Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Agen AI yang dibangun dengan Agent Builder di Microsoft 365 Copilot, Copilot Studio, dan Microsoft Foundry harus beroperasi dalam batas keamanan, tata kelola, dan kepatuhan tingkat perusahaan. Mereka juga harus dikelola dengan praktik operasional yang konsisten dan dapat diskalakan sepanjang siklus hidup mereka.

Saat agen mendapatkan otonomi, mengakses data bisnis, dan mengambil tindakan di seluruh sistem, organisasi harus memastikan mereka tetap aman berdasarkan desain, diatur sepanjang siklus hidup mereka, dan selaras dengan persyaratan risiko dan kepatuhan perusahaan. Selain itu, ketika agen berpindah dari pilot ke alur kerja bisnis sehari-hari, keunggulan operasional menjadi penting untuk mempertahankan nilai dan kepercayaan.

Pilar ini berfokus pada bagaimana organisasi membangun pagar pembatas, kontrol, praktik operasional, dan manajemen siklus hidup yang diperlukan untuk memastikan agen beroperasi dengan aman, patuh, dan andal dalam skala besar tanpa memperlambat inovasi.

Mengapa tata kelola, keamanan, dan operasi penting bagi agen AI

Agen memperkuat niat manusia dengan bertindak dalam konteks identitas, data, dan izin. Tanpa tata kelola, keamanan, dan praktik operasional yang kuat, kemampuan yang sama ini dapat menimbulkan risiko melalui paparan data yang tidak diinginkan, perilaku yang tidak konsisten, akuntabilitas yang tidak jelas, keseleo agen, atau kenaikan biaya.

Tata kelola, keamanan, dan operasi yang kuat menyediakan fondasi yang memungkinkan adopsi agen untuk menskalakan dengan aman dan berkelanjutan. Mereka memastikan bahwa perilaku agen dapat diamati, dikontrol, dan dapat diaudit, dan bahwa peningkatan otonomi cocok dengan hak keputusan yang jelas, pengawasan siklus hidup, pemantauan proaktif, dan manajemen risiko.

Pendekatan terintegrasi ini membantu kemajuan inovasi tanpa mengorbankan keselamatan, keandalan, atau efisiensi operasional.

Seperti apa kematangan tinggi

Pada tingkat kematangan yang tinggi, tata kelola, keamanan, dan operasi terintegrasi, dapat diperluas, dan mendukung alih-alih membatasi.

Karakteristik tata kelola dan keamanan:

- Organisasi mengatur agen menggunakan standar di seluruh perusahaan yang konsisten.

- Kontrol identitas, akses data, dan kepatuhan diberlakukan secara default.

- Organisasi membuat perilaku agen dapat diamati melalui log, telemetri, dan mekanisme peninjauan.

- Jalur pengawasan dan eskalasi manusia didefinisikan dengan jelas untuk setiap kelas agen.

- Tata kelola memungkinkan adopsi yang lebih cepat daripada memperlambatnya.

Karakteristik operasi dan siklus hidup:

- Teams menerapkan pola penyebaran, pemantauan, dan pemeliharaan standar secara konsisten.

- Tim menentukan telemetri operasional, pemantauan kesehatan, dan kepemilikan siklus hidup sehingga mereka dapat mengevaluasi, mengoptimalkan, atau menghentikan agen berdasarkan penggunaan dan nilai nyata.

- Teams membangun manajemen perubahan, pelatihan, dan komunikasi ke dalam operasi untuk mendorong adopsi dan kepercayaan berkelanjutan.

- Agen beralih dengan lancar dari eksperimen ke aset produksi yang andal, dengan akuntabilitas yang jelas di seluruh pemangku kepentingan TI, keamanan, dan bisnis.

Karakteristik AI yang bertanggung jawab:

- Organisasi telah mendokumen standar AI Bertanggung Jawab yang menerjemahkan prinsip ke dalam ekspektasi dan praktik konkret.

- Dewan AI lintas fungsi memberikan pengawasan aktif, panduan, dan eskalasi untuk kasus berdampak tinggi atau ambigu.

- Kepercayaan, risiko, dan etika diintegrasikan ke dalam diskusi strategis dan performa, bukan hanya respons insiden.

- Tim terus memantau sinyal keadilan, keselamatan, penyalahgunaan, dan kepercayaan sepanjang siklus hidup agen.

- Praktik AI yang bertanggung jawab disematkan berdasarkan desain di semua proses pengiriman dan operasional.

- Kepemimpinan memberikan pengawasan yang terlihat dan memperlakukan AI yang Bertanggung Jawab sebagai pembferensi strategis dan sumber kepercayaan.

Operasi, tata kelola, dan keamanan menjadi pengaktif inovasi daripada fungsi dukungan reaktif atau batasan kepatuhan.

Cara membaca tabel kematangan

Tabel ini menjelaskan bagaimana kemampuan tata kelola, keamanan, dan operasi AI berkembang di lima tingkat kematangan.

Untuk setiap tingkat, perhatikan:

- Status tata kelola dan keamanan AI: Karakteristik yang dapat diamati pada tingkat tersebut

- Peluang untuk maju: Tindakan praktis yang memungkinkan tahap kematangan berikutnya

Organisasi sering beroperasi pada tingkat yang berbeda tergantung pada kekritisan agen. Misalnya, agen produktivitas internal mungkin memerlukan kontrol yang lebih ringan daripada agen yang menghadap pelanggan atau pengambilan keputusan.

Tata kelola AI dan kematangan keamanan

| Tingkat | Status tata kelola dan keamanan AI | Kesempatan untuk maju |

|---|---|---|

| 100: Awal |

Tata kelola dan keamanan:

|

|

| 200: Dapat diulang |

Tata kelola dan keamanan:

|

|

| 300: Ditentukan |

Tata kelola dan keamanan:

|

|

| 400: Mampu |

Tata kelola dan keamanan:

|

|

| 500: Efisien |

Tata kelola dan keamanan:

|

|

Anti-pola umum

Ketika organisasi mematangkan tata kelola AI dan praktik keamanan mereka, mereka menghadapi tantangan universal yang dapat terjadi pada tingkat apa pun dan jebakan tertentu yang terkait dengan setiap tahap kematangan. Memahami pola-pola ini membantu tim mengantisipasi dan menghindari kesalahan umum.

Tantangan tata kelola universal

Masalah dasar ini dapat merusak efektivitas tata kelola pada tingkat kematangan apa pun:

- Tidak ada inventori dan tanpa kepemilikan: Teams membuat dan berbagi agen tanpa registri yang andal, status siklus hidup, atau pemilik yang dapat dipertanggungjawabkan, yang membuat audit dan respons insiden lambat dan tidak konsisten.

- Kontrol bersifat "hanya panduan" alih-alih dapat diberlakukan: Tim mendokumentasikan kebijakan tetapi tidak menerjemahkannya ke dalam kontrol teknis yang sifatnya dapat diberlakukan (misalnya, tata kelola data, kebijakan data, dan batasan sensitivitas), sehingga kepatuhan tergantung pada perilaku individu.

- Strategi lingkungan yang hilang atau diabaikan: Pembuat membangun dan menerbitkan di lingkungan yang sama tanpa pemisahan atau pagar pembatas yang jelas, yang meningkatkan risiko paparan yang tidak disengaja dan melemahkan kontrol perubahan.

- Memperlakukan semua agen dengan cara yang sama (tidak ada pendekatan berjenjang berdasarkan risiko dan kekritisan): Organisasi menerapkan satu set kontrol untuk setiap agen. Pendekatan ini terlalu membatasi agen produktivitas pribadi berisiko rendah (yang memanfaatkan AI bayangan), atau kurangnya pengaturan pada agen departemen dan misi-kritis (menciptakan kesenjangan keamanan dan kepatuhan). Pendekatan berjenjang diperlukan karena persyaratan risiko dan tata kelola meningkat saat Anda beralih dari produktivitas pribadi ke departemen dan kolaborasi tim ke beban kerja perusahaan dan misi penting.

- Kebijakan data dan tata kelola konektor tidak diperlakukan sebagai "batas keamanan agen": Teams memungkinkan agen untuk terhubung secara luas (konektor, tindakan, HTTP) tanpa batasan kebijakan yang konsisten, yang meningkatkan eksfiltrasi data dan risiko tindakan yang tidak diinginkan.

- Audit dan pemantauan adalah sesuatu yang dipikirkan belakangan: Tim tidak memusatkan log, membuat dashboard, atau menyambungkan alur kerja pusat operasi keamanan (SOC) dengan data agen. Tim hanya belajar tentang perilaku berisiko setelah insiden meningkat.

- Postur keamanan tidak secara kontinu divalidasi: Teams tidak mengandalkan status perlindungan runtime, pemindaian keamanan otomatis (jika tersedia), atau ekspektasi pengujian adversarial sistematik sebelum rilis dan pembaruan utama.

- Tata kelola biaya dan penggunaan tidak dikelola: Teams tidak mengalokasikan atau memantau biaya token, penggunaan, dan kapasitas, sehingga pengeluaran tumbuh tanpa visibilitas dan tata kelola tidak dapat memprioritaskan apa yang harus diskalakan atau dihentikan.

Anti-pola yang spesifik terhadap kematangan

Berbagai tantangan muncul seiring kemajuan organisasi melalui tingkat kematangan:

Tingkat 100 – Awal: "Proliferasi AI Bayangan"

Pola: Teams menyebarkan agen tanpa pengawasan pusat, kontrol keamanan, atau dukungan operasional.

Mengapa hal itu terjadi: Kurangnya kerangka kerja tata kelola yang jelas. Tim bergerak cepat untuk menangkap nilai tanpa menunggu standar perusahaan yang berlaku.

Risiko: Kerentanan keamanan, pelanggaran kepatuhan, akses data yang tidak terlampir, dan kekacauan operasional.

Cara menghindari: Menetapkan tata kelola dasar dan standar keamanan sebelum adopsi yang tersebar luas. Berikan jalur eskalasi yang jelas.

Tingkat 200 – Dapat diulang: "Teater tata kelola"

Pola: Membuat proses tata kelola formal yang menambahkan overhead tanpa secara bermakna meningkatkan hasil keamanan atau operasional.

Mengapa hal itu terjadi: Mentalitas kepatuhan kotak centang. Fokus pada dokumentasi atas manajemen risiko praktis.

Risiko: Inovasi yang melambat tanpa peningkatan asli dalam keamanan atau keandalan operasional.

Cara menghindari: Fokuskan tata kelola pada mitigasi risiko aktual dan efektivitas operasional. Mengukur nilai tata kelola.

Tingkat 300 – Didefinisikan: "Silo operasi"

Pola: Tata kelola dan keamanan yang terdefinisi dengan baik tetapi praktik operasional terfragmentasi di seluruh tim.

Mengapa hal itu terjadi: Tim yang berbeda mengembangkan pendekatan operasional yang berbeda. Kurangnya standar operasional bersama.

Risiko: Performa agen yang tidak konsisten, upaya duplikat, pengurangan efisiensi operasional, kontrol perubahan yang melemah.

Cara menghindari: Menerapkan kerangka kerja dan alat operasional bersama. Membangun komunitas lintas tim untuk praktik operasional.

Tingkat 400 – Mampu: "Kompleksitas otomatisasi"

Pola: Tata kelola, keamanan, dan operasi yang terlalu otomatis hingga sistem menjadi sulit dipahami atau dimodifikasi.

Mengapa itu terjadi: Keberhasilan dengan otomatisasi menciptakan tekanan untuk mengotomatiskan semuanya. Hilangnya intuisi operasional.

Risiko: Sistem Rapuh yang sulit untuk memecahkan masalah atau beradaptasi. Mengurangi kemampuan untuk menangani kasus tepi.

Cara menghindari: Menyeimbangkan otomatisasi dengan pengawasan dan pemahaman manusia. Pertahankan keahlian operasional bersama kemampuan otomatis.

Tingkat 500 – Efisien: "Stagnasi inovasi"

Pola: Kemampuan terbaik saat ini tetapi mengurangi investasi dalam pendekatan tata kelola, keamanan, atau operasional generasi berikutnya.

Mengapa itu terjadi: Keberhasilan menciptakan kenyamanan dengan pendekatan saat ini. Alokasi sumber daya berfokus pada pemeliharaan daripada maju.

Risiko: Pesaing mungkin mengembangkan pendekatan unggul. Anda mungkin melewatkan ancaman atau peluang operasional yang muncul.

Cara menghindari: Terus berinvestasi dalam kemampuan generasi berikutnya. Pantau tren dan teknologi yang muncul.

Mengoperasionalkan AI yang Bertanggung Jawab

Praktikkan AI yang bertanggung jawab dengan empat tindakan utama: tetapkan standar, tetapkan tata kelola, sematkan perlindungan dalam pengiriman dan operasi, dan bangun kebiasaan dan budaya tim.

Menentukan standar AI yang Bertanggung Jawab

Gunakan kerangka kerja yang ditetapkan, seperti prinsip Microsoft Responsible AI atau NIST AI Risk Management Framework, sebagai garis besar, lalu sesuaikan dengan konteks organisasi Anda. Terjemahkan prinsip-prinsip ke dalam:

- Tujuan yang jelas, seperti mengurangi bias dan memastikan keterjelaskan.

- Persyaratan konkret, seperti gerbang ulasan, aturan eskalasi, dan batas data.

- Alat dan praktik praktis, termasuk penilaian dampak, pengujian bias, dan pemantauan.

Menetapkan Dewan AI

Buat Dewan AI multidisiplin lintas fungsi untuk mengawasi dan memandu adopsi AI. Peran umum meliputi:

- Sponsor eksekutif (arah strategis dan prioritas)

- Pengaktifan TI dan platform (kesiapan teknis dan tata kelola)

- Manajemen perubahan (adopsi, komunikasi, umpan balik)

- Risiko, hukum, dan kepatuhan (AI yang bertanggung jawab, privasi, peraturan)

Dewan menyelaraskan penggunaan AI dengan nilai organisasi, meninjau kasus penggunaan berdampak tinggi, mengurangi risiko, dan membangun kepercayaan di seluruh pemangku kepentingan.

Menyematkan AI Yang Bertanggung Jawab ke dalam pengiriman dan operasi

- Mulai setiap proyek AI dengan kickoff AI yang Bertanggung Jawab: tanyakan bagaimana sistem dapat menyebabkan kerusakan atau ketidakadiran dan merencanakan mitigasi lebih awal.

- Pastikan pengguna tahu kapan mereka berinteraksi dengan AI dan bagaimana keputusan dibuat.

- Pantau agen secara terus menerus untuk keadilan, keamanan, penyalahgunaan, dan sinyal kepercayaan.

- Perlakukan AI yang Bertanggung Jawab sebagai tanggung jawab operasional yang berkelanjutan, bukan hanya sekadar kotak centang.

Membangun kebiasaan dan budaya AI yang Bertanggung Jawab

AI yang bertanggung jawab berhasil ketika menjadi bagian dari cara kerja tim:

- Dorong tim untuk mendokumenkan keputusan dan asumsi.

- Membuat kekhawatiran etis agar diharapkan dan aman.

- Gunakan skenario, latihan radar risiko, dan retrospektif untuk mempraktikkan respons.

- Perkuat bahwa AI Yang Bertanggung Jawab adalah pekerjaan semua orang, tidak hanya tata kelola.

Menghindari kesalahan dalam penerapan AI yang bertanggung jawab

Organisasi yang berjuang untuk menskalakan agen AI dengan aman sering mengalami tantangan berikut dengan mengoperasionalkan Responsible AI. Pendekatan ini menciptakan risiko tersembunyi yang muncul hanya setelah adopsi terhenti, atau insiden terjadi.

Kebingungan antara AI Bertanggung Jawab dengan keamanan atau kepatuhan saja

Pola: Memperlakukan AI yang Bertanggung Jawab sebagai identik dengan keamanan data atau kepatuhan terhadap peraturan.

Mengapa pendekatan ini menciptakan risiko:

- Anda melewatkan risiko kepercayaan seperti kewajaran, keterjelaskan, dan keyakinan karyawan.

- Sistem mungkin sesuai tetapi masih ditolak oleh pengguna.

- Adopsi melambat bahkan ketika teknologi bekerja.

Memperlakukan AI yang Bertanggung Jawab sebagai tinjauan satu kali

Pola: Menangani AI yang Bertanggung Jawab sebagai daftar periksa pra-penyebaran atau langkah keluar. Setelah agen ditayangkan, tim menganggap pekerjaan tersebut sudah selesai.

Mengapa pendekatan ini menciptakan risiko:

- Sistem AI berubah dari waktu ke waktu seiring berkembangnya permintaan, data, dan pola penggunaan.

- Bias, penyalahgunaan, dan penyimpangan kepercayaan biasanya muncul setelah tayang langsung, bukan sebelumnya.

- Tim-tim tidak siap saat masalah muncul dan beralih ke pemadaman reaktif.

Pendekatan ini mengarah langsung ke pola respons "panik dan matikan sesuatu" yang disorot dalam skenario kematangan.

Mengandalkan percakapan etika informal

Pola: Kekhawatiran etis tergantung pada apakah seseorang di ruang tersebut mengajukannya. Tim tidak memiliki standar, peran, atau jalur eskalasi yang ditentukan.

Mengapa pendekatan ini menciptakan risiko:

- Cakupan risiko menjadi tidak konsisten di seluruh tim dan domain.

- Tim melewatkan kasus penggunaan berdampak tinggi yang membutuhkan pengamatan yang sesuai.

- Akuntabilitas tidak jelas ketika ada yang salah.

Pendekatan ini mencerminkan kematangan Tingkat 100–200, di mana kesadaran ada tetapi tindakan tidak merata.

Tidak ada Dewan AI, atau dewan tanpa otoritas

Pola: Dewan AI ada "di atas kertas" atau sebagai forum diskusi, tetapi tidak memiliki mandat yang jelas, hak keputusan, atau sponsor eksekutif.

Mengapa pendekatan ini menciptakan risiko:

- Teams mengabaikan atau menerapkan panduan secara selektif.

- Tim mengabaikan tata kelola untuk bergerak lebih cepat.

- Tim risiko, hukum, TI, dan perubahan tetap tidak selaras.

Tanpa kewenangan, dewan tidak dapat mencegah hambatan nantinya dalam proses pengiriman, yang memperlambat adopsi daripada mendukungnya.

Menunggu insiden terjadi untuk belajar

Pola: Tim mengasumsikan mereka akan "menangani masalah jika timbul" daripada menyiapkan rencana respons terlebih dahulu.

Mengapa pendekatan ini menciptakan risiko:

- Respons reaktif dan tidak konsisten.

- Belajar itu menyakitkan, publik, dan mahal.

- Keyakinan pada AI turun dengan cepat setelah insiden pertama.

Organisasi dengan kematangan tinggi merancang strategi respons sebelum terjadi kesalahan.

Risiko umum ketika Anda tidak mengoperalisasi AI yang Bertanggung Jawab

Ketika Anda tidak menyematkan AI Bertanggung Jawab dalam pengiriman dan operasi, atau ketika tidak ada Dewan AI yang efektif, risiko muncul selama pengiriman, dalam operasi, dan di tingkat organisasi.

-

Selama pengiriman:

- Teams mengirimkan agen yang tidak bisa menjelaskan keputusan kepada pengguna.

- Bias atau hasil yang tidak adil muncul dalam alur kerja berdampak tinggi seperti SDM, keuangan, dan layanan pelanggan.

- Tidak ada yang tahu siapa yang harus menyetujui perubahan atau menghentikan penyebaran.

-

Dalam operasi:

- Insiden memicu respons darurat alih-alih penyelidikan terstruktur.

- Tim sepenuhnya mematikan agen, mengalihkan pekerjaan ke proses manual.

- Kepercayaan pada AI turun di seluruh organisasi, bukan hanya untuk satu kasus penggunaan.

-

Di tingkat organisasi:

- Pemimpin kehilangan keyakinan pada otonomi agen.

- Pengadopsian terhambat meskipun kemampuan teknis yang kuat.

- Tim melihat para agen sebagai risiko dan bukan sebagai aset strategis.

Gunakan radar risiko AI yang bertanggung jawab untuk mengidentifikasi dan mengurangi risiko agen

Radar risiko AI yang bertanggung jawab adalah aktivitas ringan dan berulang yang membantu Anda mengidentifikasi, memprioritaskan, dan mengatasi risiko AI yang Bertanggung Jawab sebelum Anda menyebarkan agen ke dalam produksi.

Daripada memperlakukan AI yang Bertanggung Jawab sebagai pemeriksaan kepatuhan akhir, radar risiko menyematkan pemikiran risiko langsung ke dalam pengiriman dan operasi. Ini mendukung tata kelola proaktif dan skala tepercaya. Tim pengiriman, Centers of Excellence, dan Dewan AI dapat menjalankan aktivitas ini. Mereka dapat menggunakannya kembali di titik-titik penting dalam siklus hidup agen (desain, prarilis, tinjauan pasca-insiden).

Radar risiko membantu tim:

- Membuat risiko AI yang Bertanggung Jawab terlihat dan mudah dibahas.

- Mengaitkan risiko dengan enam prinsip AI yang bertanggung jawab: kewajaran; transparansi; akuntabilitas; keandalan dan keselamatan; privasi dan keamanan; serta inklusivitas.

- Prioritaskan risiko berdasarkan dampak dan kemungkinan.

- Menerjemahkan risiko ke dalam tindakan konkret dan kebiasaan tim.

- Berikan input terstruktur ke Dewan AI atau forum tata kelola.

Gunakan radar risiko saat:

- Merancang agen AI baru atau fitur berdampak tinggi.

- Menyiapkan agen untuk penyebaran ke lingkungan produksi.

- Menyelidiki insiden atau masalah kepercayaan.

- Meninjau perilaku agen sebagai bagian dari operasi yang sedang berlangsung.

- Mendukung tinjauan Dewan AI tentang kasus penggunaan sensitif atau lintas domain.

Cara menggunakan radar risiko

Jalankan sesi radar risiko AI yang Bertanggung Jawab dengan menggunakan langkah-langkah berikut:

Pilih kasus penggunaan konkret: Mulailah dengan skenario tertentu, seperti agen layanan pelanggan dengan akses CRM atau agen dukungan keputusan SDM. Hindari diskusi abstrak. Kasus penggunaan nyata memunculkan risiko nyata.

Identifikasi risiko di seluruh prinsip AI yang Bertanggung Jawab: Sebagai kelompok, curah otak potensi risiko di seluruh kategori berikut:

- Keadilan

- Transparansi

- Akuntabilitas

- Keandalan dan keamanan

- Privasi dan keamanan

- Inklusivitas

Menangkap risiko tanpa pemfilteran. Pada tahap ini, fokuskan pada cakupan, bukan kesempurnaan.

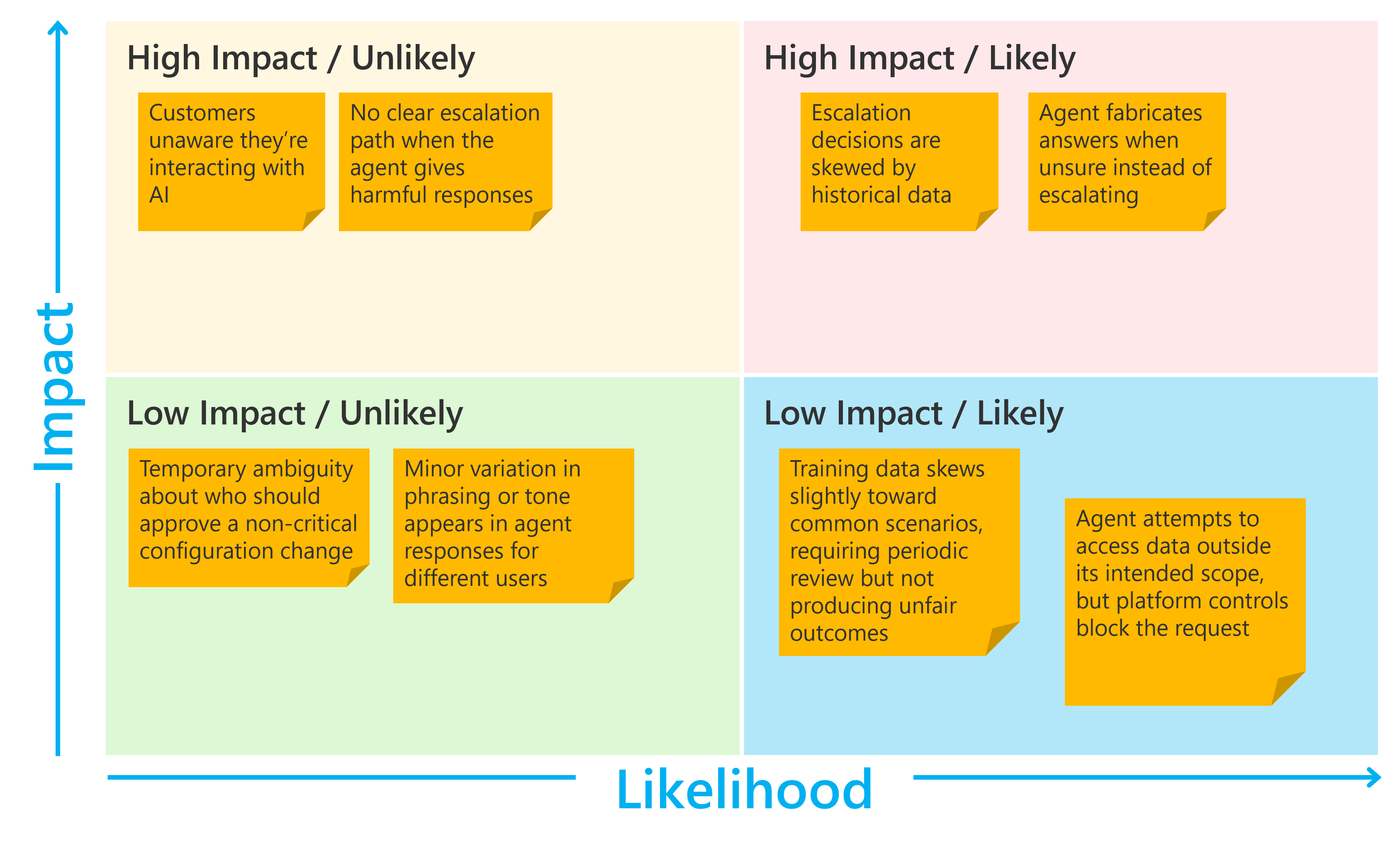

Memetakan risiko pada radar risiko: Tempatkan setiap risiko yang diidentifikasi pada Radar Risiko menggunakan dua dimensi:

- Dampak (Rendah → Tinggi): Seberapa parah dampaknya jika risiko ini terjadi?

- Kemungkinan (Tidak mungkin →): Seberapa besar risiko ini mengingat desain saat ini?

Pemetaan visual ini membantu Anda dengan cepat membedakan antara kasus tepi berprioritas rendah dan risiko berdampak tinggi dan kemungkinan tinggi yang membutuhkan perhatian segera.

Contoh skenario: Organisasi Anda menyebarkan agen untuk menangani kueri dan keluhan pelanggan di beberapa saluran—email, obrolan, dan suara. Agen terintegrasi dengan sistem manajemen hubungan pelanggan (CRM) dan memiliki akses ke riwayat pelanggan, preferensi, dan data transaksi. Agen dapat mengeskalasi kasus kompleks ke agen manusia.

Tentukan tindakan dan kebiasaan untuk risiko teratas: Untuk dua hingga tiga risiko prioritas tertinggi, tentukan:

- Tindakan, seperti memperkenalkan langkah persetujuan manusia, melibatkan Dewan AI, atau menambahkan pemantauan.

- Kebiasaan atau perilaku untuk disematkan ke dalam praktik tim, seperti tinjauan keterjelasan wajib sebelum rilis.

Contoh:

Risiko Prinsip AI yang bertanggung jawab Dampak Kemungkinan Action Kebiasaan Pelanggan tidak menyadari bahwa mereka berinteraksi dengan AI Transparansi High Tidak mungkin Memastikan penjelasan, pengungkapan, dan kutipan sehingga pengguna diberi tahu dengan jelas ketika agen kecerdasan buatan (AI) terlibat. Tinjau kasus secara teratur di mana transparansi bisa lebih jelas. Tidak ada jalur eskalasi yang jelas ketika agen memberikan respons berbahaya Akuntabilitas High Tidak mungkin Buat protokol eskalasi AI yang menentukan kapan dan bagaimana agen harus menyerahkan kepada manusia. RAI unggul dalam tim dukungan. Menominasikan pemilik agar celah-celah eskalasi dapat diidentifikasi lebih awal. Keputusan eskalasi dipengaruhi oleh data historis Keadilan High Mungkin Lakukan audit bias reguler menggunakan berbagai kasus pengujian dan tindakan korektif dokumen. Tantangan mendeteksi bias. Jalankan latihan berkala untuk mengidentifikasi dan memperbaiki perilaku bias. Agen membuat jawaban ketika tidak yakin alih-alih mengeskalasikan masalah tersebut Transparansi High Mungkin Buat protokol eskalasi AI dengan ambang batas yang jelas untuk ketidakpastian dan topik sensitif. Retro RAI dalam ulasan dukungan. Sertakan "momen RAI" dalam retro mingguan. Ambiguitas sementara tentang siapa yang harus menyetujui perubahan konfigurasi non-kritis Akuntabilitas Low Tidak mungkin Menetapkan Dewan AI untuk mengklarifikasi hak keputusan dan kepemilikan. RAI unggul dalam tim dukungan. Memperkuat kepemilikan untuk perubahan berisiko rendah. Variasi kecil dalam pembuatan frasa atau nada muncul dalam respons agen untuk pengguna yang berbeda Keadilan Low Tidak mungkin Lakukan audit bias reguler untuk meninjau nada dan konsistensi bahasa. Tantangan mendeteksi bias. Dorong tim untuk mengidentifikasi bias halus lebih awal. Data pelatihan sedikit condong ke skenario umum, membutuhkan peninjauan berkala Keadilan Low Mungkin Terapkan daftar periksa peninjauan AI yang akuntabel yang mencakup pemeriksaan keseimbangan data. Perulangan umpan balik pelanggan. Tinjau respons yang ditandai setiap minggu untuk mendeteksi penyimpangan. Agen mencoba mengakses data di luar cakupan yang dimaksudkan, tetapi kontrol memblokir permintaan Privasi dan keamanan Low Mungkin Terapkan daftar periksa peninjauan AI yang bertanggung jawab untuk memvalidasi batas akses data. Perulangan umpan balik pelanggan. Memantau upaya dan pola akses yang diblokir.

Pendekatan ini memastikan AI bertanggung jawab beralih dari kesadaran ke eksekusi dan budaya.

Menggunakan pilar ini dalam praktiknya

Untuk desain tata kelola: Gunakan pilar ini untuk membuat kerangka kerja tata kelola yang memungkinkan inovasi sekaligus mengelola risiko dan memastikan kepatuhan.

Untuk implementasi keamanan: Terapkan pilar ini untuk membangun kontrol keamanan yang melindungi agen dan data tanpa menghambat pengalaman pengguna atau efisiensi operasional.

Untuk keunggulan operasional: Gunakan pilar ini untuk membangun praktik operasional yang memastikan agen tetap andal, berkinerja, dan berharga sepanjang siklus hidup mereka.

Langkah selanjutnya

Artikel berikutnya mengeksplorasi cara membangun fondasi teknis dan strategi data yang dapat diskalakan dan aman untuk adopsi agen AI.

Informasi terkait

- Mengelola dan Mengatur Agen

- Keamanan dan tata kelola Sistem Kontrol Copilot

- Dokumentasi Microsoft Agent 365

- Situs pedoman penerapan Microsoft 365 Copilot

- Situs adopsi Agen AI

- Data, Privasi, dan Keamanan untuk Microsoft 365 Copilot

- Keamanan dan tata kelola Copilot Studio

- Mengelola proyek Copilot Studio Anda

- Tata kelola dan keamanan untuk agen AI di seluruh organisasi