Transisi dari MLOps tradisional ke LLMOps

MLOps (Operasi Pembelajaran Mesin) dan LLMOps (Operasi Model Bahasa Besar) mewakili dua paradigma yang berbeda dalam operasionalisasi model pembelajaran mesin, masing-masing dengan serangkaian tantangan, alat, dan alur kerjanya sendiri.

Meskipun MLOps tradisional berfokus pada penyebaran dan pengelolaan berbagai model pembelajaran mesin, LLMOps disesuaikan khusus untuk Model Bahasa Besar (LLM), yang memiliki persyaratan unik dalam hal skala, manajemen data, dan penyetelan model.

Azure Databricks mendukung MLOps dan LLMOps, tetapi detail implementasinya berbeda secara signifikan. Mari kita jelajahi perbedaannya dengan membandingkan MLops dengan LLMOps.

Membandingkan MLOps dengan LLMOps

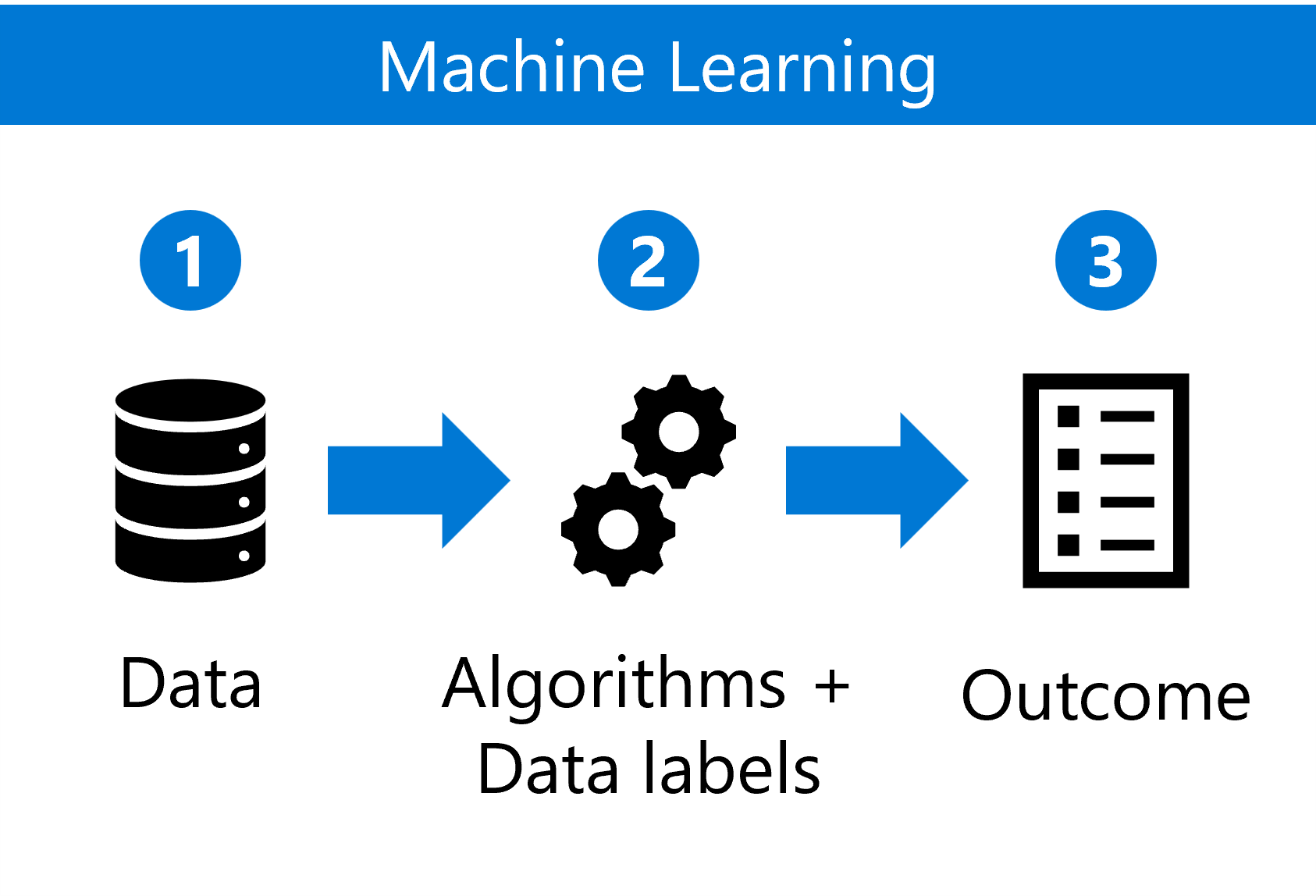

Pembelajaran mesin tradisional biasanya melibatkan pelatihan model, seperti model regresi, atau jaringan saraf yang lebih kompleks.

Proses pembelajaran mesin meliputi:

- Mengumpulkan, menjelajahi, dan menyiapkan himpunan data yang sesuai.

- Memilih algoritma dan menentukan label data.

- Menggunakan model terlatih untuk menghasilkan prediksi pada data baru.

Fokus operasional adalah memastikan bahwa model ini dapat menskalakan secara efisien di berbagai lingkungan dan volume data.

Azure Databricks memfasilitasi MLOps dengan menyediakan sumber daya komputasi yang dapat diskalakan, integrasi dengan Azure Pembelajaran Mesin, dan alat seperti MLflow untuk pelacakan dan penyebaran model.

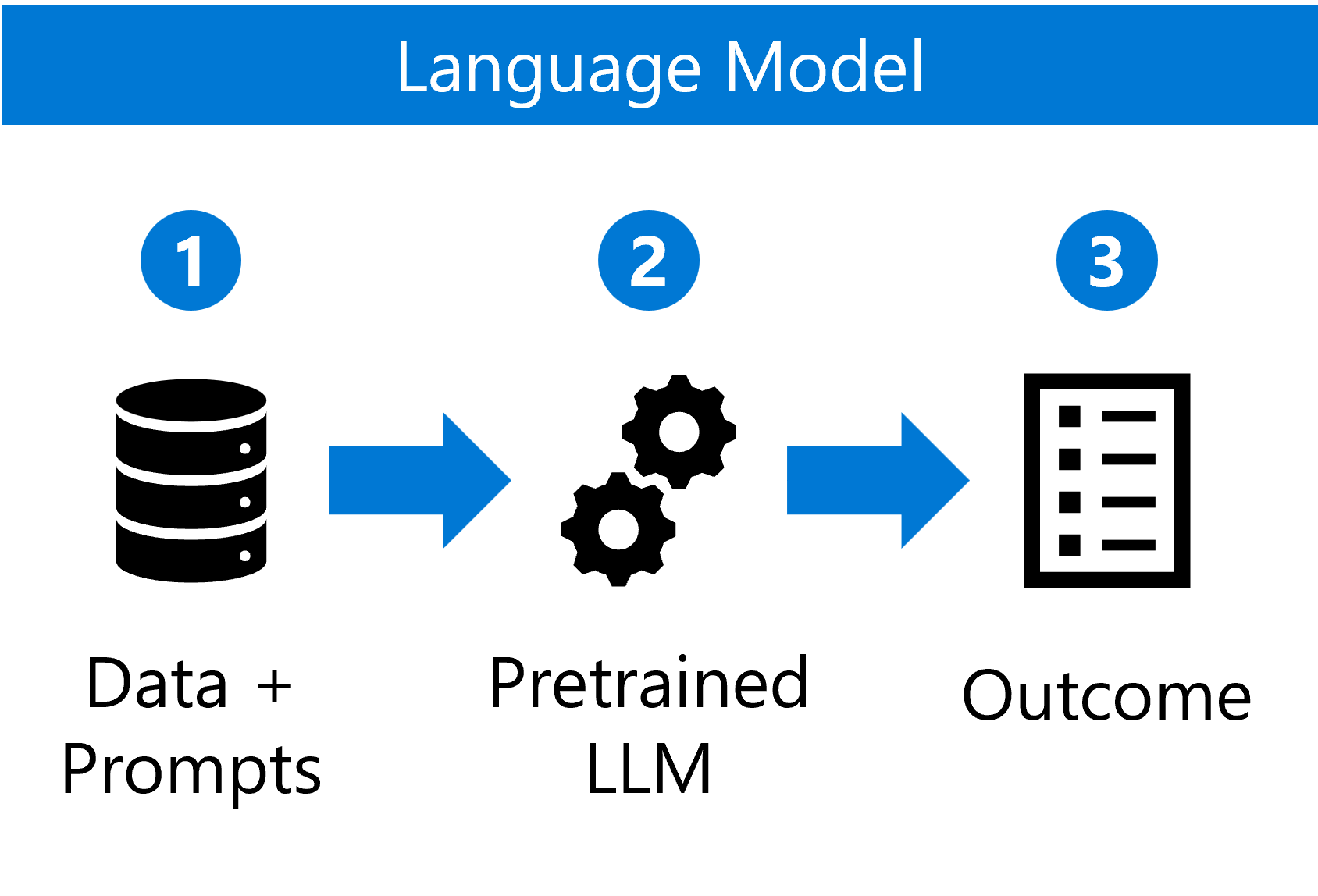

LLMOps, di sisi lain, menangani model bahasa yang telah dilatih sebelumnya yang bekerja dengan konstruksi seperti input berbasis teks, yang dikenal sebagai perintah.

Proses penggunaan model bahasa meliputi:

- Menggabungkan data dengan perintah yang diharapkan.

- Memilih dan mengonfigurasi model bahasa yang telah dilatih sebelumnya.

- Menggunakan model yang dikonfigurasi untuk menghasilkan respons pada perintah baru.

LLMOps menangani model yang urutannya lebih besar, seperti GPT-3 atau GPT-4. LLM tidak hanya membutuhkan lebih banyak daya komputasi tetapi juga infrastruktur khusus untuk menangani skala mereka.

Azure Databricks menawarkan kluster yang dioptimalkan, komputasi terdistribusi, dan integrasi dengan Azure OpenAI, memungkinkan penyebaran LLM dalam skala besar.

Ketika kita membandingkan MLOps dengan LLMOps, ada beberapa perbedaan utama yang perlu kita pahami.

Mengelola data teks yang tidak terstruktur

Dalam MLOps tradisional, manajemen data berpusat di sekitar data terstruktur dan semi terstruktur. Dalam manajemen data, fokusnya terletak pada praproses data, rekayasa fitur, dan otomatisasi alur.

LLMOps, bagaimanapun, memerlukan penanganan sejumlah besar data teks yang tidak terstruktur, mengharuskan penyerapan data yang lebih canggih dan alur pra-pemrosesan.

Azure Databricks, dikombinasikan dengan Microsoft Foundry, memungkinkan pengambilan dan pemrosesan korpus teks besar, serta efisiensi pelatihan dan penyempurnaan LLM.

Menyempurnakan alih-alih pelatihan dari awal

MLOps tradisional sering melibatkan pelatihan model berulang dan penyetelan hiperparameter, dengan fokus pada pengoptimalan performa model untuk tugas tertentu. Alat seperti Hyperopt dan AutoML (Automated Pembelajaran Mesin) di Azure Databricks membantu mengotomatiskan proses ini.

LLMOps, bagaimanapun, menempatkan penekanan yang lebih besar pada menyempurnakan model yang telah dilatih sebelumnya pada tugas atau domain tertentu.

Azure Databricks mendukung penyempurnaan melalui integrasinya dengan layanan Azure OpenAI, memungkinkan pengguna menyempurnakan LLM seperti GPT-4 dengan perubahan kode minimal, menggunakan kekuatan komputasi terdistribusi untuk waktu pelatihan yang lebih cepat.

Mengonsumsi model Anda yang disebarkan

Dalam MLOps tradisional, penyebaran melibatkan integrasi model ke dalam sistem produksi menggunakan REST API, pemrosesan batch, atau titik akhir inferensi real time.

Namun, di LLMOps, penyebaran terjadi sebelumnya dalam siklus hidup karena Anda bekerja dengan model yang telah dilatih sebelumnya dan berfokus pada mengonfigurasi cara memanggil model yang disebarkan ini. Di LLMOps, strategi penyebaran Anda berbeda dari praktik MLOps tradisional.

Azure Databricks menawarkan titik akhir terkelola untuk menyebarkan LLM, dengan pemantauan dan pengelogan bawaan untuk memastikan performa dan keandalan model di lingkungan produksi. Atau, Anda dapat menyebarkan LLM dengan Azure OpenAI dan Microsoft Foundry, lalu menggunakan dan mengonfigurasinya di Azure Databricks.

Amankan sistem Anda dan terapkan AI yang bertanggung jawab

Tata kelola, kepatuhan, dan penggunaan AI yang bertanggung jawab sangat penting dalam MLOps tradisional. Terutama di industri seperti keuangan dan layanan kesehatan, di mana model perlu mematuhi persyaratan peraturan yang ketat.

LLMOps memperkenalkan tantangan lain di area ini:

- Keamanan dan moderasi konten diperlukan untuk mencegah penyebaran informasi berbahaya.

- Jailbreak dan langkah-langkah keamanan melindungi dari serangan musuh.

- Memastikan transparansi dan keterjelasan membangun kepercayaan dengan membuat keputusan model dapat dimengerti.

- Pemantauan berkelanjutan dan perulangan umpan balik menjaga akurasi model, kewajaran, dan keamanan dari waktu ke waktu.

Ketika Anda mengatasi tantangan ini, Anda memastikan bahwa LLM dikembangkan dan disebarkan secara bertanggung jawab, mematuhi standar tata kelola, kepatuhan, dan praktik AI yang bertanggung jawab tertinggi.