Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Windows Server Failover Clustering mendukung berbagai topologi penyebaran untuk memenuhi beragam persyaratan bisnis akan ketersediaan tinggi dan pemulihan bencana untuk aplikasi, layanan, dan data Anda. Topologi ini memberikan keandalan, ketahanan, dan waktu aktif yang penting di seluruh lingkungan lokal, hibrid, cloud publik, cloud privat, dan cloud berdaulat.

Topologi yang Anda pilih tergantung pada faktor-faktor seperti infrastruktur fisik Anda, persyaratan latensi jaringan, batasan anggaran, dan tujuan pemulihan. Memahami topologi ini membantu Anda merancang solusi yang tepat untuk beban kerja Anda.

Anda juga dapat menggunakan klaster failover dalam deployment Azure Local untuk menyediakan ketersediaan tinggi di lokasi edge. Untuk informasi selengkapnya tentang Azure Local, lihat Apa itu penyebaran hyperkonvergensi Azure Local?

Topologi

Cluster Failover Windows Server mendukung beberapa topologi, masing-masing dengan kelebihan dan kompromi sendiri. Topologi utama meliputi:

- Kluster sederhana (domain kesalahan tunggal)

- Kluster kampus Storage Spaces Direct

- Kluster jarak jauh Storage Spaces Direct

- Kluster sebaran SAN

- Topologi multi-kluster

Bagian berikut memberikan gambaran umum tentang setiap topologi, termasuk kasus penggunaan, manfaat, dan batasannya.

Domain kesalahan dalam klaster failover

Sebelum menjelajahi topologi tertentu, penting untuk memahami konsep domain kesalahan dalam kluster failover. Domain kesalahan adalah pengelompokan logis komponen perangkat keras yang berbagi titik kegagalan umum. Ketika satu komponen dalam domain kesalahan gagal, itu dapat berpotensi mempengaruhi semua komponen lain di domain yang sama.

Contoh umum domain kesalahan meliputi:

- Tingkat node: Kegagalan server individual karena masalah perangkat keras, masalah sistem operasi, atau pemeliharaan

- Tingkat rak: Infrastruktur bersama dalam rak, seperti unit distribusi daya (PDU), sakelar jaringan di atas rak (TOR), atau sistem pendinginan.

- Tingkat ruang atau pusat data: Sistem di seluruh bangunan seperti umpan daya utama, sistem pendinginan, atau keamanan fisik

- Tingkat situs: Risiko khusus lokasi geografis seperti bencana alam, pemadaman listrik regional, atau masalah konektivitas jaringan

Saat Anda merancang kluster failover, pemahaman dan perencanaan untuk domain kesalahan sangat penting untuk mencapai tingkat ketersediaan dan ketahanan yang Anda inginkan. Kluster yang dirancang dengan baik terus beroperasi bahkan ketika seluruh domain kesalahan gagal. Contohnya:

- Kluster sederhana dengan keseluruhan simpul dalam satu rak dapat bertahan dari kegagalan simpul individu, tetapi bukan kegagalan tingkat rak.

- Kluster kampus dengan simpul-simpul yang didistribusikan di dua rak dapat bertahan dari kegagalan seluruh satu rak.

- Kluster rentang dengan simpul di situs geografis terpisah dapat bertahan dari kegagalan total situs.

Jumlah dan jenis domain kesalahan dalam topologi Anda berdampak langsung pada kemampuan kluster Anda untuk mempertahankan layanan selama berbagai skenario kegagalan. Lebih banyak domain kesalahan umumnya memberikan ketahanan yang lebih tinggi tetapi dilengkapi dengan peningkatan kompleksitas dan biaya.

Untuk informasi selengkapnya tentang domain kesalahan di Windows Server, lihat Kesadaran domain kesalahan.

Perbandingan topologi

Tabel berikut membandingkan karakteristik utama dari setiap topologi pengklusteran failover:

| Karakteristik | Kluster Sederhana | Storage Spaces Direct Kluster Kampus | Kluster Peregangan Langsung Ruang Penyimpanan | Kluster Peregangan SAN | Multi-Kluster |

|---|---|---|---|---|---|

| Cakupan geografis | Domain gangguan tunggal | Lokasi fisik yang sama, bangunan terpisah | Situs geografis terpisah | Situs geografis terpisah | Beberapa situs terpisah |

| Jenis jaringan | LAN (Jaringan Lokal) | LAN (Jaringan Lokal) | LAN atau WAN | LAN atau WAN | Ditentukan oleh persyaratan beban kerja |

| Latensi optimal | ≤1 ms | ≤1 ms |

≤1-5 ms (sinkron) Variabel (asinkron) |

Ditentukan oleh vendor SAN | Variabel (beban kerja ditentukan) |

| Konfigurasi penyimpanan | TARGET SAN, NAS, atau iSCSI / Kumpulan Langsung Ruang Penyimpanan Tunggal / gabungan | Kumpulan Ruang Penyimpanan Tunggal Langsung yang mencakup rak | Memisahkan kumpulan Storage Spaces Direct per lokasi | SAN LUN direplikasi antar situs | Penyimpanan mandiri per kluster |

| Metode replikasi penyimpanan | Tidak ada | Ruang Penyimpanan Direct Rack Level Nested Mirror | Replika Penyimpanan | Replikasi SAN vendor | Tingkat aplikasi atau Replika Penyimpanan |

| Domain kesalahan | Node saja | 2 domain kesalahan | Domain kesalahan 2 | 2 bidang kesalahan | Kluster mandiri |

| Melindungi dari | Kegagalan node, Node + disk | Kegagalan rak + simpul (konfigurasi 2+2) | Kegagalan situs | Kegagalan situs | Kegagalan lokasi + kluster |

| Kompleksitas penyebaran | Kurang Penting | Menengah | Tinggi | Tinggi | Tinggi |

| Kasus penggunaan utama | Pusat data tunggal HA | Ketersediaan Tinggi Lingkungan Kampus/multi-bangunan | DR wilayah metro | DR wilayah metro | DR di multi-wilayah |

Konfigurasi penyimpanan

Pengelompokan Failover Windows Server mendukung berbagai arsitektur penyimpanan. Anda dapat menggabungkan arsitektur ini dengan topologi kluster yang berbeda untuk memenuhi persyaratan performa, skalabilitas, dan ketersediaan Anda. Pilihan arsitektur penyimpanan Anda memengaruhi bagaimana skala sumber daya komputasi dan penyimpanan, ketahanan data, dan perilaku kluster secara keseluruhan.

Arsitektur penyimpanan utama meliputi:

Penyimpanan SAN atau NAS: Penyimpanan bersama eksternal yang diakses melalui jaringan, memungkinkan komputasi dan penyimpanan untuk diskalakan secara independen.

Hyperconverged: Ruang Penyimpanan Langsung mengumpulkan disk lokal di seluruh node kluster dengan penskalaan komputasi dan penyimpanan yang simetris.

Ruang Penyimpanan Yang Tidak Diagregasi Langsung: Pisahkan kluster komputasi dan penyimpanan dengan penskalaan independen dari setiap tingkatan.

Hyperconverged dengan penyimpanan SAN: Menggabungkan Storage Spaces Direct dengan penyimpanan SAN eksternal di kluster yang sama.

Arsitektur campuran: Beberapa jenis penyimpanan yang melayani kluster komputasi yang sama untuk strategi penskalaan yang fleksibel.

Untuk informasi terperinci tentang setiap arsitektur penyimpanan, termasuk karakteristik penskalaan, pertimbangan perencanaan, dan panduan penyebaran, lihat Failover Clustering Storage Architectures.

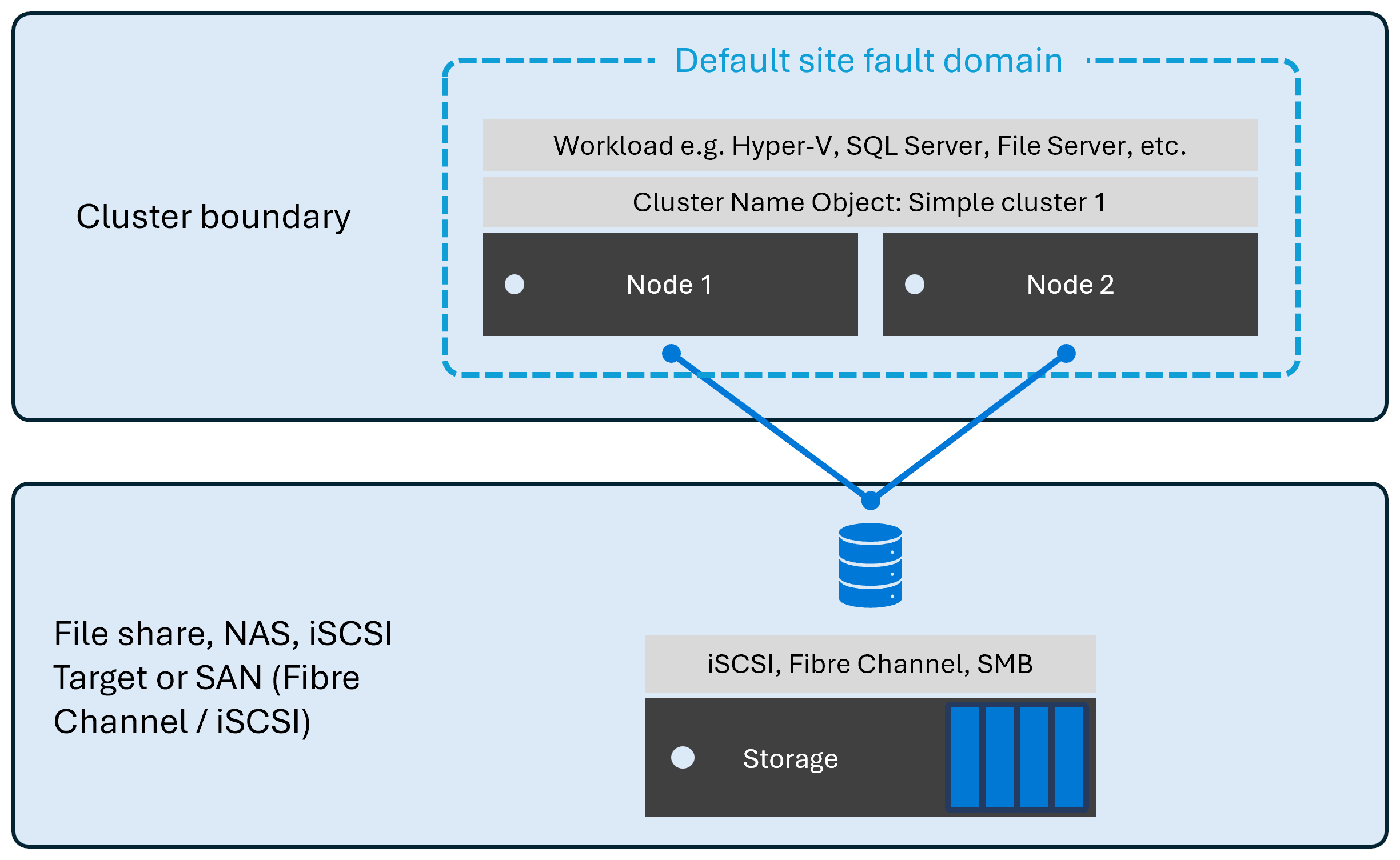

Kluster sederhana (domain kesalahan tunggal)

Kluster sederhana menempatkan semua node kluster dalam satu domain kesalahan, biasanya di rak fisik yang sama di ruang pusat data. Topologi ini adalah topologi kluster failover yang paling umum dan mudah. Semua simpul berada dalam satu rak, dengan penyimpanan bersama yang dapat berupa SAN, NAS, Storage Spaces Direct (S2D), atau S2D dengan koeksistensi SAN. Konfigurasi ini memberikan redundansi tingkat simpul dan perlindungan terhadap kegagalan server individual sambil mempertahankan latensi jaringan terendah antar simpul.

Diagram berikut mengilustrasikan contoh topologi kluster sederhana dengan semua simpul di domain kegagalan situs subnet default menggunakan konfigurasi penyimpanan yang terpencar.

Topologi ini sangat ideal untuk penyebaran pusat data tunggal, beban kerja yang membutuhkan performa tinggi dengan latensi minimal, organisasi dengan infrastruktur fisik terbatas, dan lingkungan pengembangan dan pengujian. Ini adalah konfigurasi paling sederhana untuk menyebarkan dan mengelola, menjadikannya titik awal yang sangat baik bagi banyak organisasi.

Dalam kluster sederhana, Anda dapat menggabungkan Storage Spaces Direct dengan solusi penyimpanan bersama seperti solusi SAN atau NAS, atau menggunakan Storage Spaces Direct saja. Untuk mempelajari selengkapnya tentang menggabungkan solusi penyimpanan, lihat Hyperconverged dengan penyimpanan SAN.

Namun, topologi ini memiliki batasan penting. Ini tidak memberikan perlindungan terhadap kegagalan yang dapat memengaruhi seluruh domain kesalahan. Misalnya, jika domain kesalahan berada pada tingkat rak, kegagalan seperti masalah distribusi daya atau kegagalan top-of-rack switch dapat memengaruhi ketersediaan kluster Anda. Ini juga tidak menawarkan perlindungan terhadap pusat data yang lebih luas atau bencana tingkat situs. Infrastruktur rak itu sendiri mewakili satu titik kegagalan yang harus diterima organisasi saat memilih topologi ini.

Kluster kampus Storage Spaces Direct

Kluster kampus Storage Spaces Direct adalah konfigurasi dua rak dalam lokasi fisik yang sama, seperti pabrik, rumah sakit, kampus perguruan tinggi, atau pusat data yang terhubung oleh infrastruktur jaringan area lokal (LAN) latensi rendah. Kluster kampus menyediakan ketahanan pada tingkat rak melalui Storage Spaces Direct (S2D) dengan volume dua salinan atau empat salinan, yang dikenal sebagai Rack Level Nested Mirror (RLNM). Pendekatan ini berarti data didistribusikan secara cerdas di seluruh rak. Topologi ini dirancang untuk melindungi dari kegagalan tingkat rak sambil mempertahankan latensi rendah antar simpul.

Diagram berikut mengilustrasikan contoh topologi kluster kampus Storage Spaces Direct dengan node yang didistribusikan di dua domain kesalahan rak dalam lokasi fisik yang sama.

Kluster kampus memerlukan Windows Server 2025 dengan pembaruan kumulatif Desember yang diinstal (KB5072033). Kluster kampus hanya mendukung dua area kegagalan rak dalam lokasi fisik yang sama dan terhubung melalui LAN. Topologi ini berbeda secara signifikan dari kluster stretch, yang mencakup lokasi-lokasi yang dipisahkan secara geografis dan terhubung melalui WAN serta menggunakan Replika Penyimpanan untuk replikasi antar lokasi. Topologi ini memberikan ketahanan tingkat rak untuk Hyper-V VM, SQL Server FCI, Server File, SAP, dan aplikasi lainnya.

Konfigurasi ini memerlukan tepat dua domain kesalahan pada rak dengan satu pool penyimpanan Storage Spaces Direct (S2D) yang mencakup kedua rak. Rack Level Nested Mirror (RLNM) mendistribusikan salinan data di seluruh rak: volume dua salinan menempatkan satu salinan di setiap rak, sementara volume empat salinan menempatkan dua salinan di setiap rak. Semua drive dengan kapasitas harus berjenis yang sama. Drive berbasis flash (SSD atau NVMe) direkomendasikan untuk performa optimal. Lapisan cache dan HDD tidak direkomendasikan.

Kluster kampus menggunakan konektivitas LAN dan membutuhkan latensi 1 milidetik atau kurang antar rak. RDMA NIC dan sakelar disarankan untuk mengurangi overhead CPU. Konfigurasi bekerja paling baik dengan untaian kabel serat gelap yang redundan antara rak, dan sakelar top-of-rack (TOR) dengan ketersediaan tinggi untuk menghindari titik kegagalan tunggal. Setiap rak harus memiliki jalur jaringan terpisah ke sumber daya kuorum kluster.

Topologi ini sangat cocok untuk lingkungan kampus termasuk pabrik, taman bisnis, rumah sakit, kampus sekolah dan perguruan tinggi, kapal dan kapal pesiar, dan stadion. Ini juga ideal untuk organisasi yang memenuhi persyaratan NIS2 untuk ruang data terpisah, atau lokasi mana pun dengan dua bangunan atau ruangan yang terhubung oleh serat.

Kluster kampus mendukung distribusi simpul simetris (simpul per domain kesalahan rak) dengan volume dua dan empat salinan yang direkomendasikan. Misalnya, 1+1, 2+2, 3+3, dan seterusnya, hingga maksimum 10 simpul (5+5).

Konfigurasi umum meliputi:

- 1+1: Satu simpul per domain kesalahan pada rak, konfigurasi minimum. Konfigurasi ini menggunakan mirror dua arah bertingkat dengan volume empat salinan untuk ketahanan data maksimum. Untuk mempelajari lebih lanjut pencerminan sarang, lihat Ketahanan berlapis untuk Ruang Penyimpanan Langsung.

- 2+2: Dua node per domain kesalahan rak, menggunakan kombinasi volume dua salinan atau empat salinan.

Petunjuk / Saran

Konfigurasi 2+2 dengan empat salinan volume memberikan keseimbangan terbaik antara biaya, performa, dan ketahanan, memungkinkan kluster tetap berfungsi meskipun kehilangan seluruh rak (domain kesalahan) dan satu simpul secara bersamaan.

Untuk mempelajari selengkapnya tentang berbagai opsi ketahanan volume, lihat Toleransi kesalahan dan efisiensi penyimpanan pada kluster Azure Local dan Windows Server.

Untuk kuorum kluster, tempatkan sumber daya saksi (Saksi Berbagi File, Saksi Disk, Saksi Awan, atau Saksi USB) di lokasi ketiga, terpisah dari dua rak server.

Kluster kampus Storage Spaces Direct juga dikenal sebagai kluster sadar rak untuk Azure Local. Kluster kampus Storage Spaces Direct memberikan fungsionalitas dan manfaat yang sama dengan kluster sadar rak Lokal Azure, tetapi memiliki persyaratan penyebaran dan konfigurasi tertentu. Untuk mempelajari selengkapnya tentang pengklusteran sadar rak Azure Local, lihat Gambaran Umum pengklusteran sadar rak Azure Local.

Anda juga dapat mempelajari lebih lanjut tentang kluster kampus Storage Spaces Direct di blog pengumuman kami, Mengumumkan Dukungan untuk Kluster Kampus S2D di Windows Server 2025.

Kluster terbentang

Kluster peregangan, juga dikenal sebagai kluster geografis atau kluster multi-situs, memperluas kluster failover di dua situs fisik yang dipisahkan secara geografis yang terhubung oleh infrastruktur jaringan area luas berkecepatan tinggi (WAN). Perbedaan utama dari kluster kampus adalah bahwa kluster rentang mencakup lokasi geografis yang terpisah dan terhubung melalui WAN, sedangkan kluster kampus menggunakan konektivitas LAN di dalam satu lokasi.

Anda dapat menerapkan kluster stretch menggunakan dua arsitektur penyimpanan yang berbeda:

- Kluster Stretch Storage Spaces Direct: Setiap situs mempertahankan kumpulan penyimpanan Storage Spaces Direct sendiri, dengan menggunakan Storage Replica untuk menyediakan replikasi antar situs

- Kluster stretch SAN: Menggunakan penyimpanan SAN bersama atau yang telah direplikasi dengan teknologi replikasi khusus vendor

Kedua varian kluster stretch dirancang untuk pemulihan bencana di seluruh area metropolitan, dengan mempertahankan infrastruktur independen yang lengkap di setiap lokasi. Mereka sangat cocok untuk organisasi dengan beberapa lokasi pusat data atau yang memiliki persyaratan kepatuhan yang mengamanatkan perlindungan data di luar situs.

Untuk kuorum kluster, gunakan Saksi Berbagi File atau Saksi Cloud. Saksi harus dapat diakses dari kedua lokasi untuk mengaktifkan failover otomatis dan menentukan mayoritas lokasi selama pemisahan jaringan.

Topologi kluster stretch lebih kompleks untuk dikonfigurasi dan dikelola daripada kluster situs tunggal. Latensi yang lebih tinggi antar situs dapat memengaruhi performa replikasi sinkron, terlepas dari arsitektur penyimpanan yang dipilih.

Kluster jarak jauh Storage Spaces Direct

Dalam konfigurasi kluster peregangan Storage Spaces Direct, setiap situs mengoperasikan kumpulan penyimpanan Storage Spaces Direct independennya sendiri. Replika Penyimpanan menangani replikasi antar situs, dan Anda dapat mengonfigurasinya sebagai sinkron atau asinkron tergantung pada jarak dan latensi antar lokasi.

Diagram berikut adalah ilustrasi contoh sebuah topologi kluster stretch dari Storage Spaces Direct dengan node dan kumpulan penyimpanan di setiap situs geografis, saling terhubung melalui WAN.

Persyaratan jaringan berbeda berdasarkan mode replikasi. Replikasi sinkron memerlukan latensi pulang-pergi kurang dari 5 mdtk melalui koneksi WAN. Persyaratan ini memastikan performa yang baik. Replikasi asinkron dapat bekerja dengan latensi yang lebih tinggi. Namun, replikasi asinkron berarti Anda mungkin kehilangan lebih banyak data selama kegagalan (RPO yang lebih besar). Kedua mode memerlukan koneksi WAN bandwidth tinggi khusus antara situs, dan setiap situs harus memiliki jalur jaringan ke saksi untuk memastikan manajemen kuorum yang tepat.

Konfigurasi ini memerlukan edisi Pusat Data Windows Server untuk fungsionalitas Replika Penyimpanan. Bandwidth dan keandalan jaringan sangat penting untuk menjaga keberhasilan replikasi dan kesehatan kluster.

Kluster sebaran SAN

Kluster SAN dengan jangkauan lebih luas bergantung pada kemampuan replikasi dari vendor jaringan area penyimpanan untuk menjaga sinkronisasi data antar situs. SAN menangani replikasi di lapisan penyimpanan, menyajikan LUN yang direplikasi ke node kluster di kedua situs.

Diagram berikut mengilustrasikan contoh topologi kluster peregangan SAN dengan penyimpanan SAN yang direplikasi di setiap situs geografis, yang terhubung melalui WAN.

Saat menerapkan kluster peregangan SAN, tinjau persyaratan interoperabilitas vendor SAN dan konfigurasi yang didukung. Vendor SAN yang berbeda memiliki berbagai persyaratan untuk latensi jaringan, bandwidth, dan parameter konfigurasi. Pastikan solusi SAN Anda divalidasi untuk skenario kluster terbentang serta memenuhi tujuan spesifik pemulihan bencana Anda.

Kluster peregangan SAN memerlukan koordinasi yang cermat dengan administrator penyimpanan dan kepatuhan terhadap praktik terbaik khusus vendor untuk konfigurasi replikasi, prosedur failover, dan pemantauan.

Topologi multi-kluster

Topologi multi-kluster melibatkan penyebaran beberapa kluster failover independen yang bekerja sama melalui replikasi atau koordinasi tingkat aplikasi. Topologi ini berbeda secara mendasar dari kluster tunggal yang diperpanjang. Dalam pendekatan ini, dua atau lebih kluster failover independen masing-masing beroperasi secara otonom, dengan replikasi tingkat aplikasi antara kluster dan tidak ada sumber daya kuorum atau kluster bersama.

Diagram berikut mengilustrasikan contoh topologi multi-kluster dengan dua kluster SQL independen di situs geografis terpisah, terhubung melalui WAN dan direplikasi pada lapisan aplikasi.

Kluster mereplikasi data satu sama lain menggunakan metode seperti:

- Grup Ketersediaan AlwaysOn SQL Server untuk beban kerja database

- Penyalinan berbasis file untuk beban kerja penyimpanan

- Alat sinkronisasi kustom yang dirancang untuk aplikasi tertentu

Topologi ini berfungsi dengan baik untuk:

- Penyebaran skala besar yang memerlukan isolasi antar kluster

- Lingkungan dengan batas administratif atau zona keamanan yang berbeda

- Pengaturan aktif-aktif di mana Anda mendistribusikan beban di seluruh lokasi

- Skenario yang menuntut pemisahan maksimum antar situs

Anda dapat mengelola setiap kluster secara independen, dan kegagalan dalam satu kluster tidak memengaruhi kuorum kluster lain. Arsitektur ini memberikan fleksibilitas dalam konfigurasi dan versi kluster. Ini memungkinkan kluster untuk menjangkau jarak yang lebih besar menggunakan replikasi asinkron tanpa batasan persyaratan kuorum satu kluster.

Namun, penyebaran multi-kluster memerlukan perencanaan yang cermat. Pendekatan ini tergantung pada dukungan aplikasi untuk replikasi lintas kluster. Ini melibatkan prosedur operasional yang lebih kompleks daripada topologi kluster tunggal. Ini mungkin memerlukan orkestrasi tingkat aplikasi untuk skenario failover. Pemantauan harus secara komprehensif mencakup beberapa lingkungan kluster untuk memastikan kesehatan dan performa sistem secara keseluruhan.

Memilih topologi yang tepat

Anda perlu mempertimbangkan dengan cermat beberapa faktor di seluruh dimensi bisnis, infrastruktur, beban kerja, dan operasional saat memilih topologi kluster failover yang sesuai.

Dari perspektif bisnis, mulailah dengan menentukan Tujuan Waktu Pemulihan (RTO) Anda - seberapa cepat layanan harus dipulihkan setelah kegagalan - dan Tujuan Titik Pemulihan (RPO) Anda - berapa banyak kehilangan data yang dapat diterima oleh organisasi Anda. Metrik ini secara langsung memengaruhi pemilihan topologi. Selain itu, pertimbangkan anggaran Anda untuk perangkat keras, jaringan, dan lisensi, karena topologi yang lebih tangguh biasanya membutuhkan investasi yang lebih besar. Persyaratan kepatuhan dan peraturan dapat mengamanatkan konfigurasi tertentu, seperti pusat data yang dipisahkan secara geografis atau standar perlindungan data tertentu.

Faktor infrastruktur juga membentuk keputusan Anda. Pertimbangkan jumlah dan lokasi pusat data atau ruang yang dapat Anda akses. Mengevaluasi tautan jaringan dan latensi antar situs. Tinjau sistem penyimpanan yang ada yang dapat Anda gunakan kembali. Menilai daya dan pendinginan cadangan di setiap lokasi. Sebuah kampus dengan dua bangunan terdekat yang terhubung oleh serat mendukung topologi yang berbeda dari pusat data yang jauh.

Karakteristik beban kerja memainkan peran penting dalam pemilihan topologi. Evaluasi pola I/O dan persyaratan performa aplikasi Anda, karena beban kerja yang sensitif terhadap latensi mungkin tidak cocok dengan biaya tambahan dari replikasi geografis.

Pertimbangkan berapa banyak penyimpanan yang Anda butuhkan, berapa banyak bandwidth jaringan yang Anda miliki, dan apakah beban kerja Anda dapat menangani penundaan. Faktor-faktor ini membantu Anda memutuskan antara replikasi sinkron dan asinkron.

Akhirnya, jangan mengabaikan pertimbangan operasional. Menilai keahlian tim TI Anda dan sumber daya yang tersedia, karena topologi yang lebih kompleks membutuhkan pengetahuan teknis yang lebih mendalam.

Pikirkan tentang cara mengelola dan memantau kluster. Pertimbangkan seberapa sering Anda perlu menguji pemulihan bencana. Tinjau opsi Anda untuk jendela pemeliharaan dan jadwal peningkatan.

Topologi yang terlihat ideal di atas kertas mungkin terbukti sulit dioperasikan jika melebihi kemampuan tim atau sumber daya yang tersedia.