Prompt flow in Studio AI della piattaforma Azure

Importante

Alcune funzionalità descritte in questo articolo potrebbero essere disponibili solo in anteprima. Questa anteprima viene fornita senza un contratto di servizio e non è consigliabile per i carichi di lavoro di produzione. Alcune funzionalità potrebbero non essere supportate o potrebbero presentare funzionalità limitate. Per altre informazioni, vedere le Condizioni supplementari per l'uso delle anteprime di Microsoft Azure.

Prompt flow è uno strumento di sviluppo progettato per semplificare l'intero ciclo di sviluppo delle applicazioni di IA basate su Large Language Model (LLM). Prompt flow offre una soluzione completa che semplifica il processo di creazione di prototipi, la sperimentazione, l'iterazione e la distribuzione delle applicazioni di intelligenza artificiale.

Prompt flow è disponibile in modo indipendente come progetto open source in GitHub, con un SDK e l'estensione per VS Code specifici. Prompt flow è anche disponibile e consigliato per l'uso come funzionalità all'interno di Studio AI della piattaforma Azure e studio di Azure Machine Learning. Questo set di documentazione è incentrato sul prompt flow in Studio AI della piattaforma Azure.

Definizioni:

- Il prompt flow è una funzionalità che può essere usata per generare, personalizzare o eseguire un flusso.

- Un flusso è un set di istruzioni eseguibili che può implementare la logica dell'intelligenza artificiale. I flussi possono essere creati o eseguiti tramite più strumenti, ad esempio un canvas predefinito, LangChain e così via. Le iterazioni di un flusso possono essere salvate come asset. Dopo la distribuzione, un flusso diventa un'API. Non tutti i flussi sono prompt flow. Il prompt flow è invece un modo per creare un flusso.

- Un prompt è un pacchetto di input inviato a un modello, costituito dall'input dell'utente, dal messaggio di sistema e da eventuali esempi. L'input dell'utente è il testo inviato nella finestra della chat. Il messaggio di sistema è un set di istruzioni per il modello che definisce l'ambito dei relativi comportamenti e funzionalità.

- Un flusso di esempio è un flusso di orchestrazione predefinito semplice che mostra il funzionamento dei flussi e può essere personalizzato.

- Un prompt di esempio è un prompt definito per uno scenario specifico che può essere copiato da una libreria e usato così come è o modificato nella progettazione del prompt.

Vantaggi del prompt flow

Con il prompt flow in Studio AI della piattaforma Azure è possibile:

- Orchestrare flussi eseguibili che collegano LLM, richieste e strumenti Python tramite un grafo visivo.

- Eseguire il debug, condividere e iterare i flussi con facilità tramite collaborazione in team.

- Creare varianti di prompt e confrontarne le prestazioni.

Agilità nella progettazione dei prompt

- Esperienza di creazione interattiva: prompt flow fornisce una rappresentazione visiva della struttura del flusso, consentendo di comprendere i progetti e orientarsi facilmente al loro interno.

- Varianti per l'ottimizzazione dei prompt: è possibile creare e confrontare più varianti di prompt, semplificando un processo di perfezionamento iterativo.

- Valutazione: i flussi di valutazione predefiniti consentono di valutare la qualità e l'efficacia dei prompt e dei flussi.

- Risorse complete: prompt flow include una libreria di strumenti, esempi e modelli predefiniti che servono da punto di partenza per lo sviluppo, ispirando creatività e accelerando il processo.

Soluzione pronta per l'azienda

- Collaborazione: prompt flow supporta la collaborazione in team, consentendo a più utenti di collaborare alla progettazione dei prompt, condividere conoscenze e mantenere il controllo delle versioni.

- Piattaforma all-in-one: prompt flow semplifica l'intero processo di progettazione dei prompt, dallo sviluppo e la valutazione alla distribuzione e il monitoraggio. È possibile distribuire facilmente i flussi come endpoint di Azure per intelligenza artificiale e monitorarne le prestazioni in tempo reale, garantendo un funzionamento ottimale e un miglioramento continuo.

- Soluzioni per la preparazione delle aziende: prompt flow applica le soluzioni affidabili di preparazione delle aziende di Azure per intelligenza artificiale, fornendo una base sicura, scalabile e affidabile per lo sviluppo, la sperimentazione e la distribuzione di flussi.

Con prompt flow in Studio AI della piattaforma Azure, è possibile sfruttare l'agilità per la progettazione dei prompt, collaborare efficacemente e applicare soluzioni di livello aziendale per lo sviluppo e la distribuzione di applicazioni basate su LLM di successo.

Ciclo di vita di sviluppo dei flussi

Prompt flow offre un processo ben definito che facilita lo sviluppo di applicazioni di IA. Usandolo, è possibile progredire efficacemente attraverso le fasi di sviluppo, test, ottimizzazione e distribuzione dei flussi, con conseguente creazione di applicazioni di intelligenza artificiale complete di tutte le funzionalità.

Il ciclo di vita è costituito dalle fasi seguenti:

- Inizializzazione: identificare il caso d'uso aziendale, raccogliere dati di esempio, imparare a creare un prompt di base e sviluppare un flusso che ne estenda le funzionalità.

- Sperimentazione: eseguire il flusso sui dati di esempio, valutare le prestazioni del prompt ed eseguire l'iterazione del flusso, se necessario. Continuare a sperimentare fino a raggiungere risultati soddisfacenti.

- Valutazione e perfezionamento: valutare le prestazioni del flusso eseguendolo con un set di dati più grande, valutare l'efficacia del prompt e perfezionarlo secondo necessità. Procedere alla fase successiva se i risultati soddisfano i criteri desiderati.

- Produzione: ottimizzare il flusso per efficienza ed efficacia, distribuirlo, monitorare le prestazioni in un ambiente di produzione e raccogliere dati di utilizzo e feedback. Usare queste informazioni per migliorare il flusso e contribuire alle fasi precedenti per ulteriori iterazioni.

Rispettando questo approccio metodico e strutturato, prompt flow consente di sviluppare, testare rigorosamente, ottimizzare e distribuire flussi con fiducia, creando in definitiva applicazioni di IA affidabili e sofisticate.

Tipi di flusso

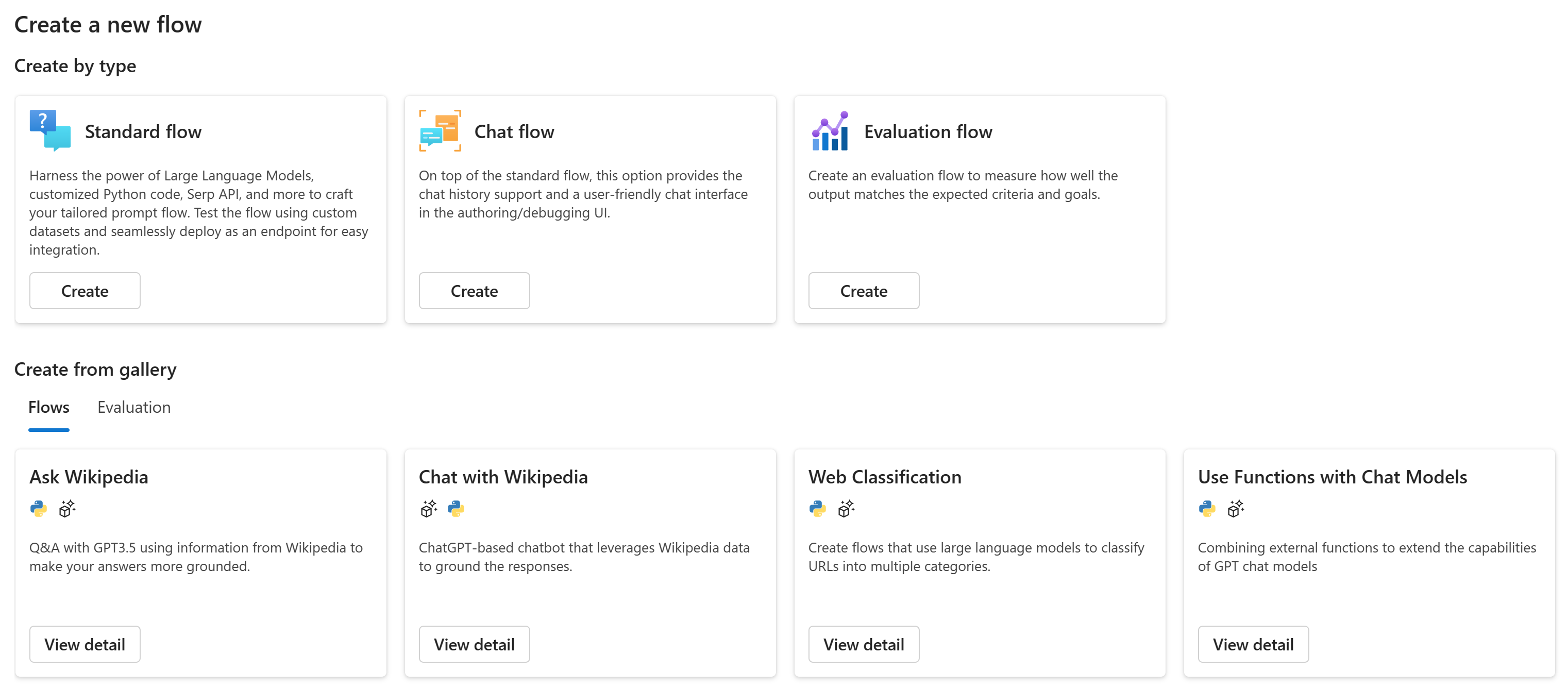

In Studio AI della piattaforma Azure è possibile avviare un nuovo flusso selezionando un tipo di flusso o un modello dalla raccolta.

Ecco alcuni esempi di tipi di flusso:

- Flusso Standard: progettato per lo sviluppo di applicazioni generali, il flusso standard consente di creare un flusso usando un'ampia gamma di strumenti integrati per lo sviluppo di applicazioni basate su LLM. Offre flessibilità e versatilità per lo sviluppo di applicazioni in domini diversi.

- Flusso di chat: progettato su misura per lo sviluppo di applicazioni conversazionali, il flusso di chat si basa sulle funzionalità del flusso standard e offre un supporto avanzato per l'input/output delle chat e la gestione della cronologia delle chat. Con la modalità di conversazione nativa e le funzionalità predefinite, è possibile sviluppare ed eseguire facilmente il debug delle applicazioni all'interno di un contesto di conversazione.

- Flusso di valutazione: progettato per gli scenari di valutazione, il flusso di valutazione consente di creare un flusso che accetta gli output di esecuzioni precedenti del flusso come input. Questo tipo di flusso consente di valutare le prestazioni dei risultati di esecuzione precedenti e di restituire metriche pertinenti, semplificando la valutazione e il miglioramento dei modelli o delle applicazioni.

Flussi

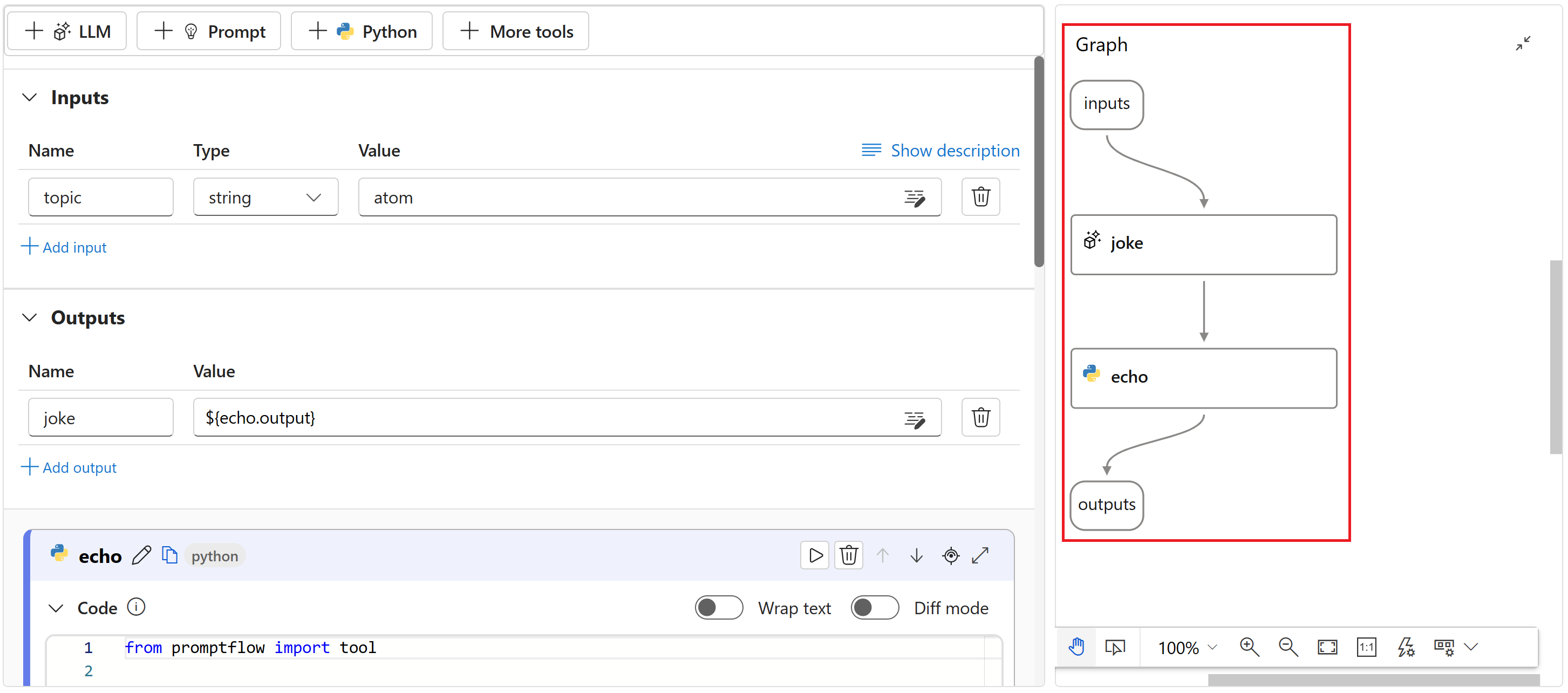

Un flusso nel prompt flow funge da flusso di lavoro eseguibile che semplifica lo sviluppo dell'applicazione di intelligenza artificiale basata su LLM. Offre un framework completo per la gestione del flusso di dati e dell'elaborazione all'interno dell'applicazione.

All'interno di un flusso, i nodi hanno un ruolo centrale, rappresentando strumenti specifici con funzionalità univoche. Questi nodi gestiscono l'elaborazione dei dati, l'esecuzione delle attività e le operazioni algoritmiche, con input e output. Connettendo i nodi, si stabilisce una catena continua di operazioni che guida il flusso di dati attraverso l'applicazione.

Per facilitare la configurazione e l'ottimizzazione dei nodi, viene fornita una rappresentazione visiva della struttura del flusso di lavoro tramite un grafo aciclico diretto. Questo grafo presenta la connettività e le dipendenze tra nodi, fornendo una panoramica chiara dell'intero flusso di lavoro.

Con la funzionalità di flusso nel prompt flow, è possibile progettare, personalizzare e ottimizzare la logica dell'applicazione di intelligenza artificiale. La disposizione coesa dei nodi garantisce un'efficiente elaborazione dei dati e una gestione efficace del flusso, supportando la creazione di applicazioni affidabili e avanzate.

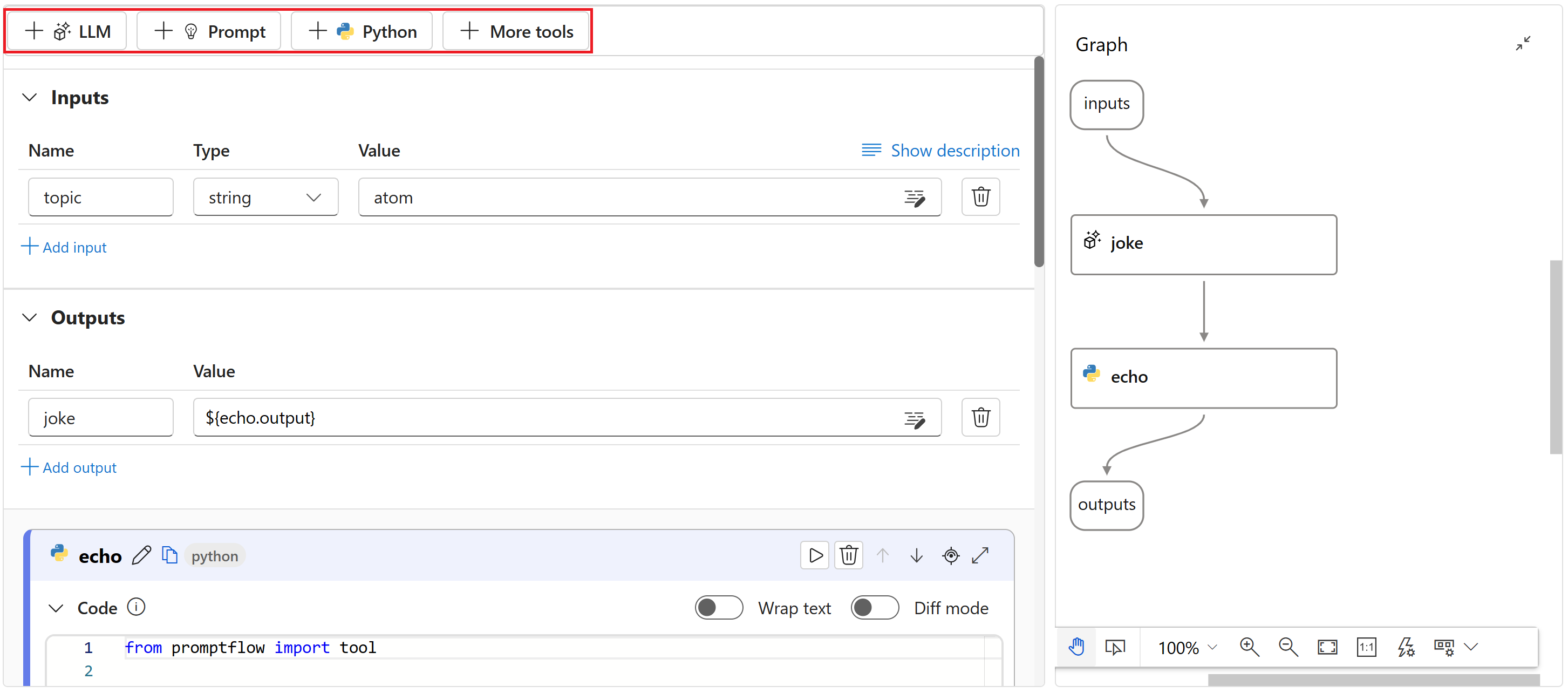

Strumenti del prompt flow

Gli strumenti sono gli elementi costitutivi di un flusso.

In Studio AI della piattaforma Azure le opzioni per gli strumenti includono lo strumento LLM, lo strumento Prompt, lo strumento Python e altri ancora.

Ogni strumento è un'unità eseguibile semplice con una funzione specifica. Combinando diversi strumenti, è possibile creare un flusso che realizza un'ampia gamma di obiettivi. Ad esempio, è possibile usare lo strumento LLM per generare testo o riepilogare un articolo e lo strumento Python per elaborare il testo per informare il componente o il risultato del flusso successivo.

Uno dei vantaggi principali degli strumenti del prompt flow è la perfetta integrazione con le API di terze parti e i pacchetti open source Python, che consente non solo di migliorare le funzionalità dei modelli linguistici di grandi dimensioni, ma rende anche il processo di sviluppo più efficiente per gli sviluppatori.

Se gli strumenti di prompt flow in Studio AI della piattaforma Azure non soddisfano i requisiti, è possibile seguire questa guida per sviluppare uno strumento personalizzato e impostarlo come pacchetto di strumenti. Per scoprire altri strumenti personalizzati sviluppati dalla community open source, visitare questa pagina.