Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

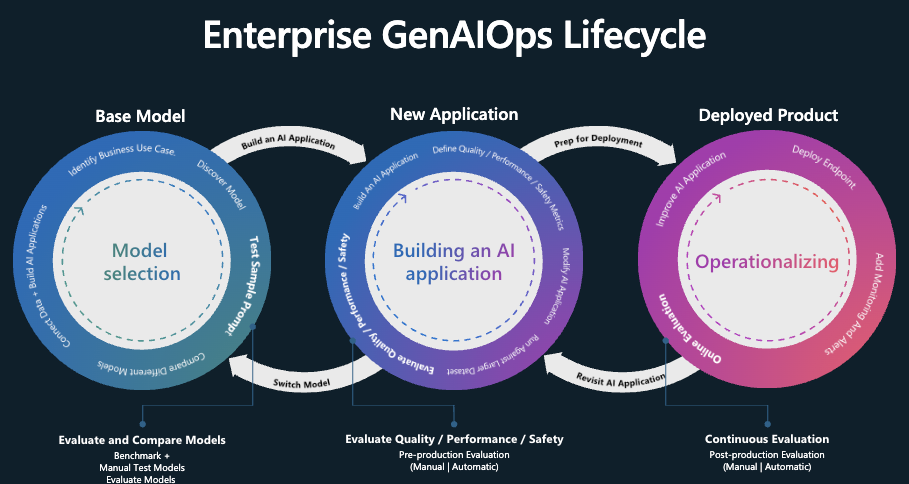

Il ciclo di vita dell'applicazione di intelligenza artificiale richiede framework di valutazione affidabili per garantire che i sistemi di intelligenza artificiale forniscano output accurati, pertinenti e affidabili. Senza una valutazione rigorosa, i sistemi di intelligenza artificiale rischiano di generare risposte imprecise, incoerenti, incoerenti o potenzialmente dannose. L'osservabilità consente ai team di misurare e migliorare sia la qualità che la sicurezza degli output di intelligenza artificiale durante il ciclo di vita di sviluppo, dalla selezione del modello al monitoraggio della produzione.

Che cos'è l'osservabilità?

L'osservabilità dell'intelligenza artificiale si riferisce alla possibilità di monitorare, comprendere e risolvere i problemi dei sistemi di intelligenza artificiale durante il ciclo di vita. È possibile tracciare, valutare, integrare controlli di qualità automatizzati nelle pipeline CI/CD e raccogliere segnali come metriche di valutazione, log, tracce e output del modello per ottenere visibilità su prestazioni, qualità, sicurezza e integrità operativa.

Funzionalità di osservabilità di base

Microsoft Foundry offre tre funzionalità di base che interagiscono per offrire un'osservabilità completa nel ciclo di vita dell'applicazione di intelligenza artificiale:

Evaluation

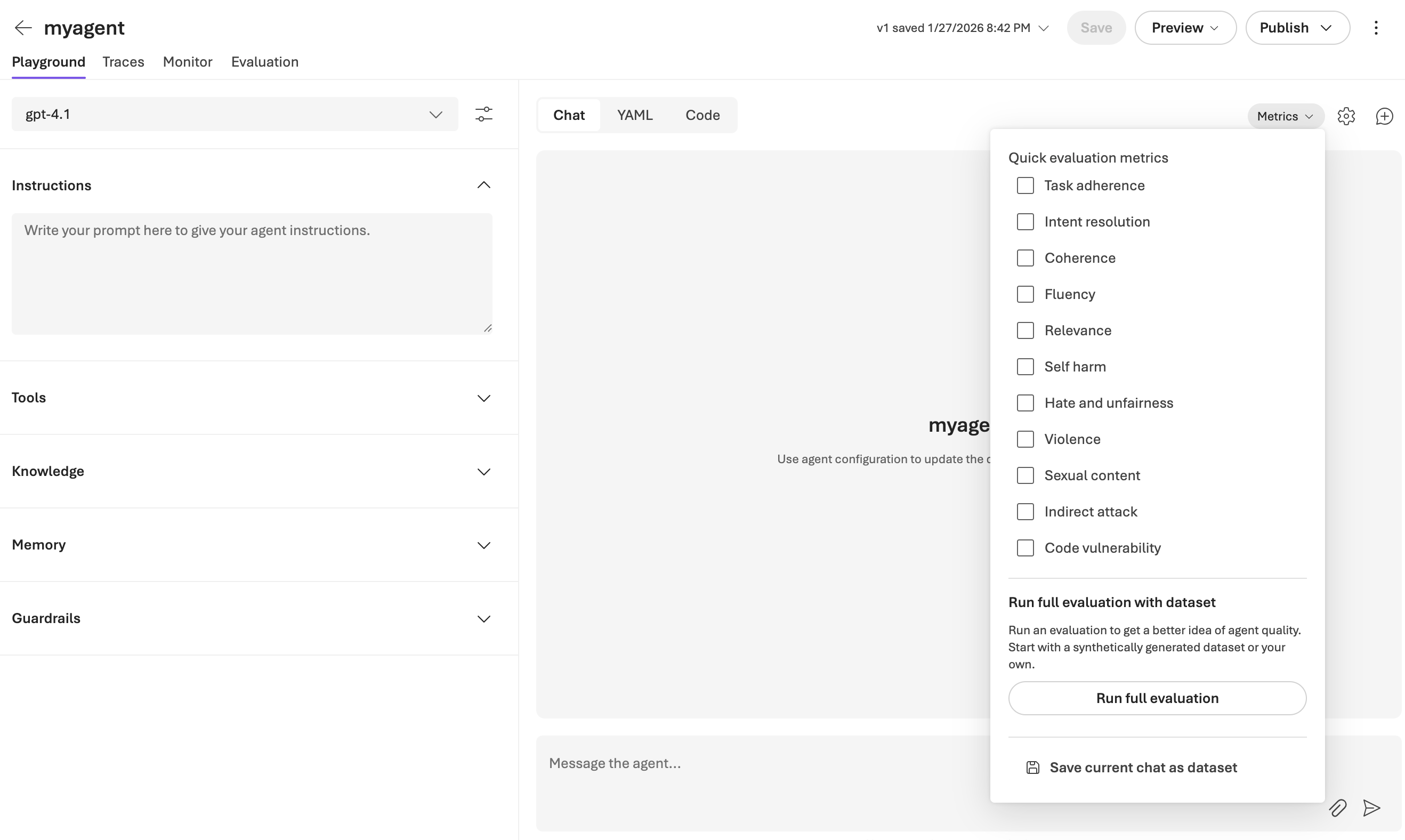

Gli analizzatori misurano la qualità, la sicurezza e l'affidabilità delle risposte di intelligenza artificiale durante lo sviluppo. Microsoft Foundry fornisce analizzatori predefiniti, tra cui metriche di qualità per utilizzo generico (coerenza, fluenza), metriche specifiche di RAG (base, pertinenza), sicurezza e sicurezza (odio/ingiustità, violenza, materiali protetti) e metriche specifiche dell'agente (accuratezza delle chiamate degli strumenti, completamento attività), tra gli altri. È anche possibile creare analizzatori personalizzati personalizzati in base ai requisiti specifici del dominio.

Per un elenco completo degli analizzatori predefiniti, vedere Riferimenti agli analizzatori predefiniti.

Monitoraggio

Il monitoraggio della produzione garantisce che le applicazioni di intelligenza artificiale distribuite mantengano la qualità e le prestazioni in condizioni reali. Integrato con Azure Monitor Application Insights, Microsoft Foundry offre dashboard in tempo reale che consentono di tenere traccia delle metriche operative, dell'utilizzo dei token, della latenza, delle percentuali di errore e dei punteggi di qualità. È possibile configurare avvisi quando gli output non superano le soglie di qualità o producono contenuto dannoso, abilitando la risoluzione rapida dei problemi.

Per informazioni dettagliate sulla configurazione del monitoraggio della produzione, vedere Dashboard di Monitoraggio degli Agenti.

Traccia

La traccia distribuita acquisisce il flusso di esecuzione delle applicazioni di intelligenza artificiale, offrendo visibilità sulle chiamate LLM, sulle chiamate degli strumenti, sulle decisioni degli agenti e sulle dipendenze tra servizi. Basato sugli standard OpenTelemetry e integrato con Application Insights di Monitoraggio di Azure, il tracciamento consente il debug degli agenti con comportamenti complessi, l'identificazione dei colli di bottiglia delle prestazioni e la comprensione delle catene di ragionamento in più passaggi. Microsoft Foundry supporta la traccia per framework comuni, tra cui LangChain, LangGraph, OpenAI Agents SDK e Microsoft Agent Framework.

Per indicazioni sull'implementazione della traccia, vedere Panoramica dell'agente di traccia.

Che cosa sono gli analizzatori?

Gli analizzatori sono strumenti specializzati che misurano la qualità, la sicurezza e l'affidabilità delle risposte di intelligenza artificiale durante tutto il ciclo di vita dello sviluppo.

Per un elenco completo degli analizzatori predefiniti, vedere Riferimenti agli analizzatori predefiniti.

Gli analizzatori si integrano in ogni fase del ciclo di vita dell'IA per garantire affidabilità, sicurezza ed efficacia.

Le tre fasi della valutazione del ciclo di vita delle applicazioni di intelligenza artificiale

Selezione del modello di base

Selezionare il modello di base corretto confrontando qualità, prestazioni delle attività, considerazioni etiche e profili di sicurezza in diversi modelli.

Tools disponibili: Microsoft Foundry benchmark per confrontare i modelli su set di dati pubblici o i propri dati e Azure AI Evaluation SDK per testare endpoint specifici del modello.

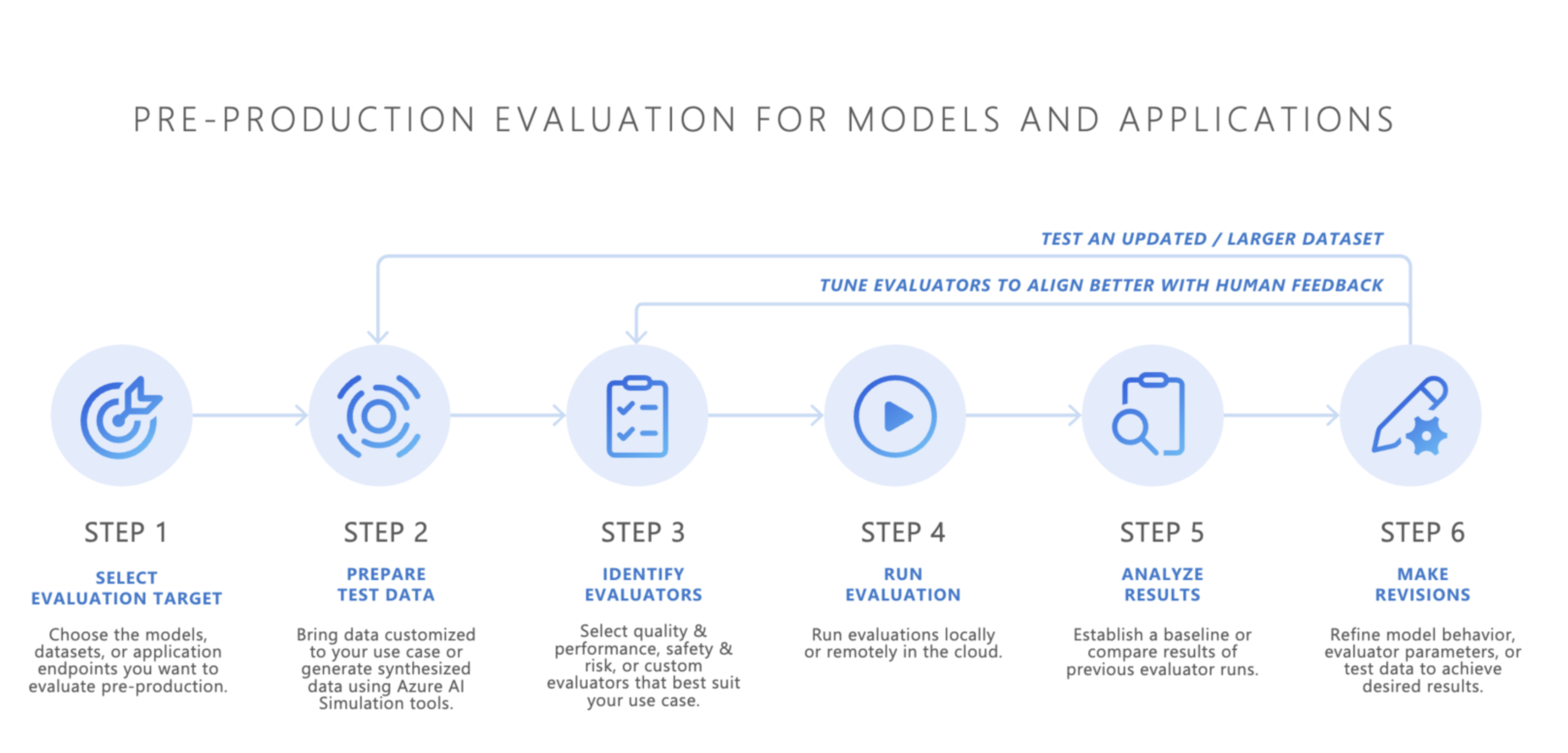

Valutazione pre-produzione

Prima della distribuzione, i test approfonditi assicurano che l'agente di intelligenza artificiale o l'applicazione siano pronti per la produzione. Questa fase convalida le prestazioni tramite set di dati di valutazione, identifica i casi perimetrali, valuta l'affidabilità e misura le metriche chiave, tra cui conformità delle attività, importanza, pertinenza e sicurezza. Per la creazione di agenti pronti per la produzione con conversazioni a più turni, richiami di strumenti e gestione dello stato, vedere Servizio agenti Foundry.

Strumenti e approcci di valutazione:

Porta i tuoi dati: valuta le applicazioni di intelligenza artificiale utilizzando i tuoi dati con analizzatori di qualità, sicurezza o personalizzati. Usare la procedura guidata di valutazione del portale foundry o Foundry SDK e visualizzare i risultati nel portale foundry.

AI red teaming agent: l'agente di red teaming AI simula attacchi complessi utilizzando il framework PyRIT di Microsoft per identificare le vulnerabilità di sicurezza operativa e di protezione prima della distribuzione. Ideale da utilizzare con processi con intervento umano.

Monitoraggio post-produzione

Dopo la distribuzione, il monitoraggio continuo garantisce che l'applicazione di intelligenza artificiale mantenga la qualità in condizioni reali:

- Metriche operative: misurazione regolare delle metriche operative dell'agente di intelligenza artificiale chiave

- Valutazione continua: valutazione della qualità e della sicurezza del traffico di produzione a una frequenza campionata

- Valutazione pianificata: valutazione pianificata della qualità e della sicurezza usando set di dati di test per rilevare la deriva del sistema

- Red Teaming pianificato: test antagonisti pianificati per verificare la presenza di vulnerabilità di sicurezza e protezione

- Azure Monitor avvisi: notifiche quando gli output non superano le soglie di qualità o producono contenuto dannoso

Integrato con Azure Monitor Application Insights, il dashboard Foundry Observability offre informazioni dettagliate in tempo reale sulle metriche relative a prestazioni, sicurezza e qualità, consentendo la risoluzione rapida dei problemi e mantenendo l'attendibilità degli utenti.

Riferimento rapido alla valutazione

| Scopo | Processo | Parametri, linee guida ed esempi |

|---|---|---|

| Come impostare il tracciamento? | Configurare il tracciamento distribuito |

Panoramica della traccia Utilizza il monitoraggio con Agents SDK |

| Che cosa stai valutando? | Identificare o compilare analizzatori pertinenti |

Analizzatori predefiniti Valutatori personalizzati Esempi di Python SDK Esempi di C# SDK |

| Quali dati è necessario usare? | Caricare o generare un set di dati pertinente | Selezionare o creare un set di dati |

| Come eseguire valutazioni? | Eseguire la valutazione |

Esecuzioni valutazioni agente Esecuzione del cloud remoto |

| Come si è comportata la mia applicazione del modello di intelligenza artificiale? | Analizzare i risultati |

Visualizzare i risultati della valutazione Analisi del cluster |

| Come posso migliorare? | Analizzare i risultati e ottimizzare gli agenti | Analizzare gli errori di valutazione con l'analisi del cluster. Ottimizzare gli agenti e rivalutare. Esaminare i risultati della valutazione. |

Supporto per le regioni, limiti di frequenza e supporto della rete virtuale

Per informazioni sulle aree che supportano gli analizzatori assistito dall'intelligenza artificiale, sui limiti di frequenza applicabili alle esecuzioni di valutazione e su come configurare il supporto della rete virtuale per l'isolamento della rete, vedere Supporto delle aree , limiti di frequenza e supporto della rete virtuale per la valutazione.

Pricing

Le funzionalità di osservabilità, come le valutazioni di rischio e sicurezza nel playground dell'agente, vengono fatturate in base al consumo elencato nella nostra pagina dei prezzi di Azure.

Importante

Le valutazioni nel playground degli agenti sono abilitate per impostazione predefinita per tutti i progetti Foundry e sono incluse nella fatturazione basata sul consumo. Per disattivare le valutazioni del playground, selezionare le metriche in alto a destra nel playground degli agenti e deselezionare tutti i valutatori.