Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

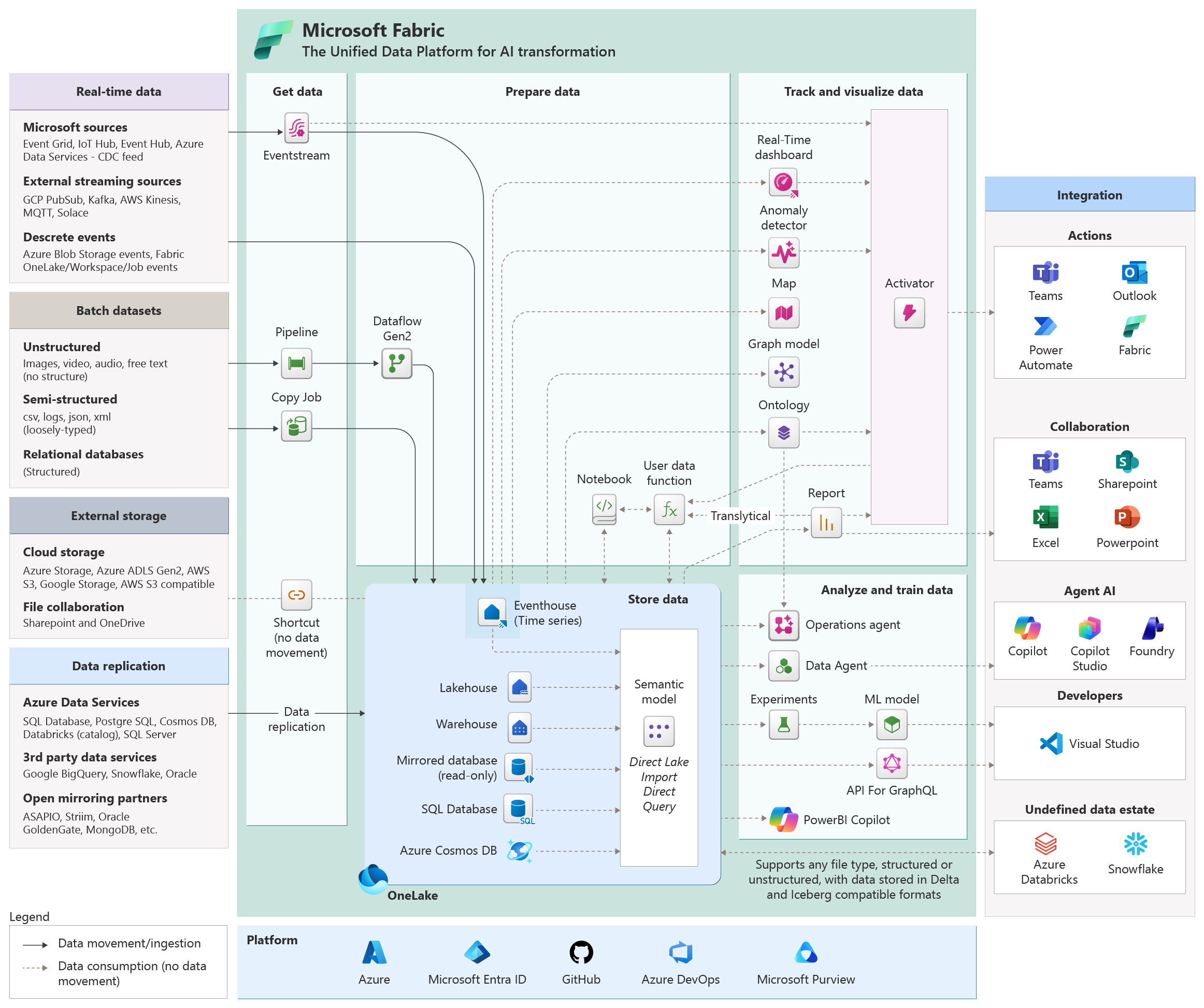

Le organizzazioni in genere si basano su più servizi disconnessi per inserire, archiviare, trasformare, analizzare e visualizzare i dati. Questa frammentazione crea silo di dati, aumenta il sovraccarico di integrazione e rallenta il tempo per ottenere informazioni dettagliate. Microsoft Fabric risolve queste sfide unificando ogni fase del ciclo di vita dei dati in una singola piattaforma basata su una base condivisa.

Al centro di questa architettura si trova OneLake, un singolo data lake aziendale che archivia tutti i dati in formato Delta Parquet aperto. OneLake viene fornito automaticamente con ogni tenant di Fabric. Poiché ogni carico di lavoro Fabric legge e scrive in OneLake, i dati non vengono spostati tra i motori. Un set di dati inserito tramite una pipeline, perfezionato in un notebook e visualizzato in un report di Power BI rimane in un'unica posizione durante il percorso.

Il ciclo di vita dei dati è costituito da sei fasi e Fabric offre strumenti appositamente creati per ognuno di essi:

Recupera dati: consente di importare i dati in OneLake da centinaia di origini in tempo reale, in base a una pianificazione, tramite la replica continua del database o facendo riferimento all'archiviazione esterna sul posto.

Archiviare i dati: rendere persistenti i dati in formati di archiviazione ottimizzati per il carico di lavoro, sia che si tratti di analisi di Big Data flessibili, query SQL strutturate, analisi degli eventi in tempo reale, elaborazione transazionale o creazione di report aziendali regolamentati.

Preparare e trasformare: pulire, rimodellare e arricchire i dati usando trasformazioni visive a basso codice o notebook code-first e funzioni riutilizzabili, senza spostare i dati da OneLake.

Analizzare ed eseguire il training: creare e rendere operativi i modelli di Machine Learning, eseguire analisi avanzate, eseguire query sui dati a livello di codice ed esplorare le informazioni dettagliate tramite agenti di intelligenza artificiale in linguaggio naturale.

Tenere traccia e visualizzare: informazioni dettagliate su Surface tramite report interattivi, monitorare i flussi di dati live nei dashboard in tempo reale e attivare azioni automatizzate quando vengono soddisfatte le condizioni.

Integrazione esterna: connettersi in modo sicuro a servizi esterni per automazione, collaborazione, governance, strumenti per sviluppatori e CI/CD.

Il diagramma seguente mostra come queste fasi si connettono e quali elementi di Fabric partecipano a ogni fase. Ogni fase è descritta in dettaglio in un articolo dedicato. Usare i collegamenti in ogni sezione per esplorare le funzionalità e gli strumenti disponibili in questa fase.

Ottieni dati

Diversi tipi di set di dati provengono da un'ampia gamma di origini dati in diversi scenari di dati, tra cui la replica dei dati, i riferimenti all'archiviazione esterna, i set di dati batch e i flussi di dati in tempo reale. È possibile inserire e trasformare questi set di dati tramite gli strumenti di integrazione di Fabric. I dati approdano in OneLake, l'archiviazione centralizzata dei dati per l'intera Fabric. I metodi di inserimento delle chiavi includono:

- Flussi di eventi per l'inserimento e il routing degli eventi in tempo reale.

- Pipeline di dati per lo spostamento di dati in modalità batch e pianificazione, con oltre 200 connettori.

- Mirroring per la replica continua da database operativi senza costruire pipeline ETL.

- Scorciatoie per la virtualizzazione dei dati senza copia da archiviazioni esterne come Azure Data Lake, Amazon S3 o Google Cloud Storage.

Per altre informazioni, vedere Ottenere dati in Microsoft Fabric.

Salvare i dati

Una volta assunti, tutti i dati confluiscono in OneLake nel formato aperto Delta Parquet. OneLake offre un singolo data lake per l'intera organizzazione senza alcuna necessità di provisioning separato. Fabric offre diversi elementi di archiviazione ottimizzati per carichi di lavoro diversi:

- Lakehouse per l'archiviazione flessibile di Big Data che combina file e tabelle Delta gestite con un endpoint SQL automatico.

- Warehouse per analisi relazionali strutturate con supporto T-SQL completo, stored procedure e transazioni ACID.

- Eventhouse per l'analisi in tempo reale sui dati di streaming e telemetria usando il linguaggio di query Kusto (KQL).

- Database SQL per carichi di lavoro transazionali e analisi operativa.

- Modelli semantici per logica di business, misure e gerarchie curate che alimentano report e intelligenza artificiale.

Per altre informazioni, vedere Archiviare i dati in Microsoft Fabric.

Preparare e trasformare i dati

Una volta in OneLake, è possibile trasformare ulteriormente i dati usando motori code-first o strumenti a basso codice, tutti all'interno di Fabric senza spostamento dei dati tra motori:

- Dataflow Gen2 offre un'interfaccia di Power Query a basso codice per la pulizia, la trasformazione e l'arricchimento dei dati.

- I notebook offrono un ambiente simile a Jupyter per Python, T-SQL e progettazione dei dati basata su Scala.

- Funzioni dati utente consente di incorporare logica Python personalizzata riutilizzabile che può essere richiamata da pipeline, notebook e regole di attivazione.

Per altre informazioni, vedere Preparare e trasformare i dati.

Analizzare i dati ed eseguire il training dei modelli

Usare i dati preparati per eseguire il training dei modelli di Machine Learning ed eseguire analisi avanzate. Il carico di lavoro di data science di Fabric offre un ambiente per la creazione, il training e l'operazionalizzazione dei modelli di Machine Learning:

- Gli esperimenti MLflow tengono traccia delle esecuzioni di training del modello con registrazione automatica di iperparametri, metriche ed elementi.

- I modelli ml vengono registrati in un registro basato su MLflow per il controllo delle versioni, il rilevamento dei metadati e la riproducibilità.

- Gli agenti dati e gli agenti operativi consentono di interagire con i dati usando il linguaggio naturale e agire su condizioni e modelli trovati.

- Le API GraphQL offrono un livello flessibile di accesso ai dati per gli sviluppatori per eseguire query su più origini dati di Fabric tramite un singolo endpoint.

- Copilot per Power BI usa l'intelligenza artificiale generativa per l'analisi ad hoc, la generazione DAX e l'esplorazione dei dati in linguaggio naturale.

Per ulteriori informazioni, consultare Analizzare e addestrare i dati in Microsoft Fabric.

Tenere traccia e visualizzare i dati

Usare i dati preparati e modellati per creare report, dashboard e avvisi in tempo reale:

- I report di Power BI offrono una visualizzazione interattiva dei dati basata su modelli semantici, con distribuzione tra app di Microsoft 365 come Teams, SharePoint, PowerPoint ed Excel.

- I flussi di attività translitici consentono agli utenti di intervenire direttamente dai report di Power BI chiamando le funzioni dei dati utente.

- Dashboard di Intelligence in Tempo Reale monitorano i dati di streaming con una latenza inferiore al secondo usando query KQL e creazione visiva.

- L'attivatore rileva le condizioni nei dati di streaming e attiva azioni automatizzate, ad esempio avvisi di Teams, messaggi di posta elettronica o flussi di Power Automate.

- Infrastruttura IQ esegue il mapping dei dati aziendali a un'ontologia aziendale condivisa e consente agli agenti di intelligenza artificiale di ragionare sui dati con contesto aziendale completo.

Per altre informazioni, vedere Tenere traccia e visualizzare i dati.

Integrazione esterna

Fabric si integra con sistemi esterni sia per l'inserimento dei dati che per il recapito di informazioni dettagliate:

- Power Automate e Data Activator consentono l'automazione del flusso di lavoro in tempo reale in base alle condizioni dei dati.

- L'integrazione di Microsoft 365 illustra informazioni dettagliate in Teams, SharePoint, PowerPoint ed Excel.

- Le API REST e le librerie client forniscono l'accesso a livello di codice alle risorse di Fabric.

- Microsoft Entra ID gestisce l'autenticazione, l'accesso condizionale e il supporto per i service principal.

- L'integrazione git con Azure DevOps e GitHub abilita il controllo della versione e CI/CD per gli elementi di Fabric.

- Microsoft Purview offre governance unificata dei dati, catalogazione e conformità nel patrimonio di dati di Fabric.

Per altre informazioni, vedere Integrazione esterna e connettività della piattaforma.

Supporto per linguaggio naturale e intelligenza artificiale

Il supporto del linguaggio naturale è costituito da Power BI Copilot, agenti dati e agenti operativi, che possono ragionare sui dati aziendali in OneLake e produrre risposte in base agli elementi di dati a cui gli utenti possono accedere. È possibile integrare Data Agents in Microsoft 365 Copilot, Microsoft Foundry e Copilot Studio in modo che gli utenti possano ottenere informazioni dettagliate da OneLake nei flussi di lavoro esistenti in diverse applicazioni.