Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

In questa esercitazione si apprenderà come eseguire qualsiasi modello di linguaggio di grandi dimensioni basato su ONNX tramiteAI Dev Gallery, ovvero un'applicazione Windows open source (disponibile in Microsoft Store) che presenta esempi basati sull'intelligenza artificiale.

Questi passaggi funzionano per qualsiasi LLM nel ONNX Runtime GenAI formato, tra cui:

- Modelli scaricati da Hugging Face

- Modelli convertiti da altri framework usando lo strumento di conversione ai Toolkit per Visual Studio Code

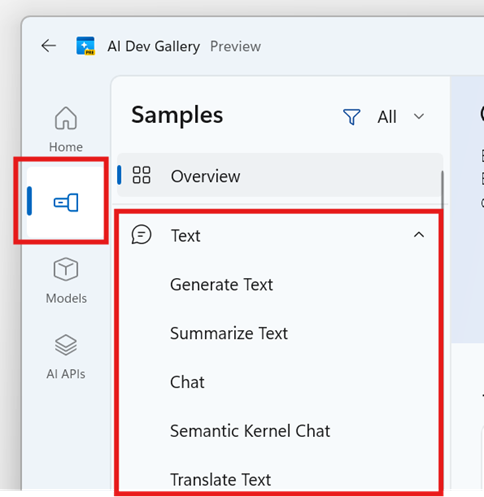

Passaggio 1: Selezionare un esempio interattivo nel AI Dev Gallery

Aprire l'app AI Dev Gallery .

Passare alla scheda Esempi e scegliere un esempio di testo (ad esempio, "Genera testo" o "Chat").

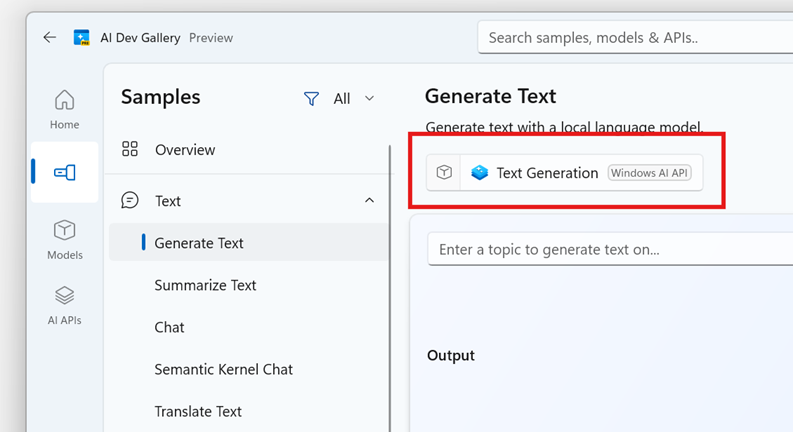

Fare clic sul pulsante Selettore di modelli per visualizzare i modelli disponibili per l'esempio.

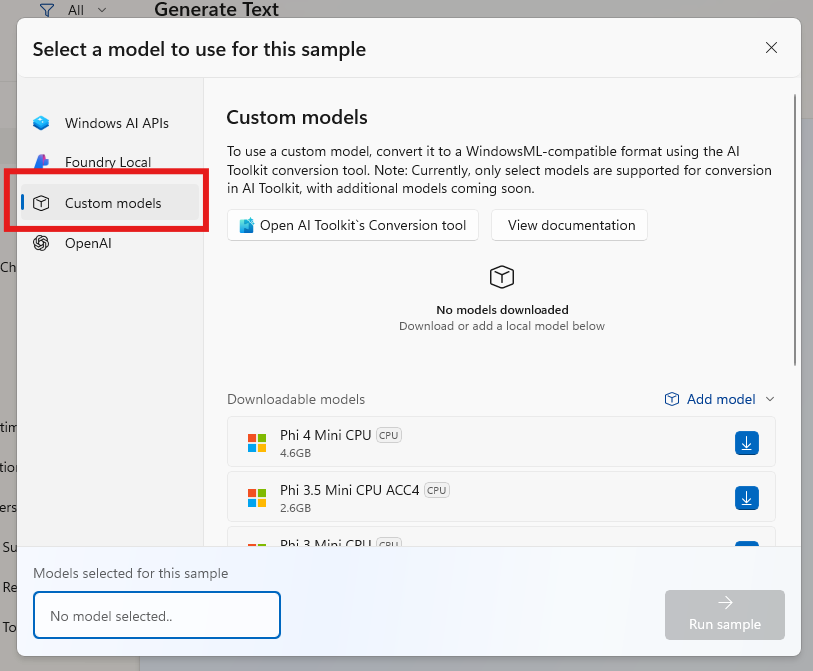

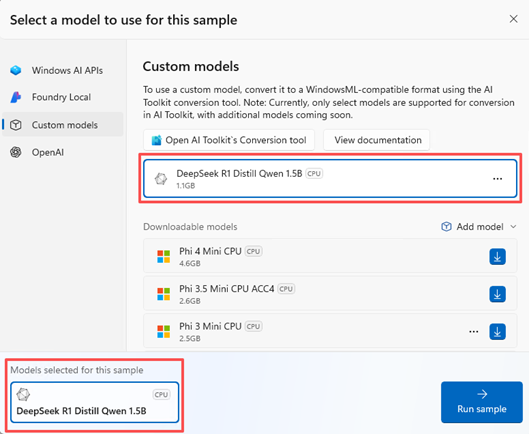

Selezionare la scheda Modelli personalizzati da inserire in ONNX LLM.

Passaggio 2: Ottenere o convertire un modello ONNX LLM

Per usare un modello in AI Dev Gallery, deve essere nel ONNX Runtime GenAI formato . È possibile:

Scaricare un modello pre-convertito:

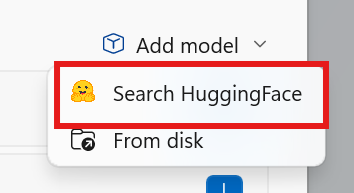

Esplorare i modelli nei modelli Hugging Face ONNX o

In AI Dev Gallery vai su Aggiungi modello → Cerca Hugging Face

Convertire un modello personalizzato:

- Fare clic su Open AI Toolkit's Conversion Tool (Apri strumento di conversione di AI Toolkit ) nel selettore di modelli, che avvia l'estensione AI Toolkit in Visual Studio Code.

- Se non è installato, cercare "AI Toolkit" nel Marketplace delle estensioni di VS Code.

- Usare AI Toolkit per Visual Studio Code per convertire un modello supportato in ONNX Runtime GenAI formato.

- Fare clic su Open AI Toolkit's Conversion Tool (Apri strumento di conversione di AI Toolkit ) nel selettore di modelli, che avvia l'estensione AI Toolkit in Visual Studio Code.

Modelli attualmente supportati per la conversione:

- DeepSeek R1 Distill Qwen 1.5B

- Phi 3.5 Mini insegnare

- Qwen 2.5-1.5B Instruct

- Llama 3.2 1B Instruct

Annotazioni

La conversione di AI Toolkit è in anteprima e attualmente supporta solo i modelli elencati in precedenza.

Passaggio 3: Usare il modello ONNX in AI Dev Gallery

Dopo aver creato un modello nel ONNX Runtime GenAI formato, tornare alla AI Dev Gallery del modello.

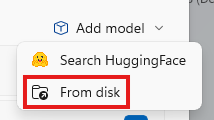

Fare clic su Aggiungi modello → da disco e specificare il percorso del modello ONNX.

Annotazioni

Se è stato usato lo strumento di conversione di AI Toolkit, il percorso del modello convertito deve seguire questo formato:

c:/{workspace}/{model_project}/history/{workflow}/model/model.onnxDopo l'aggiunta, è ora possibile selezionare il modello e usarlo con gli esempi interattivi.

Facoltativamente, fare clic su Mostra codice sorgente nell'app per visualizzare il codice che esegue il modello.

Esempi supportati in AI Dev Gallery

Questi LLM ONNX possono essere usati con gli esempi seguenti in AI Dev Gallery:

Testo

- Genera testo

- Riepilogare il testo

- Chat

- Chat del kernel semantico

- Controllo grammaticale

- Testo paraphrase

- Analizzare il sentiment del testo

- Moderazione del contenuto

- Parametri personalizzati

- Generazione Aumentata dal Recupero

Controlli intelligenti

- Smart TextBox

Codice

- Generare codice

- Spiegare il codice

Passaggi successivi

Dopo aver provato ONNX LLM in AI Dev Gallery, è possibile usare lo stesso approccio nella propria app.

Funzionamento dell'esempio

- Gli AI Dev Gallery esempi usano

OnnxRuntimeGenAIChatClient(dall'SDK) per eseguire il wrapping del ONNX Runtime GenAImodello ONNX. - Questo client si collega alle

Microsoft.Extensions.AIastrazioni (IChatClient,ChatMessagee così via), in modo da poter lavorare con richieste e risposte in modo naturale e di alto livello. - All'interno della factory (

OnnxRuntimeGenAIChatClientFactory), l'app garantisce che Windows ML i provider di esecuzione (WinML) siano registrati ed esegua il modello ONNX con la migliore accelerazione hardware disponibile (CPU, GPU o NPU).

Esempio dell'esempio:

// Register WinML execution providers (under the hood)

var catalog = Microsoft.Windows.AI.MachineLearning.ExecutionProviderCatalog.GetDefault();

await catalog.EnsureAndRegisterCertifiedAsync();

// Create a chat client for your ONNX model

chatClient = await OnnxRuntimeGenAIChatClientFactory.CreateAsync(

@"C:\path\to\your\onnx\model",

new LlmPromptTemplate

{

System = "<|system|>\n{{CONTENT}}<|end|>\n",

User = "<|user|>\n{{CONTENT}}<|end|>\n",

Assistant = "<|assistant|>\n{{CONTENT}}<|end|>\n",

Stop = [ "<|system|>", "<|user|>", "<|assistant|>", "<|end|>"]

});

// Stream responses into your UI

await foreach (var part in chatClient.GetStreamingResponseAsync(messages, null, cts.Token))

{

OutputTextBlock.Text += part;

}

Per altre informazioni sull'integrazione di modelli ONNX nelle applicazioni Windows, vedere:

Vedere anche

- Scaricare AI Dev Gallery

- Modelli ONNX su Hugging Face

- AI Toolkit per Visual Studio Code

- AI Dev Gallery Repository GitHub