Azure AI Video Indexer は、Azure AI サービス (Face、Translator、Azure AI Vision、音声など) 上に構築された、Azure AI サービスの一部であるクラウド アプリケーションです。 これによって Azure AI Video Indexer のビデオおよびオーディオ モデルを使用して、ビデオから分析情報を抽出することが可能になります。

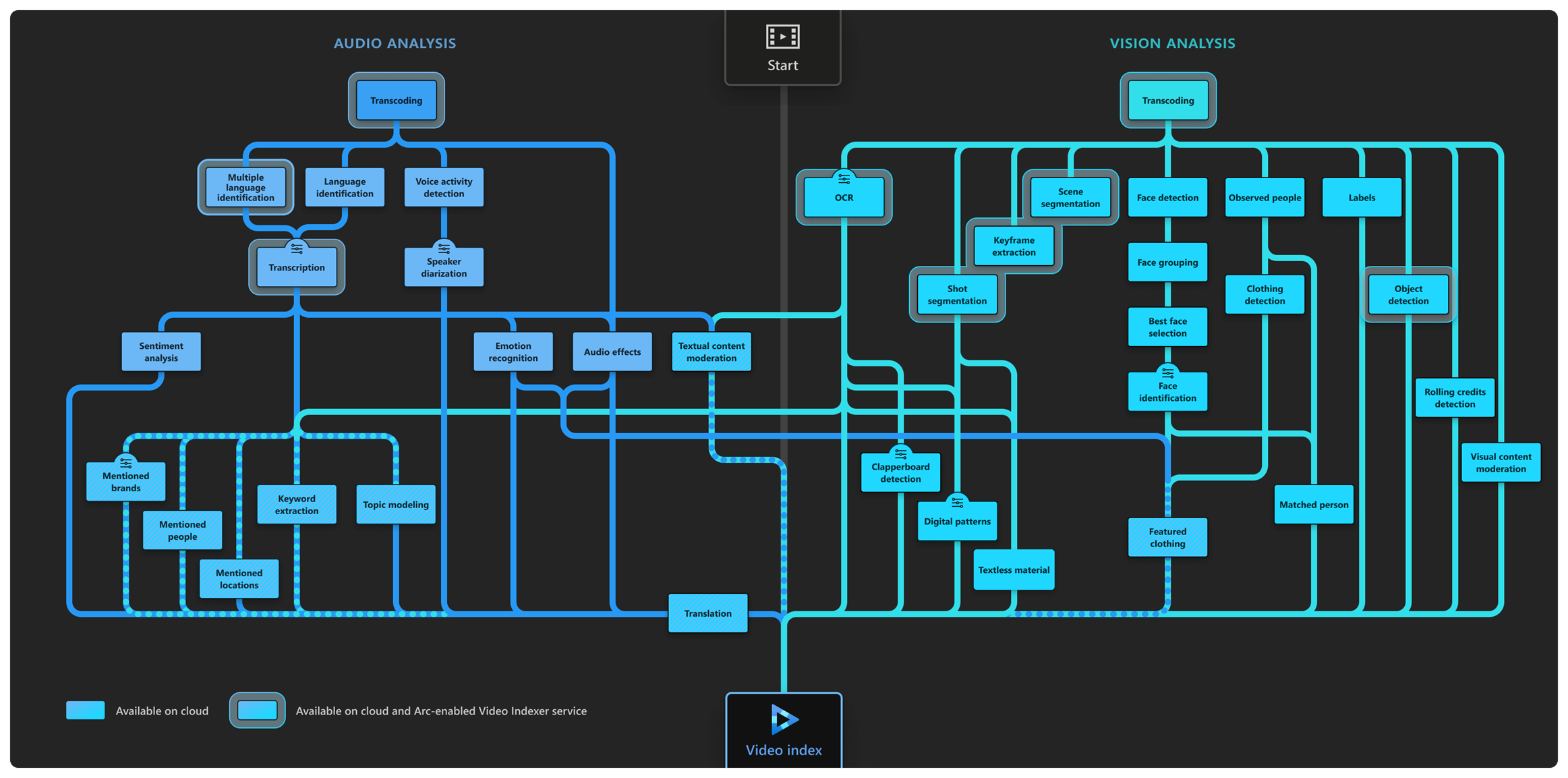

Azure AI Video Indexer は、30 個以上の AI モデルを実行することでビデオおよびオーディオ コンテンツを分析し、豊富な分析情報を生成します。 Azure AI Video Indexer によってバックグラウンドで実行されるオーディオとビデオの分析の図を次に示します。

Azure AI Video Indexer を使用して分析情報の抽出を開始するには、使用を 開始する方法 に関するセクションを参照してください。

Azure AI Video Indexer を使用して何ができますか?

Azure AI Video Indexer の分析情報は、多くのシナリオに適用できます。

- 詳細検索: ビデオ ライブラリ全体の検索エクスペリエンスを強化するには、ビデオから抽出された分析情報を使用します。 たとえば、話されている語句と顔にインデックスを作成すると、人物が特定の単語をいつ話したかや、2 人の人物がいつ会っていたかを検索できるようになります。 ビデオからのこのような分析情報に基づいた検索は、通信社、教育機関、放送局、エンターテイメント コンテンツの所有者、エンタープライズ LOB アプリにとって利用価値があり、一般には、ユーザーが検索の対象にするビデオ ライブラリを保有するすべての業界が対象になります。

- コンテンツ作成: Azure AI Video Indexer がコンテンツから抽出する分析情報に基づいて、トレーラー、ハイライト リール、ソーシャル メディア コンテンツまたはニュース クリップを作成します。 人物とラベルの外観用のキーフレーム、シーン マーカー、タイムスタンプにより、作成プロセスがより円滑で簡単になり、コンテンツの作成中に必要なビデオの部分に容易にアクセスできるようになります。

- アクセシビリティ: コンテンツを障碍のある人々が利用できるようにしたい場合や、コンテンツをさまざまな言語を使用してさまざまなリージョンに配布したい場合には、Azure AI Video Indexer によって複数の言語で提供される文字起こしと翻訳が使用できます。

- 収益化: Azure AI Video Indexer は、ビデオの価値の向上に役立ちます。 たとえば、広告収入に依存している業界 (ニュース メディア、ソーシャル メディアなど) では、抽出した分析情報を広告サーバーへの追加のシグナルとして利用することで、関連広告を提供できます。

- コンテンツ モデレーション: テキストとビジュアルのコンテンツ モデレーション モデルを使用して、不適切なコンテンツからユーザーの安全を維持し、公開したコンテンツが組織の値と一致することを検証します。 コンテンツに関して、特定のビデオを自動的にブロックしたり、ユーザーに通知したりすることができます。

- 推奨事項:ビデオの分析情報は、ユーザーに関連のあるビデオ モーメントを強調表示することで、ユーザー エンゲージメントを向上させるために使用できます。 より多くのメタデータで各ビデオにタグを付けることで、最も関連性の高いビデオをユーザーに勧め、ニーズに合ったビデオの部分を強調することができます。

ビデオ/オーディオの AI 機能

次の一覧は、Azure AI Video Indexer のビデオおよびオーディオの AI 機能 (モデル) を使用して、ビデオまたはオーディオ ファイルから取得できる分析情報を示しています。

注

プライバシーと規制の要件を考えると、これらの機能の一部は使用が制限され、完全に利用するには承認が必要です。

特に指定がない限り、モデルは一般提供されます。

ビデオ モデル

顔検出: ビデオに表示される顔を検出してグループ化します。

著名人識別: 世界中の 100 万人以上の著名人 (世界のリーダー、俳優、アーティスト、アスリート、研究者、ビジネス、技術リーダーなど) を識別します。 これらの著名人に関するデータは、さまざまな Web サイト (IMDB、Wikipedia など) でも見つけることができます。

アカウントベースの顔識別: 特定のアカウントのモデルをトレーニングします。 その後、トレーニングされたモデルに基づいてビデオ内の顔を認識します。 詳細については、「 Azure AI Video Indexer Web サイトから人物モデルをカスタマイズする」および「Azure AI Video IndexerAPI を使用して人物モデルをカスタマイズする」を参照してください。

顔のサムネイル抽出: (品質、サイズ、正面の位置に基づいて) 顔の各グループで最適にキャプチャされた顔を識別し、画像アセットとして抽出します。

光学式文字認識 (OCR): 画像、道路標識、メディア ファイル内の製品などの画像からテキストを抽出して分析情報を作成します。

ビジュアル コンテンツモデレーション: 成人のビジュアルやわいせつなビジュアルを検出します。

ラベル識別: 表示されるビジュアル オブジェクトとアクションを識別します。

シーンのセグメント化: 視覚的な手掛かりに基づいてビデオ内のシーンが変化するタイミングを決定します。シーンは 1 つのイベントを表し、セマンティックに関連する一連の連続したショットによって構成されます。

ショット検出: 視覚的な手掛かりに基づいてビデオでショットが変化するタイミングを決定します。ショットは、同じモーションピクチャカメラから撮影された一連のフレームです。 詳細については、「 シーン、ショット、キーフレーム」を参照してください。

黒いフレーム検出: ビデオに表示される黒いフレームを識別します。

キーフレーム抽出: ビデオ内の安定したキーフレームを検出します。

ローリング クレジット: テレビ番組や映画の最後のローリング クレジットの開始と終了を識別します。

編集ショットの種類の検出: タイプに基づいてショットをタグ付けします (ワイド ショット、ミディアム ショット、クローズアップ、極端なクローズアップ、2 ショット、複数のユーザー、屋外と屋内など)。 詳細については、「 編集ショットの種類の検出」を参照してください。

観察された人物の検出: ビデオ内の観察されたユーザーを検出し、ビデオ フレーム内の人物の位置 (境界ボックスを使用) や正確なタイムスタンプ (開始、終了)、人物が表示されたときの信頼度などの情報を提供します。 詳細については、「 ビデオで観察されたユーザーをトレースする」を参照してください。

- 一致したユーザー: ビデオで観察されたユーザーを、検出された対応する顔と照合します。 観察された人物と顔との照合には、信頼レベルが含まれます。

- 検出された衣類: ビデオに登場する人の服の種類を検出し、長いまたは短い袖、長いまたは短いパンツ、スカートやドレスなどの情報を提供します。 検出された衣服はそれを着ている人に関連付けられ、正確なタイムスタンプ (開始、終了) と検出の信頼度が提供されます。

- おすすめの服: ビデオに表示される注目の服の画像をキャプチャします。 特徴化した衣服の分析情報を利用して、ターゲット広告を改善することができます。 注目の衣料品の画像のランク付け方法と分析情報の取得方法については、 おすすめの衣料品を参照してください。

物体検出: フレームに戻った場合に認識されるようにそれも追跡する固有の物体を検出します。 Azure AI Video Indexer オブジェクト検出を参照してください

スレート検出: 高度なインデックス作成オプションを使用してビデオのインデックスを作成するときに、次の映画のポストプロダクション分析情報を識別します。

- メタデータ抽出によるカチンコの検出。

- カラー バーを含むデジタル パターン検出。

- シーン マッチングを含むテキストレス スレート検出。

詳細については、 スレート検出を参照してください。

テキストロゴ検出: Azure AI Video Indexer OCR を使用して、特定の定義済みテキストと一致します。 たとえば、ユーザーがテキストロゴ (

Microsoft) を作成した場合、Microsoftという単語のさまざまな外観がMicrosoftロゴとして検出されます。 詳細については、「 テキスト ロゴを検出する」を参照してください。

オーディオ モデル

音声の文字起こし: 音声を 50 言語以上のテキストに変換し、拡張機能を許可します。 詳細については、 Azure AI Video Indexer 言語のサポートに関するページを参照してください。

自動言語検出: 主要な音声言語を識別します。 詳細については、 Azure AI Video Indexer 言語のサポートに関するページを参照してください。 言語を確実に識別できない場合、Azure AI Video Indexer は音声言語が英語であると想定します。

複数言語の音声識別と文字起こし: 音声とは異なるセグメントで話された言語を識別します。 書き起こされるようにメディア ファイルの各セグメントを送信した後、文字起こしが 1 つの統合された文字起こしに結合されます。 文字起こしの詳細については、「文字起こし」を参照してください。

クローズド キャプション: VTT、TTML、SRT の 3 つの形式でクローズド キャプションを作成します。

2 つのチャネル処理: 自動で個別のトランスクリプトを検出し、1 つのタイムラインにマージします。

ノイズリダクション: テレフォニーオーディオまたはノイズの多い録音をクリアします (Skype フィルターに基づく)。

トランスクリプトのカスタマイズ (CRIS): 業界固有のトランスクリプトを作成するために、カスタム音声テキスト モデルをトレーニングします。 詳細については、「 言語モデルのカスタマイズ」を参照してください。

話者の列挙: どの話者がどの単語とタイミングを話したかをマップして理解します。 16 人の話者を 1 つの音声ファイルで検出できます。

話者統計: 話者の音声比率の統計情報を提供します。

テキスト コンテンツ モデレーション: 音声トランスクリプト内の明示的なテキストを検出します。

テキストベースの感情検出: トランスクリプト分析によって検出された喜び、悲しみ、怒り、恐怖などの感情。

翻訳: さまざまな言語で音声トランスクリプトの翻訳を作成します。 詳細については、 Azure AI Video Indexer 言語のサポートに関するページを参照してください。

オーディオ効果の検出: コンテンツの非スピード セグメントで、アラームまたはサイレン、犬の吠え、群衆の反応 (応援、拍手、ブーイング)、銃声または爆発、笑い、ガラスの破損、無音のオーディオ効果を検出します。

検出される音響イベントはクローズド キャプション ファイルにあります。 このファイルは、Azure AI Video Indexer の Web サイトからダウンロードできます。 詳細については、「 オーディオ効果の検出」を参照してください。

注

イベントの完全なセットは、アップロード プリセットでファイルのアップロード時に [高度なオーディオ分析 ] を選択した場合にのみ使用できます。 既定では、無音のみが検出されます。

オーディオとビデオのモデル (マルチチャンネル)

1 つのチャネルでインデックスを作成すると、それらのモデルの部分的な結果を使用できます。

- キーワード抽出: 音声テキストとビジュアル テキストからキーワードを抽出します。

- 名前付きエンティティ抽出: 自然言語処理 (NLP) を使用して、音声テキストとビジュアル テキストからブランド、場所、ユーザーを抽出します。

- トピックの推論: さまざまなキーワードに基づいてトピックを抽出します (つまり、キーワード 'Exchange'、'Wall Street' はトピック 'Economics' を生成します)。 このモデルでは、3 つの異なるオントロジ (IPTC、 Wikipedia、Video Indexer 階層トピックオントロジ) を使用します。 このモデルでは、文字起こし (話し言葉)、OCR コンテンツ (ビジュアル テキスト)、および Video Indexer の顔認識モデルを使用してビデオで認識された著名人を使用します。

- 成果物: 各モデルの豊富な "次のレベルの詳細" 成果物を抽出します。

- 感情分析: 音声テキストとビジュアル テキストから肯定的、否定的、中立的なセンチメントを識別します。

Azure AI Video Indexer の使用を開始するにはどうすればよいですか?

Azure AI Video Indexer の使用を開始する方法について説明します。

セットアップが完了したら、分析情報の使用を開始し、他の 方法ガイドを確認してください。

コンプライアンス、プライバシー、セキュリティ

注

2020 年 6 月 11 日、Microsoft は、人権に基づく強力な規制が制定されるまで、米国の警察に顔認識テクノロジを販売しないことを発表しました。 そのため、お客様は、顔認識機能や Azure AI サービスに含まれる機能 (Face や Video Indexer など) を使用することはできません。たとえば、お客様が米国の警察によって、またはそのようなサービスの使用を許可している場合です。

注

顔識別、カスタマイズ、および著名人認識機能のアクセスは、責任ある AI 原則をサポートするために、適格性と使用条件に基づいて制限されます。 顔識別、カスタマイズ、および著名人認識機能は、Microsoft の管理対象の顧客とパートナーのみが利用できます。 顔認識の取り込みフォームを使用して、アクセスを申請します。

Azure AI Video Indexer の使用に適用されるすべての法律を遵守する必要があります。また、Azure AI Video Indexer や Azure サービスを、他のユーザーの権利を侵害したり、他のユーザーに有害な可能性がある方法で使用したりすることはできません。

ビデオ/画像を Azure AI Video Indexer にアップロードする前に、法律で要求されている場合、ビデオ/イメージ内の個人 (存在する場合) からの、Azure AI Video Indexer と Azure でのデータの使用、処理、保存に必要なすべての同意を含め、ビデオ/画像を使用するための適切かつ法的な権利をすべて持っている必要があります。 一部の管轄区域では、生体認証データなど、特定のカテゴリのデータの収集、オンライン処理、ストレージに特別な法的要件が課される場合があります。 特別な法的要件に該当するデータの処理と保存に Azure AI Video Indexer と Azure を使用する前に、お客様とその使用目的に適用されるすべての法的要件に従って使用する必要があります。

Azure AI Video Indexer のコンプライアンス、プライバシー、セキュリティの詳細については、Microsoft セキュリティ センターを参照してください。 お客様のデータを削除する方法を含む、Microsoft のプライバシー義務、データ処理および保持プラクティスについては、Microsoft の プライバシーに関する声明、 オンライン サービス条件 ("OST")、 およびデータ処理補遺 ("DPA") を確認してください。 Azure AI Video Indexer を使用すると、OST、DPA、およびプライバシーに関する声明に拘束されることに同意したと見なされます。