組織が人工知能 (AI) モデルを使用して自動化、分析情報、インテリジェントな意思決定を推進するにつれて、セキュリティ チームは、環境に入る AI モデルの安全性とコンプライアンスを評価するために可視性と制御を必要とします。 これらのモデルは、多くの場合、データとインフラストラクチャに幅広くアクセスできます。 これらの機能がないと、内部標準の適用がますます困難になります。

Microsoft Defender for Cloud の Defender for AI セキュリティでは、AI モデルのスキャンがサポートされています。 AI モデル スキャンでは、安全でないアーティファクトまたは悪意のある成果物を事前に検出し、AI ライフサイクル全体にわたってモデルのリスクを継続的に監視します。

AI モデルのセキュリティは、AI モデルが運用環境に到達する前に、埋め込みマルウェア、安全でないオペレーター、公開されたシークレットなどのセキュリティ リスクについて AI モデルを自動的にスキャンします。 Azure Machine Learning および CI/CD パイプラインと直接統合されたこのサービスでは、リアルタイムの調査結果と実用的な修復ガイダンスが表示されるため、チームは開発プロセスの早い段階で危険なモデルを停止できます。

AI モデルのセキュリティを使用することで、セキュリティ チームは、Azure Machine Learning ワークスペースとレジストリにアップロードされたカスタム AI モデルをスキャンして、埋め込みマルウェア、安全でないオペレーター、公開されたシークレットなどの脅威を特定できます。 Defender for Cloud は結果を提示し、チームはセキュリティの結果と共に重大度評価、修復ガイダンス、関連するモデル メタデータを可視化し、効果的なトリアージと優先順位付けをサポートします。 開発者は、Azure DevOps または GitHub パイプラインと統合された CLI ツールを使用して、ビルドまたはリリース段階でモデル スキャンをトリガーすることもできます。これにより、モデルが運用環境に到達する前に静的スキャンと早期リスク検出が可能になります。

前提条件

- Azure Machine Learning (Azure Machine Learning ) レジストリまたはワークスペースに登録されている AI モデルを含む Azure サブスクリプションが必要です。

注

プライベート リンクを使用するワークスペースとレジストリはサポートされていません。

AI サービスと、計画の AI モデル セキュリティ コンポーネントに対して脅威保護を有効にする必要があります。

必要なアクセス許可: プランを有効にするには、Azure Machine Learning リソースに対する 所有者 レベルまたは 共同作成者 レベルのアクセス許可が必要です。

サポートされているモデル ファイル形式:

Pickle (.pkl)、HDF5 (.h5)、TorchScript (.pt)、ONNX (.onnx)、SafeTensors (.safetensors)、TensorFlow SavedModel / TFLite (FlatBuffers)、NumPy (.npy)、Arrow, MsgPack, dill, joblib、PMML, JSON, POJO, MOJO, GGUF。ファイル サイズの制限: 10 GB。 10 GB を超えるモデル ファイルはスキャンできません。

スキャンは週に 1 回行われます。

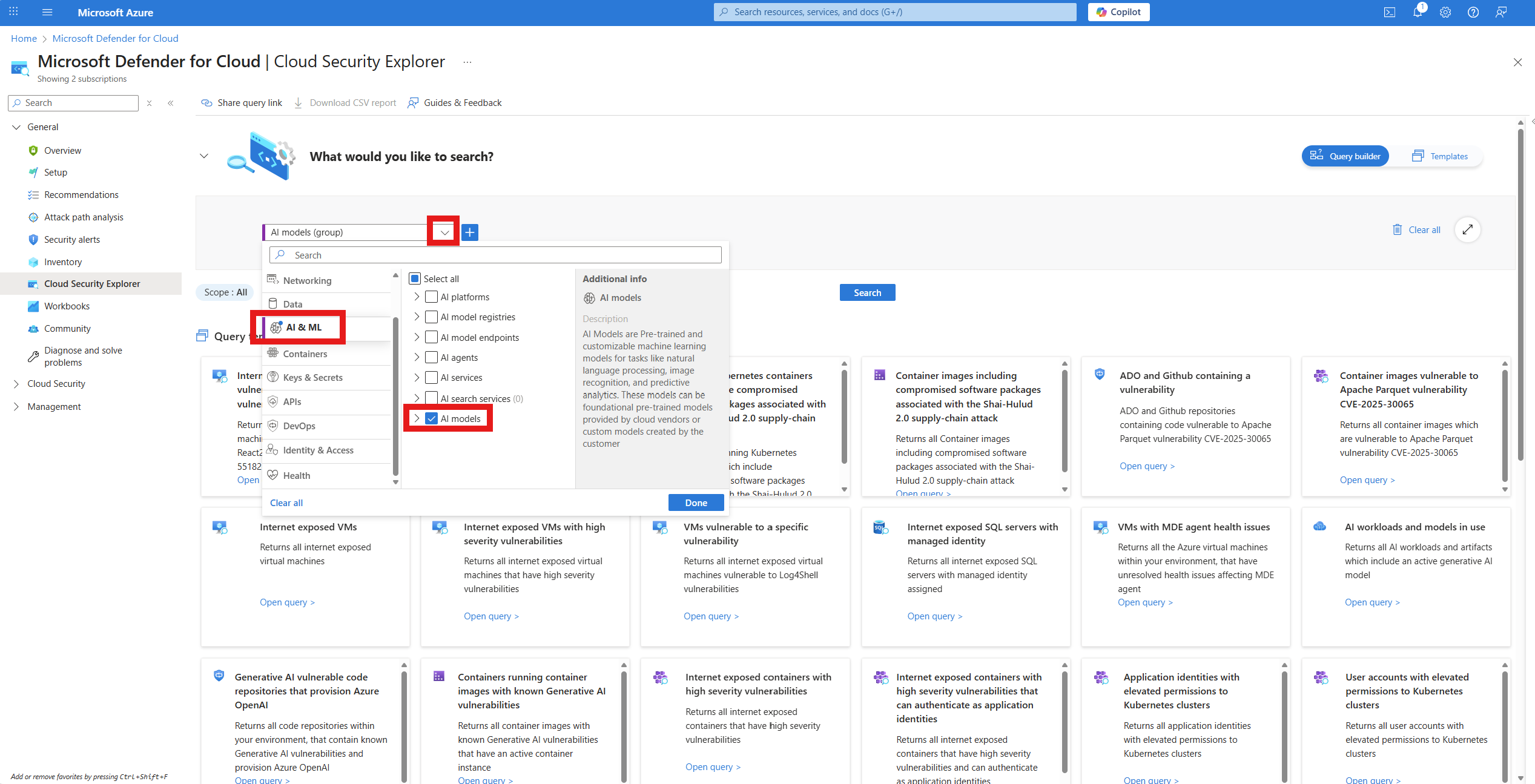

環境内のすべての AI モデルを検索する

Azure portal にサインインする

「Microsoft Defender for Cloud」を検索して選択します。

Cloud Security Explorer を選択します。

AI & Mls AI モデル を選択します。完了を選択します。

+ を選択します。

> AI モデル メタデータを選択します。

検索 を選択します。

Cloud Security Explorer には、環境内のすべての AI モデルが表示されます。 [ 詳細の表示 ] を選択すると、選択した各モデルに関する詳細情報を表示できます。

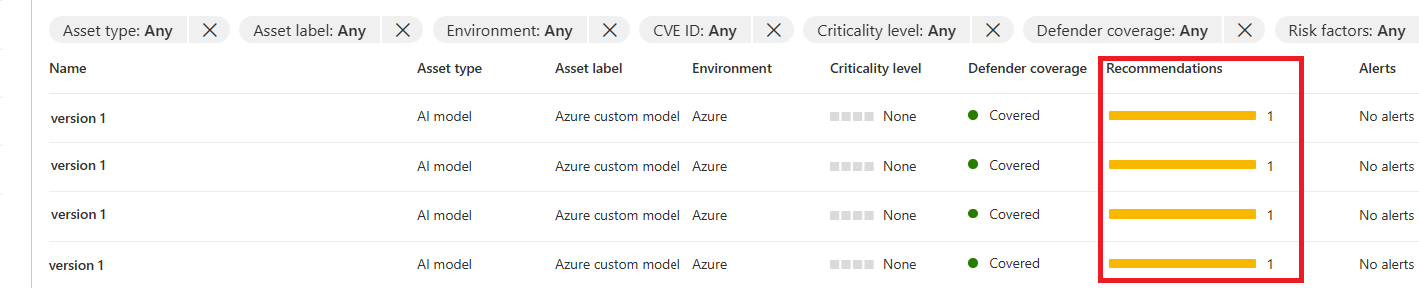

セキュリティの結果を使用して AI モデルを検索する

Cloud Security Explorer を使用して、アクティブなセキュリティ結果を持つ AI モデルを見つけます。

「 環境内のすべての AI モデルを検索する」セクションの 手順 1 から 7 に従います。

+ を選択します。

[ 推奨事項>すべての推奨事項] を選択します。

検索 を選択します。

Cloud Security Explorer には、アクティブなセキュリティ結果を持つ環境内のすべての AI モデルが表示されます。 ビュー の詳細 を選択すると、各モデルと関連する結果に関する詳細情報が表示されます。

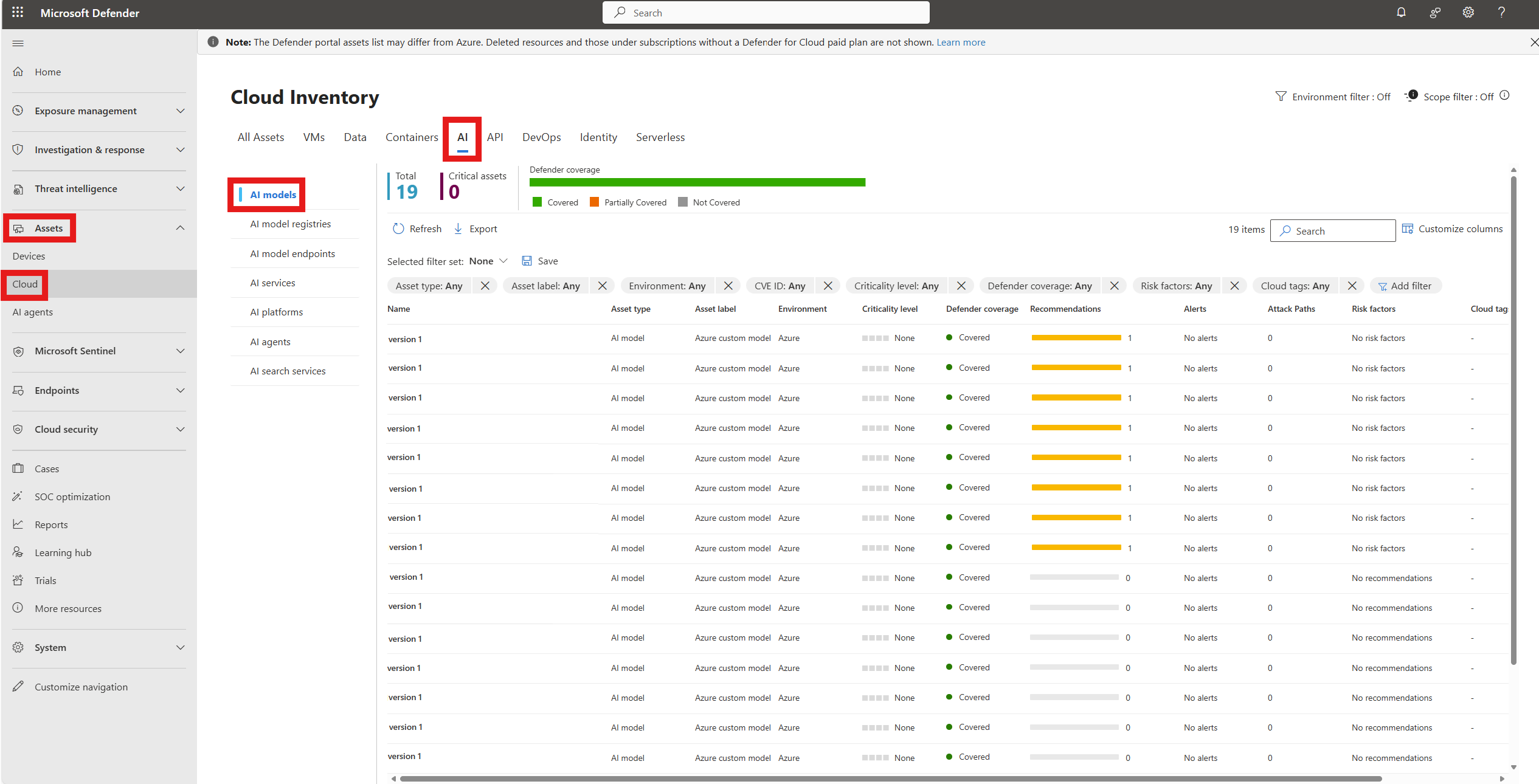

環境内のすべての AI モデルを検索する

Defender ポータル の [資産] ページには、環境内のすべての AI モデルの包括的なビューが表示されます。

Microsoft Defender ポータルにサインインします。

Assets>Cloud>AI>AI モデルに移動します。

推奨事項を含む AI モデルを選択します。

アセットページを開くを選択します。

[ セキュリティに関する推奨事項> 関連する推奨事項を選択します。

必要に応じて、セキュリティの検出を確認して修復します。

Azure portal で推奨事項を管理することもできます。

![[AI モデル メタデータ] オプションを選択する方法を示すスクリーンショット。](media/models/ai-models-metadata.png)

![[すべての推奨事項] オプションを選択する方法を示すスクリーンショット。](media/models/all-recommendations.png)

![[資産ページを開く] ボタンがある場所を示すスクリーンショット。](media/models/asset-page.png)