データ重複除去のユース ケースと相互運用性の定義

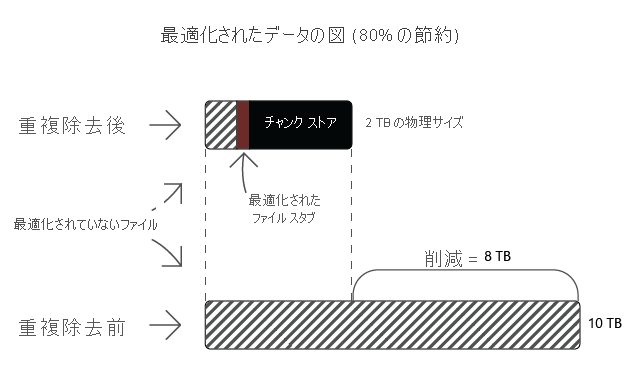

データ重複除去によって削減される量は、データの種類、データの組み合わせ、ボリュームのサイズ、それらのボリュームに含まれているファイルによって異なります。 重複除去を有効にする前に、ボリュームごとの削減量を評価するオプションがあります。

データ重複除去のユース ケース

次の一覧では、重複除去の一般的なシナリオと、それぞれにおけるボリューム領域の削減量を示しています。

| 使用事例 | コンテンツ | 領域の削減量 |

|---|---|---|

| ユーザー ドキュメント | グループ コンテンツの公開/共有、ユーザーのホーム フォルダー、オフライン ファイルにアクセスするためのプロファイルのリダイレクト | 30 - 50% |

| ソフトウェア展開用の共有 | ソフトウェア バイナリ、cab ファイル、シンボル ファイル、イメージ、更新プログラム | 70 - 80% |

| 仮想化ライブラリ | ハイパーバイザーへのプロビジョニング用の仮想ハード ディスク ファイル (つまり、.vhd ファイルと .vhdx ファイル) のストレージ | 80 - 95% |

| 一般的なファイル共有 | これまでに特定されたすべてのデータ タイプの組み合わせ | 50 - 60% |

推奨されるデータ重複除去のユース ケース

Windows Server での潜在的な削減量と標準的なリソースの使用量に基づいて、重複除去の展開の候補は理想的な候補、評価が必要な候補、理想的ではない候補としてランクされます。

- 重複除去に理想的な候補:

- フォルダー リダイレクト サーバー。

- 仮想化関連データの格納場所またはプロビジョニング ライブラリ。

- ソフトウェア展開用の共有。

- Microsoft SQL Server および Microsoft Exchange Server のバックアップ ボリューム。

- スケールアウト ファイル サーバー (SOFS) クラスターの共有ボリューム (CSV) 上のファイル。

- 仮想化されたバックアップ VHD (Microsoft System Center Data Protection Manager など)。

- 仮想デスクトップ インフラストラクチャの VDI VHD (パーソナル VDI のみ)。

重要

ほとんどの VDI の展開では、ブート ストームを考慮した特別な計画が必要となります。 この用語は、多くのユーザーが始業時間に VDI に同時にサインインしようとする状況を指します。 ブート ストームでは VDI ストレージ システムに大きな負荷がかかるため、VDI ユーザーが最初にサインインするときに長い遅延が発生することがあります。 重複除去を有効にすると、ブート ストームの影響を最小限に抑えることができます。 これにより、VM の起動中のディスク上の重複除去ストアからのチャンクの読込みがメモリにキャッシュされます。 その結果、以降の読み取りでは、ディスク上のチャンクがキャッシュ内で使用できるようになるため、それらのチャンクに頻繁にアクセスする必要がなくなります。

コンテンツに基づく評価が必要

- 基幹業務 (LOB) サーバー。

- 静的コンテンツのプロバイダー。

- Web サーバー。

- ハイ パフォーマンス コンピューティング (HPC)。

重複除去に理想的ではない候補:

- Windows Server Update Service (WSUS)。

- SQL Server および Exchange Server データベースのボリューム。

削減効果を重複除去評価ツールで評価する

重複除去評価ツール (DDPEval.exe) を使用すると、特定のボリュームでの重複除去で予想される削減量を判断できます。 DDPEval.exe では、ローカル ドライブと、マッピングされたリモート共有やマッピングされていないリモート共有の評価がサポートされます。

ヒント

重複除去機能をインストールすると、DDPEval.exe が \Windows\System32\ ディレクトリに自動的にインストールされます。

データ重複除去の相互運用性

Windows Server では、データ重複除去を展開するときに、次の関連するテクノロジと潜在的な問題について考慮する必要があります。

Windows BranchCache

Windows Server および Windows クライアントのオペレーティング システムで BranchCache を有効にすると、ワイド エリア ネットワーク (WAN) 経由のデータへのアクセスを最適化できます。 2 つのテクノロジを組み合わせると、重複除去されたすべてのファイルが既にインデックス付けおよびハッシュ化されているため、ブランチ オフィスからのデータ要求の処理が高速化されます。 これは、BranchCache 対応サーバーを事前にインデックス付けまたはハッシュ化することと似ています。

注意

BranchCache は、ユーザーがブランチ オフィスの場所からセントラル オフィスのコンテンツにアクセスするときに、WAN の使用量を減らし、ネットワーク アプリケーションの応答性を向上させることができる機能です。 BranchCache を有効にすると、Web サーバーまたはファイル サーバーから取得されたコンテンツのコピーがブランチ オフィスの内部にキャッシュされます。 ブランチ内の別のクライアントによって同じコンテンツが要求された場合、そのクライアントでは、再び WAN を使用してセントラル オフィスからコンテンツを取得するのではなく、ローカル ブランチのネットワークから直接ダウンロードできます。

フェールオーバー クラスター

フェールオーバー クラスターでは、データ重複除去が完全にサポートされます。これは、重複除去されたボリュームがクラスター内のノード間で正常にフェールオーバーされることを意味します。 ただし、フェールオーバーに参加するクラスター内の各ノードにデータ重複除去機能をインストールする必要があります。

FSRM クォータ

重複除去が有効にされているボリューム ルートのフォルダーにはハード クォータを作成しないようにする必要がありますが、このようなシナリオでは、ファイル サーバー リソース マネージャー (FSRM) を使用してソフト クォータを作成できます。 重複除去されたファイルが FSRM で検出されると、クォータを計算するために、そのファイルの論理サイズが識別されます。 このため、重複除去によってファイルが処理されても、クォータの使用率 (クォータのしきい値を含む) は変わりません。 ボリューム ルートのソフト クォータやサブフォルダーのクォータを含む FSRM クォータの他のすべての機能は、重複除去が使用されていても予想したとおりに機能します。

注意

FSRM は、サーバーに格納されているデータの種類と量を識別、制御、管理するために役立つ一連のツールです。 FSRM では、フォルダーとボリュームにハードまたはソフトのクォータを構成できます。 ハード クォータでは、クォータ制限に達すると、ユーザーがファイルを保存できないようにされるのに対して、ソフト クォータでは、クォータ制限は適用されず、ボリューム上のデータがしきい値に達したときに通知が生成されます。

DFS レプリケーション

データ重複除去は、分散ファイル システム (DFS) レプリケーションと互換性があります。 ファイルを最適化または非最適化しても、ファイルは変更されないため、レプリケーションはトリガーされません。 DFS レプリケーションでは、ネットワークを節約するため、(チャンク ストアのチャンクではなく) Remote Differential Compression (RDC) が使用されます。