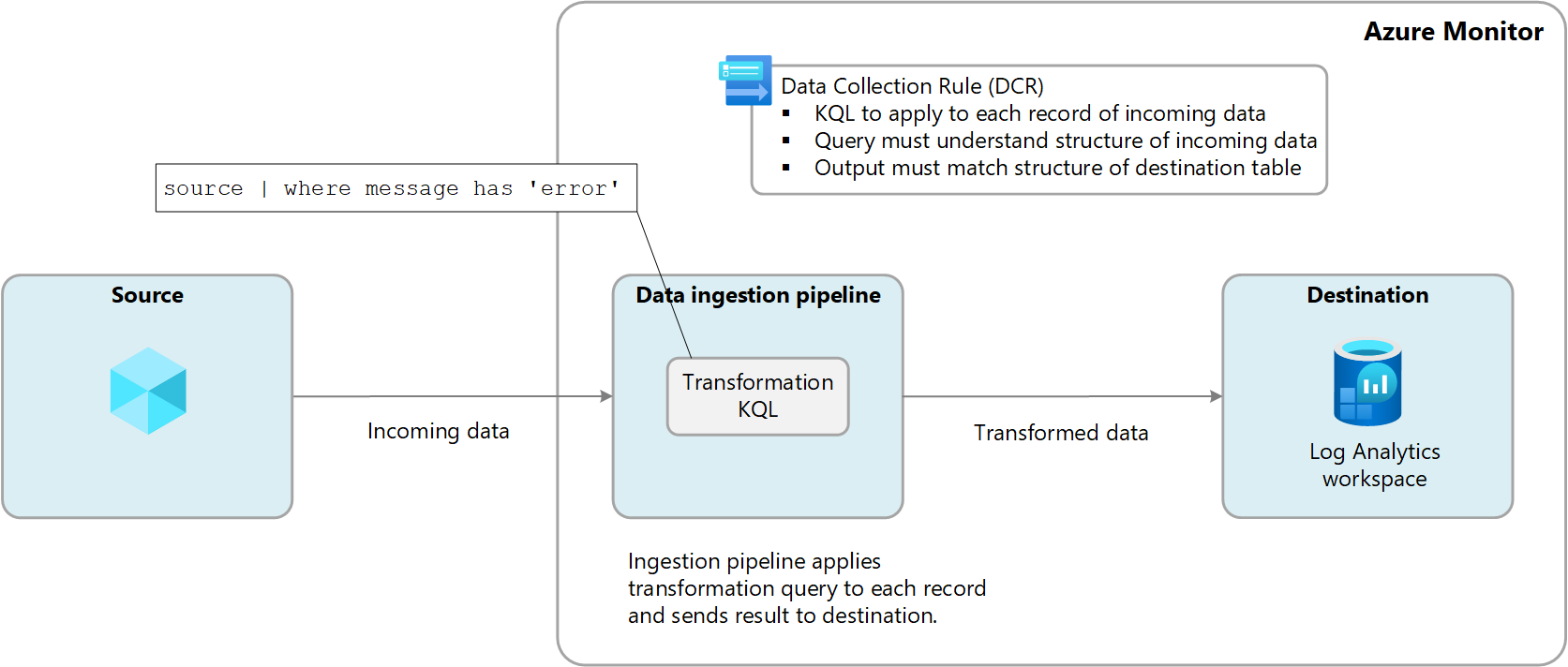

Azure Monitor의 변환을 사용하면 들어오는 데이터를 Log Analytics 작업 영역으로 보내기 전에 필터링하거나 수정할 수 있습니다. 변환은 데이터 원본이 데이터를 전달한 후 대상에 전송되기 전에 실행됩니다. DCR(데이터 수집 규칙)에 정의되어 있으며 수신 데이터의 각 항목에 개별적으로 적용되는 KQL(Kusto 쿼리 언어) 문을 사용합니다.

다음 다이어그램은 들어오는 데이터에 대한 변환 프로세스와 사용할 수 있는 샘플 쿼리를 보여 줍니다. 이 샘플에서는 열에 message 단어가 error 포함된 레코드만 수집됩니다.

지원되는 테이블

Log Analytics 작업 영역의 다음 표는 변환을 지원합니다.

- Azure Monitor 로그에서 변환을 지원하는 테이블에 나열된 모든 Azure 테이블. 변환을 지원하는지 여부를 포함하여 각 테이블의 특성을 나열하는 Azure Monitor 데이터 참조를 사용할 수도 있습니다.

- Azure Monitor 에이전트에 대해 만들어진 모든 사용자 지정 테이블입니다.

변환 만들기

Azure Portal을 사용하여 변환을 추가할 수 있는 몇 가지 데이터 수집 시나리오가 있지만 대부분의 시나리오에서는 JSON 정의를 사용하여 새 DCR을 만들거나 기존 DCR에 변환을 추가해야 합니다. 다양한 옵션은 Azure Monitor에서 변환 만들기를 참조하고, 일반적인 시나리오에 대한 샘플 변환 쿼리는 Azure Monitor에서 변환에 대한 모범 사례 및 샘플을 참조하세요.

작업 영역 변환 DCR

변환은 DCR(데이터 수집 규칙)에 정의되어 있지만 Azure Monitor에는 아직 DCR을 사용하지 않는 데이터 수집이 있습니다. 예를 들어 진단 설정에서 수집한 리소스 로그와 Application Insights에서 수집한 애플리케이션 데이터가 있습니다.

DCR(작업 영역 변환 데이터 수집 규칙)은 Log Analytics 작업 영역에 직접 적용되는 특수 DCR입니다. 이 DCR의 목적은 데이터 컬렉션에 DCR을 아직 사용하지 않으므로 변환을 정의할 수단이 없는 데이터에 대한 변환 을 수행하는 것입니다.

각 작업 영역에 대해 하나의 작업 영역 DCR만 있을 수 있지만 지원되는 테이블 수에 제한 없이 변환을 포함할 수 있습니다. 이러한 변환은 해당 데이터가 다른 DCR에서 제공되지 않는 한 이러한 테이블로 전송된 모든 데이터에 적용됩니다.

예를 들어 이벤트 테이블은 Windows 가상 머신의 이벤트를 저장하는 데 사용됩니다. 이벤트 테이블에 대한 작업 영역 변환 DCR에서 변환을 만드는 경우 이 에이전트는 DCR을 사용하지 않으므로 Log Analytics 에이전트1을 실행하는 가상 머신에서 수집한 이벤트에 적용됩니다. 변환은 DCR을 사용하여 데이터 수집을 정의하기 때문에 AMA(Azure Monitor 에이전트)에서 보낸 모든 데이터에 의해 무시됩니다. Azure Monitor 에이전트에서 변환을 계속 사용할 수 있지만 작업 영역 변환 DCR이 아니라 에이전트와 연결된 DCR에 해당 변환을 포함합니다.

1 Log Analytics 에이전트는 더 이상 사용되지 않지만 일부 환경에서는 계속 사용할 수 있습니다. DCR을 사용하지 않는 데이터 원본의 한 가지 예일 뿐입니다.

변환 비용

Azure Monitor 클라우드 파이프라인에서 로그 처리(변환 및 필터링)는 Log Analytics 작업 영역에서 데이터를 수집하는 테이블의 유형에 따라 다른 청구 영향을 줍니다.

보조 로그

처리된 데이터 및 Log Analytics 작업 영역에 수집된 데이터에 대한 보조 로그 요금입니다. 데이터 처리 요금은 Log Analytics 작업 영역의 대상이 보조 로그 테이블인 경우 Azure Monitor 클라우드 파이프라인에서 수신하는 모든 들어오는 데이터에 적용됩니다. 데이터 수집 요금은 보조 로그 테이블로 Log Analytics 작업 영역으로 수집되는 변환 후의 데이터에만 적용됩니다. 변환은 데이터 크기를 줄일 수 있습니다.

다음 표에서는 몇 가지 예를 보여 줍니다.

| 들어오는 데이터 크기 | 변환에 의해 삭제되거나 추가된 데이터 | Log Analytics 작업 영역에 보조 로그 테이블로 수집된 데이터 | 데이터 처리 청구 가능 GB | 데이터 수집 청구 가능 GB |

|---|---|---|---|---|

| 20GB | 12GB 삭제됨 | 8GB | 20GB | 8GB |

| 20GB | 8GB 삭제됨 | 12GB | 20GB | 12GB |

| 20GB | 4GB 추가됨 | 24GB | 20GB | 24GB |

로그 처리 및 로그 데이터 수집에 대한 가격은 Azure Monitor 가격 책정 을 참조하세요.

분석 또는 기본 로그

분석 또는 기본 로그의 경우 변환 자체는 일반적으로 비용이 발생하지 않지만 다음 시나리오에서는 추가 요금이 발생할 수 있습니다.

- 계산 열을 추가하는 등의 변환으로 들어오는 데이터의 크기가 증가하는 경우 추가 데이터에 대한 표준 수집 속도에 대한 요금이 청구됩니다.

- 변환으로 수집된 데이터가 50%이상 감소할 경우, 필터링된 데이터의 양이 50%를 초과하는 부분에 대해 요금이 청구됩니다.

변환으로 인한 데이터 처리 요금을 계산하려면 다음 수식을 사용합니다.

[변환에 의해 삭제된 GB 데이터] - ([GB 들어오는 데이터 크기] / 2).

다음 표에서는 두 가지 예제를 보여 줍니다.

| 들어오는 데이터 크기 | 변환에 의해 삭제되거나 추가된 데이터 | Analytics 또는 기본 로그 테이블로 Log Analytics 작업 영역에 수집된 데이터 | 데이터 처리 청구 가능 GB | 데이터 수집 청구 가능 GB |

|---|---|---|---|---|

| 20GB | 12GB 삭제됨 | 8GB | 2GB | 8GB |

| 20GB | 8GB 삭제됨 | 12GB | 0GB | 12GB |

| 20GB | 4GB 추가됨 | 24GB | 0GB | 24GB |

이 요금을 피하려면 변환을 적용하기 전에 대체 방법을 사용하여 수집한 데이터를 필터링하는 것이 좋습니다. 이렇게 하면 변환으로 처리된 데이터의 양을 줄일 수 있으므로 추가 비용을 최소화할 수 있습니다.

로그 처리 및 로그 데이터 수집 가격은 Azure Monitor 가격을 참조하세요.

중요합니다

Log Analytics 작업 영역에 대해 Microsoft Sentinel을 사용하도록 설정한 경우 변환이 필터링하는 데이터의 양에 관계없이 분석 테이블로 변환하는 데 드는 비용은 없습니다.