Merk

Tilgang til denne siden krever autorisasjon. Du kan prøve å logge på eller endre kataloger.

Tilgang til denne siden krever autorisasjon. Du kan prøve å endre kataloger.

Naturlig språkforståelse (NLU) er kjernen i hvordan Copilot Studio-agenter tolker brukerhenvendelser og gir relevante, kontekstuelle svar. En veldefinert tilnærming til intensjonsgjenkjenning, entitetsuttrekking og håndtering av fallback-løsninger sikrer at agenter leverer effektive, naturlige samtaler som samsvarer med forretningsbehov.

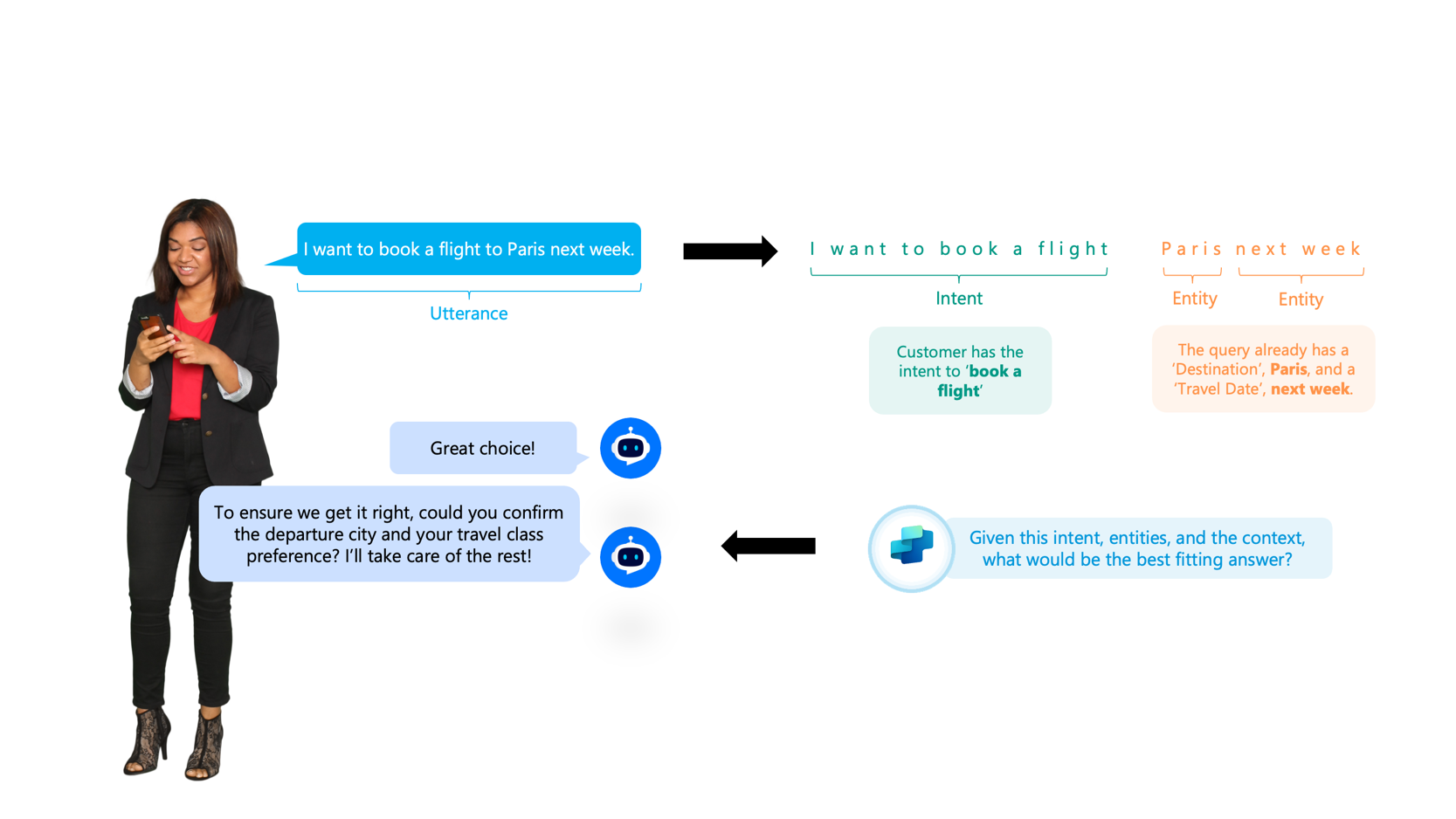

Når en bruker skriver inn noe til en agent, kalles det en ytring. Agenten må bryte opp ytringen i intensjon og enheter, slik at agentens respons føles både naturlig og effektiv.

Hva er språkforståelse?

Språkforståelse (LU) er et underfelt av naturlig språkbehandling (NLP) som fokuserer på å gjøre det mulig for maskiner å forstå meningen, intensjonen og konteksten bak menneskelig språk.

Diagram som viser hvordan en brukers melding deles opp i intensjon og enheter. En person skriver: «Jeg vil bestille en flybillett til Paris neste uke.» Meldingen er merket som en ytring. Uttrykket «Jeg vil bestille en flyreise» identifiseres som intensjonen, og «Paris» og «neste uke» identifiseres som enheter. Systemet ber deretter om flere detaljer som avreiseby og reiseklasse. Diagrammet illustrerer hvordan agenten bruker intensjon, entiteter og kontekst for å avgjøre den beste responsen.

Språkforståelse innebærer:

- Intensjonsgjenkjenning: Å identifisere hva brukeren ønsker å oppnå (for eksempel kartlegger «Bestill en flyreise til Paris neste uke» intensjonen om å bestille en flyvning).

- Entitetsutvinning: Å hente ut viktige detaljer som datoer, steder eller navn (for eksempel "Paris" som destinasjon, "neste uke" som reisedato).

- Kontekstbevissthet: Opprettholde kontinuitet og løse tvetydigheter i samtaler (for eksempel forstå pronomen eller referanser).

- Håndtering av tvetydigheter: Å bruke kontekst for å løse ord med flere betydninger (for eksempel «bank» som finansinstitusjon eller elvebredd).

Språkforståelse i Copilot Studio

Copilot Studio har en fleksibel modell for språkforståelse, med flere konfigurasjonsmuligheter.

Generativ iverksetting

Generativ orkestrering bruker språkmodeller for å intelligent koble sammen temaer, handlinger og kunnskap. Denne funksjonaliteten muliggjør gjenkjenning av flere intensjoner, avansert entitetsuttrekking og dynamisk plangenerering for komplekse spørringer.

Denne metoden er standard for Copilot Studio. Denne tilnærmingen gjenkjenner flere intensjoner eller temaer i én ytring, kobler automatisk sammen handlinger og kunnskapskilder, og genererer enhetlige svar. Det er spesielt nyttig for å håndtere komplekse samtaler som spenner over flere forretningsområder. Generativ orkestrering har begrensninger, som fem meldinger per tema eller handlingskjede, og 128 temaer eller handlinger per orkestrering, men det gir en kraftfull måte å skalere samtalebredde på.

Lær mer i Bruk generative orkestreringsmuligheter.

Klassisk iverksetting

Klassisk orkestrering bruker triggerfraser og deterministisk temaruting. Hvis en brukers ytring samsvarer med en triggerfrase, kjører det tilsvarende temaet. Hvis det ikke er noen match, søker fallback-mekanismer i kunnskapskilder eller ber brukeren om avklaring.

Innebygd NLU

Denne tilnærmingen var standard, men er nå fallback-løsningen. Copilot Studio tilbyr en ferdig NLU-modell som støtter triggerfraser, forhåndsdefinerte enheter og egendefinerte enheter. Denne modellen gjør det mulig for agenter å identifisere brukerintensjon og hente ut nøkkeldetaljer som datoer, destinasjoner eller mengder direkte fra en forespørsel.

NLU+

For høy nøyaktighet, bruk NLU+-alternativet. NLU+-alternativet er ideelt for store programmer i bedriftsklasse. Disse typene programmer består vanligvis av et stort antall emner og enheter, og bruker et stort antall opplæringseksempler. Hvis du har en stemmeaktivert agent, brukes også NLU+-opplæringsdataene til å optimalisere talegjenkjenningsfunksjonene dine.

Azure CLU integration

For mer avanserte scenarioer hvor du ikke kan bruke standard generativ orkestrering, kan du integrere Azure Conversational Language Understanding (CLU). CLU gir større tilpasning, flerspråklig støtte og kompleks entitetsutvinning (for eksempel flere "fra"-enheter). Du må kartlegge CLU-intensjoner til Copilot Studio-temaer for å holde dem synkroniserte. Dette alternativet er spesielt verdifullt for bransjespesifikke vokabularer, ikke-engelske språk eller scenarioer som krever høyere nøyaktighet.

Nøkkelfunksjoner og begrensninger

Denne tabellen sammenligner de tre språkforståelsesmetodene i Copilot Studio. Den fremhever deres nøkkelfunksjoner og begrensninger for å hjelpe deg med å velge riktig modell for agentens behov for kompleksitet, skala og nøyaktighet.

| Egenskaper og begrensninger | Generativ iverksetting | Innebygd NLU-modell | Egendefinert Azure CLU-modell |

|---|---|---|---|

| Viktige funksjoner |

|

|

|

| Grenser |

|

|

|

Lær mer i Oversikt over naturlig språkforståelse (NLU).

Temastruktur og fallback

Temaene har gått bort fra en rigid, intensjonsbasert vei til en mer fleksibel, orkestreringsfokusert tilnærming. I stedet for å stole utelukkende på forhåndsdefinerte triggere og stier, fungerer temaer nå som modulære instruksjoner som agenten kan påkalle når de orkestrerer en samtale. Generativ orkestrering håndterer det meste av rutingen ved å tolke brukerinput dynamisk, og emner gir strukturert fallback når presisjon er nødvendig.

Den mer tradisjonelle strukturerte temautformingen gjør samtalene naturlige og effektive. Emner kan være inngangspunkter utløst av brukeruttalelser eller gjenbrukbare underemner som kalles av omdirigeringer eller systemhendelser. Ambigueringstemaer bidrar til å unngå forvirring når flere temaer kan utløses, mens fallback- og samtaleforsterkende temaer gir sikkerhetsnett når agenten ikke trygt kan matche intensjonen. Du kan også legge på generative svar som hentes fra eksterne kunnskapskilder, slik at brukerne sjelden står uten svar.

Lær mer i Apply best practices to authoring topics.

Lokalisering og språk

Språket som brukes av en Copilot Studio-agent bestemmes av verdien til systemvariabelen: System.User.Language.

Denne variabelen fungerer som det sentrale kontrollpunktet for all språkrelatert atferd hos agenten. Du kan sette verdien manuelt, programmatisk, eller oppdage den automatisk.

Hvordan fungerer det?

Søk kunnskap på brukerens språk: Copilot Studio bruker verdien av

System.User.Languagetil å søke i kunnskapskilder på det angitte språket. Denne tilnærmingen betyr at selv om en bruker stiller et spørsmål på ett språk, oversetter agenten søkeforespørselen til språket som er satt iSystem.User.Language(automatisk oversettelse for søkespørring).Svar på brukerens språk: Agenten genererer svar på språket som er spesifisert av

System.User.Language, uavhengig av hvilket språk som brukes i spørsmålet eller de opprinnelige dokumentene (automatisk oversettelse for svargenerering).Manuell overstyring: Du kan manuelt sette verdien av

System.User.Languagefor å tvinge agenten til å operere i et bestemt språk. Denne funksjonen er nyttig for testing eller i situasjoner der du må kontrollere språket eksplisitt. Finn ut mer i Konfigurer og opprett flerspråklige agenter.

Automatisk gjenkjenning av talespråk

Du kan konfigurere Copilot Studio til automatisk å oppdage brukerens tale- eller skriftlige språk og sette variabelen System.User.Language deretter. Denne funksjonen muliggjør sømløse flerspråklige opplevelser uten at brukerne må spesifisere sitt språk.

Hvordan auto-deteksjon fungerer

- Triggerbasert deteksjon: Når boten mottar en melding, starter en trigger en språkdeteksjonsflyt.

-

Sett systemvariabel: Boten tildeler det oppdagede språket til

System.User.Language. - Dynamisk respons: Agenten fortsetter samtalen på det oppdagede språket, både ved å søke kunnskap og generere svar deretter.

Fordeler

- Personlig tilpasset opplevelse: Brukere interagerer på sitt foretrukne språk uten manuell konfigurasjon.

- Konsistent erfaring: Alle svar og kunnskapsinnhenting samsvarer med det oppdagede eller fastsatte språket.

- Skalerbar løsning: Støtter globale utrullinger med minimal konfigurasjon.

Tips

Se gjennom eksempelløsningen som demonstrerer hvordan man kan gjøre det mulig for Copilot Studio-agenter å automatisk oppdage brukerens talespråk og bytte til et av de maker-godkjente språkene for agenten: Auto-detect language for generative svar

Beste praksis for lokalisering

- Konfigurer støttede språk: Definer primær- og sekundærspråk for agenten din. Bruk lokaliseringsfiler (JSON eller ResX) for å gi oversettelser til prompts, meldinger og emner.

- Test flerspråklige scenarioer: Simuler brukerinteraksjoner på ulike språk for å sikre jevne overganger og nøyaktige svar.

- Bruk auto-oversettelse: Stol på Copilot Studios innebygde oversettelse for kunnskapssøk og svargenerering, men tilby tilpassede oversettelser for kritisk eller nyansert innhold.

- Overvåk og finjuster: Bruk analyser for å spore språkbruk og forbedre lokaliseringsdekningen over tid.

Copilot Studios agentspråktilnærminger:

- Separate agenter per språk.

- Enkeltspråklige agenter med forhåndsforfattede oversettelser.

- Sanntids flerspråklige agenter, som bruker oversettelsestjenester mellom bruker og agent.

Riktig tilnærming avhenger av bruk, hensyn til separasjon, skala, oppdateringsrytme og tilgjengelige ressurser.

Identifiserte tekniske utfordringer

Typiske utfordringer inkluderer å sikre at Azure CLU- og Copilot Studio-temaer holdes synkroniserte, håndtere tvetydige ytringer og skalere flerspråklige distribusjoner. Tidlig identifisering av disse hindringene lar deg planlegge avbøtende strategier, som fallback-konfigurasjoner, massetesting av triggerfraser eller relébaserte oversettelsestjenester.

Målet med språkforståelse er å sikre at hver agent kan tolke brukerens forespørsler nøyaktig, tilpasse seg ulike språk og situasjoner, og håndtere det uventede på en elegant måte. Dette målet skaper et solid grunnlag for å bygge pålitelige, engasjerende og effektive Copilot Studio-samtaler.