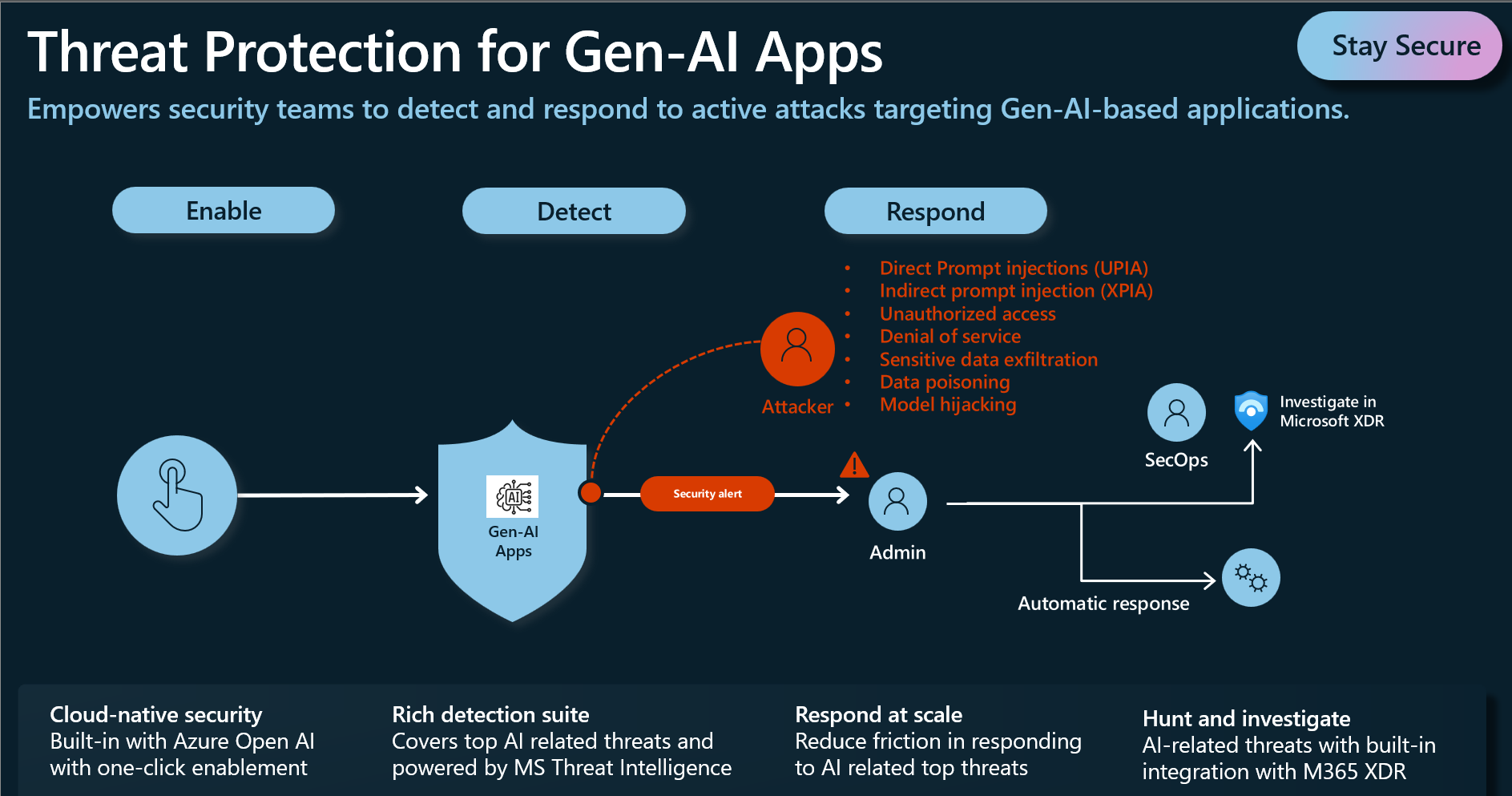

Overzicht - AI-bedreigingsbeveiliging

Bedreigingsbeveiliging voor AI-workloads in Microsoft Defender voor Cloud identificeert voortdurend bedreigingen voor generatieve AI-toepassingen in realtime en helpt bij het reactieproces voor beveiligingsproblemen die kunnen bestaan in generatieve AI-toepassingen.

Belangrijk

Bedreigingsbeveiliging voor AI-workloads is momenteel beschikbaar als preview-versie. Raadpleeg de Aanvullende voorwaarden voor Microsoft Azure-previews voor juridische voorwaarden die van toepassing zijn op Azure-functies die in bèta of preview zijn of die anders nog niet algemeen beschikbaar zijn.

ai-bedreigingsbeveiliging van Defender voor Cloud integreert met Azure AI Content Safety Prompt Shields en de bedreigingsinformatiesignalen van Microsoft om contextuele en bruikbare beveiligingswaarschuwingen te leveren die zijn gekoppeld aan een reeks bedreigingen, zoals lekken van gevoelige gegevens, gegevensvergiftiging, jailbreaking en diefstal van referenties.

Notitie

Bedreigingsbeveiliging voor AI-workloads is afhankelijk van azure OpenAI-inhoudsfiltering voor promptbasis geactiveerde waarschuwingen. Als u zich afmeldt voor triggerwaarschuwingen op basis van prompts en deze mogelijkheid hebt verwijderd, kan dit van invloed zijn op de mogelijkheid van Defender voor Cloud om dergelijke aanvallen te bewaken en te detecteren.

Defender XDR-integratie

Bedreigingsbeveiliging voor AI-workloads kan worden geïntegreerd met Defender XDR, waardoor beveiligingsteams waarschuwingen kunnen centraliseren voor AI-workloads in de Defender XDR-portal.

Beveiligingsteams kunnen waarschuwingen en incidenten van AI-workloads correleren in de Defender XDR-portal en inzicht krijgen in het volledige bereik van een aanval, waaronder schadelijke activiteiten die zijn gekoppeld aan hun generatieve AI-toepassingen vanuit het XDR-dashboard.

Registreren voor de beperkte openbare preview

Als u bedreigingsbeveiliging wilt gebruiken voor AI-workloads, moet u zich inschrijven in het beperkte openbare preview-programma door het registratieformulier in te vullen.

Gerelateerde inhoud

Feedback

Binnenkort beschikbaar: In de loop van 2024 zullen we GitHub-problemen geleidelijk uitfaseren als het feedbackmechanisme voor inhoud en deze vervangen door een nieuw feedbacksysteem. Zie voor meer informatie: https://aka.ms/ContentUserFeedback.

Feedback verzenden en weergeven voor