Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

De realtime hub wordt gebruikt voor het detecteren en beheren van uw streaminggegevens in Fabric. Het opnemen van streaminggegevens met de realtime hub is de eerste stap bij het naadloos integreren van uw gegevens in Fabric, waardoor analisten realtime inzichten uit de gegevens kunnen extraheren. De uitgebreide set beschikbare connectors zorgt ervoor dat u moeiteloos gegevens in Fabric kunt importeren, ongeacht uw streamingbron.

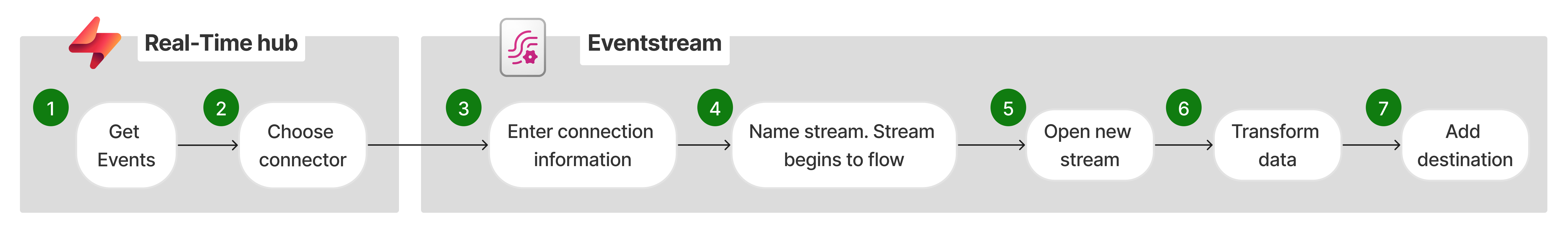

Deze gebruikersstroom laat zien hoe een data engineer gebeurtenissen van een groot aantal streamingbronnen kan laden en transformeren in de realtime hub.

Stappen

Blader naar de realtime hub en selecteer Evenementen ophalen.

De ondersteunde connectors worden weergegeven. Kies een connector op basis van waar uw streamingbron zich bevindt.

Geef verbindingen met de bron op, inclusief referenties.

Geef de stream een naam. Er wordt een nieuwe eventstream gemaakt en de gegevens worden binnengestroomd.

Zie Gebeurtenissen ophalen uit ondersteunde bronnen voor gedetailleerde informatie en stappen.

Open de zojuist gemaakte eventstream.

Definieer gegevensverwerkingsbewerkingen waarmee de streaminggegevens worden getransformeerd.

Voeg een bestemming toe aan de stream.

Zie Transformatiebewerkingen en Bestemming toevoegen en beheren voor gedetailleerde informatie en stappen.

Ondersteunde connectors

Microsoft-bronnen

| Bron | Beschrijving | Meer informatie |

|---|---|---|

| Azure Event Hubs | Een volledig beheerde realtime gegevensopnameservice. | Meer informatie |

| Azure Service Bus (voorvertoning) | Een berichtenservice voor betrouwbare communicatie. | Meer informatie |

| Azure IoT Hub | Een platform voor het beheren van IoT-apparaten en -gegevens. | Meer informatie |

| Azure SQL Database CDC | Databasewijzigingen vastleggen en streamen in realtime. | Meer informatie |

| Azure Database for PostgreSQL CDC | Streamen van wijzigingen uit PostgreSQL-databases. | Meer informatie |

| Azure Database for MySQL CDC | Stream wijzigingen uit MySQL-databases. | Meer informatie |

| Azure Cosmos DB CDC | Wijzigingen doorsturen vanuit Cosmos DB. | Meer informatie |

| Azure SQL Managed Instance CDC | Leg wijzigingen vast van SQL Managed Instances. | Meer informatie |

| SQL Server op VM DB CDC | Stream wijzigingen van SQL Server op VM's. | Meer informatie |

| Azure-gegevensverkenner | Analyseer grote hoeveelheden gegevens in realtime. | Meer informatie |

Externe bronnen

| Externe bron | Beschrijving | Meer informatie |

|---|---|---|

| Google Cloud Pub/Sub service voor berichtendistributie en -streaming | Een berichtenservice voor realtime gebeurtenisstreaming. | Meer informatie |

| Amazon Kinesis-gegevensstromen | Een platform voor realtime gegevensverwerking. | Meer informatie |

| Confluent Cloud Kafka | Een cloudeigen Kafka-service voor gebeurtenisstreaming. | Meer informatie |

| Apache Kafka (preview) | Een gedistribueerd gebeurtenisstreamingplatform. | Meer informatie |

| Amazon Managed Streaming voor Apache Kafka | Een beheerde Kafka-service voor streaming. | Meer informatie |

| MQTT | Een lichtgewicht berichtenprotocol voor IoT. | Meer informatie |

| Solace PubSub+ | Een geavanceerde gebeurtenbemiddelaar voor berichtenuitwisseling in real-time. | Meer informatie |

| Realtime weer | Een bron voor realtime weergegevens. | Meer informatie |

Discrete gebeurtenissen

| Bron van gebeurtenis | Beschrijving |

|---|---|

| Azure Blob Storage-gebeurtenissen | Meer informatie over het vastleggen en verwerken van gebeurtenissen uit Azure Blob Storage. |

| gebeurtenissen van Fabric Werkruimte-item | Begrijp hoe je kunt werken met gebeurtenissen uit Fabric Workspace Items. |

| Fabric OneLake-gebeurtenissen | Bekijk gebeurtenisafhandeling voor Fabric OneLake. |

| Fabric-taakgebeurtenissen | Fabric-taak gebeurtenissen effectief beheren en verwerken. |

Potentiële gebruikscases

Uw streaminggegevensbron bevindt zich in een Confluent Kafka-cluster en u wilt deze naar Fabric brengen. Met de ervaring 'GetEvents' in realtime-hub kunt u eenvoudig gegevens uit uw Confluent Kafka-cluster opnemen in Fabric.