GitHub Copilot Large Language Models (LLM's)

GitHub Copilot wordt mogelijk gemaakt door LLM's (Large Language Models) om u te helpen naadloos code te schrijven. In deze les richten we ons op het begrijpen van de integratie en impact van LLM's in GitHub Copilot. Laten we de volgende onderwerpen bekijken:

- Wat zijn LLM's?

- De rol van LLM's in GitHub Copilot en vragen

- LLM's verfijnen

- LoRA-afstemming

Wat zijn LLM's?

Grote taalmodellen (LLM's) zijn modellen voor kunstmatige intelligentie die zijn ontworpen en getraind om menselijke taal te begrijpen, genereren en manipuleren. Deze modellen zijn ingesleten met de mogelijkheid om een breed scala aan taken met betrekking tot tekst af te handelen, dankzij de uitgebreide hoeveelheid tekstgegevens waarop ze zijn getraind. Hier volgen enkele belangrijke aspecten die u moet begrijpen over LLM's:

Volume van trainingsgegevens

LLM's worden blootgesteld aan grote hoeveelheden tekst uit diverse bronnen. Deze blootstelling biedt hen een breed begrip van taal, context en complexiteit die betrokken zijn bij verschillende vormen van communicatie.

Contextueel begrip

Ze excelleren in het genereren van contextuele relevante en coherente tekst. Met hun vermogen om context te begrijpen, kunnen ze zinvolle bijdragen leveren, of het nu zinnen, alinea's of zelfs het genereren van hele documenten die contextueel apt zijn.

Machine learning en AI-integratie

LLM's zijn gebaseerd op machine learning- en kunstmatige intelligentieprincipes. Het zijn neurale netwerken met miljoenen of zelfs miljarden parameters die zijn afgestemd tijdens het trainingsproces om tekst effectief te begrijpen en te voorspellen.

Veelzijdigheid

Deze modellen zijn niet beperkt tot een specifiek type tekst of taal. Ze kunnen worden afgestemd en afgestemd op het uitvoeren van gespecialiseerde taken, waardoor ze zeer veelzijdig en toepasbaar zijn in verschillende domeinen en talen.

Rol van LLM's in GitHub Copilot en prompts

GitHub Copilot maakt gebruik van LLM's om contextbewuste codesuggesties te bieden. De LLM beschouwt niet alleen het huidige bestand, maar ook andere geopende bestanden en tabbladen in de IDE om nauwkeurige en relevante codevoltooiingen te genereren. Deze dynamische benadering zorgt voor op maat gemaakte suggesties, waardoor uw productiviteit wordt verbeterd.

LLM's verfijnen

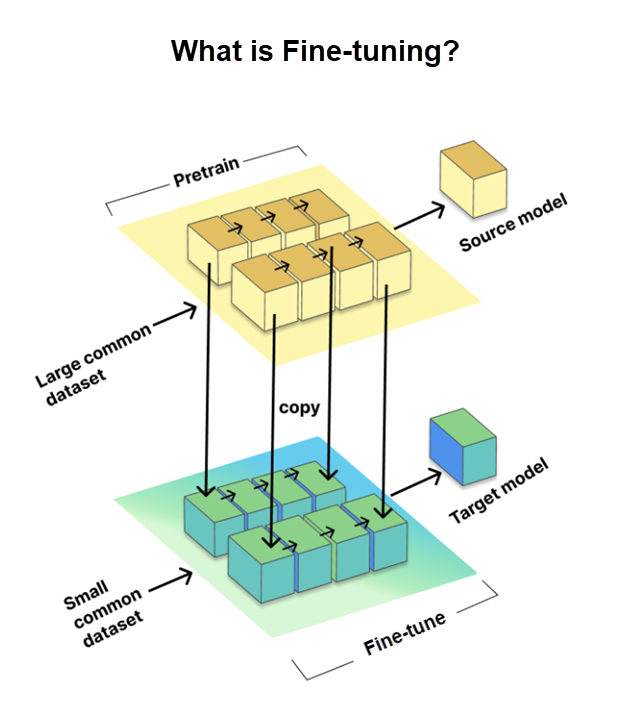

Fine-tuning is een kritiek proces waarmee we vooraf getrainde grote taalmodellen (LLM's) kunnen aanpassen voor specifieke taken of domeinen. Het betreft het trainen van het model op een kleinere, taakspecifieke gegevensset, ook wel de doelgegevensset genoemd, terwijl u de kennis en parameters gebruikt die zijn opgedaan uit een grote vooraf getrainde gegevensset, aangeduid als het bronmodel.

Fine-tuning is essentieel voor het aanpassen van LLM's voor specifieke taken, waardoor hun prestaties worden verbeterd. GitHub heeft het echter een stap verder gedaan met behulp van de methode voor het verfijnen van LoRA, die we hierna bespreken.

LoRA-afstemming

Traditionele volledige afstemming betekent dat alle onderdelen van een neuraal netwerk worden getraind, wat traag en sterk afhankelijk kan zijn van resources. Maar LoRA (Low-Rank Adaptation) fine-tuning is een slim alternatief. Het wordt gebruikt om grote vooraf getrainde taalmodellen (LLM's) beter te laten werken voor specifieke taken zonder dat alle training opnieuw hoeft te worden uitgevoerd.

Zo werkt LoRA:

- LoRA voegt kleinere trainbare onderdelen toe aan elke laag van het vooraf getrainde model, in plaats van alles te wijzigen.

- Het oorspronkelijke model blijft hetzelfde, wat tijd en resources bespaart.

Wat is geweldig aan LoRA:

- Het slaat andere aanpassingsmethoden op, zoals adapters en afstemming van voorvoegsels.

- Het is alsof je geweldige resultaten krijgt met minder bewegende onderdelen.

In eenvoudige termen gaat loRA-afstemming over slimmer werken, niet moeilijker, om LLM's beter te maken voor uw specifieke coderingsvereisten bij het gebruik van Copilot.