Modellen selecteren met behulp van benchmarks

Voordat u een model implementeert, wilt u weten hoe het presteert in verschillende dimensies. Modelbenchmarks bieden objectieve, meetbare gegevens om u te helpen modellen te vergelijken en weloverwogen selectiebeslissingen te nemen. De Microsoft Foundry-portal biedt uitgebreide benchmarkinghulpprogramma's die zijn ingedeeld in metrische gegevens over kwaliteit, veiligheid, kosten en prestaties.

Toegang tot modelbenchmarks

U kunt benchmarks op twee manieren verkennen in de Microsoft Foundry-portal:

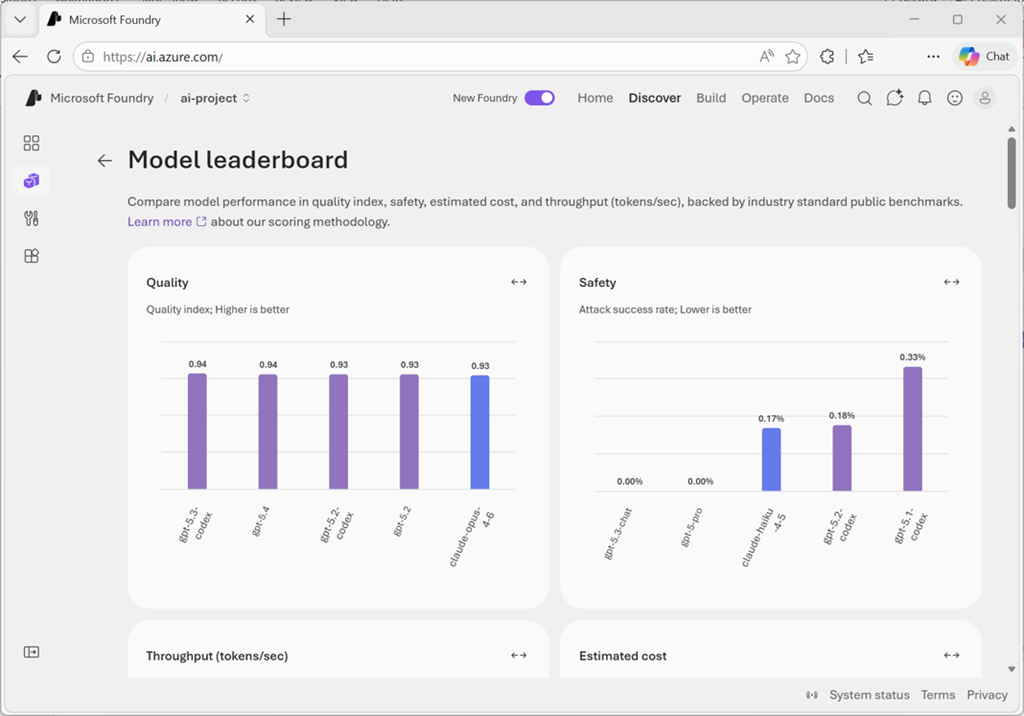

Bekijk in de modelcatalogus het scorebord Model om vergelijkende classificaties te zien voor alle beschikbare modellen. Deze weergave helpt u bij het identificeren van top presterende modellen voor specifieke metrische gegevens of scenario's. In het leaderboard worden de beste modellen weergegeven gerangschikt op kwaliteit, veiligheid, geschatte kosten en doorvoer.

Open de modelkaart voor gedetailleerde benchmarks voor een specifiek model en selecteer het tabblad Benchmarks . In deze weergave ziet u hoe het afzonderlijke model presteert voor verschillende metrische gegevens en gegevenssets, met vergelijkingsgrafieken die het ten opzichte van vergelijkbare modellen plaatsen.

Kwaliteitsbenchmarks

Kwaliteitsbenchmarks beoordelen hoe goed een model nauwkeurige, coherente en contextafhankelijke reacties genereert. Deze metrische gegevens maken gebruik van openbare gegevenssets en gestandaardiseerde evaluatiemethoden om consistentie te garanderen.

De kwaliteitsindex biedt een overzicht op hoog niveau door gemiddelde nauwkeurigheidsscores te berekenen voor meerdere benchmarkgegevenssets die redenering, kennis, vraagantwoorden, wiskundige mogelijkheden en coderingsvaardigheden meten. Indexwaarden van hogere kwaliteit geven een sterkere algehele prestaties aan voor algemene taaltaken.

Kwaliteitsbenchmarks maken gebruik van gegevenssets zoals:

- Arena-Hard - tegenwerkend beantwoording van vragen

- BIG-Bench Hard - redeneringsmogelijkheden

- GPQA - vragen over meerdere discipline op graduate-level

- HumanEval+ en MBPP+ - taken voor het genereren van code

- WISKUNDE - wiskundige redenering

- MMLU-Pro - algemene kennisbeoordeling

- IFEval - instructie volgen

Benchmarkscores zijn genormaliseerde indexen, variërend van nul tot één, waarbij hogere waarden duiden op betere prestaties.

Veiligheidsbenchmarks

Metrische veiligheidsgegevens zorgen ervoor dat modellen geen schadelijke, vooroordelen of ongepaste inhoud genereren. Deze benchmarks zijn van cruciaal belang voor toepassingen die worden blootgesteld aan eindgebruikers, met name in gereguleerde branches of klantgerichte scenario's.

Microsoft Foundry evalueert modellen in meerdere veiligheidsdimensies:

Detectie van schadelijk gedrag maakt gebruik van de HarmBench-benchmark om te meten hoe goed modellen bestand zijn tegen het genereren van onveilige inhoud. De evaluatie berekent het aantal geslaagde aanvallen (ASR), waarbij lagere waarden duiden op veiligere, robuustere modellen. HarmBench test drie functionele gebieden:

- Standaard schadelijk gedrag - cybercriminaliteit, illegale activiteiten, algemene schade

- Contextueel schadelijk gedrag - onjuiste informatie, intimidatie, pesten

- Schendingen van het auteursrecht - het reproduceren van auteursrechtelijk beschermd materiaal

Detectie van giftige inhoud maakt gebruik van de ToxiGen-gegevensset om te meten hoe goed modellen adversarial en impliciete haatspraak identificeren. Hogere F1-scores geven betere detectieprestaties aan voor verwijzingen naar minderheidsgroepen.

Gevoelige domeinkennis maakt gebruik van de WMDP-benchmark (Wapens van Massavernietigingsproxy) om modelkennis te meten in bioveiligheid, cyberbeveiliging en chemische beveiliging. Hogere WMDP-scores geven meer kennis van potentieel gevaarlijke mogelijkheden aan.

Veiligheidsscores helpen u inzicht te krijgen in de robuustheid van modellen, met name belangrijk voor klantgerichte toepassingen waarbij schadelijke uitvoer aanzienlijke zorgen vormt.

Kostenmaatstaven

Inzicht in de financiële impact van het modelgebruik helpt u om de kwaliteitsvereisten te verdelen met budgetbeperkingen. Kostenbenchmarks in Microsoft Foundry geven prijzen weer voor serverloze API-implementaties en Azure OpenAI-modellen.

Kosten per invoertokens tonen de prijs voor het verwerken van 1 miljoen invoertokens (de tekst die u naar het model verzendt).

Kosten per uitvoertokens geven de prijs aan voor het genereren van 1 miljoen uitvoertokens (de tekst die het model produceert).

Geschatte kosten combineren invoer- en uitvoerkosten met behulp van een typische verhouding van 3:1 (drie invoertokens voor elk uitvoertoken), zodat u één getal kunt vergelijken. Lagere waarden geven meer rendabele modellen aan.

Met kostenbenchmarks kunt u modellen identificeren die de kwaliteit leveren die u nodig hebt tegen een prijspunt dat past bij de gebruikspatronen en het budget van uw toepassing.

Prestatiebenchmarks

Metrische prestatiegegevens meten hoe snel en efficiënt modellen reageren op aanvragen. Deze benchmarks zijn belangrijk voor realtime toepassingen waarbij gebruikerservaring afhankelijk is van reactiesnelheid.

Latentiemetingen zijn onder andere:

- Gemiddelde latentie - gemiddelde tijd in seconden om een aanvraag te verwerken

- Latentie P50 (mediaan) - 50% aanvragen sneller worden voltooid dan deze keer

- Latentie P90 - 90% aanvragen sneller worden voltooid dan deze keer

- Latentie P95 - 95% van de verzoeken wordt sneller voltooid dan deze tijd

- Latentie P99 - 99% aanvragen sneller worden voltooid dan deze keer

- Tijd tot eerste token (TTFT): tijd totdat het eerste token binnenkomt bij het gebruik van streaming

Doorvoermetingen zijn onder andere:

- Gegenereerde tokens per seconde (GTPS) - uitvoertokens die per seconde worden gegenereerd

- Totaal aantal tokens per seconde (TTPS) - gecombineerde invoer- en uitvoertokens verwerkt per seconde

- Tijd tussen tokens - interval tussen het ontvangen van opeenvolgende tokens

Het leaderboard bevat een overzicht van de prestaties met behulp van gemiddelde tijd tot het eerste token (lager is beter) en gemiddelde gegenereerde tokens per seconde (hoger is beter). Modellen met hoge doorvoer en lage latentie bieden betere gebruikerservaringen in interactieve toepassingen. Voor batchverwerkingstaken waarbij snelheid lager is dan kosten, kunt u andere factoren prioriteren.

Leaderboards en vergelijkingsfuncties gebruiken

Met het leaderboard van het model kunt u de belangrijkste modellen voor specifieke metrische gegevens bekijken. U kunt sorteren op kwaliteit, veiligheid, geschatte kosten en doorvoer om modellen te identificeren die het beste aan uw vereisten voldoen.

Scenario leaderboards helpen u modellen te vinden die zijn geoptimaliseerd voor specifieke gebruiksvoorbeelden, zoals redenering, coderen, wiskunde, vragen beantwoorden of grondheid. Als uw toepassing is toegewezen aan een bepaald scenario, begint u met het relevante leaderboard voor scenario's in plaats van alleen te vertrouwen op de algehele kwaliteitsindex.

In trade-off-grafieken worden twee metrische gegevens tegelijk weergegeven, zoals kwaliteit versus kosten of kwaliteit versus doorvoer. Met deze visualisaties kunt u de optimale balans vinden voor uw vereisten. Gebruik de vervolgkeuzelijst om de kwaliteit te vergelijken met kosten, doorvoer of veiligheid. Modellen die zich dichter bij de rechterbovenhoek van de grafiek bevinden, presteren goed op beide metrische gegevens. Een model dat iets minder nauwkeurig is, maar aanzienlijk sneller of goedkoper is, kan uw behoeften beter dienen.

Met een vergelijking naast elkaar kunt u twee of drie modellen selecteren in het leaderboard en deze vergelijken in meerdere dimensies:

- Prestatiebenchmarks (kwaliteit, veiligheid, doorvoer)

- Modeldetails (contextvenster, trainingsgegevens, ondersteunde talen)

- Ondersteunde eindpunten (implementatieopties)

- Functieondersteuning (functie aanroepen, gestructureerde uitvoer, visie)

Selecteer modellen door selectievakjes naast hun namen in te schakelen en kies Vergelijken om de gedetailleerde vergelijkingsweergave te openen.