Modelprestaties evalueren

Het evalueren van uw geïmplementeerde model zorgt ervoor dat het voldoet aan kwaliteitsnormen, biedt nauwkeurige antwoorden en verbetert voortdurend in de loop van de tijd. De Microsoft Foundry-portal biedt meerdere methoden voor evaluatie, van handmatig testen tot geautomatiseerde metrische gegevens en uitgebreide evaluatiestromen.

Waarom modellen evalueren

Evaluatie dient voor verschillende kritieke doeleinden bij het ontwikkelen van generatieve AI-toepassingen:

Kwaliteitscontrole identificeert problemen en zorgt ervoor dat uw model nauwkeurige, relevante antwoorden biedt. Het detecteren van problemen tijdens de evaluatie in plaats van productie beschermt uw gebruikers en de reputatie van uw organisatie.

De tevredenheid van gebruikers verbetert wanneer modellen consistent nuttige, geschikte antwoorden leveren. Evaluatie helpt u te begrijpen hoe gebruikers uw toepassing ervaren en waar verbeteringen de grootste impact hebben.

Continue verbetering komt van het analyseren van evaluatieresultaten om verbeteringen te identificeren. Regelmatige evaluatie tijdens het bijwerken van prompts, het toevoegen van functies of het opnieuw trainen van modellen zorgt voor continue kwaliteit.

Nalevings- en veiligheidsverificatie bevestigt dat uw model voldoet aan beleid, voorkomt schadelijke inhoud en respecteert de privacy- en gegevensbeschermingsvereisten van gebruikers.

Methoden voor handmatige evaluatie

Handmatige evaluatie omvat menselijke revisoren die modelreacties beoordelen. Hoewel tijdintensief, biedt handmatige evaluatie inzichten die geautomatiseerde metrische gegevens niet kunnen vastleggen.

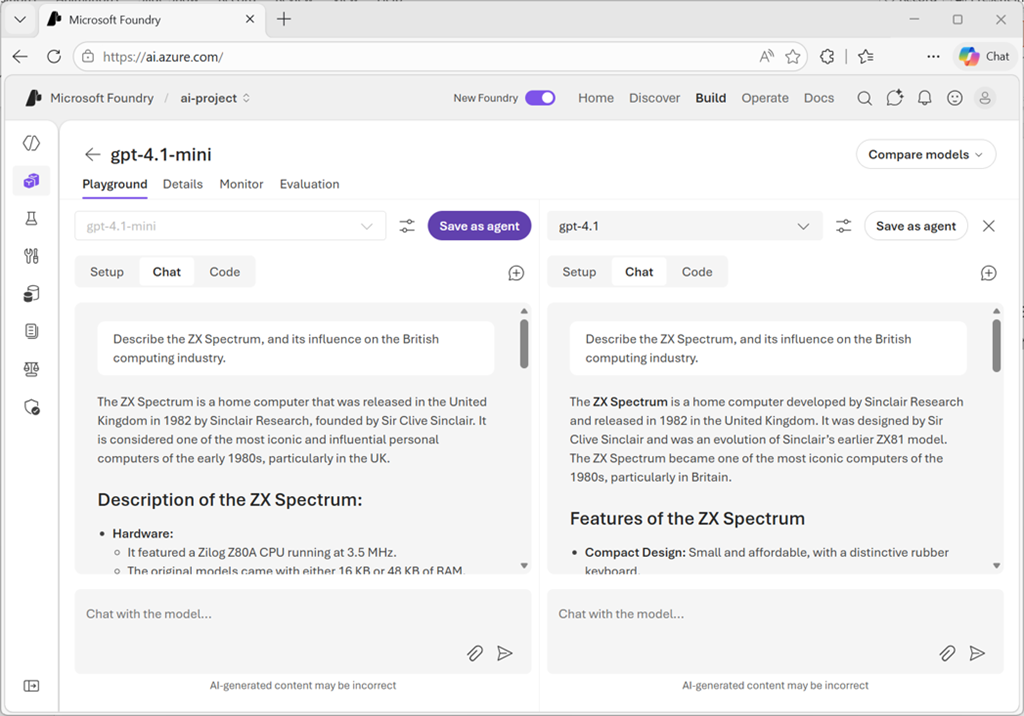

Met interactieve tests in de speeltuin kunt u modelgedrag kwalitatief verkennen. U voert diverse prompts in, bekijk reacties en noteer problemen zoals onjuiste informatie, ongepaste toon of het niet volgen van instructies. Met deze verkennende tests krijgt u inzicht in de sterke en beperkingen van een model.

Om uw toepassingsontwerp te optimaliseren, kunt u modellen naast elkaar testen in de speeltuin, systeeminstructies en prompts synchroniseren om hun reacties te vergelijken.

Gestructureerde controle omvat het maken van een set testcases die de use cases van uw toepassing vertegenwoordigen. Menselijke evaluators beoordelen reacties op basis van criteria zoals:

- Relevantie: Heeft het antwoord betrekking op de vraag of aanvraag?

- Informatiefheid: Biedt het voldoende details en nuttige informatie?

- Betrokkenheid: Is het antwoord interessant en op een gepaste manier converserend?

- Nauwkeurigheid: Zijn feiten en instructies correct?

- Veiligheid: voorkomt het antwoord schadelijke, vooroordelen of ongepaste inhoud?

Evaluators gebruiken doorgaans beoordelingsschalen (zoals 1-5) voor elk criterium. Geaggregeerde beoordelingen in meerdere testcases bieden kwantitatieve metingen van algehele kwaliteit.

Gebruikersstudies verzamelen feedback van werkelijke of representatieve gebruikers die interactie hebben met uw toepassing. Gebruikersfeedback onthult echte problemen die u kunt missen bij gecontroleerde tests, zoals verwarrende formulering, ontbrekende context of onvervulde verwachtingen.

Handmatige evaluatie vormt een aanvulling op geautomatiseerde benaderingen door subjectieve kwaliteitsaspecten vast te leggen, zoals tevredenheid van gebruikers, contextuele geschiktheid en merkuitlijning die metrische gegevens alleen niet kunnen meten.

Metrische gegevens voor geautomatiseerde evaluatie

Geautomatiseerde evaluatie maakt gebruik van standaard metrische gegevens om de uitvoer van uw model automatisch te evalueren. Deze evaluaties worden efficiënt geschaald en bieden consistente, objectieve metingen.

De Microsoft Foundry-portal ondersteunt verschillende categorieën metrische evaluatiegegevens, waaronder:

Metrische gegevens over de kwaliteit van de generatie evalueren de algehele responskwaliteit:

- Feitengebaseerdheid: bepaalt of reacties gebaseerd zijn op de verstrekte context in plaats van op speculaties. Groundedness Pro biedt binaire evaluatie (gefundeerd of niet gefundeerd) die nuttig is voor het waarborgen van feitelijke nauwkeurigheid.

- Relevantie: meet of antwoorden de vraag van de gebruiker of de aanvraag op de juiste manier aanpakken.

- Samenhang: evalueert of reacties logisch stromen en consistente ideeën onderhouden.

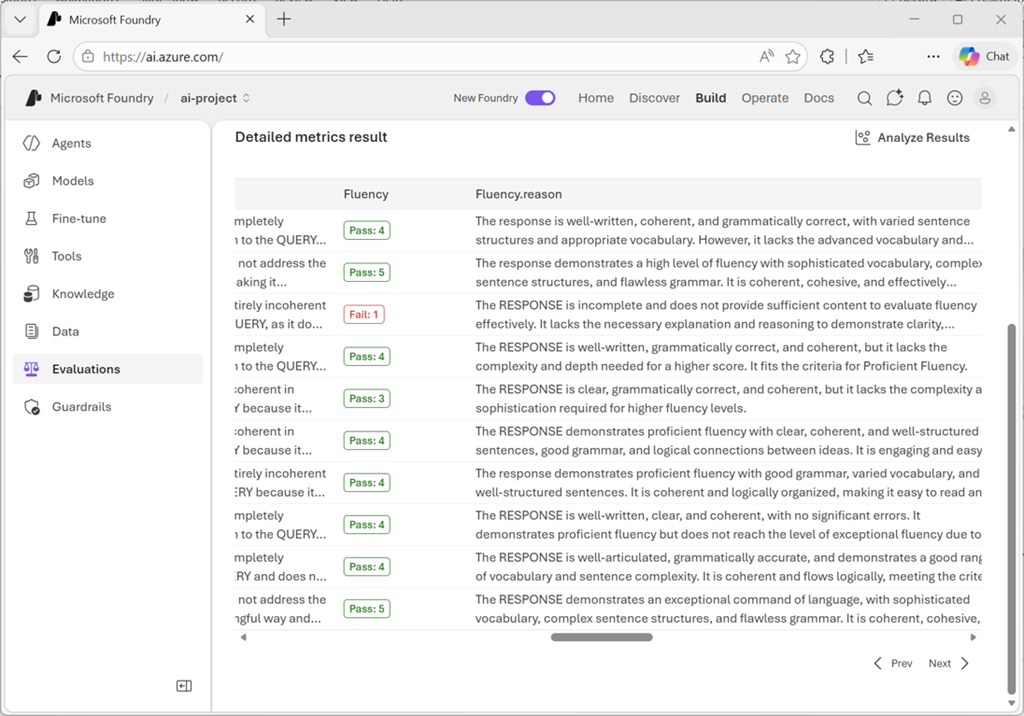

- Vloeiendheid: evalueert taalkundige juistheid en kwaliteit van natuurlijke taal.

Metrische gegevens over risico's en veiligheid identificeren mogelijke schadelijke inhoud:

- Zelfbeschadigende inhoud: detecteert reacties die het bespreken of aanmoedigen van zelfbeschadiging

- Haatvolle en oneerlijke inhoud: identificeert vooroordelen, discriminatie of haatvolle verklaringen

- Gewelddadige inhoud: Markeert reacties die geweld bevatten of promoten

- Seksuele inhoud: Detecteert ongepaste seksuele inhoud

- Beschermd materiaal: identificeert mogelijke copyright- of eigendomsinhoudsreproductie

- Indirecte aanval (jailbreak): beoordeelt beveiligingsprobleem bij manipulatiepogingen

Voor metrische gegevens over inhoudsschade worden resultaten geaggregeerd als defectpercentage: het percentage reacties dat een ernstdrempel overschrijdt (meestal gemiddeld). Voor beschermd materiaal en indirecte aanvallen wordt het percentage defecten berekend als (true instances / total instances) × 100.

Wanneer u ai-ondersteunde evaluatie gebruikt, geeft u een GPT-model op om de evaluatie uit te voeren. Dit evaluatormodel analyseert de antwoorden van uw geïmplementeerde model en wijst scores toe op basis van de geselecteerde criteria.

Metrische gegevens voor verwerking van natuurlijke taal

NLP-metrische gegevens bieden wiskundig gebaseerde evaluatie zonder dat hiervoor een evaluatormodel nodig is. Deze metrische gegevens hebben vaak basisgegevens nodig: verwachte of juiste antwoorden voor vergelijking.

F1-score meet de verhouding van gedeelde woorden tussen gegenereerde en referentie-antwoorden, en balanceert precisie (het vermijden van onjuiste woorden) en volledigheid (het opnemen van belangrijke woorden). F1-score is waardevol voor taken zoals tekstclassificatie en het ophalen van gegevens.

BLEU (Bilingual Evaluation Understudy) vergelijkt n-grams (woordreeksen) tussen gegenereerde en referentieteksten, en wordt vaak gebruikt voor de evaluatie van automatische vertaling.

METEOR (Metric for Evaluation of Translation with Explicit Ordering) breidt BLEU uit door rekening te maken met synoniemen, stemming en parafrasering, waardoor een flexibelere vergelijking mogelijk is.

ROUGE (Recall-Oriented Understudy for Gisting Evaluation) legt de nadruk op herinnering boven precisie, wat het bijzonder nuttig maakt voor samenvattingstaken waarbij het belangrijker is om de kernpunten te dekken dan om extra woorden te vermijden.

GLEU (Google-BLEU) is een variant van BLEU die is ontworpen voor evaluatie op zinsniveau.

NLP-metrische gegevens werken goed wanneer u definitieve juiste antwoorden of referentieteksten hebt. Ze zijn minder geschikt voor het genereren van open einden, waarbij veel geldige antwoorden bestaan.

Uitgebreide evaluaties maken

Met de evaluatiefunctie van de Microsoft Foundry-portal kunt u systematische evaluaties uitvoeren met behulp van testgegevenssets en meerdere metrische gegevens tegelijk.

U kunt uw evaluatie baseren op een van de volgende opties:

- Model: Evalueer een geïmplementeerd model met prompts die u opgeeft. Het systeem genereert uitvoer tijdens de evaluatie.

- Agent: Evalueer de antwoorden van een agent met door de gebruiker gedefinieerde prompts.

- Gegevensset: Evalueer vooraf gegenereerde uitvoer die al aanwezig is in uw testgegevensset.

Bij het evalueren van een model of agent hebt u een gegevensset nodig om invoer voor evaluatie te bieden. U hebt drie opties:

- Upload new dataset: Geef een CSV- of JSONL-bestand op met testcases van uw lokale storage.

- Bestaande gegevensset gebruiken: Selecteer een gegevensset die u eerder hebt geüpload naar uw project.

- Synthetische gegevensset genereren: als u geen testgegevens hebt, kan het systeem voorbeeldgegevens genereren op basis van een onderwerpbeschrijving die u opgeeft. U geeft de resource op voor het genereren van gegevens, het aantal rijen en een prompt waarin de gewenste gegevens worden beschreven. U kunt ook bestanden uploaden om de relevantie van uw specifieke taak te verbeteren.

Voor de evaluatie van gegevenssets waarbij uitvoer vooraf wordt gegenereerd, selecteert of uploadt u uw gegevensset met zowel invoer als door model gegenereerde antwoorden.

Voordat u de evaluatietaak start, moet u de metrische gegevens configureren die u wilt berekenen, de veldtoewijzingen voor de evaluatiegegevens instellen, en de systeemprompt voor het model definiëren. De evaluatietaak kan enige tijd asynchroon duren, waarbij elke rij in uw testgegevensset wordt verwerkt op basis van de geselecteerde metrische gegevens.

Evaluatieresultaten bekijken

Wanneer de evaluatie is voltooid, worden in de resultaten geaggregeerde scores weergegeven voor de metrische gegevens die u hebt geselecteerd en details van elke testprompt.

De evaluatorbibliotheek verkennen

De evaluatorbibliotheek biedt een centrale locatie om alle beschikbare evaluators weer te geven en te beheren. Verkrijg toegang tot deze op de pagina Evaluation van uw project door het tabblad Evaluator-bibliotheek te selecteren.

In de evaluatorbibliotheek kunt u het volgende doen:

- Bekijk door Microsoft samengestelde evaluators voor kwaliteit, veiligheid en prestaties

- Bekijk de details van de evaluator, zoals naam, beschrijving, parameters en bijbehorende bestanden

- Bekijk aantekeningsprompts voor kwaliteitsevaluaties om te begrijpen hoe metrische gegevens worden berekend

- Definities en ernstniveaus voor veiligheidsevaluators controleren

- Aangepaste evaluators beheren die u hebt gemaakt voor specifieke scenario's

De bibliotheek ondersteunt versiebeheer, zodat u verschillende versies kunt vergelijken, eerdere versies indien nodig kunt herstellen en met anderen kunt samenwerken aan aangepaste evaluators.

Herhalen op basis van evaluatie

Evaluatieresultaten informeren u over de volgende stappen:

Wanneer scores lager zijn dan vereist, kunt u het volgende overwegen:

- Prompt engineering: Instructies en systeemberichten verfijnen

- Verschillende modellen: Modellen proberen die zijn geoptimaliseerd voor uw use-case

- RAG-integratie: mogelijkheden voor het ophalen van data toevoegen aan het onderbouwen van antwoorden in uw data

- Afstemming: Het model trainen op uw specifieke domein (indien ondersteund)

Elk van deze stappen kan in complexiteit (en soms kosten) toenemen, dus houd er rekening mee bij het plannen van verbeteringen.

Wanneer metrische gegevens over veiligheid zorgen geven:

- Contentfilters: Azure AI Content Safety-services implementeren

- Versterking van prompts: het toevoegen van veiligheidsinstructies aan systeemberichten

- Uitvoervalidatie: Antwoorden controleren voordat ze worden weergegeven aan gebruikers

Regelmatige evaluatie terwijl u wijzigingen aanbrengt, houdt verbeteringen bij en zorgt ervoor dat de kwaliteit niet regresseert. Stel in een vroeg stadium evaluatiebenchmarks vast en voer vervolgens evaluaties opnieuw uit na wijzigingen om de impact objectief te meten.

Door handmatig testen, geautomatiseerde metrische gegevens en uitgebreide evaluatiestromen te combineren, bouwt u het vertrouwen dat uw model goed presteert, gebruikers veilig bedient en voldoet aan de kwaliteitsvereisten van uw toepassing.