Aparat głębokości zestawu Azure Kinect DK

Na tej stronie opisano sposób używania aparatu głębi w zestawie Azure Kinect DK. Kamera głębi jest drugą z dwóch kamer. Jak opisano w poprzednich sekcjach, drugi aparat jest aparatem RGB.

Zasady operacyjne

Aparat głębi zestawu Azure Kinect DK implementuje zasadę Czasu lotu (ToF) modulowanej amplitudy (AMCW). Kamera rzutowała oświetlenie modulowane w spektrum zbliżeniowym (NIR) na scenę. Następnie rejestruje pośredni pomiar czasu, w jaki zajmuje światło, aby podróżować z kamery do sceny i z powrotem.

Te pomiary są przetwarzane w celu wygenerowania mapy głębokości. Mapa głębokości jest zestawem wartości współrzędnych Z dla każdego piksela obrazu mierzonego w jednostkach milimetrów.

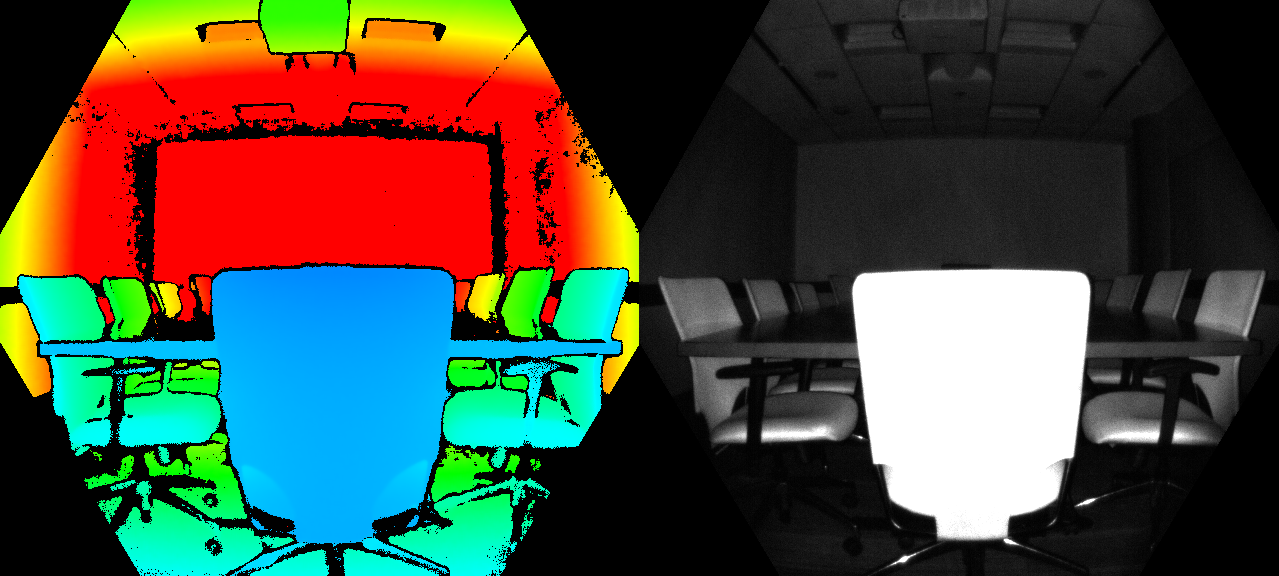

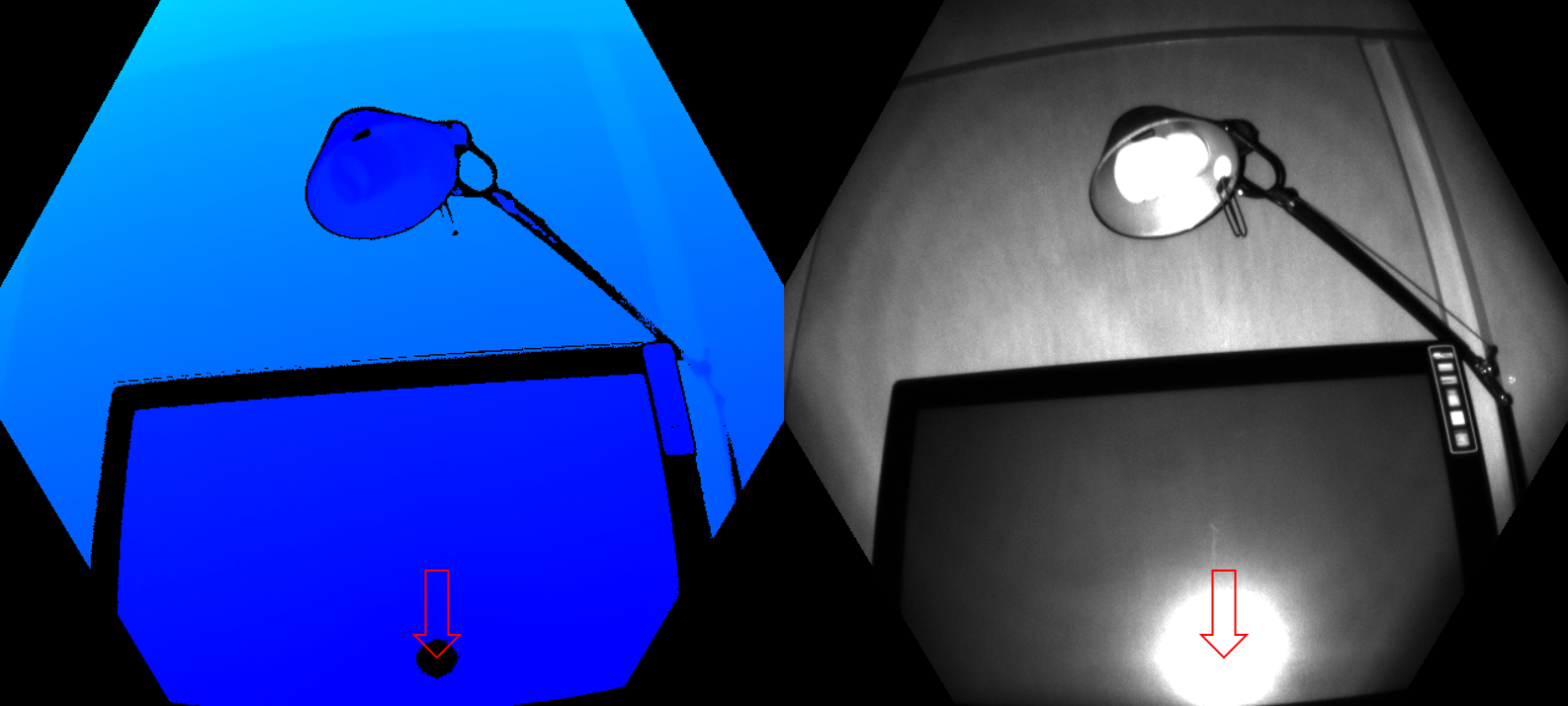

Wraz z mapą głębokości uzyskujemy również tzw. czysty odczyt środowiska IR. Wartość pikseli w czystym odczytywaniu środowiska IR jest proporcjonalna do ilości światła zwróconego ze sceny. Obraz wygląda podobnie do zwykłego obrazu środowiska IR. Na poniższej ilustracji przedstawiono przykładową mapę głębokości (po lewej) i odpowiedni obraz czystego środowiska IR (po prawej).

Najważniejsze funkcje

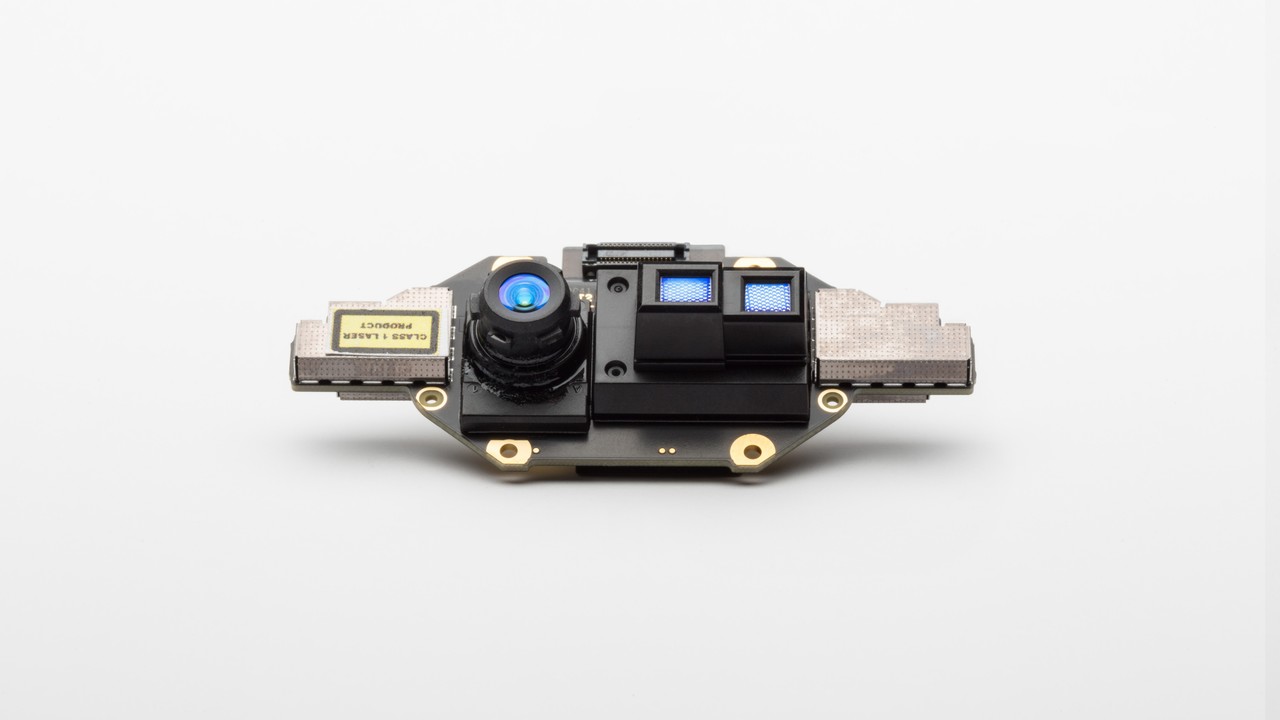

Cechy techniczne kamery głębokości obejmują:

- Mikroukład obrazu ToF o rozdzielczości 1-pikselowej z zaawansowaną technologią pikseli umożliwiającą wyższe częstotliwości modulacji i precyzję głębokości.

- Dwie diody laserowe NIR umożliwiające tryby głębokości zbliżone do szerokiego pola widzenia (FoV).

- Najmniejszy piksel ToF na świecie, na 3,5μm o 3,5μm.

- Automatyczne wybieranie przyrostu pikseli, dzięki czemu duży zakres dynamiczny pozwala na dokładne przechwycenie blisko i daleko obiektów.

- Globalna migawka, która pozwala zwiększyć wydajność światła słonecznego.

- Metoda obliczania głębokości wielofazowej, która umożliwia niezawodną dokładność nawet w przypadku zmiany układu, lasera i zasilania.

- Niskie systematyczne i losowe błędy.

Kamera głębinowa przesyła nieprzetworzone modulowane obrazy IR do komputera hosta. Na komputerze oprogramowanie z przyspieszoną głębią procesora GPU konwertuje nieprzetworzony sygnał na mapy głębokości. Kamera głębinowa obsługuje kilka trybów. Wąskie pola widoku (FoV) tryby są idealne dla scen o mniejszych zakresach w wymiarach X i Y, ale większych zakresów w wymiarze Z. Jeśli scena ma duże zakresy X i Y, ale mniejsze zakresy Z, szerokie tryby FoV są lepiej dopasowane.

Aparat głębi obsługuje tryby kwantowania 2x2 , aby rozszerzyć zakres Z w porównaniu do odpowiednich trybów bez powiązania. Kwantowanie odbywa się kosztem obniżenia rozdzielczości obrazu. Wszystkie tryby mogą być uruchamiane z maksymalnie 30 ramkami na sekundę (fps) z wyjątkiem trybu 1 mp (MP), który działa z maksymalną szybkością klatek wynoszącą 15 klatek na sekundę. Kamera głębina zapewnia również pasywny tryb IR. W tym trybie reflektory w aparacie nie są aktywne i obserwuje się tylko oświetlenie otoczenia.

Wydajność aparatu

Wydajność aparatu jest mierzona jako systematyczne i losowe błędy.

Błąd systematyczny

Systematyczny błąd jest definiowany jako różnica między zmierzoną głębokością po usunięciu szumu a prawidłową głębokością (prawda ziemi). Obliczamy średnią czasową dla wielu ram statycznej sceny, aby wyeliminować jak najwięcej szumów głębokości. Dokładniej mówiąc, systematyczny błąd jest definiowany jako:

Gdzie dt oznacza głębokość miary w czasie t, N jest liczbą ramek używanych w procedurze uśredniania i dgt jest głębokość prawdy ziemi.

Systematyczna specyfikacja błędu aparatu głębi wyklucza interferencję wielościeżkową (MPI). MpI jest wtedy, gdy jeden piksel czujnika integruje światło odbite przez więcej niż jeden obiekt. MpI jest częściowo złagodzony w naszej kamerze głębi przy użyciu wyższych częstotliwości modulacji, wraz z unieważnieniem głębokości, które wprowadzimy później.

Losowy błąd

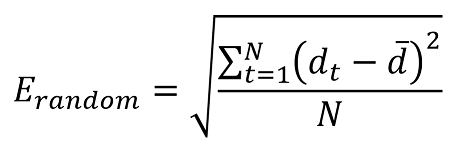

Załóżmy, że zrobimy 100 obrazów tego samego obiektu bez przenoszenia aparatu. Głębokość obiektu będzie nieco inna w każdym z 100 obrazów. Ta różnica jest spowodowana szumem strzału. Szum strzału to liczba fotonów uderzających w czujnik różni się w zależności od losowego współczynnika w czasie. Ten losowy błąd na scenie statycznej definiujemy jako odchylenie standardowe głębokości w czasie obliczone jako:

Gdzie N oznacza liczbę pomiarów głębokości, dt reprezentuje pomiar głębokości w czasie t i d oznacza wartość średnią obliczoną na wszystkich pomiarach głębokości dt.

Unieważnienie

W niektórych sytuacjach aparat głębokości może nie dostarczać prawidłowych wartości dla niektórych pikseli. W takich sytuacjach piksele głębokości są unieważniane. Nieprawidłowe piksele są wskazywane przez wartość głębokości równą 0. Przyczyny braku możliwości wygenerowania prawidłowych wartości przez aparat głębokości obejmują:

- Poza aktywną maską oświetlenia ŚRODOWISKA IR

- Sygnał nasyconego środowiska IR

- Sygnał niskiego środowiska IR

- Odfiltrowywanie wartości odstających

- Interferencja wielu ścieżek

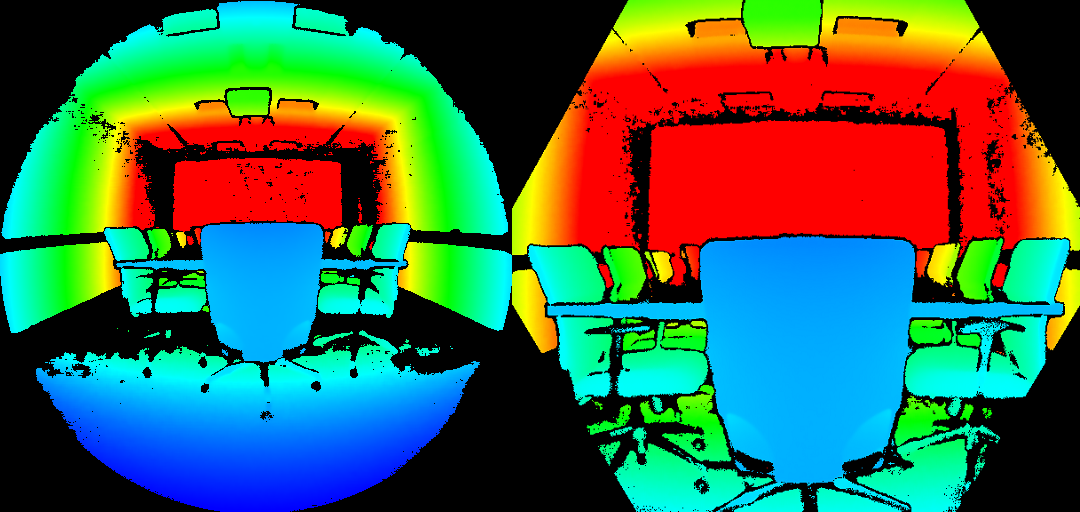

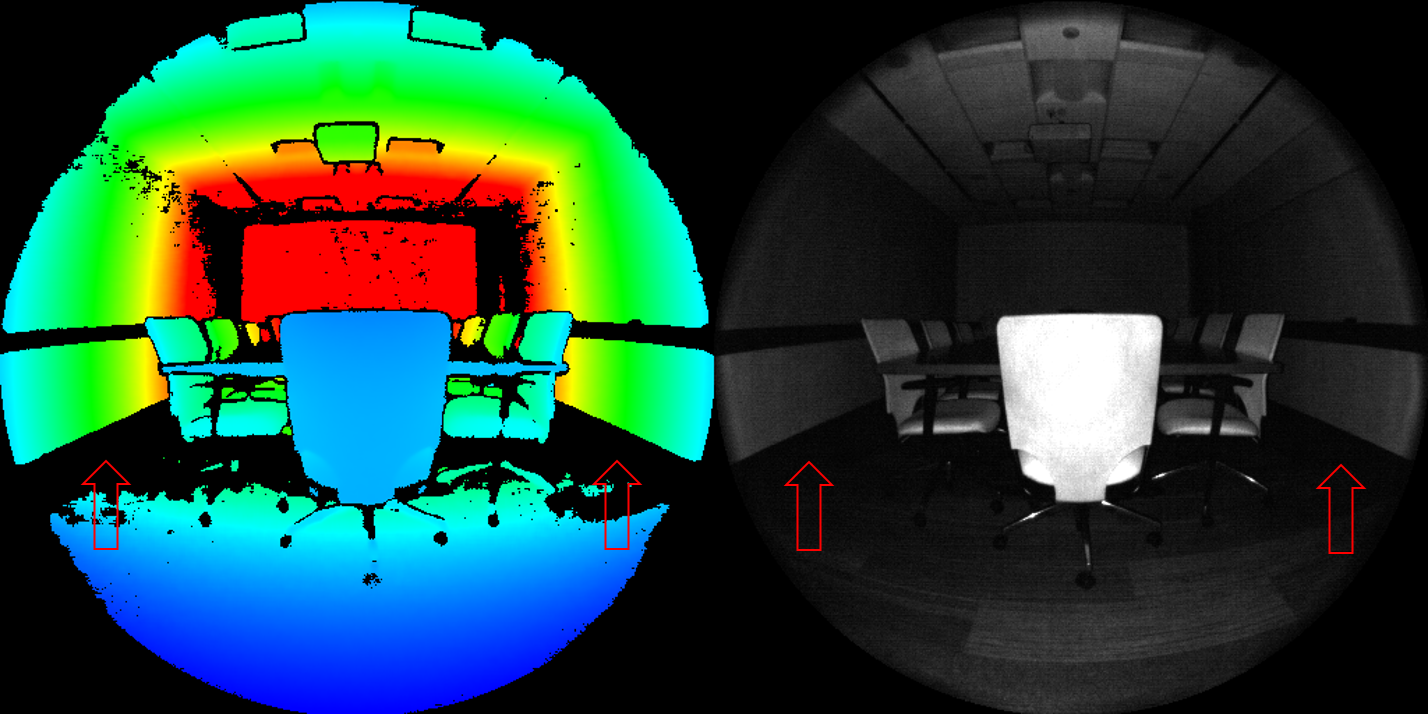

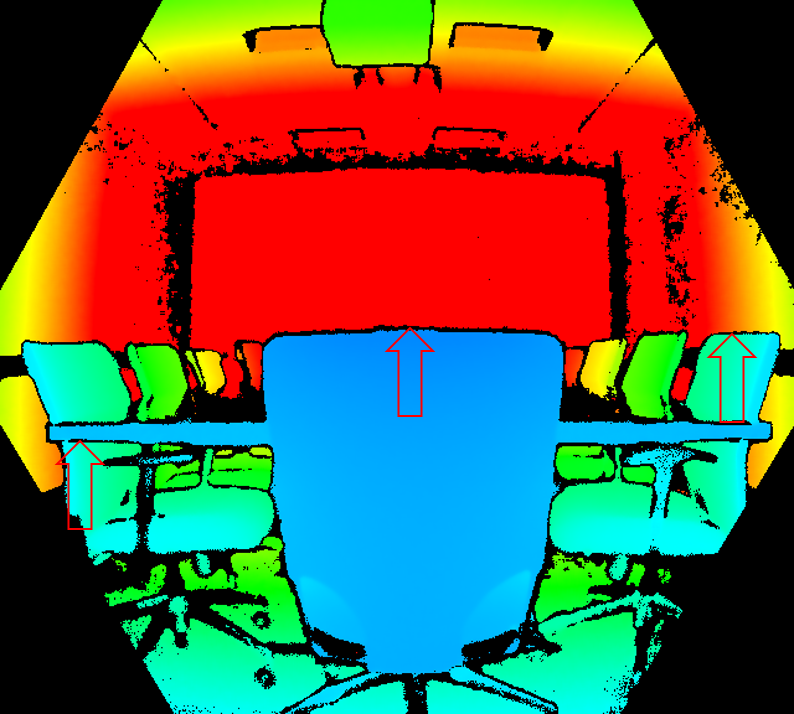

Maska oświetleniowa

Piksele są unieważniane, gdy znajdują się poza aktywną maską oświetlenia IR. Nie zalecamy używania sygnału takich pikseli do głębokości obliczeniowej. Na poniższej ilustracji przedstawiono przykład unieważnienia przez maskę oświetlenia. Unieważnione piksele to piksele koloru czarnego poza okręgiem w trybach FoV (po lewej) i sześciokąt w wąskich trybach FoV (po prawej).

Siła sygnału

Piksele są unieważniane, gdy zawierają nasycony sygnał IR. Gdy piksele są nasycone, informacje o fazie są tracone. Na poniższej ilustracji przedstawiono przykład unieważnienia przez nasycony sygnał IR. Zobacz strzałki wskazywane na przykładowe piksele zarówno w głębi, jak i na obrazach IR.

Unieważnienie może również wystąpić, gdy sygnał IR nie jest wystarczająco silny, aby wygenerować głębokość. Na poniższej ilustracji przedstawiono przykład unieważnienia przez sygnał niskiego środowiska IR. Zobacz strzałki wskazywane na przykładowe piksele zarówno w głębi, jak i na obrazach IR.

Niejednoznaczna głębokość

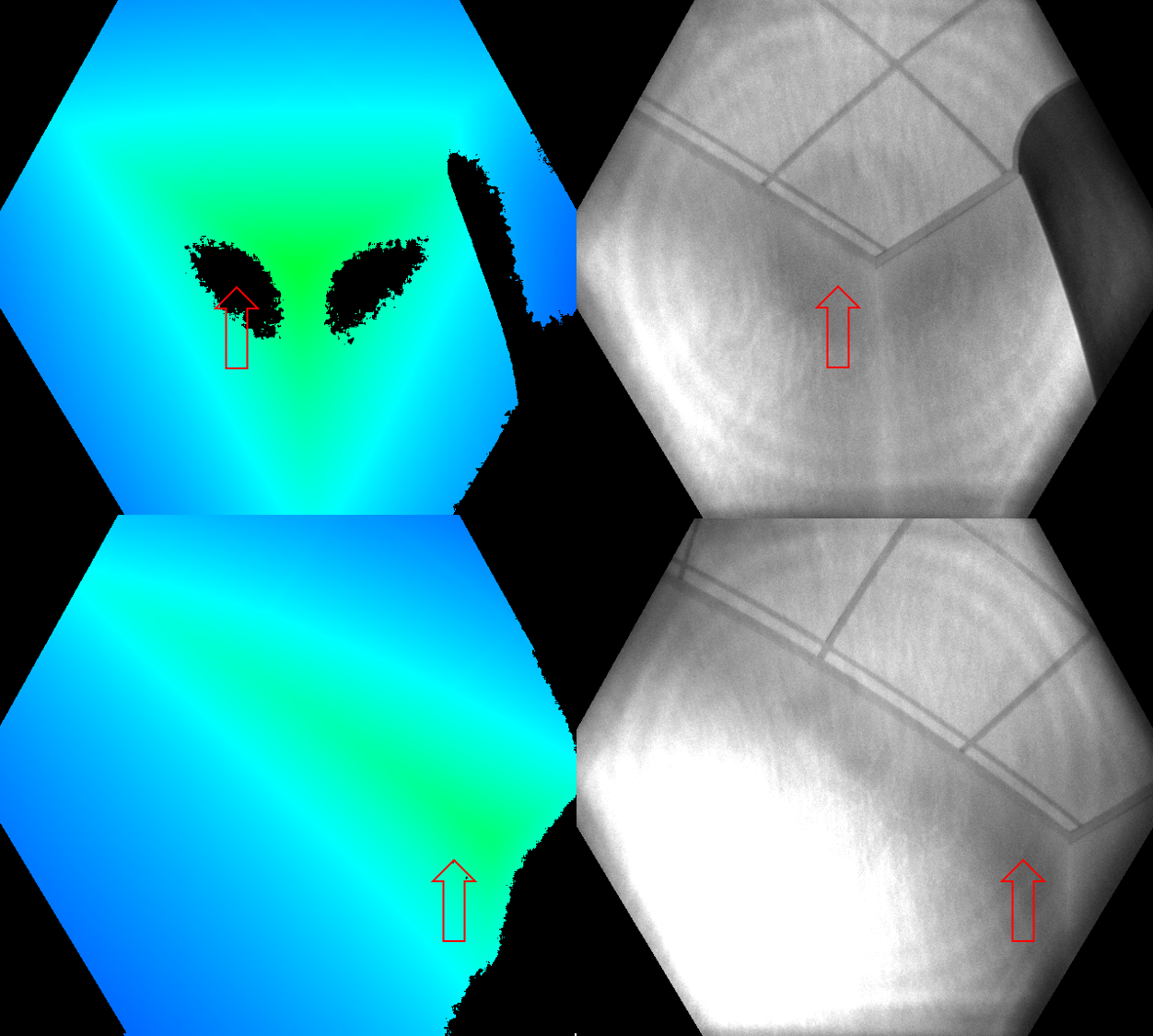

Piksele można również unieważnić, jeśli odebrały sygnały z więcej niż jednego obiektu w scenie. Typowy przypadek, w którym można zobaczyć tego rodzaju unieważnienie, znajduje się w rogach. Ze względu na geometrię sceny, światło IR z kamery odbił się od jednej ściany i na drugą. To odbite światło powoduje niejednoznaczność w zmierzonej głębokości piksela. Filtry w algorytmie głębokości wykrywają te niejednoznaczne sygnały i unieważniają piksele.

Na poniższych ilustracjach przedstawiono przykłady unieważnienia przez wykrywanie wielu ścieżek. Można również zobaczyć, jak ten sam obszar powierzchni, który został unieważniony z jednego widoku aparatu (górny wiersz) może pojawić się ponownie z innego widoku aparatu (dolny wiersz). Ten obraz pokazuje, że powierzchnie unieważnione z jednej perspektywy mogą być widoczne z innej strony.

Innym typowym przypadkiem wielościeżkowego są piksele zawierające sygnał mieszany z pierwszego planu i tła (na przykład wokół krawędzi obiektów). Podczas szybkiego ruchu mogą pojawić się bardziej unieważnione piksele wokół krawędzi. Dodatkowe unieważnione piksele są spowodowane interwałem ekspozycji surowego przechwytywania głębokości,

Następne kroki

Opinia

Dostępne już wkrótce: W 2024 r. będziemy stopniowo wycofywać zgłoszenia z serwisu GitHub jako mechanizm przesyłania opinii na temat zawartości i zastępować go nowym systemem opinii. Aby uzyskać więcej informacji, sprawdź: https://aka.ms/ContentUserFeedback.

Prześlij i wyświetl opinię dla