Uwaga

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

Ważne

Usługa Azure Content Moderator jest przestarzała od lutego 2024 r. i zostanie wycofana 15 marca 2027 r. Jest on zastępowany przez Azure AI Content Safety, która oferuje zaawansowane funkcje sztucznej inteligencji i zwiększoną wydajność.

Bezpieczeństwo zawartości sztucznej inteligencji platformy Azure to kompleksowe rozwiązanie przeznaczone do wykrywania szkodliwej zawartości generowanej przez użytkownika i generowanej przez sztuczną inteligencję w aplikacjach i usługach. Bezpieczeństwo zawartości sztucznej inteligencji platformy Azure jest odpowiednie dla wielu scenariuszy, takich jak witryny internetowe, firmy zajmujące się grami, platformy do obsługi wiadomości społecznościowych, firmy zajmujące się mediami korporacyjnymi i dostawcy rozwiązań edukacyjnych K-12. Poniżej przedstawiono omówienie jej funkcji i możliwości:

- API do wykrywania tekstu i obrazu: Skanowanie tekstu i obrazów pod kątem zawartości seksualnej, przemocy, nienawiści i samookaleczenia z wykorzystaniem różnych poziomów nasilenia.

- Content Safety Studio: narzędzie online przeznaczone do obsługi potencjalnie obraźliwych, ryzykownych lub niepożądanych treści przy użyciu naszych najnowszych modeli ML do moderacji treści. Udostępnia szablony i dostosowane przepływy pracy, które umożliwiają użytkownikom budowanie własnych systemów moderacji treści.

- Obsługa języka: Azure AI Content Safety obsługuje ponad 100 języków i został specjalnie przeszkolony w zakresie języka angielskiego, niemieckiego, japońskiego, hiszpańskiego, francuskiego, włoskiego, portugalskiego i chińskiego.

Bezpieczeństwo treści Azure AI zapewnia niezawodne i elastyczne rozwiązanie dla potrzeb moderacji treści. Przełączając się z usługi Content Moderator na bezpieczeństwo zawartości sztucznej inteligencji platformy Azure, możesz skorzystać z najnowszych narzędzi i technologii, aby upewnić się, że zawartość jest zawsze moderowana zgodnie z dokładnymi specyfikacjami.

Dowiedz się więcej o Bezpieczeństwie Treści Azure AI i odkryj, jak może podnieść poziom Twojej strategii moderacji treści.

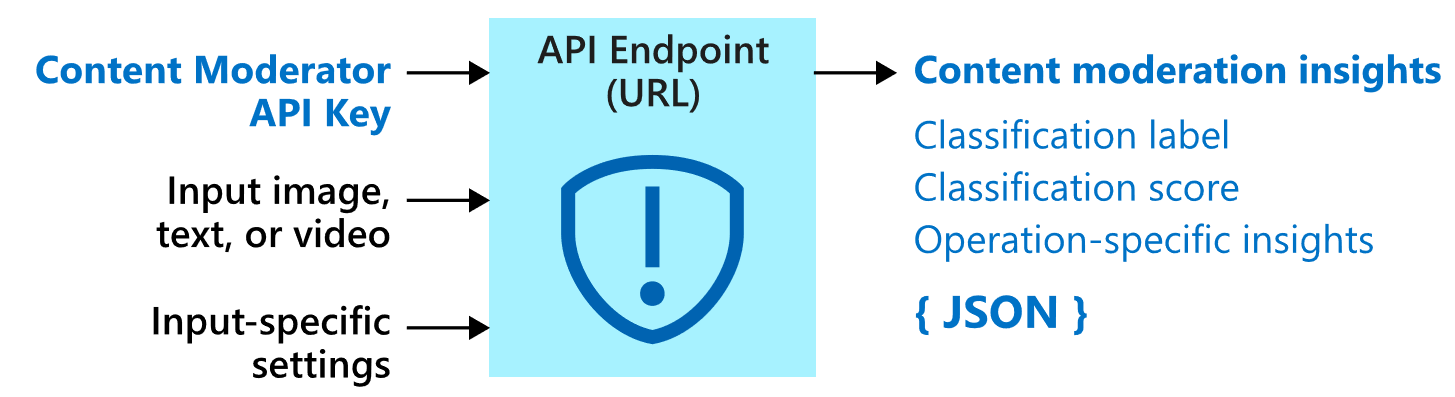

Azure Content Moderator to usługa sztucznej inteligencji, która umożliwia obsługę zawartości potencjalnie obraźliwej, ryzykownej lub w inny sposób niepożądanej. Obejmuje ona usługę moderacji treści obsługiwaną przez sztuczną inteligencję, która automatycznie skanuje teksty, obrazy i filmy wideo oraz stosuje odpowiednie flagi zawartości.

Możesz utworzyć oprogramowanie do filtrowania zawartości w aplikacji w celu zachowania zgodności z przepisami lub utrzymania zamierzonego środowiska dla użytkowników.

Ta dokumentacja zawiera następujące typy artykułów:

- Przewodniki szybkiego startu to instrukcje wprowadzające, które ułatwiają wysyłanie żądań do usługi.

- Przewodniki z instrukcjami zawierają instrukcje dotyczące korzystania z usługi w bardziej szczegółowy lub dostosowany sposób.

- Pojęcia zawierają szczegółowe wyjaśnienia dotyczące funkcjonalności i funkcji usługi.

Aby uzyskać bardziej ustrukturyzowane podejście, postępuj zgodnie z modułem Szkoleniowym dla usługi Content Moderator.

- Wprowadzenie do usługi Content Moderator

- Klasyfikowanie i moderowanie tekstu za pomocą usługi Azure Content Moderator

Miejsce użycia

Poniżej przedstawiono kilka scenariuszy, w których deweloper oprogramowania lub zespół wymaga usługi moderacji treści.

- Platformy handlowe online, które moderowały katalogi produktów i inną zawartość wygenerowaną przez użytkownika.

- Firmy zajmujące się grami, które moderują artefakty gier tworzone przez użytkowników oraz pokoje rozmów.

- Platformy do obsługi wiadomości społecznościowych, które moderują obrazy, tekst i filmy wideo dodane przez użytkowników.

- Przedsiębiorstwa medialne, które implementują scentralizowane moderowanie zawartości.

- Dostawcy rozwiązań edukacyjnych K-12 odfiltrowuje zawartość nieodpowiednią dla uczniów i nauczycieli.

Ważne

Usługi Content Moderator nie można używać do wykrywania nielegalnych obrazów wykorzystywania dzieci. Jednak kwalifikowane organizacje mogą używać usługi PhotoDNA Cloud Service do sprawdzania zawartości tego typu.

Co zawiera

Usługa Content Moderator składa się z kilku interfejsów API usług internetowych dostępnych za pośrednictwem wywołań REST i zestawu .NET SDK.

Interfejsy API moderowania

Usługa Content Moderator zawiera interfejsy API moderowania, które sprawdzają zawartość pod kątem materiałów potencjalnie nieodpowiednich lub niepożądanych.

W poniższej tabeli opisano różne typy interfejsów API moderowania.

| Grupa interfejsów API | opis |

|---|---|

| Moderowanie tekstu | Skanuje tekst pod kątem obraźliwych treści, treści seksualnych lub sugestywnych, wulgaryzmów i danych osobowych. |

| Niestandardowe listy terminów | Skanuje tekst w porównaniu z niestandardową listą terminów wraz z wbudowanymi terminami. Użyj list niestandardowych, aby blokować zawartość lub zezwalać na nią zgodnie z własnymi zasadami dotyczącymi zawartości. |

| Moderowanie obrazów | Skanuje obrazy pod kątem zawartości dla dorosłych i zawartości erotycznej, wykrywa tekst w obrazach za pomocą funkcji optycznego rozpoznawania znaków (OCR) i wykrywa twarze. |

| Niestandardowe listy obrazów | Skanuje obrazy względem własnej listy obrazów. Użyj niestandardowych list obrazów, aby filtrować wystąpienia często powtarzającej się zawartości, której nie chcesz klasyfikować ponownie. |

| Moderowanie filmów wideo | Skanuje filmy wideo pod kątem zawartości dla dorosłych lub treści erotycznych i zwraca znaczniki czasu dla tej zawartości. |

Prywatność i zabezpieczenia danych

Podobnie jak w przypadku wszystkich usług sztucznej inteligencji platformy Azure, deweloperzy korzystający z usługi Content Moderator powinni pamiętać o zasadach firmy Microsoft dotyczących danych klientów. Aby dowiedzieć się więcej, zobacz stronę usługi Azure AI w Centrum zaufania firmy Microsoft.

Następne kroki

- Ukończ bibliotekę klienta lub przewodnik Szybki start dotyczący interfejsu API REST, aby zaimplementować podstawowe scenariusze w kodzie.