Nuta

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować się zalogować lub zmienić katalog.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

W tym artykule opisano podstawowe pojęcia związane z usługą Azure Kubernetes Service (AKS), zarządzaną usługą Kubernetes, której można użyć do wdrażania i obsługi konteneryzowanych aplikacji na dużą skalę na platformie Azure.

Ważne

Od 30 listopada 2025 r. usługa Azure Kubernetes Service (AKS) nie obsługuje już ani nie zapewnia aktualizacji zabezpieczeń dla systemu Azure Linux 2.0. Obraz węzła systemu Linux 2.0 platformy Azure został zamrożony w wersji 202512.06.0. Od 31 marca 2026 r. obrazy węzłów zostaną usunięte i nie będzie można skalować pul węzłów. Przeprowadź migrację do obsługiwanej wersji systemu Linux platformy Azure, uaktualniając pule węzłów do obsługiwanej wersji rozwiązania Kubernetes lub migrując do systemu osSku AzureLinux3. Aby uzyskać więcej informacji, zobacz [Wycofywanie] pul węzłów Azure Linux 2.0 w usłudze AKS.

Co to jest platforma Kubernetes?

Kubernetes to platforma orkiestracji kontenerów typu open source do automatyzacji wdrażania, skalowania i zarządzania konteneryzowanymi aplikacjami. Aby uzyskać więcej informacji, zobacz oficjalną dokumentację platformy Kubernetes.

Co to jest usługa AKS?

Usługa AKS to zarządzana usługa Kubernetes, która upraszcza wdrażanie i skalowanie konteneryzowanych aplikacji korzystających z platformy Kubernetes oraz zarządzanie nimi. Aby uzyskać więcej informacji, zobacz Co to jest usługa Azure Kubernetes Service (AKS)?.

Składniki klastra

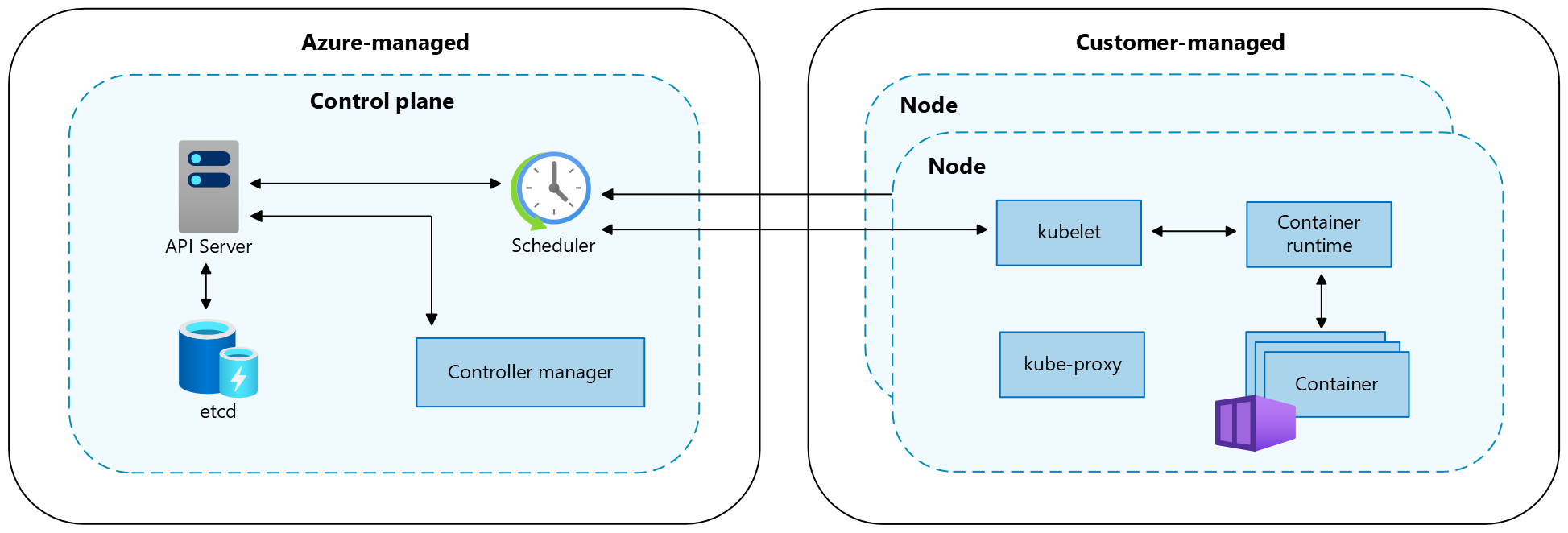

Klaster usługi AKS jest podzielony na dwa główne składniki:

- Płaszczyzna sterowania: Płaszczyzna sterowania zapewnia podstawowe usługi Kubernetes i aranżację obciążeń aplikacji.

- Węzły: węzły są podstawowymi maszynami wirtualnymi, które uruchamiają aplikacje.

Uwaga

Składniki zarządzane przez usługę AKS mają etykietę kubernetes.azure.com/managedby: aks.

Usługa AKS zarządza wydaniami programu Helm przy użyciu prefiksu aks-managed. Ciągle rosnące poprawki tych wersji są oczekiwane i bezpieczne.

Płaszczyzna sterowania

Zarządzana płaszczyzna sterowania platformy Azure składa się z kilku składników, które ułatwiają zarządzanie klastrem:

| Składnik | opis |

|---|---|

kube-apiserver |

Serwer interfejsu API (kube-apiserver) uwidacznia interfejs API Kubernetes w celu umożliwienia żądań do klastra z wewnątrz klastra i poza nim. |

etcd |

System przechowujący dane typu klucz-wartość o wysokiej dostępności etcd pomaga utrzymywać stan klastra Kubernetes i jego konfigurację. |

kube-scheduler |

Harmonogram (kube-scheduler) pomaga podejmować decyzje dotyczące planowania. Monitoruje nowe zasobniki bez przypisanego węzła i przypisuje im węzeł do uruchomienia. |

kube-controller-manager |

Menedżer kontrolera (kube-controller-manager) uruchamia procesy kontrolera, takie jak zauważenie i reagowanie, gdy węzły zejdą w dół. |

cloud-controller-manager |

Menedżer kontrolera chmury (cloud-controller-manager) osadza logikę sterowania specyficzną dla chmury w celu uruchamiania kontrolerów specyficznych dla dostawcy chmury. |

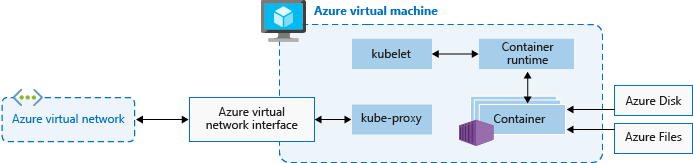

Węzły

Każdy klaster usługi AKS ma co najmniej jeden węzeł, czyli maszynę wirtualną platformy Azure, która uruchamia składniki węzła Kubernetes. Następujące składniki są uruchamiane w każdym węźle:

| Składnik | opis |

|---|---|

kubelet |

Narzędzie kubelet zapewnia, że kontenery są uruchomione w zasobniku. |

kube-proxy |

Serwer proxy kube-proxy to serwer proxy sieci, który obsługuje reguły sieci w węzłach. |

container runtime |

Środowisko uruchomieniowe kontenera zarządza wykonywaniem i cyklem życia kontenerów. |

Konfiguracja węzła

Skonfiguruj następujące ustawienia dla węzłów.

Rozmiar i obraz maszyny wirtualnej

Rozmiar maszyny wirtualnej platformy Azure dla węzłów definiuje procesory, pamięć, rozmiar i dostępny typ magazynu, taki jak dysk półprzewodnikowy o wysokiej wydajności lub zwykły dysk twardy. Wybrany rozmiar maszyny wirtualnej zależy od wymagań dotyczących obciążenia i liczby zasobników, które mają być uruchamiane w każdym węźle. Od maja 2025 r. domyślna jednostka SKU i rozmiar maszyny wirtualnej zostaną dynamicznie wybrane przez usługę AKS na podstawie dostępnej pojemności i limitu przydziału, jeśli parametr pozostanie pusty podczas wdrażania. Aby uzyskać więcej informacji, zobacz Obsługiwane rozmiary maszyn wirtualnych w usłudze Azure Kubernetes Service (AKS).

W usłudze AKS obraz maszyny wirtualnej dla węzłów klastra jest oparty na systemie Ubuntu Linux, Azure Linux lub Windows Server 2022. Podczas tworzenia klastra usługi AKS lub skalowania w poziomie liczby węzłów platforma Azure automatycznie tworzy i konfiguruje żądaną liczbę maszyn wirtualnych. Węzły agentów są rozliczane jako standardowe maszyny wirtualne. Wszelkie rabaty na rozmiar maszyny wirtualnej, w tym rezerwacje platformy Azure, są automatycznie stosowane.

Dyski systemu operacyjnego

Domyślne ustalanie rozmiaru dysku systemu operacyjnego jest używane w nowych klastrach lub pulach węzłów tylko wtedy, gdy nie określono domyślnego rozmiaru dysku systemu operacyjnego. To zachowanie ma zastosowanie zarówno do dysków zarządzanych, jak i efemerycznych systemu operacyjnego. Aby uzyskać więcej informacji, zobacz Domyślny rozmiar dysku systemu operacyjnego.

Rezerwacje zasobów

Usługa AKS używa zasobów węzłów, aby ułatwić działanie węzłów w ramach klastra. To użycie może spowodować rozbieżność między całkowitymi zasobami węzła a zasobami allocatable w usłudze AKS. Aby zachować wydajność i funkcjonalność węzła, AKS rezerwuje dwa typy zasobów sprzętowych — CPU oraz pamięć — na każdym węźle. Aby uzyskać więcej informacji, zobacz Rezerwacje zasobów w usłudze AKS.

System operacyjny

Usługa AKS obsługuje dwie dystrybucje systemu Linux: Ubuntu i Azure Linux. Ubuntu to domyślna dystrybucja systemu Linux w usłudze AKS. Pule węzłów systemu Windows są również obsługiwane w AKS, z kanałem długoterminowego serwisowania (LTSC) jako kanałem domyślnym. Aby uzyskać więcej informacji na temat domyślnych wersji systemu operacyjnego, zobacz dokumentację dotyczącą obrazów węzłów.

Środowisko uruchomieniowe kontenera

Środowisko uruchomieniowe kontenera to oprogramowanie, które wykonuje kontenery i zarządza obrazami kontenerów w węźle. Środowisko uruchomieniowe umożliwia abstrakcję systemowych wywołań lub funkcji specyficznych dla OS, aby uruchamiać kontenery w systemie Linux lub Windows. W przypadku pul węzłów systemu Linux kontenerd jest używany na platformie Kubernetes w wersji 1.19 lub nowszej. Dla pul węzłów Windows Server 2019 i 2022 containerd jest dostępne i jest jedyną opcją środowiska uruchomieniowego na platformie Kubernetes w wersji 1.23 lub nowszej.

Zasobniki

Zasobnik to grupa co najmniej jednego kontenera, który współużytkuje te same zasoby sieciowe i magazynowe oraz specyfikację sposobu uruchamiania kontenerów. Zasobniki zazwyczaj mają mapowanie 1:1 z kontenerem, ale można uruchamiać wiele kontenerów w zasobniku.

Pule węzłów

W usłudze AKS węzły tej samej konfiguracji są grupowane razem w pule węzłów. Te pule węzłów zawierają bazowe zestawy skalowania maszyn wirtualnych i maszyny wirtualne, które uruchamiają aplikacje.

Podczas tworzenia klastra usługi AKS należy zdefiniować początkową liczbę węzłów i ich rozmiar (wersję), która tworzy pulę węzłów systemowych. Pule węzłów systemowych służą głównemu celowi hostowania krytycznych zasobników systemu, takich jak CoreDNS i konnectivity.

Aby obsługiwać aplikacje o różnych wymaganiach obliczeniowych lub magazynowych, można utworzyć pule węzłów użytkownika. Pule węzłów użytkownika służą głównemu celowi hostowania zasobników aplikacji.

Aby uzyskać więcej informacji, zobacz Tworzenie pul węzłów w usłudze AKS i Zarządzanie pulami węzłów w usłudze AKS.

Grupa zasobów węzła

Podczas tworzenia klastra usługi AKS w grupie zasobów platformy Azure dostawca zasobów usługi AKS automatycznie tworzy drugą grupę zasobów o nazwie grupa zasobów węzła. Ta grupa zasobów zawiera wszystkie zasoby infrastruktury skojarzone z klastrem, w tym maszyny wirtualne, zestawy skalowania maszyn wirtualnych i magazyn.

Aby uzyskać więcej informacji, zobacz następujące zasoby:

- Dlaczego dwie grupy zasobów są tworzone za pomocą usługi AKS?

- Czy mogę podać własną nazwę dla grupy zasobów węzła usługi AKS?

- Czy mogę modyfikować tagi i inne właściwości zasobów w grupie zasobów węzła usługi AKS?

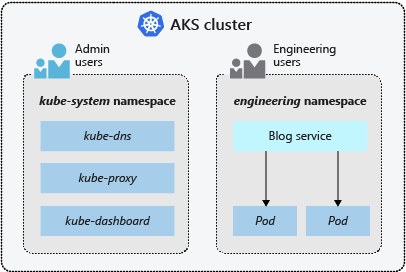

Przestrzenie nazw

Zasoby platformy Kubernetes, takie jak zasobniki i wdrożenia, są logicznie grupowane w przestrzenie nazw, aby podzielić klaster usługi AKS i utworzyć, wyświetlić lub zarządzać dostępem do zasobów.

Następujące przestrzenie nazw są domyślnie tworzone w klastrze usługi AKS:

| Przestrzeń nazw | opis |

|---|---|

default |

Domyślna przestrzeń nazw umożliwia rozpoczęcie korzystania z zasobów klastra bez tworzenia nowej przestrzeni nazw. |

kube-node-lease |

Przestrzeń nazw kube-node-lease umożliwia węzłom komunikowanie się ich dostępności z płaszczyzną sterowania. |

kube-public |

Publiczna przestrzeń nazw kube-public nie jest zwykle używana, ale można jej używać, aby zasoby były widoczne w całym klastrze przez dowolnego użytkownika. |

kube-system |

Przestrzeń nazw kube-system jest używana przez platformę Kubernetes do zarządzania zasobami klastra, takimi jak coredns, konnectivity-agenti metrics-server. Nie zaleca się wdrażania własnych aplikacji w tej przestrzeni nazw. W rzadkich przypadkach, w których wdrażanie własnych aplikacji w tej przestrzeni nazw jest konieczne, zobacz często zadawane pytania , aby dowiedzieć się, jak. |

Tryby klastra

W usłudze AKS można utworzyć klaster z trybem automatycznym lub standardowym. Usługa AKS Automatic zapewnia bardziej w pełni zarządzane środowisko. Konfigurację klastra można zarządzać, w tym węzłami, skalowaniem, zabezpieczeniami i innymi wstępnie skonfigurowanymi ustawieniami. Usługa AKS Standard zapewnia większą kontrolę nad konfiguracją klastra, w tym możliwość zarządzania pulami węzłów, skalowaniem i innymi ustawieniami.

Aby uzyskać więcej informacji, zobacz Porównanie funkcji automatycznych i standardowych usługi AKS.

Warstwy cenowe

Usługa AKS oferuje trzy warstwy cenowe do zarządzania klastrami: Bezpłatna, Standardowa i Premium. Wybrana warstwa cenowa określa funkcje dostępne do zarządzania klastrem.

Aby uzyskać więcej informacji, zobacz Warstwy cenowe do zarządzania klastrem usługi AKS.

Obsługiwane wersje platformy Kubernetes

Aby uzyskać więcej informacji, zobacz Obsługiwane wersje platformy Kubernetes w usłudze AKS.

Treści powiązane

Aby uzyskać więcej podstawowych pojęć dotyczących usługi AKS, zobacz następujące zasoby: