Notatka

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

DOTYCZY: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Wskazówka

Data Factory w usłudze Microsoft Fabric jest następną generacją Azure Data Factory z prostszą architekturą, wbudowaną sztuczną inteligencją i nowymi funkcjami. Jeśli dopiero zaczynasz integrować dane, zacznij od Fabric Data Factory. Istniejące obciążenia ADF można zaktualizować do Fabric, aby uzyskać dostęp do nowych możliwości w zakresie nauki o danych, analiz w czasie rzeczywistym oraz raportowania.

Uwaga

Menedżer orkiestracji przepływu pracy jest obsługiwany przez platformę Apache Airflow.

Uwaga

Program Workflow Orchestration Manager dla Azure Data Factory korzysta z aplikacji open source Apache Airflow. Dokumentację i więcej samouczków dotyczących rozwiązania Airflow można znaleźć na stronach dokumentacji lub społeczności platformy Apache Airflow.

Program Workflow Orchestration Manager w usłudze Azure Data Factory używa grafów skierowanych acyklicznych (DAG) opartych na Pythonie do uruchamiania przepływów pracy orkiestracji. Aby użyć tej funkcji, należy umieścić swoje DAG-i i wtyczki wewnątrz Azure Blob Storage. Interfejs użytkownika platformy Airflow można uruchomić w ADF przy użyciu interfejsu wiersza poleceń (CLI) lub Zestawu SDK (Software Development Kit), aby zarządzać DAG-ami.

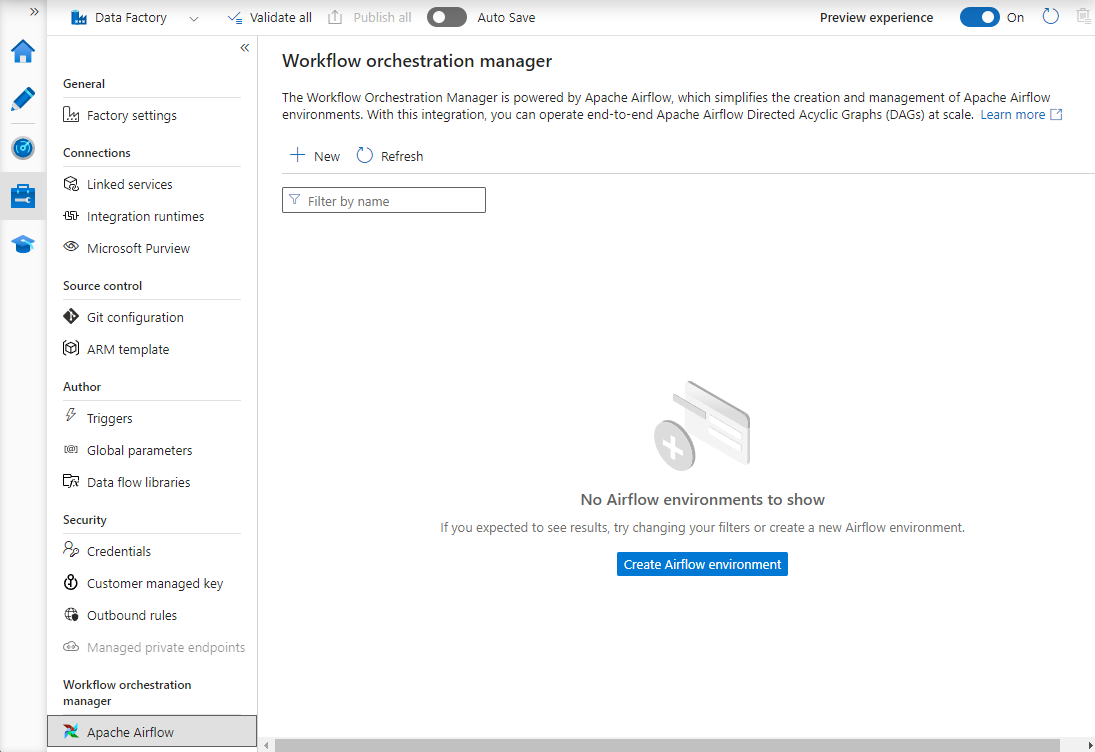

Tworzenie środowiska menedżera orkiestracji przepływu pracy

Poniższe kroki umożliwiają przygotowanie i skonfigurowanie środowiska programu Workflow Orchestration Manager.

Wymagania wstępne

Subskrypcja Azure: Jeśli nie masz subskrypcji Azure, przed rozpoczęciem utwórz darmowe konto. Utwórz lub wybierz istniejącą fabrykę danych w regionie, w którym jest obsługiwana wersja zapoznawcza programu Workflow Orchestration Manager.

Procedura tworzenia środowiska

Utwórz nowe środowisko programu Workflow Orchestration Manager. Przejdź do Zarządzanie ->Airflow (wersja zapoznawcza) ->+Nowy, aby utworzyć nowe środowisko Airflow

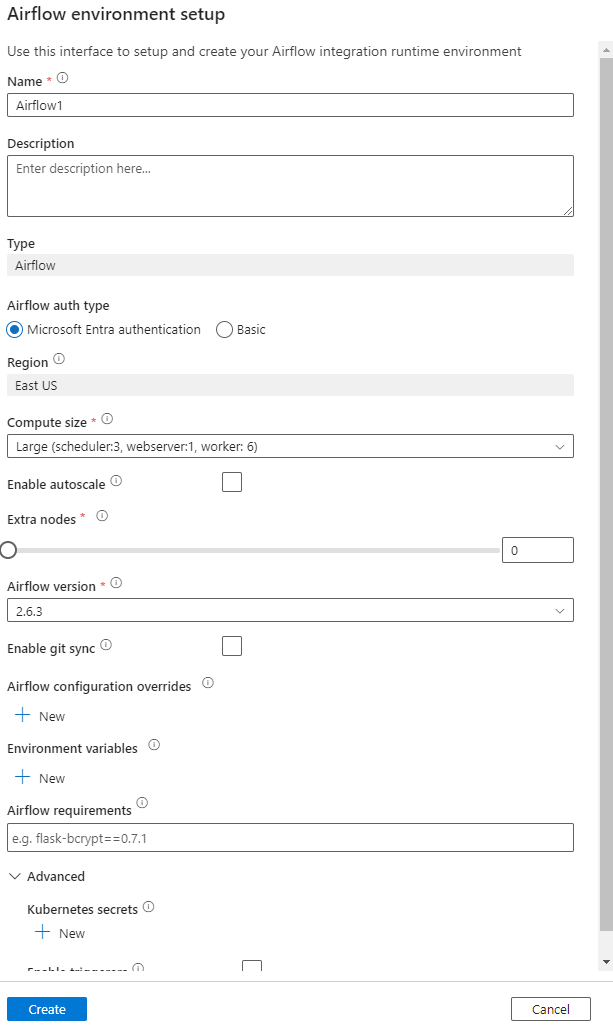

Podaj szczegóły (konfiguracja rozwiązania Airflow)

Ważne

Podczas korzystania z uwierzytelniania podstawowego pamiętaj nazwę użytkownika i hasło określone na tym ekranie. Będzie konieczne zalogowanie się później w interfejsie użytkownika programu Workflow Orchestration Manager. Domyślną opcją jest Microsoft Entra ID i nie wymaga tworzenia nazwy użytkownika ani hasła dla środowiska Airflow. Zamiast tego używa poświadczeń zalogowanego użytkownika, aby logować się i monitorować DAGi w Azure Data Factory.

Zmienne środowiskowe to prosty magazyn wartości klucza w Airflow, służący do przechowywania i pobierania dowolnej zawartości lub ustawień.

Wymagania mogą służyć do wstępnego instalowania bibliotek języka Python. Można je również zaktualizować później.

Importowanie DAG-ów

W poniższych krokach opisano sposób importowania grup DAG do programu Workflow Orchestration Manager.

Wymagania wstępne

Musisz załadować przykładowy DAG na dostępne konto Storage (powinno znajdować się w folderze dags).

Uwaga

Blob Storage w ramach sieci VNet nie są obsługiwane w wersji testowej.

Konfiguracja Key Vault w usłudze storageLinkedServices nie jest obsługiwana do importowania DAG-ów.

Przykładowy plik DAG platformy Apache Airflow w wersji 2.x. Przykładowy zestaw danych Apache Airflow w wersji 1.10 DAG.

Kroki importowania

Skopiuj zawartość (v2.x lub v1.10 na podstawie skonfigurowanego środowiska Airflow) do nowego pliku o nazwie tutorial.py.

Przekaż tutorial.py do magazynu obiektów blob. (Jak przekazać plik do obiektu blob)

Uwaga

Musisz wybrać ścieżkę katalogu z konta usługi blob storage, które zawiera foldery o nazwach dags i wtyczki, aby zaimportować je do środowiska Airflow. Wtyczki nie są obowiązkowe. Możesz również mieć kontener o nazwie dags i przekazać wszystkie pliki Airflow wewnątrz niego.

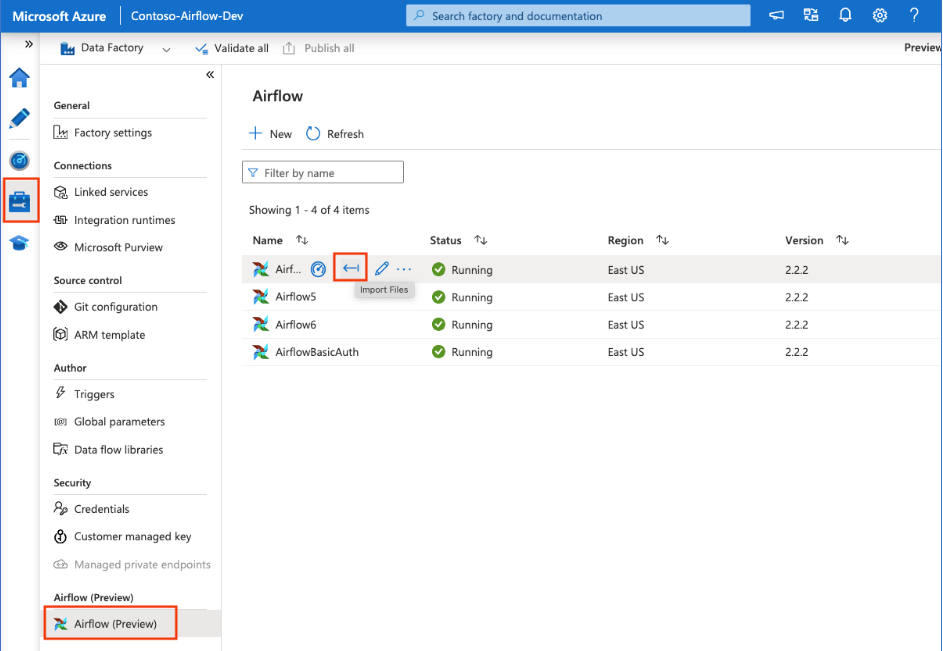

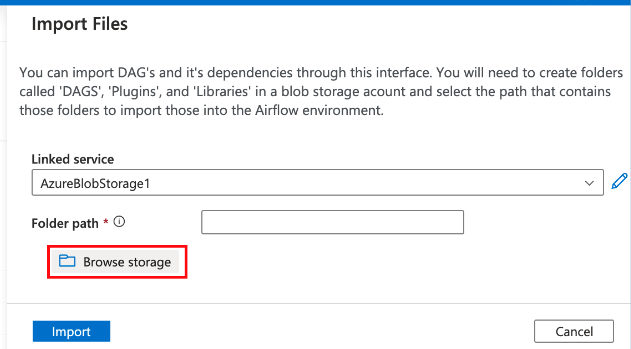

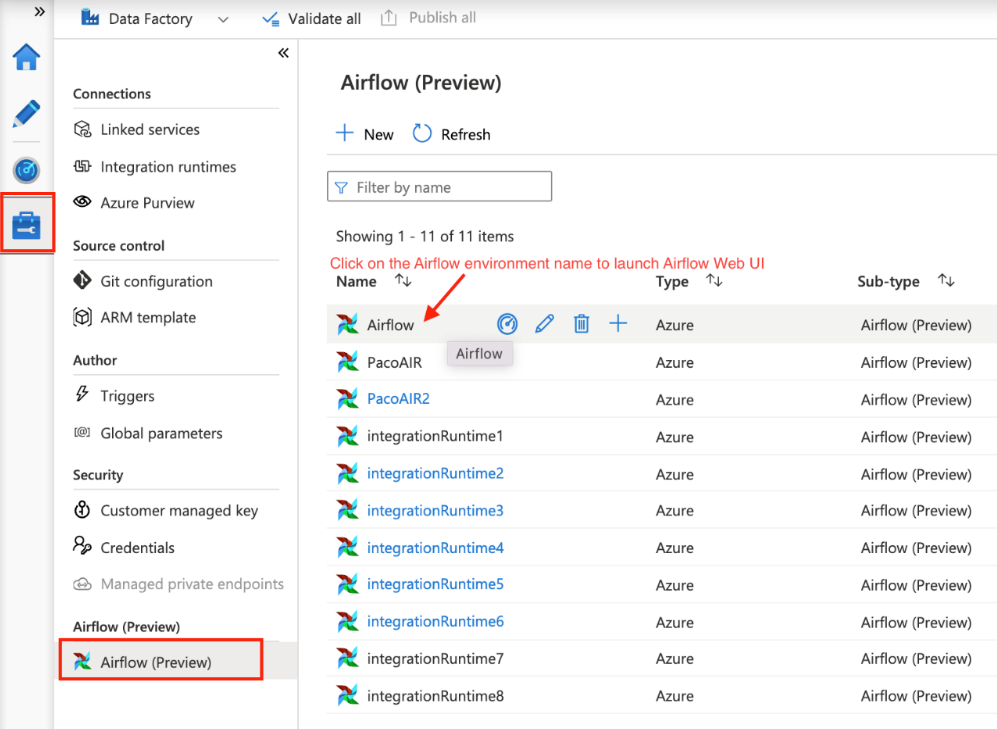

Wybierz Airflow (wersja zapoznawcza) w obszarze Zarządzaj hubu. Następnie umieść kursor na wcześniej utworzonym środowisku Airflow i wybierz pozycję Importuj pliki, aby zaimportować wszystkie grupy DAG i zależności do środowiska Airflow.

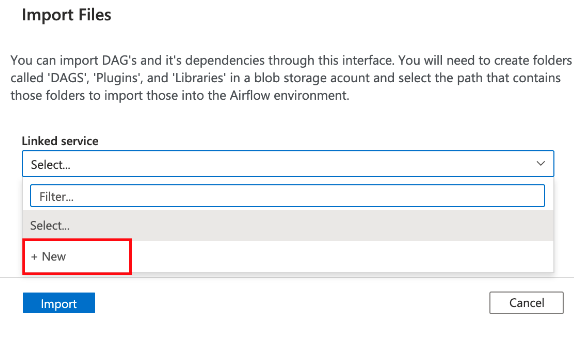

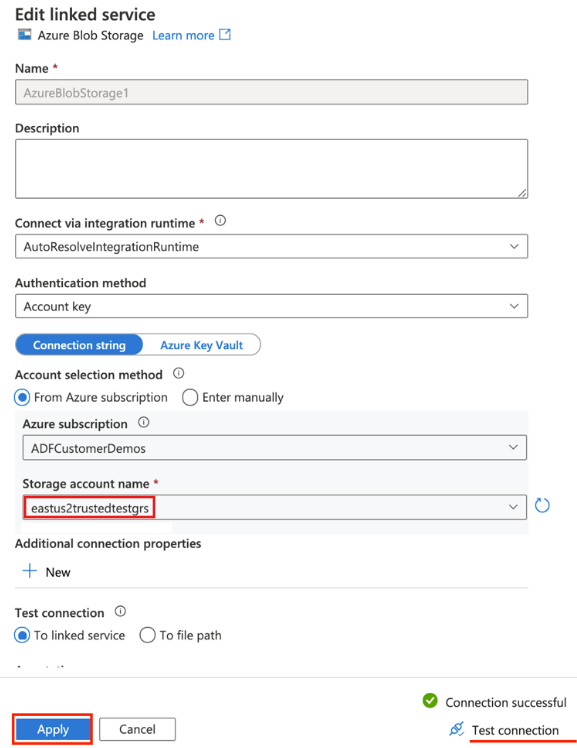

Utwórz nową połączoną usługę z dostępnym kontem magazynu wymienionym w wymaganiach wstępnych (lub użyj istniejącej usługi, jeśli masz już własne grupy DAG).

Użyj konta magazynowego, w którym załadowałeś DAG (sprawdź wymagania wstępne). Przetestuj połączenie, a następnie wybierz pozycję Utwórz.

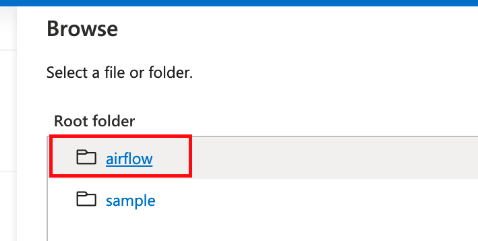

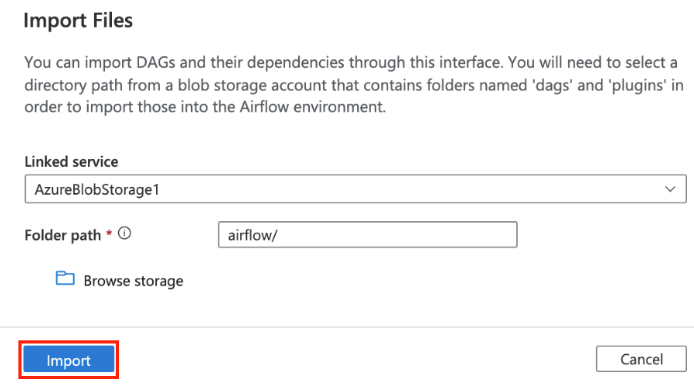

Przeglądaj i wybierz airflow, jeśli używasz przykładowego adresu URL sygnatury dostępu współdzielonego, lub wybierz folder, który zawiera folder dags z plikami DAG.

Uwaga

Możesz zaimportować grupy DAG i ich zależności za pomocą tego interfejsu. Musisz wybrać ścieżkę katalogu z konta usługi blob storage, które zawiera foldery o nazwach dags i wtyczki, aby zaimportować je do środowiska Airflow. Wtyczki nie są obowiązkowe.

Uwaga

Importowanie grup DAG może potrwać kilka minut w wersji zapoznawczej. Centrum powiadomień (ikona dzwonka w interfejsie użytkownika usługi ADF) może służyć do śledzenia aktualizacji stanu importu.

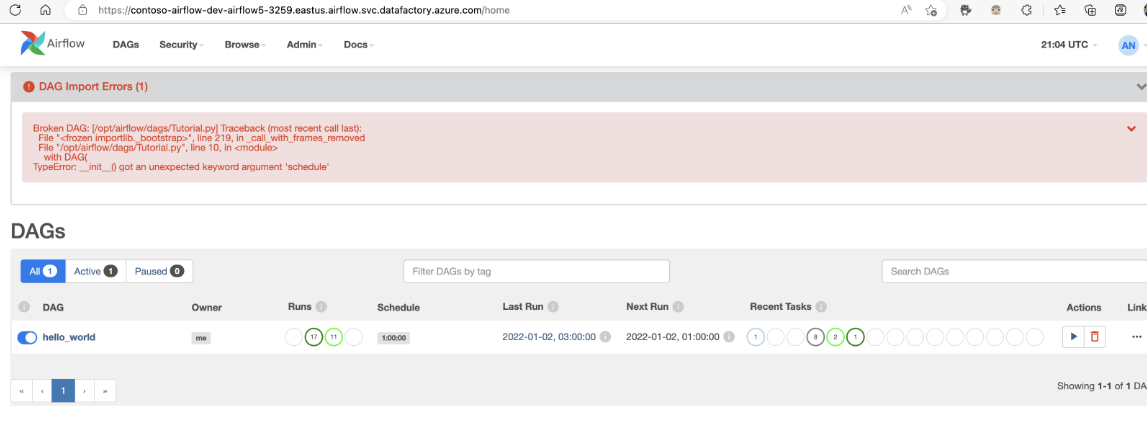

Rozwiązywanie problemów z importowaniem DAG

Problem: Importowanie grup DAG zajmuje ponad 5 minut środki zaradcze: Zmniejsz rozmiar zaimportowanych grup DAG przy użyciu pojedynczego importu. Jednym ze sposobów osiągnięcia tego celu jest utworzenie wielu folderów DAG z mniejszą liczbą DAG-ów w wielu kontenerach.

Problem: Zaimportowane grupy DAG nie są wyświetlane podczas logowania się do interfejsu użytkownika aplikacji Airflow. Środki zaradcze: zaloguj się do Airflow UI i sprawdź, czy występują błędy parsowania DAG. Może się tak zdarzyć, jeśli pliki DAG zawierają dowolny niezgodny kod. Znajdziesz dokładne numery wierszy i pliki, które mają problem w Airflow UI.

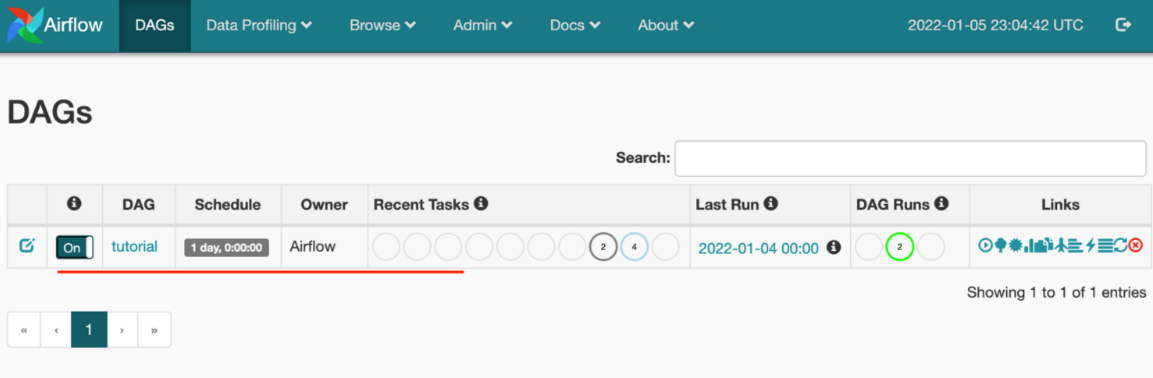

Monitorowanie przebiegów DAG

Aby monitorować grupy DAG przepływu powietrza, zaloguj się do interfejsu użytkownika aplikacji Airflow przy użyciu wcześniej utworzonej nazwy użytkownika i hasła.

Wybierz utworzone środowisko Airflow.

Zaloguj się przy użyciu nazwy użytkownika i hasła podanych podczas tworzenia Airflow Integration Runtime. (W razie potrzeby możesz zresetować nazwę użytkownika lub hasło, edytując środowisko Airflow Integration Runtime )

Usuwanie grup DAG ze środowiska Airflow

Jeśli używasz środowiska Airflow w wersji 1.x, usuń grupy DAG wdrożone w dowolnym środowisku Airflow (IR), musisz usunąć grupy DAG w dwóch różnych miejscach.

- Usuń DAG z interfejsu użytkownika Airflow

- Usunięcie DAG w interfejsie użytkownika ADF

Uwaga

Jest to obecne doświadczenie podczas wersji beta, a my będziemy ulepszać to doświadczenie.