Notatka

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

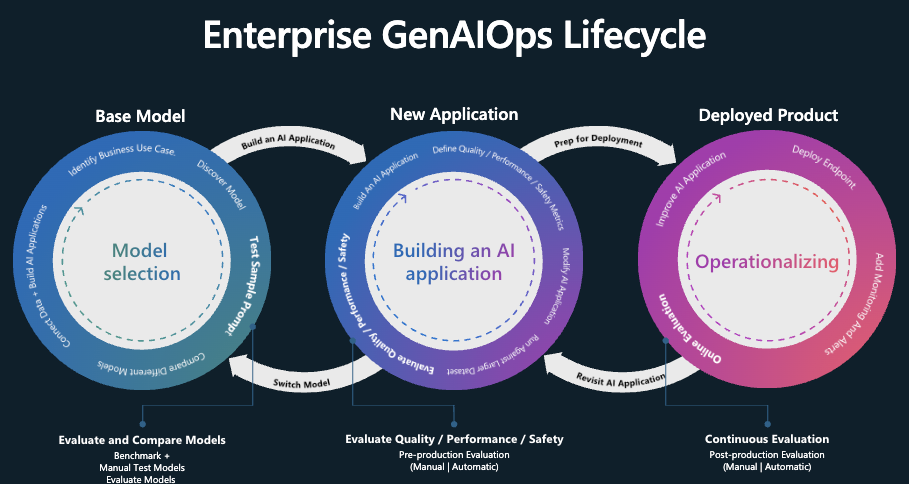

Cykl życia aplikacji sztucznej inteligencji wymaga niezawodnych struktur ewaluacyjnych, aby zapewnić, że systemy sztucznej inteligencji zapewniają dokładne, odpowiednie i niezawodne dane wyjściowe. Bez rygorystycznej oceny systemy sztucznej inteligencji ryzykują generowanie odpowiedzi, które są niedokładne, niespójne, słabo uziemione lub potencjalnie szkodliwe. Możliwość obserwacji umożliwia zespołom pomiar i poprawę jakości i bezpieczeństwa danych wyjściowych sztucznej inteligencji w całym cyklu projektowania — od wyboru modelu przez monitorowanie produkcyjne.

Co to jest obserwowanie?

Możliwość obserwowania sztucznej inteligencji odnosi się do możliwości monitorowania, zrozumienia i rozwiązywania problemów z systemami sztucznej inteligencji w całym cyklu życia. Możesz śledzić, oceniać i integrować automatyczne bramy jakości z pipeline'ami CI/CD oraz zbierać sygnały, takie jak metryki oceny, logi, ślady i dane wyjściowe modelu, aby uzyskać wgląd w wydajność, jakość, bezpieczeństwo i kondycję operacyjną.

Podstawowe możliwości obserwacji

Microsoft Foundry zapewnia trzy podstawowe możliwości, które współpracują ze sobą w celu zapewnienia kompleksowej obserwacji w całym cyklu życia aplikacji sztucznej inteligencji:

Oceny

Ewaluatorzy mierzą jakość, bezpieczeństwo i niezawodność odpowiedzi sztucznej inteligencji w całym rozwoju. Microsoft Foundry udostępnia wbudowane ewaluatory, w tym metryki jakości ogólnego przeznaczenia (spójność, płynność), metryki specyficzne dla RAG (podstawność, istotność), bezpieczeństwo i zabezpieczenia (nienawiść/niesprawiedliwość, przemoc, materiały chronione) i metryki specyficzne dla agenta (dokładność wywołań narzędzi, realizacja zadań). Można również tworzyć niestandardowe ewaluatory dostosowane do wymagań specyficznych dla domeny.

Aby uzyskać pełną listę wbudowanych ewaluatorów, zobacz Dokumentacja wbudowanych ewaluatorów.

Monitorowanie

Monitorowanie produkcji zapewnia, że wdrożone aplikacje sztucznej inteligencji zachowują jakość i wydajność w rzeczywistych warunkach. Microsoft Foundry, zintegrowana z usługą Azure Monitor Application Insights, dostarcza pulpity nawigacyjne w czasie rzeczywistym śledzące metryki operacyjne, konsumpcję tokenów, opóźnienia, wskaźniki błędów oraz oceny jakości. Alerty można skonfigurować, gdy dane wyjściowe kończą się niepowodzeniem progów jakości lub generują szkodliwą zawartość, umożliwiając szybkie rozwiązywanie problemów.

Aby uzyskać szczegółowe informacje na temat konfigurowania monitorowania produkcyjnego, zobacz Monitorowanie pulpitu nawigacyjnego agentów.

Śledzenie

Śledzenie rozproszone przechwytuje przepływ wykonywania aplikacji sztucznej inteligencji, zapewniając wgląd w wywołania dużych modeli językowych (LLM), wywołania narzędzi, decyzje agentów i zależności między usługami. Oparte na standardach OpenTelemetry i zintegrowane z usługą Azure Monitor Application Insights, śledzenie umożliwia debugowanie złożonych zachowań agentów, identyfikację wąskich gardeł wydajności oraz zrozumienie wieloetapowych łańcuchów rozumowania. program Microsoft Foundry obsługuje śledzenie popularnych struktur, takich jak LangChain, LangGraph, zestaw SDK agentów OpenAI i Microsoft Agent Framework.

Aby uzyskać wskazówki dotyczące implementowania śledzenia, zobacz Omówienie agenta śledzenia.

Co to są ewaluatory?

Ewaluatorzy to wyspecjalizowane narzędzia, które mierzą jakość, bezpieczeństwo i niezawodność odpowiedzi sztucznej inteligencji w całym cyklu projektowania.

Aby uzyskać pełną listę wbudowanych ewaluatorów, zobacz Dokumentacja wbudowanych ewaluatorów.

Ewaluatorzy integrują się z każdym etapem cyklu życia sztucznej inteligencji, aby zapewnić niezawodność, bezpieczeństwo i skuteczność.

Trzy etapy oceny cyklu życia aplikacji sztucznej inteligencji

Wybór modelu podstawowego

Wybierz odpowiedni model podstaw, porównując jakość, wydajność zadań, zagadnienia etyczne i profile bezpieczeństwa w różnych modelach.

Tools available: Microsoft Foundry benchmark do porównywania modeli na publicznych lub własnych zestawach danych oraz Azure AI Evaluation SDK do testowania określonych punktów końcowych modelu.

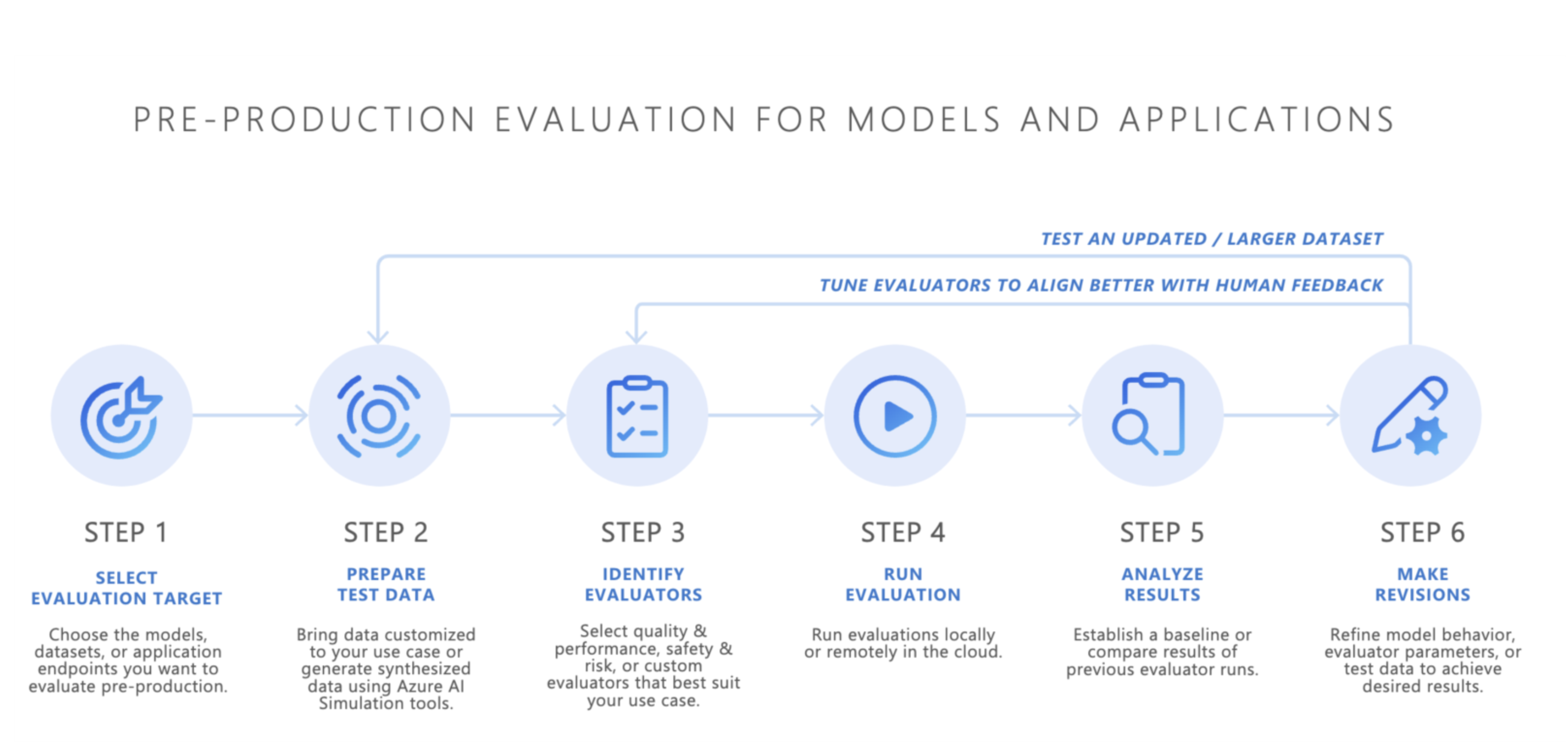

Ocena przedprodukcyjna

Przed wdrożeniem dokładne testowanie gwarantuje, że agent lub aplikacja sztucznej inteligencji jest gotowa do użycia w środowisku produkcyjnym. Ten etap weryfikuje wydajność za pomocą zestawów danych oceny, identyfikuje przypadki brzegowe, ocenia niezawodność i mierzy kluczowe metryki, w tym przestrzeganie zadań, uziemienie, istotność i bezpieczeństwo. Aby utworzyć agentów gotowych do produkcji z konwersacjami wielozadaniowymi, wywoływaniem narzędzi i zarządzaniem stanem, zobacz Foundry Agent Service.

Narzędzia do oceny i podejścia:

Korzystanie z własnych danych: ocenianie aplikacji sztucznej inteligencji przy użyciu własnych danych przy użyciu jakości, bezpieczeństwa lub niestandardowych ewaluatorów. Użyj kreatora oceny Foundry portal lub Foundry SDK i wyświetl wyniki w Foundry portal.

AI red teaming agent: AI red teaming agent symuluje złożone ataki przy użyciu frameworku PyRIT firmy Microsoft w celu zidentyfikowania luk w bezpieczeństwie i zabezpieczeniach przed wdrożeniem. Najlepiej stosować z procesami z człowiekiem w pętli.

Monitorowanie po produkcji

Po wdrożeniu ciągłe monitorowanie zapewnia, że aplikacja sztucznej inteligencji utrzymuje jakość w rzeczywistych warunkach:

- Metryki operacyjne: regularny pomiar kluczowych metryk operacyjnych agenta sztucznej inteligencji

- Ciągła ocena: ocena jakości i bezpieczeństwa ruchu produkcyjnego z częstotliwością próbkowania

- Zaplanowana ocena: zaplanowana jakość i ocena bezpieczeństwa przy użyciu testowych zestawów danych do wykrywania dryfu systemu

- Zaplanowane testy red teaming: Zaplanowane testowanie ofensywne w celu sondowania podatności na zagrożenia dotyczące bezpieczeństwa i zabezpieczeń

- alerty Azure Monitor: Powiadomienia, gdy wyniki nie spełniają progów jakości lub generują szkodliwą zawartość

Zintegrowany z usługą Azure Monitor Application Insights pulpit obserwacyjny Foundry oferuje wgląd w czasie rzeczywistym w dane dotyczące wydajności, bezpieczeństwa i jakości, umożliwiając szybkie rozwiązywanie problemów i utrzymywanie zaufania użytkowników.

Szybka dokumentacja dotycząca oceny

| Cel | Proces | Parametry, wskazówki i przykłady |

|---|---|---|

| Jak skonfigurować śledzenie? | Konfigurowanie śledzenia rozproszonego |

Przegląd śledzenia Śledzenie za pomocą agenta SDK |

| Co oceniasz? | Identyfikowanie lub tworzenie odpowiednich ewaluatorów |

Wbudowane ewaluatory Niestandardowe ewaluatory Przykłady SDK dla Pythona C# sdk samples |

| Jakich danych należy użyć? | Przekazywanie lub generowanie odpowiedniego zestawu danych | Wybieranie lub tworzenie zestawu danych |

| Jak przeprowadzić ewaluacje? | Uruchamianie oceny |

Przebiegi oceny agenta Uruchamianie chmury zdalnej |

| Jak działa moja aplikacja modelu/sztucznej inteligencji? | Analizowanie wyników |

Wyświetlanie wyników oceny Analiza klastra |

| Jak mogę ulepszyć? | Analizowanie wyników i optymalizowanie agentów | Analizowanie błędów oceny za pomocą analizy klastra. Optymalizowanie agentów i ponowne ocenianie. Przejrzyj wyniki oceny. |

Obsługa regionów, limity szybkości i obsługa sieci wirtualnej

Aby dowiedzieć się, które regiony obsługują ewaluatorów wspomaganych przez sztuczną inteligencję, limity szybkości stosowane do przebiegów ewaluacyjnych oraz jak skonfigurować obsługę sieci wirtualnej pod kątem izolacji sieciowej, zobacz obsługa regionów, limity szybkości i obsługa sieci wirtualnej na potrzeby oceny.

Ceny

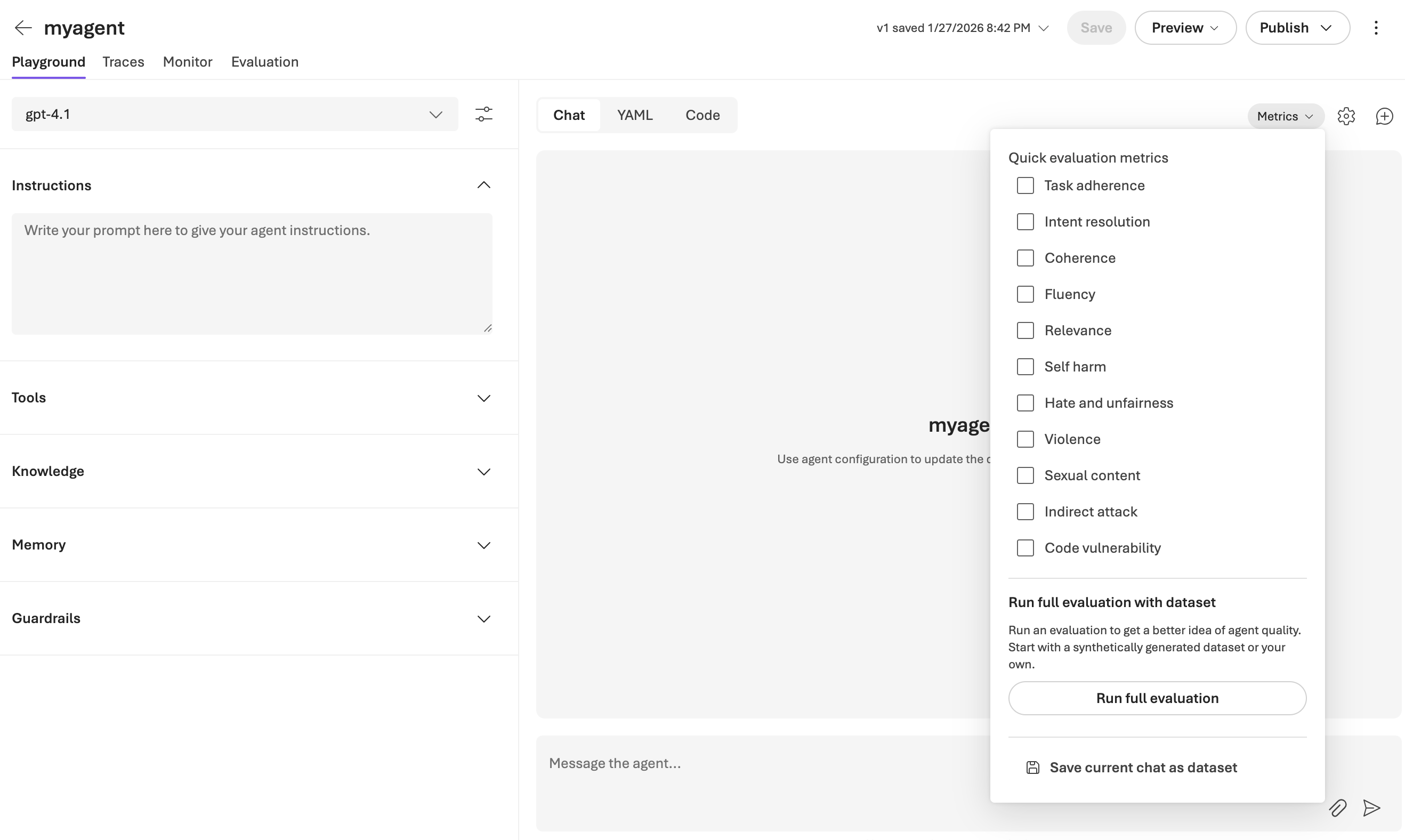

Funkcje obserwacji, takie jak oceny ryzyka i bezpieczeństwa oraz oceny w obszarze testowym agenta, są rozliczane na podstawie konsumpcji wymienionej na naszej stronie cennika Azure.

Ważne

Oceny w środowisku agentów są domyślnie włączone dla wszystkich projektów Foundry i są uwzględniane w rozliczeniach opartych na zużyciu. Aby wyłączyć oceny placu zabaw, wybierz metryki w prawym górnym rogu placu zabaw agentów i usuń zaznaczenie wszystkich ewaluatorów.