Filtrowanie i pozyskiwanie do usługi Azure Data Lake Storage Gen2 przy użyciu usługi Stream Analytics bez edytora kodu

W tym artykule opisano, jak łatwo utworzyć zadanie usługi Stream Analytics za pomocą edytora kodu bez edytora kodu. Stale odczytuje z usługi Event Hubs, filtruje dane przychodzące, a następnie zapisuje wyniki w sposób ciągły w usłudze Azure Data Lake Storage Gen2.

Wymagania wstępne

- Zasoby usługi Azure Event Hubs muszą być publicznie dostępne i nie muszą znajdować się za zaporą lub zabezpieczone w usłudze Azure Virtual Network

- Dane w usłudze Event Hubs muszą być serializowane w formacie JSON, CSV lub Avro.

Opracowywanie zadania usługi Stream Analytics w celu filtrowania i pozyskiwania danych w czasie rzeczywistym

W witrynie Azure Portal znajdź i wybierz wystąpienie usługi Azure Event Hubs.

Wybierz pozycję Funkcje Process Data (Dane przetwarzania funkcji>), a następnie wybierz pozycję Start (Rozpocznij) na karcie Filter and est to ADLS Gen2 (Filtrowanie i pozyskiwanie do usługi ADLS Gen2).

Wprowadź nazwę zadania usługi Stream Analytics, a następnie wybierz pozycję Utwórz.

Określ typ serializacji danych w oknie usługi Event Hubs i metodę uwierzytelniania, która będzie używana przez zadanie w celu nawiązania połączenia z usługą Event Hubs. Następnie wybierz pozycję Połącz.

Jeśli połączenie zostało nawiązane pomyślnie i masz strumienie danych przepływające do wystąpienia usługi Event Hubs, natychmiast zobaczysz dwie rzeczy:

- Pola, które znajdują się w danych wejściowych. Możesz wybrać pozycję Dodaj pole lub wybrać trzy symbol kropki obok każdego pola, aby usunąć, zmienić nazwę lub zmienić jego typ.

- Przykład danych przychodzących w tabeli Podgląd danych w widoku diagramu. Jest on okresowo odświeżany. Możesz wybrać pozycję Wstrzymaj podgląd przesyłania strumieniowego, aby wyświetlić statyczny widok przykładowych danych wejściowych.

- Pola, które znajdują się w danych wejściowych. Możesz wybrać pozycję Dodaj pole lub wybrać trzy symbol kropki obok każdego pola, aby usunąć, zmienić nazwę lub zmienić jego typ.

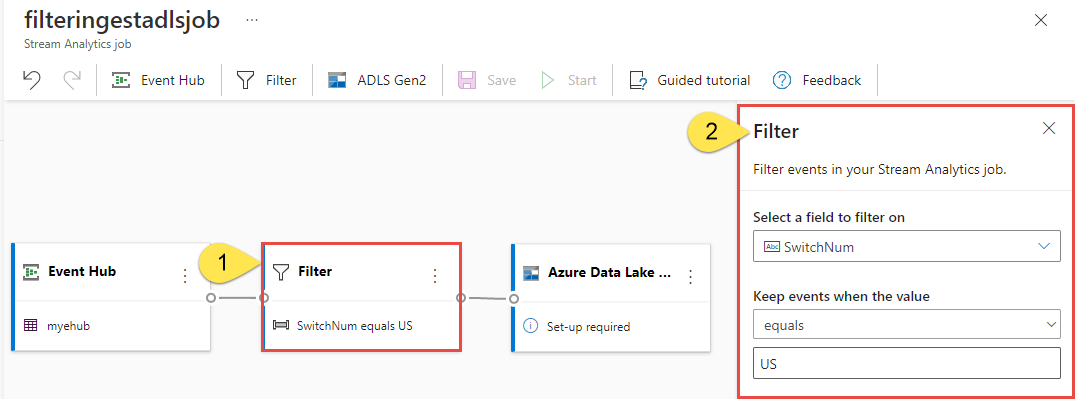

Wybierz kafelek Filtr. W obszarze Filtr wybierz pole, aby filtrować dane przychodzące za pomocą warunku.

Wybierz kafelek Azure Data Lake Storage Gen2. Wybierz konto usługi Azure Data Lake Gen2, aby wysłać przefiltrowane dane:

- Wybierz subskrypcję, nazwę konta magazynu i kontener z menu rozwijanego.

- Po wybraniu subskrypcji należy automatycznie wypełnić metodę uwierzytelniania i klucz konta magazynu. Wybierz pozycję Połącz.

Aby uzyskać więcej informacji na temat pól i zapoznać się z przykładami wzorca ścieżki, zobacz Blob Storage i Azure Data Lake Gen2 output from Azure Stream Analytics (Dane wyjściowe usługi Azure Stream Analytics).

Opcjonalnie wybierz pozycję Pobierz statyczną wersję zapoznawcza/Odśwież statyczną wersję zapoznawcza , aby wyświetlić podgląd danych, który zostanie pozyskany z usługi Azure Data Lake Storage Gen2.

Wybierz pozycję Zapisz , a następnie wybierz pozycję Uruchom zadanie usługi Stream Analytics.

Aby uruchomić zadanie, określ liczbę jednostek przesyłania strumieniowego (SU), z którymi jest uruchamiane zadanie. Jednostki SU reprezentują ilość zasobów obliczeniowych i pamięci przydzielonych do zadania. Zalecamy rozpoczęcie od trzech, a następnie dostosowanie zgodnie z potrzebami.

Po wybraniu pozycji Uruchom zadanie zostanie uruchomione w ciągu dwóch minut, a metryki zostaną otwarte w poniższej sekcji karty.

Zadanie można wyświetlić w sekcji Przetwarzanie danych na karcie Zadania usługi Stream Analytics. Wybierz pozycję Odśwież , dopóki stan zadania nie zostanie wyświetlony jako Uruchomione. Wybierz pozycję Otwórz metryki , aby je monitorować lub zatrzymać i uruchomić ponownie, zgodnie z potrzebami.

Oto przykładowa strona Metryki :

Weryfikowanie danych w usłudze Data Lake Storage

Powinny zostać wyświetlone pliki utworzone w określonym kontenerze.

Pobierz i otwórz plik, aby potwierdzić, że są widoczne tylko przefiltrowane dane. W poniższym przykładzie zobaczysz dane z parametrem SwitchNum ustawionym na stany USA.

{"RecordType":"MO","SystemIdentity":"d0","FileNum":"548","SwitchNum":"US","CallingNum":"345697969","CallingIMSI":"466921402416657","CalledNum":"012332886","CalledIMSI":"466923101048691","DateS":"20220524","TimeType":0,"CallPeriod":0,"ServiceType":"S","Transfer":0,"OutgoingTrunk":"419","MSRN":"1416960750071","callrecTime":"2022-05-25T02:07:10Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:09.5140000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null} {"RecordType":"MO","SystemIdentity":"d0","FileNum":"552","SwitchNum":"US","CallingNum":"012351287","CallingIMSI":"262021390056324","CalledNum":"012301973","CalledIMSI":"466922202613463","DateS":"20220524","TimeType":3,"CallPeriod":0,"ServiceType":"V","Transfer":0,"OutgoingTrunk":"442","MSRN":"886932428242","callrecTime":"2022-05-25T02:07:13Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:12.7350000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null} {"RecordType":"MO","SystemIdentity":"d0","FileNum":"559","SwitchNum":"US","CallingNum":"456757102","CallingIMSI":"466920401237309","CalledNum":"345617823","CalledIMSI":"466923000886460","DateS":"20220524","TimeType":1,"CallPeriod":696,"ServiceType":"V","Transfer":1,"OutgoingTrunk":"419","MSRN":"886932429155","callrecTime":"2022-05-25T02:07:22Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:21.9190000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null}

Zagadnienia dotyczące korzystania z funkcji replikacji geograficznej usługi Event Hubs

Usługa Azure Event Hubs niedawno uruchomiła funkcję replikacji geograficznej w publicznej wersji zapoznawczej. Ta funkcja różni się od funkcji odzyskiwania po awarii geograficznej w usłudze Azure Event Hubs.

Gdy typ trybu failover jest wymuszony , a spójność replikacji jest asynchroniczna, zadanie usługi Stream Analytics nie gwarantuje dokładnie raz danych wyjściowych danych wyjściowych usługi Azure Event Hubs.

Usługa Azure Stream Analytics, jako producent z centrum zdarzeń, może obserwować opóźnienie limitu w zadaniu w czasie trwania pracy w trybie failover i podczas ograniczania przepustowości przez usługę Event Hubs w przypadku opóźnienia replikacji między główną i pomocniczą osiąga maksymalne skonfigurowane opóźnienie.

Usługa Azure Stream Analytics, jako użytkownik z usługą Event Hubs jako dane wejściowe, może obserwować opóźnienie limitu w zadaniu podczas trwania trybu failover i może pominąć dane lub znaleźć zduplikowane dane po zakończeniu pracy w trybie failover.

Ze względu na te zastrzeżenia zalecamy ponowne uruchomienie zadania usługi Stream Analytics z odpowiednim czasem rozpoczęcia bezpośrednio po zakończeniu pracy w trybie failover usługi Event Hubs. Ponadto, ponieważ funkcja replikacji geograficznej usługi Event Hubs jest dostępna w publicznej wersji zapoznawczej, nie zalecamy używania tego wzorca dla produkcyjnych zadań usługi Stream Analytics. Bieżące zachowanie usługi Stream Analytics poprawi się, zanim funkcja replikacji geograficznej usługi Event Hubs będzie ogólnie dostępna i może być używana w zadaniach produkcyjnych usługi Stream Analytics.

Następne kroki

Dowiedz się więcej o usłudze Azure Stream Analytics i sposobie monitorowania utworzonego zadania.