Ocenianie i porównywanie modeli

Po zakończeniu eksperymentu zautomatyzowanego uczenia maszynowego (AutoML) chcesz przejrzeć wytrenowane modele i zdecydować, który z nich osiągnął najlepsze wyniki.

W usłudze Azure Machine Learning Studio możesz wybrać eksperyment AutoML, aby poznać jego szczegóły.

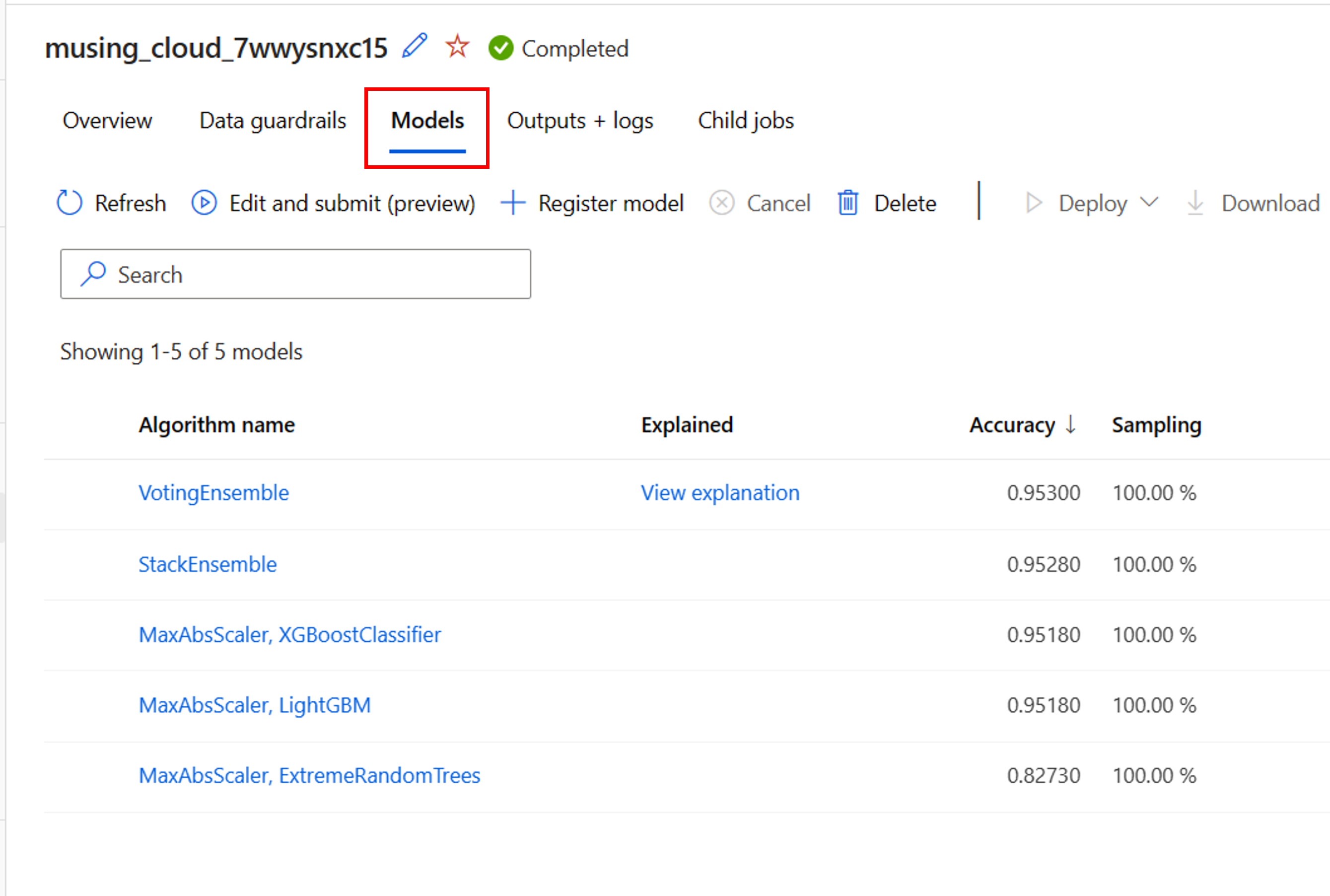

Na stronie Przegląd przebiegu eksperymentu rozwiązania AutoML możesz przejrzeć zasób danych wejściowych i podsumowanie najlepszego modelu. Aby eksplorować wszystkie wytrenowane modele, możesz wybrać kartę Modele :

Eksplorowanie kroków przetwarzania wstępnego

Po włączeniu featuryzacji dla eksperymentu AutoML mechanizmy ochrony danych również są stosowane automatycznie. Trzy zabezpieczenia danych obsługiwane dla modeli klasyfikacji to:

- Wykrywanie równoważenia klas.

- Imputacja brakujących wartości cech.

- Wykrywanie funkcji o wysokiej kardynalności.

Każda z tych barier ochrony danych pokazuje jeden z trzech możliwych stanów:

- Zaliczono: nie wykryto żadnych problemów i nie jest wymagana żadna akcja.

- Gotowe: Zmiany zostały zastosowane do Twoich danych. Należy przejrzeć zmiany wprowadzone w danych przez rozwiązanie AutoML.

- Alerted: Wykryto problem, ale nie można go rozwiązać. Aby rozwiązać ten problem, należy przejrzeć dane.

Obok środków zabezpieczających danych rozwiązanie AutoML może stosować techniki skalowania i normalizacji do każdego wytrenowanego modelu. Możesz przejrzeć technikę zastosowaną na liście modeli w obszarze Nazwa algorytmu.

Na przykład nazwa algorytmu wymienionego modelu może mieć wartość MaxAbsScaler, LightGBM.

MaxAbsScaler odnosi się do techniki skalowania, w której każda funkcja jest skalowana według maksymalnej wartości bezwzględnej.

LightGBM odnosi się do algorytmu klasyfikacji używanego do trenowania modelu.

Pobierz najlepszy przebieg i jego model

Podczas przeglądania modeli w rozwiązaniu AutoML można łatwo zidentyfikować najlepszy przebieg na podstawie określonej metryki podstawowej. W usłudze Azure Machine Learning Studio modele są automatycznie sortowane, aby pokazać najlepszy model u góry.

Na karcie Modele eksperymentu automatycznego uczenia maszynowego możesz edytować kolumny , jeśli chcesz wyświetlić inne metryki w tym samym przeglądzie. Tworząc bardziej kompleksowe omówienie obejmujące różne metryki, można łatwiej porównać modele.

Aby jeszcze bardziej eksplorować model, możesz wygenerować wyjaśnienia dla każdego wytrenowanego modelu. Podczas konfigurowania eksperymentu automatycznego uczenia maszynowego można określić, że wyjaśnienia powinny być generowane dla najlepszego modelu. Jeśli jednak interesuje Cię możliwość interpretacji innego modelu, możesz wybrać model w przeglądzie i wybrać pozycję Wyjaśnij model.

Uwaga / Notatka

Wyjaśnienie modelu jest przybliżeniem możliwości interpretacji modelu. W szczególności wyjaśnienia szacują względne znaczenie funkcji w funkcji docelowej (to, co model jest trenowany do przewidywania). Dowiedz się więcej o możliwościach interpretacji modelu.

Wskazówka

Dowiedz się więcej na temat oceniania przebiegów AutoML.

Rozwiązanie AutoML zapewnia silny punkt wyjścia — wyszukuje szeroko i przedstawia najlepszy algorytm i kombinację przetwarzania wstępnego dla danych. Ale czasami chcesz pójść dalej: dostosować hiperparametry, zaprojektować funkcje niestandardowe lub przetestować podejście, które nie obejmuje rozwiązania AutoML. Tutaj wchodzą do gry notesy.