Seleção de câmera para IA de pesquisa visual do Azure IoT Edge

Um dos componentes mais críticos em um sistema de pesquisa visual computacional é a câmera. A câmera deve capturar e apresentar imagens que os modelos de IA (inteligência artificial) ou ML (aprendizado de máquina) possam avaliar e identificar corretamente. Este artigo fornece uma compreensão detalhada de diferentes tipos de câmera, funcionalidades e considerações.

Tipos de câmeras

Os tipos de câmera incluem verificação de área, verificação de linha e câmeras inteligentes inseridas. Há muitos fabricantes diferentes para essas câmeras. Selecione um fornecedor que atenda às suas necessidades específicas.

Câmeras de verificação de área

As câmeras de verificação de área geram uma imagem de câmera tradicional. Essa câmera normalmente tem uma matriz de sensores de pixel. A câmera captura uma imagem 2D e a envia para o hardware do Azure IoT Edge para avaliação.

As câmeras de verificação de área capturam uma área grande e são boas para detectar alterações. Exemplos de cargas de trabalho que podem usar câmeras de verificação de área são segurança no local de trabalho ou detecção ou contagem de objetos em um ambiente.

Câmeras de verificação de linha

Uma câmera de verificação de linha tem uma única linha de sensores de pixel lineares. A câmera pega imagens de 1 pixel de largura em sucessão rápida, junta-as em um fluxo de vídeo e envia o fluxo ao dispositivo IoT Edge para processamento.

As câmeras de verificação de linha são boas para cargas de trabalho de pesquisa visual em que os itens passam pela câmera ou precisam ser girados para detectar defeitos. Em seguida, a câmera de verificação de linha produz um fluxo de imagem contínuo para avaliação. Exemplos de cargas de trabalho que funcionam melhor com câmeras de verificação de linha são:

- Detecção de defeito de item em partes móveis em uma correia transportadora

- Cargas de trabalho que exigem rotação para ver um objeto cilíndrico

- Cargas de trabalho que exigem rotação

Câmeras inteligentes inseridas

Uma câmera inteligente inserida é um sistema autônomo autocontido que pode processar e adquirir imagens. As câmeras inteligentes inseridas podem usar uma câmera de verificação de área ou de verificação de linha para capturar imagens, embora uma câmera inteligente de verificação de linha seja rara. Essas câmeras geralmente têm uma porta de saída RS232 ou Ethernet, portanto, elas podem se integrar diretamente a um PLC (controlador lógico programável) ou outro controlador IoT industrial (IIoT).

Recursos da câmera

Há vários recursos a serem considerados ao selecionar uma câmera para uma carga de trabalho de pesquisa visual. As seções a seguir discutem o tamanho, a resolução e a velocidade do sensor. Outros recursos de câmera a serem considerados incluem:

- Seleção de lentes

- Distância focal

- Profundidade monocromática ou colorida

- Profundidade estéreo

- Gatilhos

- Tamanho físico

- Suporte

Os fabricantes de câmera podem ajudar você a entender quais recursos específicos seu aplicativo requer.

Tamanho do sensor

O tamanho do sensor é um dos fatores mais importantes a serem avaliados em uma câmera. O sensor é o hardware dentro de uma câmera que captura o destino e o converte em sinais, que produzem uma imagem. O sensor contém milhões de fotodetectores semicondutores chamados de photosites.

Uma contagem de megapixels mais alta nem sempre resulta em uma imagem melhor. Por exemplo, uma câmera com 12 milhões de photosites e um sensor de 1 polegada produz uma imagem mais clara e nítida do que uma câmera com 12 milhões de photosites e um sensor de 1/2 polegada. As câmeras para cargas de trabalho de pesquisa visual computacional geralmente têm tamanhos de sensor entre 1/4 polegada e 1 polegada. Alguns casos podem exigir sensores muito maiores.

Escolha sensores maiores se a sua carga de trabalho de pesquisa visual tiver:

- Necessidade de medidas de precisão

- Condições de luz mais baixa

- Tempos de exposição mais curtos ou itens de movimentação rápida

Resolução

A resolução é outro fator importante na seleção da câmera. Você precisará de câmeras de resolução mais alta se a sua carga de trabalho:

- Precisar identificar recursos finos, como a gravação em um chip de circuito integrado

- Estiver tentando detectar rostos

- Precisar identificar veículos à distância

As imagens a seguir mostram o problema com o uso da resolução errada para determinado caso de uso. Ambas as imagens foram tiradas a 6 metros do carro. As pequenas caixas vermelhas representam um pixel.

A imagem a seguir foi tirada com 480 pixels horizontais:

A imagem a seguir foi tirada com 5.184 pixels horizontais:

Velocidade

Se a carga de trabalho de pesquisa visual exigir a captura de muitas imagens por segundo, dois fatores serão importantes. O primeiro fator é a velocidade da conexão da interface da câmera. O segundo fator é o tipo de sensor. Os sensores vêm em dois tipos, CCD (dispositivos de carga acoplada) e CMOS (sensores de pixel ativo). Os sensores CMOS têm uma leitura direta dos photosites, portanto, normalmente oferecem uma taxa de quadros mais alta.

Posicionamento da câmera

Os itens que você precisa capturar em sua carga de trabalho de pesquisa visual determinam os locais e ângulos para o posicionamento da câmera. O local da câmera também pode interagir com o tipo de sensor, o tipo de lente e o tipo de corpo da câmera. Dois dos fatores mais críticos para determinar o posicionamento da câmera são a iluminação e o campo de exibição.

Iluminação da câmera

Em uma carga de trabalho de pesquisa visual computacional, a iluminação é fundamental para o posicionamento da câmera. É possível aplicar várias condições de iluminação diferentes. As condições de iluminação que são úteis para uma carga de trabalho de visão podem produzir efeitos indesejáveis em uma carga de trabalho diferente.

Há vários tipos de iluminação comuns para cargas de trabalho de pesquisa visual computacional:

- A iluminação direta é a condição de iluminação mais comum. A fonte de luz é projetada no objeto a ser capturado.

- A iluminação de linha é uma única matriz de luzes mais usada com câmeras de verificação de linha. A iluminação de linha cria uma única linha de luz no foco da câmera.

- A iluminação difusa ilumina um objeto, mas evita sombras hostis. A iluminação difusa é usada principalmente em objetos especulares ou reflexivos.

- A iluminação difusa axial é frequentemente usada com objetos altamente reflexivos ou para impedir que sombras na parte a ser capturada.

- A iluminação traseira é usada atrás do objeto, produzindo uma silhueta dele. A iluminação traseira é mais útil para medidas, detecção de borda ou orientação de objeto.

- A iluminação de grade personalizada é uma condição de iluminação estruturada que estabelece uma grade de luz sobre o objeto. A projeção de grade conhecida fornece medidas mais precisas de componentes de item, partes e posicionamento.

- A iluminação estroboscópica é usada para partes móveis de alta velocidade. O estroboscópico deve estar em sincronia com a câmera para fazer um congelamento do objeto para avaliação. A iluminação estroboscópica ajuda a evitar efeitos de desfoque de movimento.

- A iluminação de campo escuro usa várias luzes com ângulos diferentes para a parte a ser capturada. Por exemplo, se a parte estiver plana em uma correia transportadora, as luzes estarão em um ângulo de 45 graus até a correia. A iluminação de campo escuro é mais útil com objetos claros altamente reflexivos e é comumente usada para detecções de arranhões de lente.

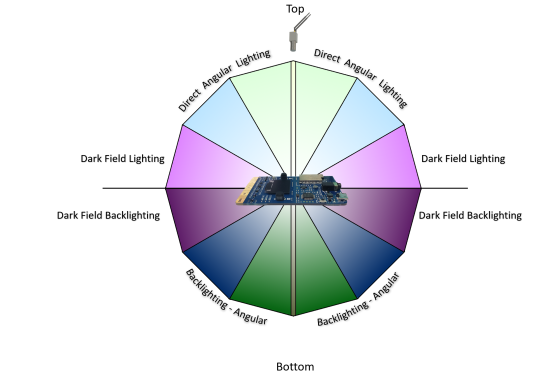

A seguinte figura demonstra o posicionamento angular de fontes de luz:

Campo de visão

Ao planejar uma carga de trabalho de pesquisa visual, você precisa saber sobre o FOV (campo de visão) dos objetos que você está avaliando. O FOV desempenha um papel na seleção da câmera, na seleção do sensor e na configuração das lentes. Os componentes do FOV incluem:

- Distância de objetos. Por exemplo, o objeto está sendo monitorado em uma correia transportadora com a câmera dois metros acima dele ou em um estacionamento? Os sensores de câmera e as configurações das lentes são distintas para diferentes distâncias.

- Área de cobertura. A área que a pesquisa visual computacional está tentando monitorar é pequena ou grande? Esse fator se correlaciona diretamente com a resolução, a lente e o tipo de sensor da câmera.

- Direção do sol. Se a carga de trabalho de pesquisa visual computacional estiver ao ar livre, você deverá considerar a direção do sol ao longo do dia. O ângulo do sol conforme ele se move pode afetar o modelo de pesquisa visual computacional. Se a câmera receber luz solar direta na lente, poderá ficar cega até que o ângulo do sol mude. Se o sol lançar uma sombra sobre o objeto que está sendo monitorado, o objeto poderá ficar obscurecido.

- Ângulo da câmera para os objetos. Se a câmera estiver muito alta ou muito baixa, poderá perder os detalhes que a carga de trabalho está tentando capturar.

Interface de comunicação

Ao planejar uma carga de trabalho de pesquisa visual computacional, é importante entender como a saída da câmera interage com o restante do sistema. Há várias maneiras padrão de comunicação das câmeras com dispositivos IoT Edge:

RTSP (Protocolo de Streaming em Tempo Real) é um protocolo de rede no nível do aplicativo que controla servidores de streaming de vídeo. O RTSP transfere dados de vídeo em tempo real da câmera para o ponto de extremidade computacional do IoT Edge em uma conexão TCP/IP.

O ONVIF (Open Network Video Interface Forum) é um fórum global e aberto do setor que desenvolve padrões abertos para câmeras baseadas em IP. Esses padrões descrevem a comunicação entre câmeras IP e sistemas downstream, interoperabilidade e código aberto.

As câmeras conectadas ao USB (Barramento Serial Universal) conectam-se pela porta USB diretamente ao dispositivo de computação do IoT Edge. Essa conexão é menos complexa, mas limita a distância a que a câmera pode estar localizada desse dispositivo.

A CSI (Interface Serial da Câmera) inclui vários padrões da Aliança MIPI (Mobile Industry Processor Interface). A CSI descreve como se comunicar entre uma câmera e um processador host. A CSI-2, lançada em 2005, tem várias camadas:

- Camada física (C-PHY ou D-PHY)

- Camada de fusão de pista

- Camada de protocolo de baixo nível

- Camada de conversão pixel a byte

- Camada de aplicativo

A CSI-2 v3.0 adicionou suporte para profundidade de cor RAW-24, Link Serial Unificado e Região Inteligente de Interesse.

Colaboradores

Esse artigo é mantido pela Microsoft. Ele foi originalmente escrito pelos colaboradores a seguir.

Autor principal:

- Keith Hill | Gerente Sênior de PM

Para ver perfis não públicos do LinkedIn, entre no LinkedIn.

Próximas etapas

Comentários

Em breve: Ao longo de 2024, eliminaremos os problemas do GitHub como o mecanismo de comentários para conteúdo e o substituiremos por um novo sistema de comentários. Para obter mais informações, consulte https://aka.ms/ContentUserFeedback.

Enviar e exibir comentários de