Filtrar e ingerir para o Azure Data Lake Storage Gen2 usando o editor sem código do Stream Analytics

Este artigo descreve como você pode usar o editor sem código para criar um trabalho do Stream Analytics com facilidade. Ele lê continuamente nos Hubs de Eventos, filtra os dados de entrada e grava os resultados continuamente no Azure Data Lake Storage Gen2.

Pré-requisitos

- Os recursos dos Hubs de Eventos do Azure devem ser acessíveis publicamente e não devem estar protegidos por um firewall ou em uma Rede Virtual do Azure

- Os dados nos Hubs de Eventos devem ser serializados no formato JSON, CSV ou Avro.

Desenvolver um trabalho do Stream Analytics para filtrar e ingerir dados em tempo real

No portal do Azure, localize e selecione a instância dos Hubs de Eventos do Azure.

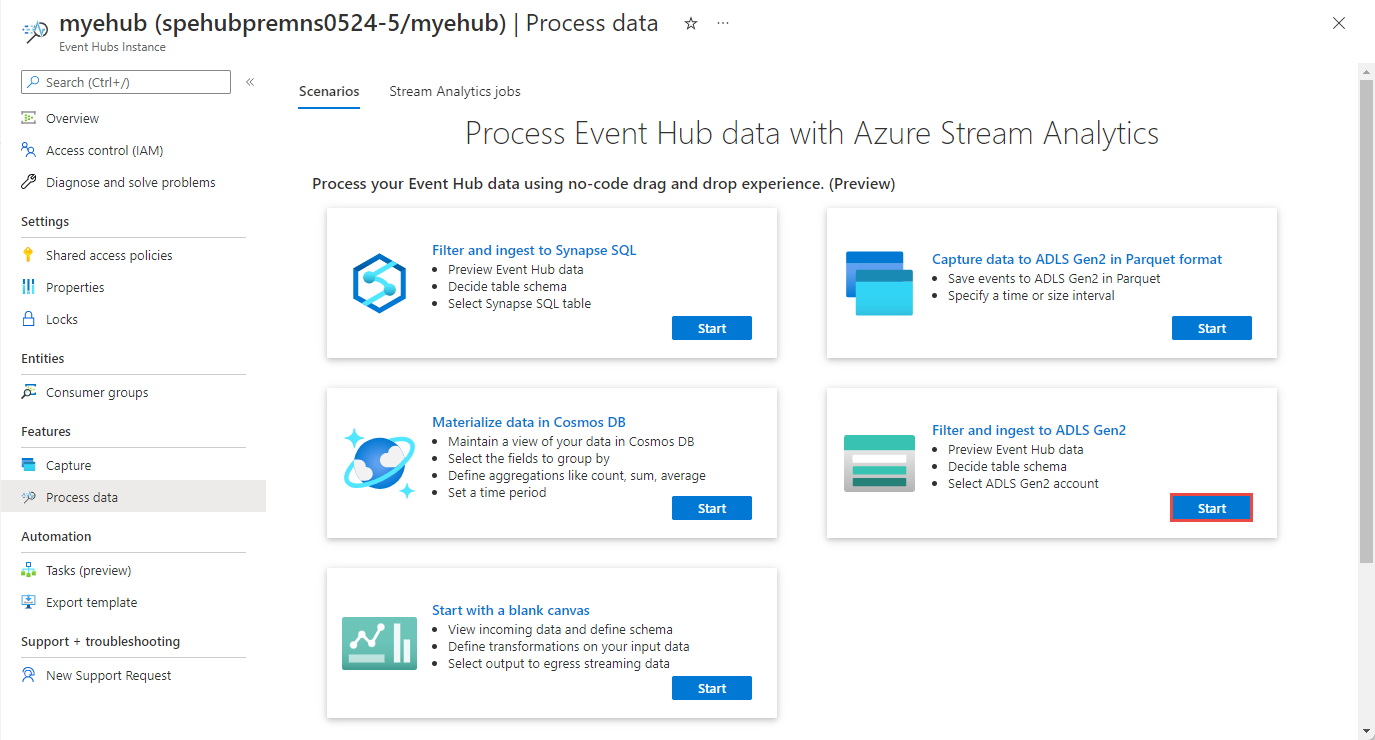

Selecione Recursos>Processar Dados e escolha Iniciar no cartão Filtrar e ingerir para o ADLS Gen2.

Insira um nome para o trabalho do Stream Analytics e selecione Criar.

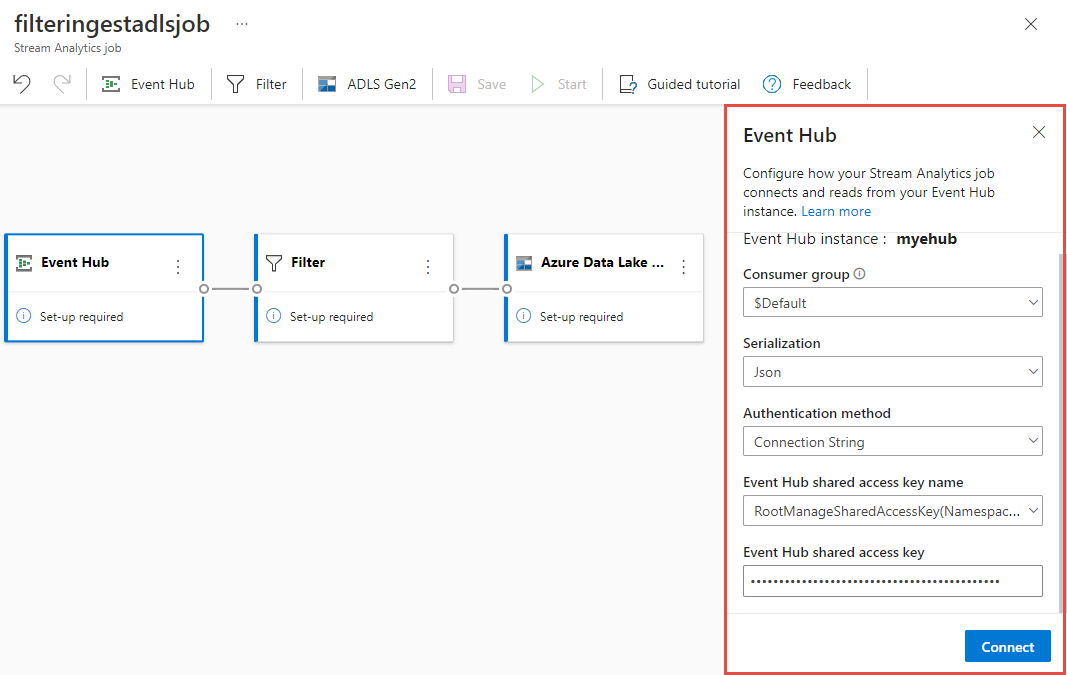

Especifique o tipo de Serialização dos dados na janela Hubs de Eventos e o Método de autenticação que o trabalho usará para se conectar aos Hubs de Eventos. Depois, selecione Conectar.

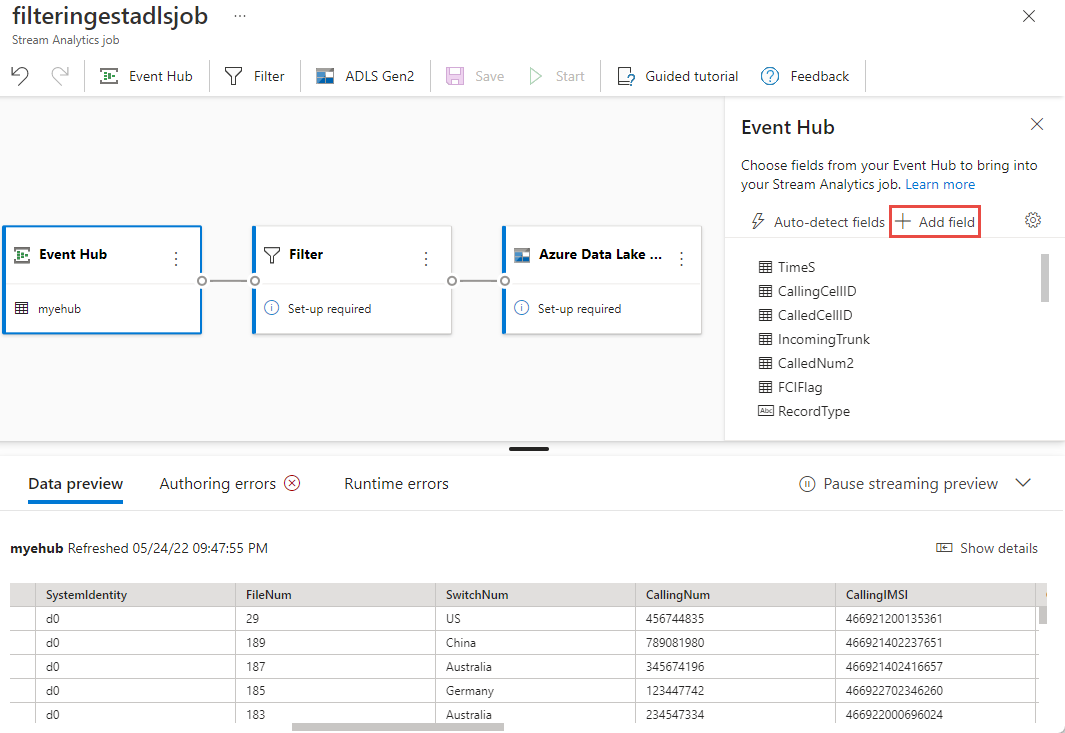

Se a conexão for estabelecida com êxito e você tiver fluxos de dados para a instância dos Hubs de Eventos, você verá duas coisas imediatamente:

- Os campos presentes nos dados de entrada. Você pode escolher Adicionar campo ou selecionar o símbolo de três pontos ao lado de cada campo para remover, renomear ou alterar o tipo.

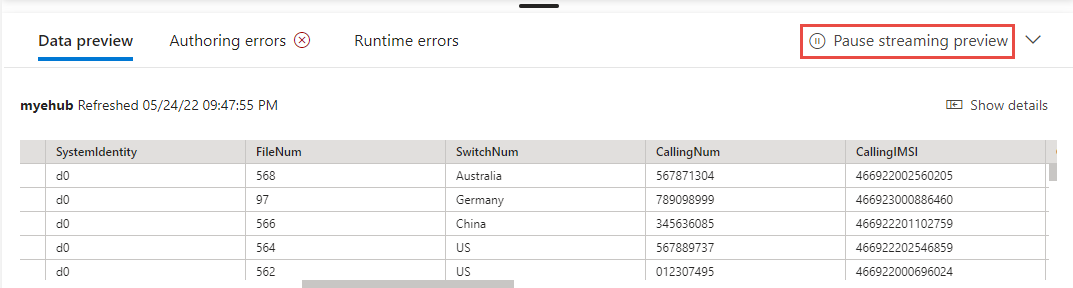

- Um exemplo dinâmico dos dados de entrada na tabela Visualização de dados na exibição de diagrama. Ele é atualizado automaticamente com regularidade. Você pode selecionar Pausar visualização de streaming para ver uma exibição estática dos dados de entrada de exemplo.

- Os campos presentes nos dados de entrada. Você pode escolher Adicionar campo ou selecionar o símbolo de três pontos ao lado de cada campo para remover, renomear ou alterar o tipo.

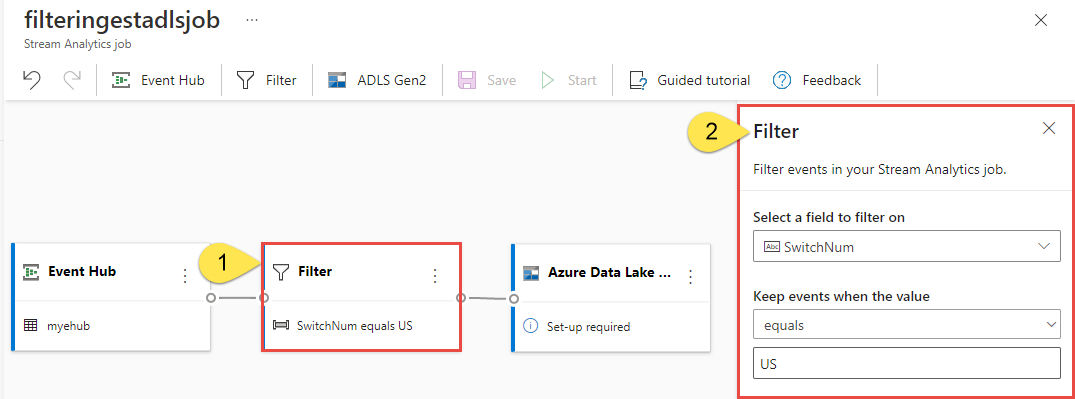

Selecione o bloco de Filtro. Na área Filtro, selecione um campo para filtrar os dados de entrada com uma condição.

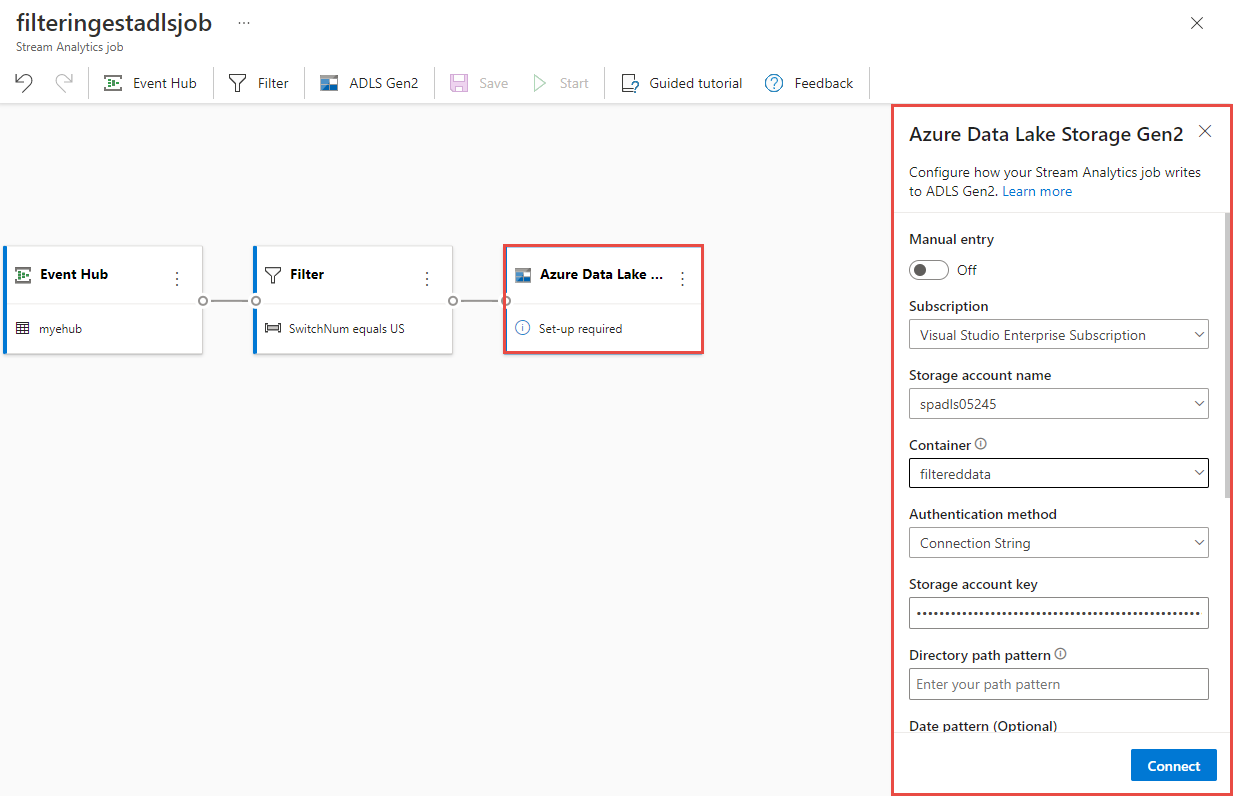

Selecionar o bloco Azure Data Lake Storage Gen2. Selecione a conta do Azure Data Lake Gen2 para enviar os dados filtrados:

- Selecione a assinatura, o nome da conta de armazenamento e o contêiner no menu suspenso.

- Depois que a assinatura for selecionada, o método de autenticação e a chave da conta de armazenamento deverão ser preenchidos automaticamente. Selecione Conectar.

Para obter mais informações sobre os campos e ver exemplos do padrão de caminho, confira Armazenamento de blobs e saída do Azure Data Lake Gen2 no Azure Stream Analytics.

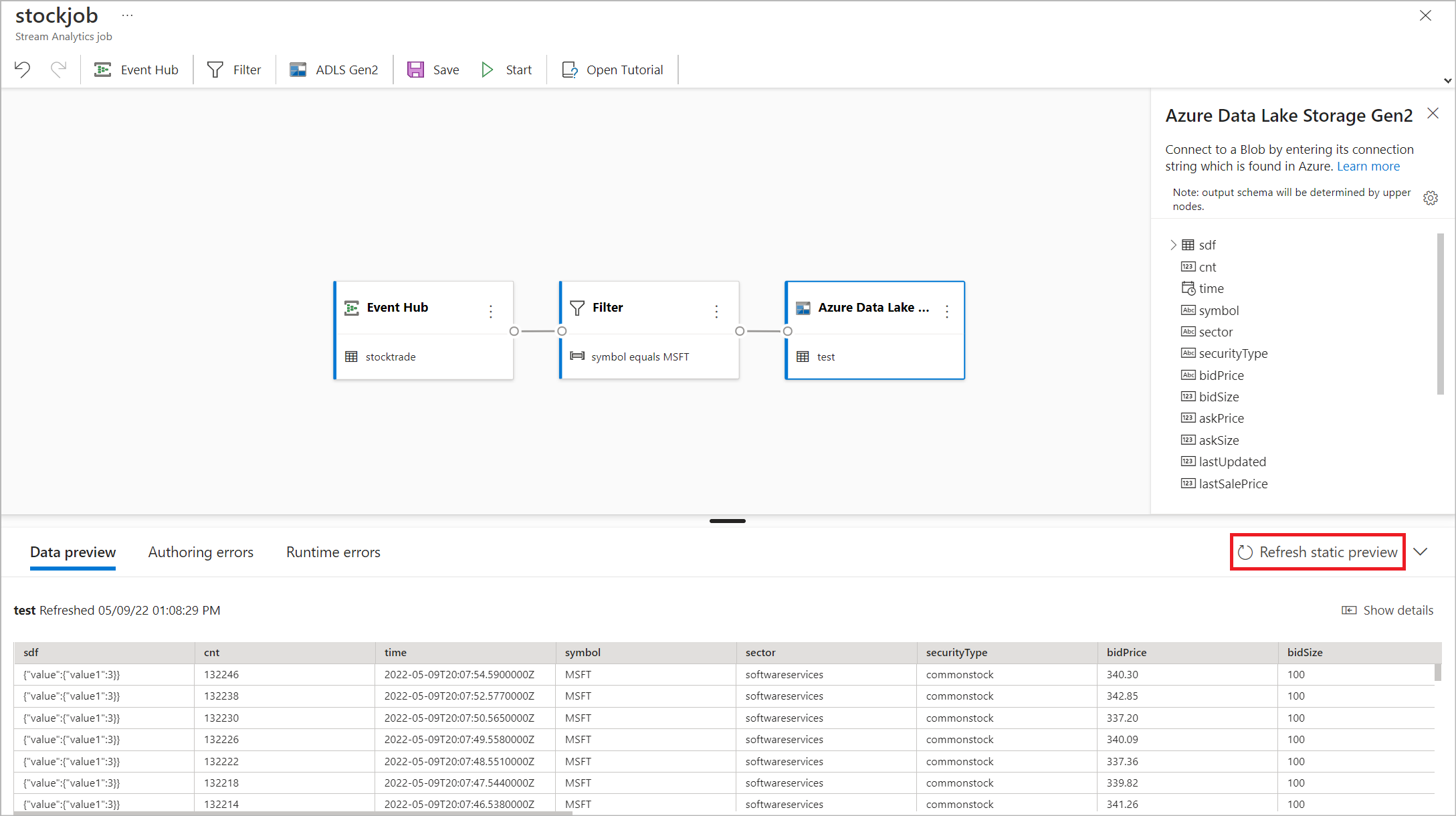

Como alterativa, selecione Obter visualização estática/Atualizar visualização estática para ver a visualização de dados que será ingerida no Azure Data Lake Storage Gen2.

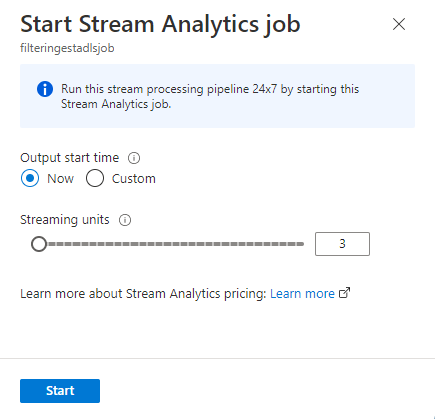

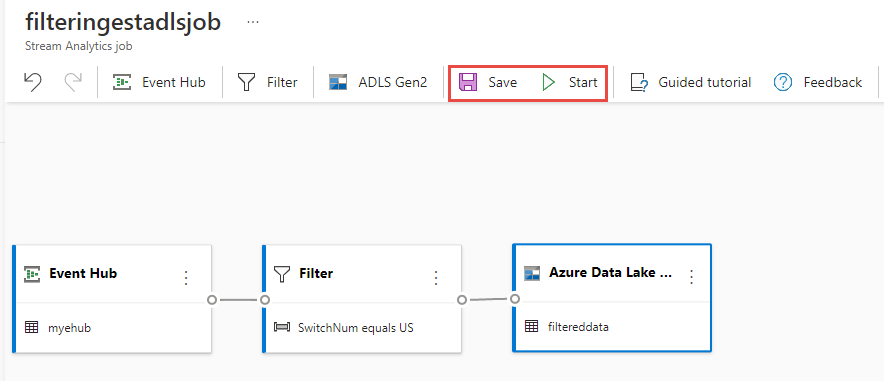

Selecione Salvar e depois escolha Iniciar o trabalho do Stream Analytics.

Para iniciar o trabalho, especifique o número de SUs (Unidades de Streaming) com as quais o trabalho é executado. As SUs representam a quantidade de computação e memória alocada para o trabalho. É recomendável começar com três e depois ajuste conforme necessário.

Depois de selecionar Iniciar, o trabalho começará a ser executado em até dois minutos e as métricas serão abertas na seção da guia abaixo.

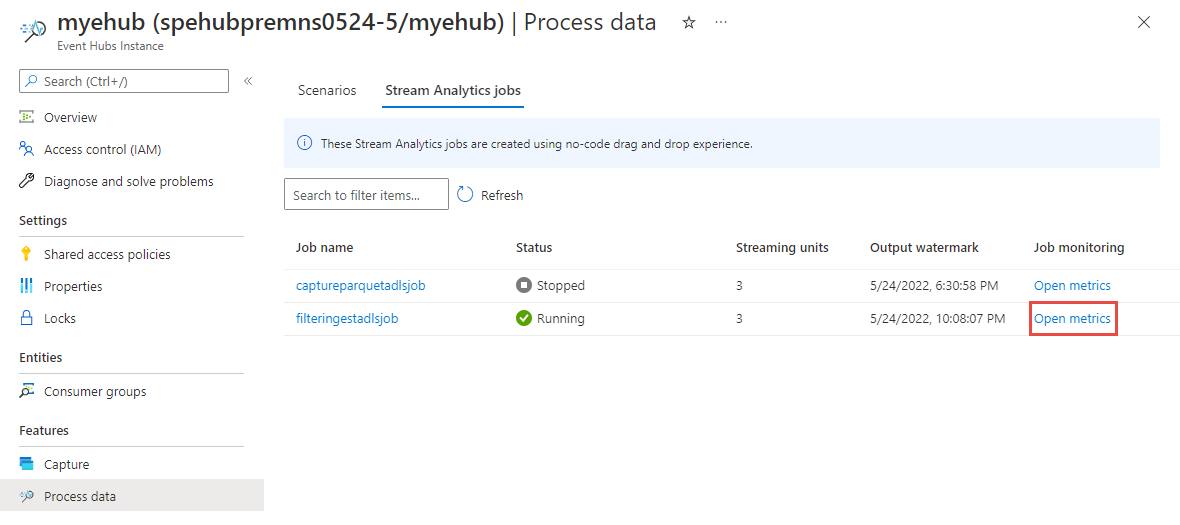

Você pode ver o trabalho na seção de Dados do Processo na guia Trabalhos do Stream Analytics. Selecione Atualizar até ver o status do trabalho como Em execução. Selecione Abrir métricas para monitorá-lo ou interrompê-lo e reiniciá-lo, conforme necessário.

Aqui está uma página de Métricas de amostra:

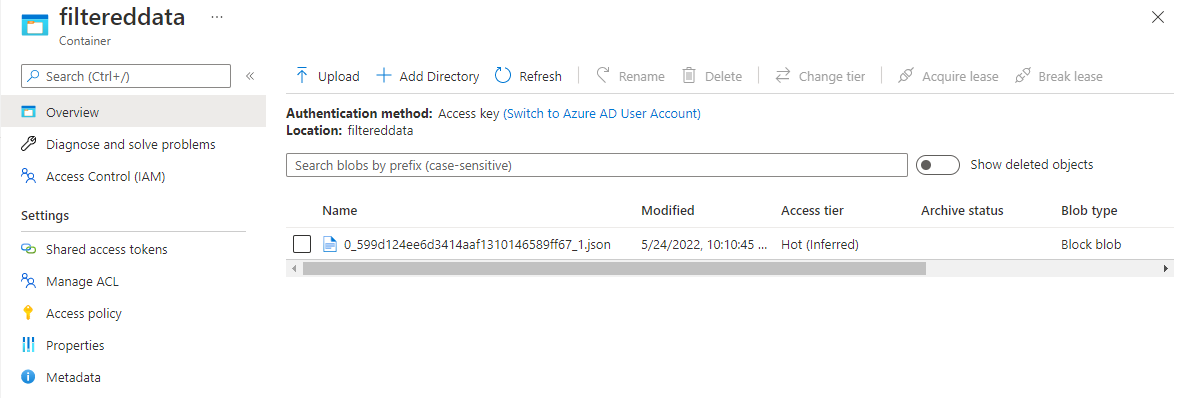

Verificar dados no Data Lake Storage

Deverá ver os arquivos criados no contêiner que indicou.

Baixe e abra o arquivo para confirmar que você vê apenas os dados filtrados. No exemplo a seguir, você verá dados com o SwitchNum definido como EUA.

{"RecordType":"MO","SystemIdentity":"d0","FileNum":"548","SwitchNum":"US","CallingNum":"345697969","CallingIMSI":"466921402416657","CalledNum":"012332886","CalledIMSI":"466923101048691","DateS":"20220524","TimeType":0,"CallPeriod":0,"ServiceType":"S","Transfer":0,"OutgoingTrunk":"419","MSRN":"1416960750071","callrecTime":"2022-05-25T02:07:10Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:09.5140000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null} {"RecordType":"MO","SystemIdentity":"d0","FileNum":"552","SwitchNum":"US","CallingNum":"012351287","CallingIMSI":"262021390056324","CalledNum":"012301973","CalledIMSI":"466922202613463","DateS":"20220524","TimeType":3,"CallPeriod":0,"ServiceType":"V","Transfer":0,"OutgoingTrunk":"442","MSRN":"886932428242","callrecTime":"2022-05-25T02:07:13Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:12.7350000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null} {"RecordType":"MO","SystemIdentity":"d0","FileNum":"559","SwitchNum":"US","CallingNum":"456757102","CallingIMSI":"466920401237309","CalledNum":"345617823","CalledIMSI":"466923000886460","DateS":"20220524","TimeType":1,"CallPeriod":696,"ServiceType":"V","Transfer":1,"OutgoingTrunk":"419","MSRN":"886932429155","callrecTime":"2022-05-25T02:07:22Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:21.9190000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null}

Próximas etapas

Saiba mais sobre o Azure Stream Analytics e como monitorar o trabalho criado.