Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

No estágio anterior deste tutorial, discutimos os pré-requisitos da criação de seu próprio modelo e aplicativo do Windows Machine Learning e baixamos um conjunto de imagens a ser usado. Neste estágio, aprenderemos a usar a interface de Visão Personalizada baseada na Web para transformar nosso conjunto de imagens em um modelo de classificação de imagem.

A Visão Personalizada do Azure é um serviço de reconhecimento de imagem que permite criar, implantar e melhorar seus próprios identificadores de imagem. O Serviço de Visão Personalizada está disponível como um conjunto de SDKs nativos, bem como por meio de uma interface baseada na Web no site da Visão Personalizada.

Criar recursos do Custom Vision e projeto

Criar recurso de Visão Personalizada

Para usar o Serviço de Visão Personalizada, você precisará criar recursos de Visão Personalizada no Azure.

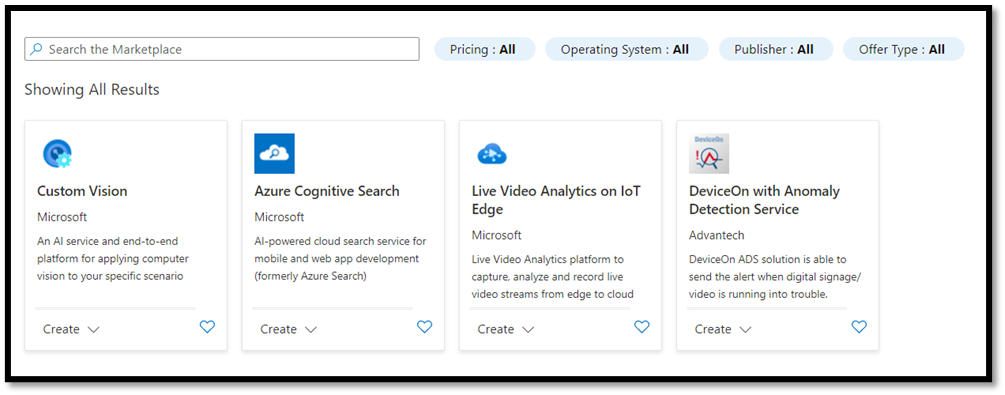

- Navegue até a página principal da sua conta do Azure e selecione

Create a resource.

- Na caixa de pesquisa, pesquise

Custom Visione você entrará no Azure Marketplace. SelecioneCreate Custom Visionpara abrir a janela de diálogo na página Criar Visão Personalizada.

- Na página da caixa de diálogo Visão Personalizada, escolha o seguinte:

- Selecione ambos

TrainingePredictionrecursos. - Selecione a assinatura para gerenciar recursos implantados. Se você não vir sua Assinatura do Azure no menu, saia e reabra sua conta do Azure usando as mesmas credenciais com as quais você abriu sua conta.

- Crie um novo grupo de recursos e dê um nome a ele. Neste tutorial, nós chamamos o nosso de

MLTraining, mas fique à vontade para escolher seu próprio nome ou usar um grupo de recursos existente, caso tenha um. - Dê um nome ao seu projeto. Neste tutorial, chamamos

classificationAppo nosso, mas você pode usar qualquer nome de sua escolha. - Para os recursos

TrainingePrediction, defina o local como (US) Leste dos EUA e o tipo de preço como Free FO.

- Pressione

Review + createpara implantar seus recursos de Visão Personalizada. A implantação dos recursos pode levar alguns minutos.

Criar um novo projeto dentro da Visão Personalizada

Agora que você criou seu recurso, é hora de criar seu projeto de treinamento na Visão Personalizada.

No navegador da Web, navegue até a página visão personalizada e selecione

Sign in. Entre com a mesma conta usada para entrar no Portal do Azure.Selecione

New Projectpara abrir uma nova caixa de diálogo do projeto.

- Crie um novo projeto da seguinte maneira:

Name: Classificação de Alimentos.Description: classificação de diferentes tipos de alimentos.Resource: mantenha o mesmo recurso que você abriu anteriormente –ClassificationApp [F0].Project Types:classificationClassification Types:Multilabel (Multiple tags per image)Domains:Food (compact).Export Capabilities:Basic platforms (Tensorflow, CoreML, ONNX, ...)

Observação

Para exportar para o formato ONNX, verifique se você escolheu o Food (compact) domínio. Domínios não compactos não podem ser exportados para ONNX.

Importante

Se sua conta de entrada estiver associada a uma conta do Azure, a lista suspensa grupo de recursos exibirá todos os grupos de recursos do Azure que incluem um recurso do Serviço de Visão Personalizada. Se nenhum grupo de recursos estiver disponível, confirme se você fez logon no customvision.ai com a mesma conta usada para fazer logon no Portal do Azure.

- Depois de preencher a caixa de diálogo, selecione

Create project.

Carregar o conjunto de dados de treinamento

Agora que você criou seu projeto, você carregará um conjunto de dados previamente preparado de imagens de alimentos dos Datasets Abertos do Kaggle.

Selecione o seu projeto

FoodClassificationpara abrir a interface baseada na Web do site da Visão Personalizada.Selecione o

Add imagesbotão e escolhaBrowse local files.

Navegue até o local do conjunto de dados da imagem e selecione a pasta de treinamento –

vegetable-fruit. Selecione todas as imagens na pasta e selecioneopen. A opção de etiquetagem será aberta.Insira

vegetable-fruitnoMy Tagscampo e pressioneUpload.

Aguarde até que o primeiro grupo de imagens seja carregado em seu projeto e pressione done. A seleção de etiqueta será aplicada a todo o grupo de imagens selecionadas que você escolheu para carregar. É por isso que é mais fácil carregar imagens de grupos de imagens já pré-criados. Você pode sempre alterar as etiquetas das imagens individuais depois que elas forem carregadas.

- Depois que o primeiro grupo de imagens for carregado com êxito, repita o processo mais duas vezes para carregar as imagens de sobremesa e sopa. Certifique-se de etiquetá-las com marcas relevantes.

No final, você terá três grupos diferentes de imagens prontas para treinamento.

Treinar o classificador de modelo

Agora você treinará o modelo para classificar os legumes, sopa e sobremesas do conjunto de imagens baixadas na parte anterior.

- Para iniciar o processo de treinamento, selecione o

Trainbotão no canto superior direito. O classificador usará as imagens para criar um modelo que identifique as qualidades visuais de cada marca.

Há uma opção para alterar o limite de probabilidade usando o controle deslizante no canto superior esquerdo. O limite de probabilidade define o nível de confiança que uma previsão precisa ter para ser considerada correta. Se o limite de probabilidade for muito alto, você obterá uma classificação mais correta, mas menos serão detectados. Por outro lado, se o limite de probabilidade for muito baixo, você detectará muito mais classificações, mas com uma confiança menor ou resultados positivos mais falsos.

Neste tutorial, você pode manter o limite de probabilidade em 50%.

- Aqui, usaremos o

Quick Trainingprocesso.Advanced Trainingtem mais configurações e permite definir especificamente o tempo usado para treinamento, mas não precisamos desse nível de controle aqui. PressioneTrainpara iniciar o processo de treinamento.

Um processo de treinamento rápido levará apenas alguns minutos para ser concluído. Durante este período, as informações sobre o processo de treinamento são exibidas na guia Performance.

Avaliar e testar

Avaliar os resultados

Depois que o treinamento for concluído, você verá o resumo da primeira iteração de treinamento. Ele inclui a estimativa do desempenho do modelo – Precisão e Recall.

- A precisão indica a fração de classificações identificadas que estavam corretas. Em nosso modelo, a precisão é de 98,2%, portanto, se nosso modelo classificar uma imagem, é muito provável que ela seja prevista corretamente.

- Orecall indica a fração das classificações reais que foram identificadas corretamente. Em nosso modelo, o recall é 97,5%, portanto, nosso modelo classifica corretamente a grande maioria das imagens apresentadas a ele.

- AP significa Desempenho Adicional. Ele fornece uma métrica adicional que resume a precisão e o recall em limites diferentes.

Testar o modelo

Antes de exportar o modelo, você pode testar seu desempenho.

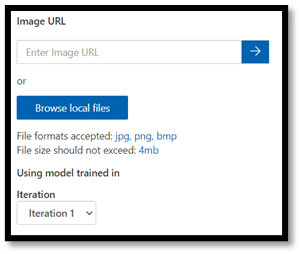

- Selecione

Quick Testno canto superior direito da barra de menus superior para abrir uma nova janela de teste.

Nesta janela, você pode fornecer uma URL da imagem para testar ou selecionar Browse local files usar uma imagem armazenada localmente.

- Escolha

Browse local files, navegue até o conjunto de dados de alimentos e abra uma pasta de validação. Escolha qualquer imagem aleatória nafruit-vegetablepasta e pressioneopen.

O resultado do teste será exibido na tela. Em nosso teste, o modo classificou com êxito a imagem com 99,8% certeza.

Você pode usar a previsão para treinamento na guia Predictions, que pode aprimorar o desempenho do modelo. Para obter mais informações, consulte Como melhorar seu classificador.

Observação

Interessados em aprender mais sobre as APIs Custom Vision do Azure? A documentação do Serviço de Visão Personalizada tem mais informações sobre o portal da Web e o SDK da Visão Personalizada.

Exportar o modelo para ONNX

Agora que treinamos nosso modelo, podemos exportá-lo para o ONNX.

- Selecione a guia

Performancee, em seguida, escolhaExportpara abrir uma janela de exportação.

- Selecione

ONNXpara exportar seu modelo para o formato ONNX.

- Você pode escolher a opção

ONNX 16float se necessário, mas neste tutorial não precisamos alterar nenhuma configuração. SelecioneExport and Download.

- Abra o arquivo .zip baixado e extraia o arquivo

model.onnxdele. Esse arquivo contém o modelo de classificador.

Parabéns! Você criou e exportou com êxito o modelo de classificação.

Próximas etapas

Agora que temos um modelo de classificação, a próxima etapa é criar um aplicativo do Windows e executá-lo localmente em seu dispositivo Windows.