Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Observação

Este artigo aplica-se ao Databricks Connect for Databricks Runtime 13.3 LTS e superior.

O Databricks Connect permite ligar IDEs populares como PyCharm, servidores de notebooks e outras aplicações personalizadas ao Azure Databricks compute. Consulte Databricks Connect.

Este artigo demonstra como começar rapidamente com o Databricks Connect para Python usando PyCharm. Você criará um projeto no PyCharm, instalará o Databricks Connect for Databricks Runtime 13.3 LTS e superior e executará código simples na computação clássica em seu espaço de trabalho Databricks do PyCharm.

Requerimentos

Para concluir este tutorial, você deve atender aos seguintes requisitos:

- O seu espaço de trabalho, ambiente local e computação cumprem os requisitos do Databricks Connect para Python. Consulte Requisitos de uso do Databricks Connect.

- Você tem o PyCharm instalado. Este tutorial foi testado com o PyCharm Community Edition 2023.3.5. Se você usar uma versão ou edição diferente do PyCharm, as instruções a seguir podem variar.

- Se você estiver usando computação clássica, precisará da ID do cluster. Para obter a ID do cluster, no espaço de trabalho, clique em Computação na barra lateral e, em seguida, clique no nome do cluster. Na barra de endereço do navegador da Web, copie a cadeia de caracteres entre

clusterseconfigurationno URL.

Passo 1: Configurar a autenticação do Azure Databricks

Este tutorial utiliza autenticação utilizador-para-máquina (U2M) Azure Databricks OAuth (U2M) e um perfil Azure Databricks configuration para autenticação no seu espaço de trabalho Azure Databricks. Para usar um tipo de autenticação diferente, consulte Configurar propriedades de conexão.

A configuração da autenticação U2M do OAuth requer a CLI do Databricks. Para obter informações sobre como instalar a CLI do Databricks, consulte Instalar ou atualizar a CLI do Databricks.

Inicie a autenticação OAuth U2M, da seguinte maneira:

Use a CLI do Databricks para iniciar o gerenciamento de token OAuth localmente executando o seguinte comando para cada espaço de trabalho de destino.

No comando seguinte, substitua

<workspace-url>pelo URL do seu Azure Databricks por espaço de trabalho, por exemplohttps://adb-1234567890123456.7.azuredatabricks.net.databricks auth login --configure-cluster --host <workspace-url>Sugestão

Para usar a computação sem servidor com o Databricks Connect, consulte Configurar uma conexão com computação sem servidor.

A CLI do Databricks pede-lhe para guardar a informação que introduziu como um perfil de configuração do Azure Databricks. Pressione

Enterpara aceitar o nome de perfil sugerido ou digite o nome de um perfil novo ou existente. Qualquer perfil existente com o mesmo nome é substituído pelas informações que você inseriu. Você pode usar perfis para alternar rapidamente seu contexto de autenticação em vários espaços de trabalho.Para obter uma lista de quaisquer perfis existentes, em um terminal ou prompt de comando separado, use a CLI do Databricks para executar o comando

databricks auth profiles. Para visualizar as configurações existentes de um perfil específico, execute o comandodatabricks auth env --profile <profile-name>.No seu navegador web, complete as instruções no ecrã para iniciar sessão no seu espaço de trabalho do Azure Databricks.

Na lista de clusters disponíveis que aparece no seu terminal ou prompt de comandos, use as teclas de seta para cima e para baixo para selecionar o cluster do Azure Databricks alvo no seu ambiente de trabalho e depois pressione

Enter. Você também pode digitar qualquer parte do nome de exibição do cluster para filtrar a lista de clusters disponíveis.Para exibir o valor atual do token OAuth de um perfil e o carimbo de data/hora de expiração do token, execute um dos seguintes comandos:

databricks auth token --host <workspace-url>databricks auth token -p <profile-name>databricks auth token --host <workspace-url> -p <profile-name>

Se tiver vários perfis com o mesmo valor

--host, talvez seja necessário especificar as opções--hoste-pem conjunto para ajudar a interface de linha de comando do Databricks a encontrar as informações corretas do token OAuth.

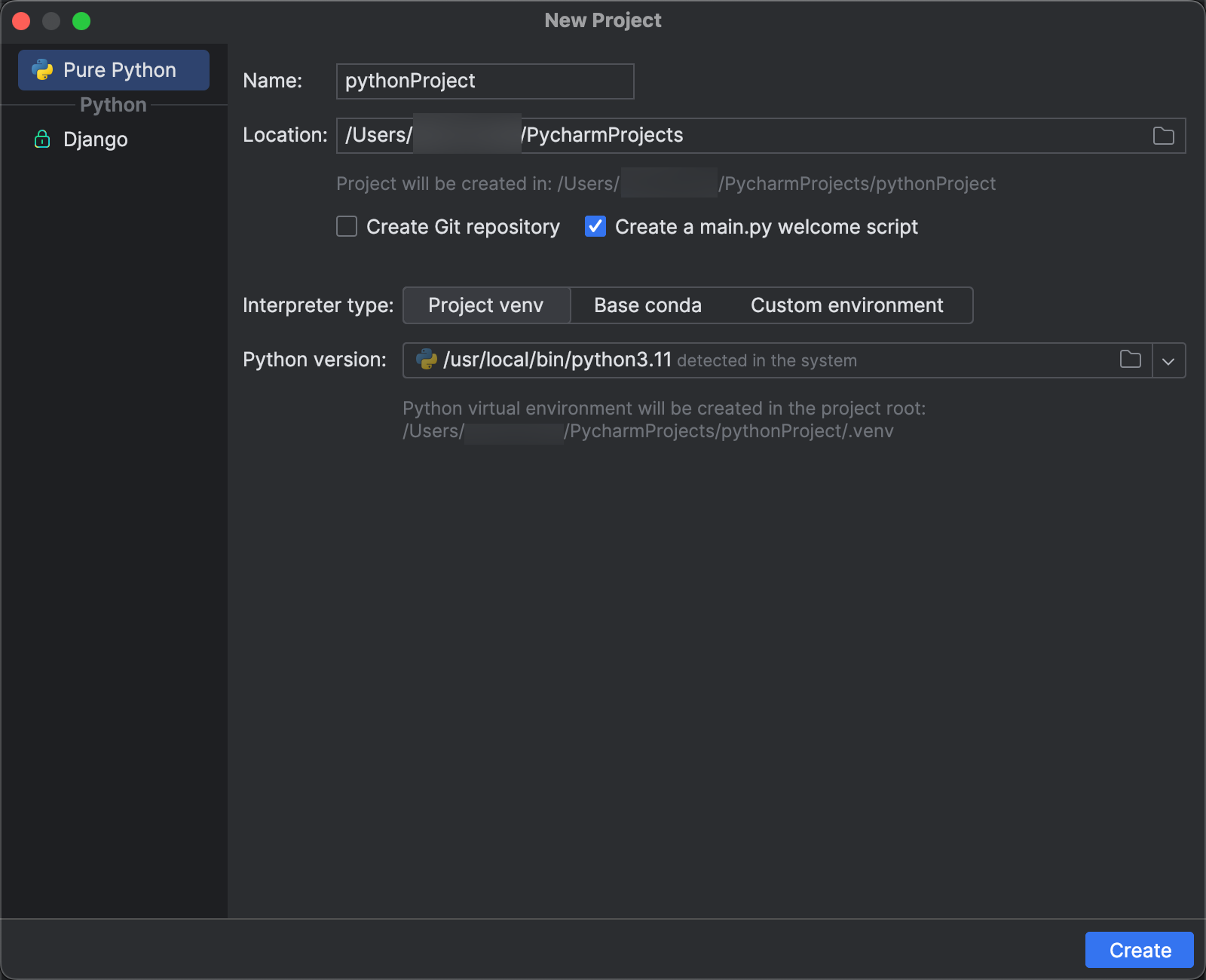

Etapa 2: Criar o projeto

- Inicie o PyCharm.

- No menu principal, clique em Ficheiro > Novo Projeto.

- No diálogo Novo Project, clique em Pure Python.

- Para Localização, clique no ícone da pasta e complete as instruções no ecrã para especificar o caminho para o seu novo projeto Python.

- Deixe a opção Criar um script de boas-vindas main.py selecionada.

- Para Interpreter type, clique em Project venv.

- Expanda versão do Python e use o ícone da pasta ou a lista suspensa para especificar o caminho ao interpretador Python a partir dos requisitos anteriores.

- Clique em Criar.

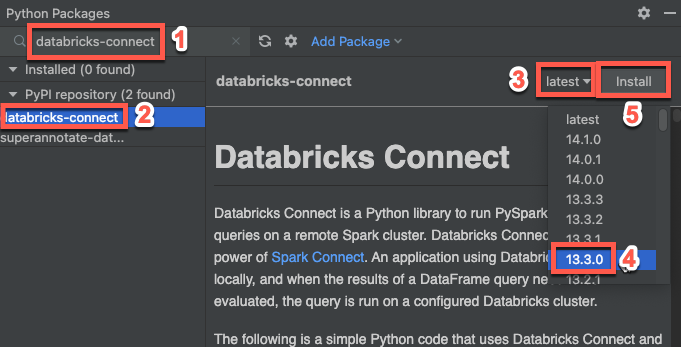

Etapa 3: Adicionar o pacote Databricks Connect

- No menu principal do PyCharm, clique em Ver > Ferramenta Windows > Python Pacotes.

- Na caixa de pesquisa, digite

databricks-connect. - Na lista do repositório PyPI, clique em databricks-connect.

- Na lista suspensa mais recente do painel de resultados, selecione a versão que corresponde à versão do Databricks Runtime do cluster. Por exemplo, se o cluster tiver o Databricks Runtime 14.3 instalado, selecione 14.3.1.

- Clique em Instalar pacote.

- Depois de instalar o pacote, pode fechar a janela Python Pacotes.

Passo 4: Adicionar código

Na janela da ferramenta Project, clique com o botão direito na pasta raiz do project e clique em Novo > Python Ficheiro.

Introduza

main.pye clique duas vezes em ficheiro Python.Insira o seguinte código no arquivo e salve-o, dependendo do nome do seu perfil de configuração.

Se o seu perfil de configuração da Etapa 1 for nomeado

DEFAULT, insira o seguinte código no arquivo e salve o arquivo:from databricks.connect import DatabricksSession spark = DatabricksSession.builder.getOrCreate() df = spark.read.table("samples.nyctaxi.trips") df.show(5)Se o seu perfil de configuração da Etapa 1 não for nomeado

DEFAULT, insira o código a seguir no arquivo. Substitua o espaço reservado<profile-name>pelo nome do seu perfil de configuração na Etapa 1 e salve o arquivo:from databricks.connect import DatabricksSession spark = DatabricksSession.builder.profile("<profile-name>").getOrCreate() df = spark.read.table("samples.nyctaxi.trips") df.show(5)

Etapa 5: Executar o código

- Inicia o cluster alvo no teu espaço de trabalho remoto do Azure Databricks.

- Depois que o cluster for iniciado, no menu principal, clique em Executar > executar 'main'.

- Na janela de ferramentas Run (View > Tool Windows > Run), no separador Run do painel principal main, aparecem as primeiras 5 linhas do

samples.nyctaxi.trips.

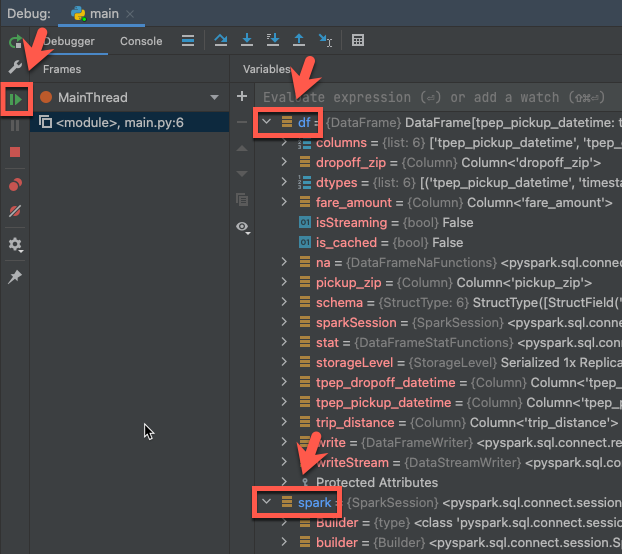

Etapa 6: Depurar o código

- Com o cluster ainda em execução, no código anterior, clique na margem ao lado de

df.show(5)para definir um ponto de interrupção. - No menu principal, clique em >.

- Na janela de ferramentas Debug (Ver > Janelas de Ferramentas > Debug), no separador Debugger do painel Variables, expanda os nós de variáveis df e spark para consultar informações sobre as variáveis de

dfesparkdo código. - Na barra lateral da janela da ferramenta Depurar , clique no ícone de seta verde (Retomar Programa).

- No painel Console da guia Depurador, as primeiras 5 linhas do

samples.nyctaxi.tripssão exibidas.