Diagnóstico de uma longa etapa no Spark

Comece por identificar a fase mais longa do trabalho. Desloque-se para a parte inferior da página do trabalho até à lista de etapas e ordene-as por duração:

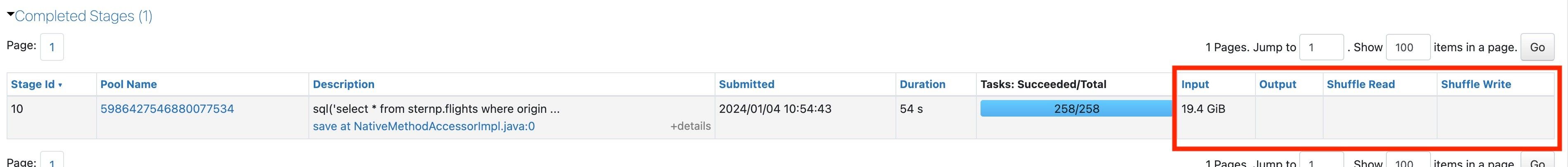

Detalhes de E/S do estágio

Para ver dados de alto nível sobre o que esse estágio estava fazendo, observe as colunas Entrada, Saída, Leitura aleatória e Gravação aleatória:

As colunas significam o seguinte:

- Entrada: Quantos dados esta etapa leu do armazenamento. Isso pode ser lido de Delta, Parquet, CSV, etc.

- Saída: Quantos dados este estágio gravou no armazenamento. Isso pode ser escrever para Delta, Parquet, CSV, etc.

- Shuffle Read: Quantos dados aleatórios esta etapa leu.

- Shuffle Write: Quantos dados aleatórios esta etapa escreveu.

Se você não está familiarizado com o que é shuffle, agora é um bom momento para aprender o que isso significa.

Anote esses números, pois provavelmente precisará deles mais tarde.

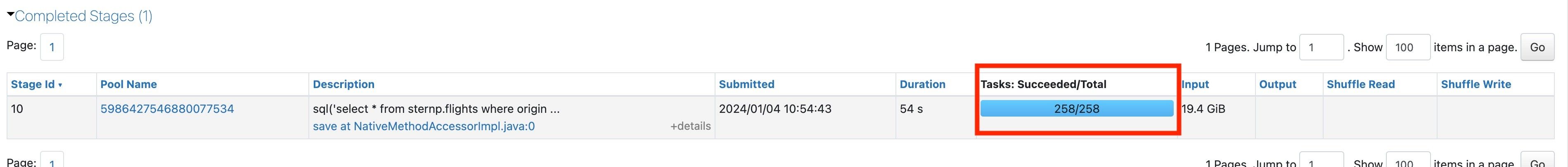

Número de tarefas

O número de tarefas no estágio longo pode apontar na direção do seu problema. Você pode determinar o número de tarefas consultando aqui:

Se você vir uma tarefa, isso pode ser um sinal de um problema. Para obter mais informações, consulte Tarefa One Spark.

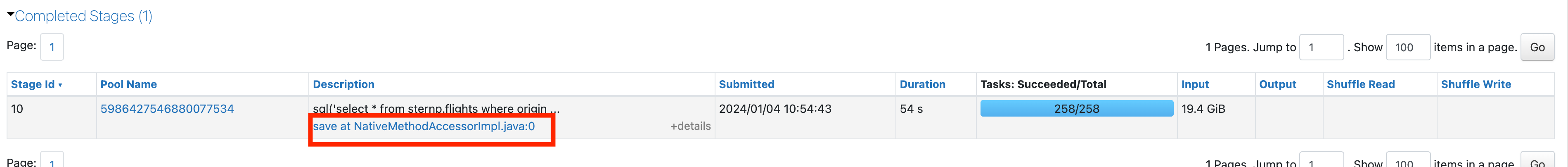

Ver mais detalhes do palco

Se o estágio tiver mais de uma tarefa, você deve investigar mais. Clique no link na descrição do estágio para obter mais informações sobre o estágio mais longo:

Agora que você está na página do palco, veja Inclinação e derramamento.

Comentários

Brevemente: Ao longo de 2024, vamos descontinuar progressivamente o GitHub Issues como mecanismo de feedback para conteúdos e substituí-lo por um novo sistema de feedback. Para obter mais informações, veja: https://aka.ms/ContentUserFeedback.

Submeter e ver comentários