Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

À medida que as organizações utilizam cada vez mais modelos de inteligência artificial (IA) para impulsionar automação, insights e tomada de decisões inteligentes, as equipas de segurança precisam de visibilidade e controlo para avaliar a segurança e conformidade dos modelos de IA que entram nos seus ambientes. Estes modelos têm frequentemente amplo acesso a dados e infraestruturas. Sem estas capacidades, torna-se cada vez mais difícil aplicar normas internas.

O Defender para Cloud da Microsoft oferece segurança para IA suportando a análise de modelos de IA. A varredura de modelos por IA proporciona deteção proativa de artefactos inseguros ou maliciosos e monitoriza continuamente os modelos para riscos ao longo de todo o ciclo de vida da IA.

A segurança dos modelos de IA analisa automaticamente os modelos de IA à procura de riscos de segurança, como malware embutido, operadores inseguros e segredos expostos antes de esses modelos entrarem em produção. Integrado diretamente com Azure Machine Learning e pipelines CI/CD, o serviço revela descobertas em tempo real e orientações acionáveis de remediação, permitindo que as equipas possam travar modelos arriscados no início do processo de desenvolvimento.

Ao utilizar a segurança dos modelos de IA, as equipas de segurança podem analisar modelos de IA personalizados carregados em espaços de trabalho e registos de Aprendizagem Automática do Azure para identificar ameaças como malware embutido, operadores inseguros e segredos expostos. O Defender for Cloud apresenta os resultados, proporcionando às equipas visibilidade sobre as conclusões de segurança, juntamente com classificações de gravidade, orientações para remediação e metadados relevantes do modelo para apoiar uma triagem e priorização eficazes. Os programadores também podem desencadear varreduras de modelos durante as fases de construção ou lançamento, utilizando ferramentas de CLI integradas com pipelines Azure DevOps ou GitHub, permitindo varredura estática e deteção precoce de risco antes de os modelos entrarem em produção.

Pré-requisitos

- Deve ter uma subscrição do Azure que contenha modelos de IA registados nos registos ou espaços de trabalho do Azure Machine Learning (Azure Machine Learning).

Observação

Espaços de trabalho e registos que usam um link privado não são suportados.

Ativar o plano de Gestão de Postura de Segurança do Defender para Cloud.

Deve ativar a proteção contra ameaças para serviços de IA e o componente de segurança do modelo de IA do plano.

Permissões necessárias: Para ativar o plano, precisa de permissões ao nível de Proprietário ou Contribuinte nos recursos de Machine Learning do Azure.

Formatos de ficheiro de modelo suportados:

Pickle (.pkl),HDF5 (.h5),TorchScript (.pt)ONNX (.onnx),SafeTensors (.safetensors),TensorFlow SavedModel / TFLite (FlatBuffers),NumPy (.npy),Arrow, MsgPack, dill, joblib, .PMML, JSON, POJO, MOJO, GGUFLimite de tamanho do ficheiro: 10 GB. Ficheiros de modelo com mais de 10 GB não podem ser digitalizados.

A ecografia ocorre uma vez por semana.

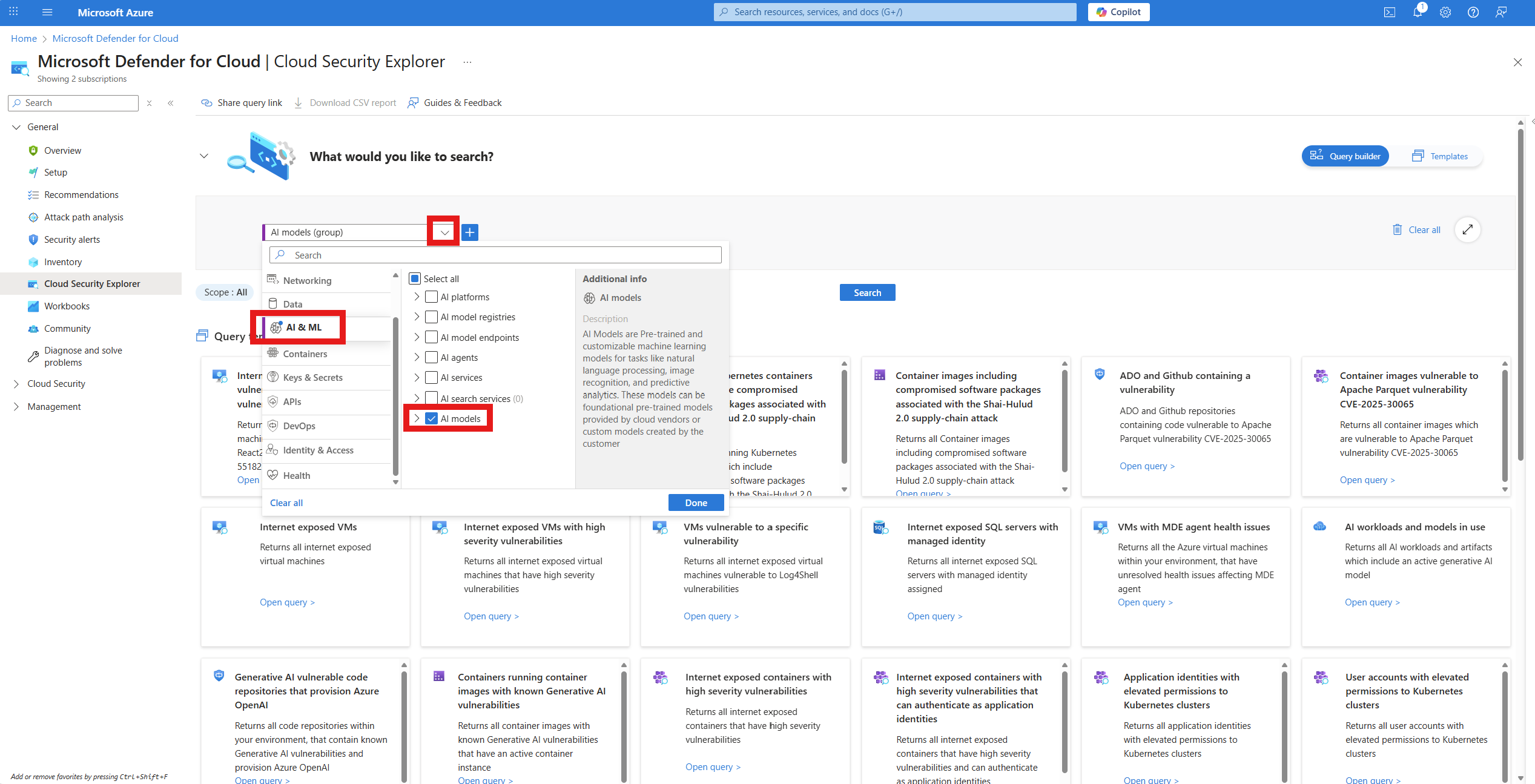

Localize todos os modelos de IA no seu ambiente

Inicie sessão no portal Azure.

Procure e selecione Microsoft Defender for Cloud.

Selecione Cloud Security Explorer.

Selecione AI & Mls>modelos de IA.

Selecione Concluído.

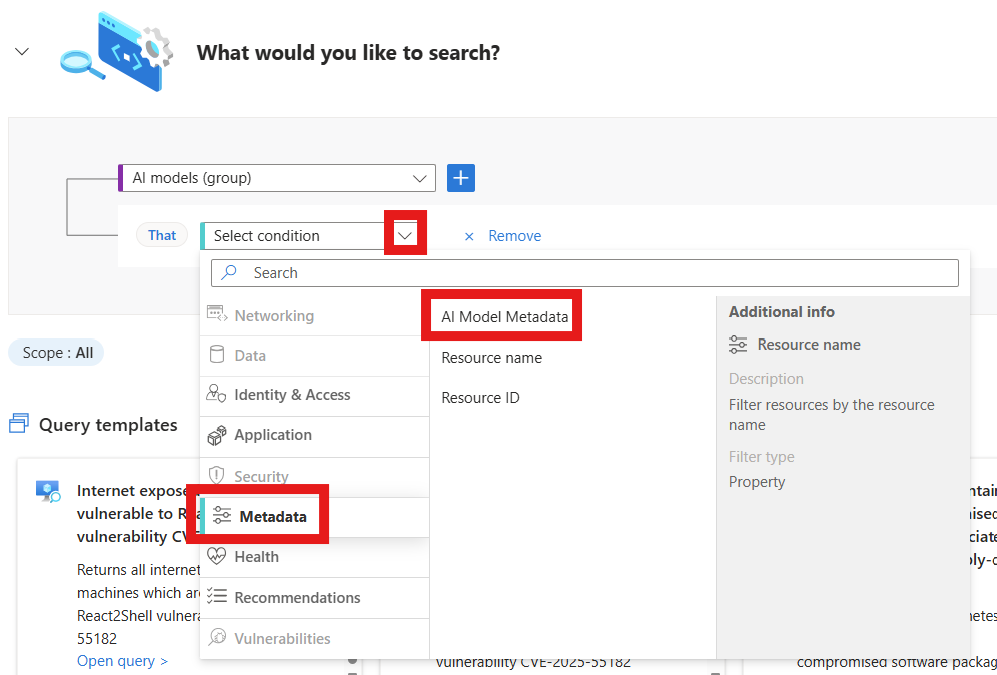

Selecione +.

Selecione Metadados>Metadados do Modelo de IA.

Selecione Pesquisar.

O Cloud Security Explorer apresenta todos os modelos de IA no seu ambiente. Pode selecionar ver detalhes para obter mais informações sobre cada modelo selecionado.

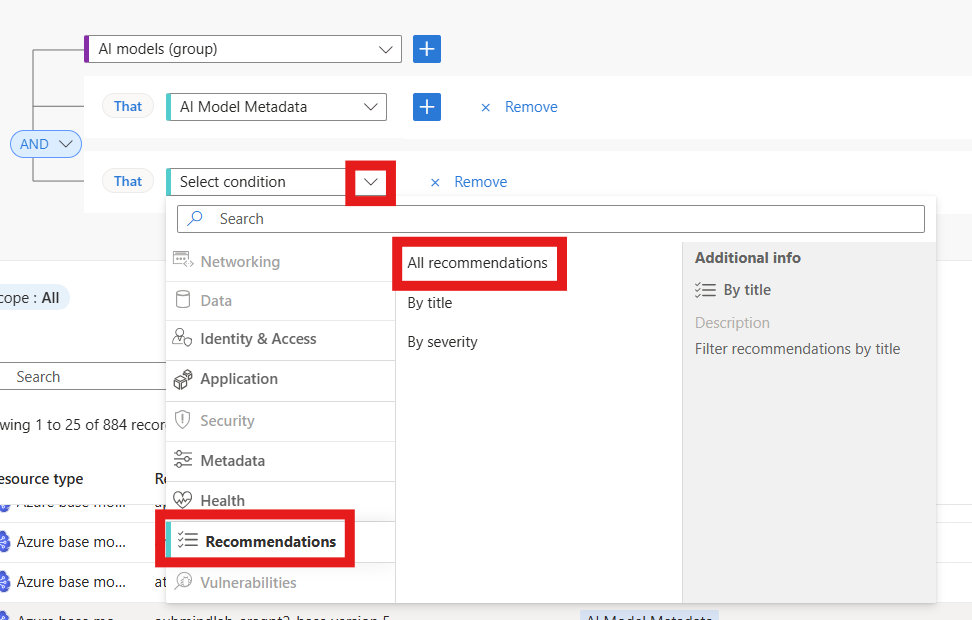

Localizar modelos de IA com descobertas de segurança

Use o Cloud Security Explorer para encontrar modelos de IA que tenham descobertas ativas de segurança.

Siga os passos 1 a 7 da secção Localizar todos os modelos de IA no seu ambiente .

Selecione +.

Selecionar Recomendações>Todas as recomendações.

Selecione Pesquisar.

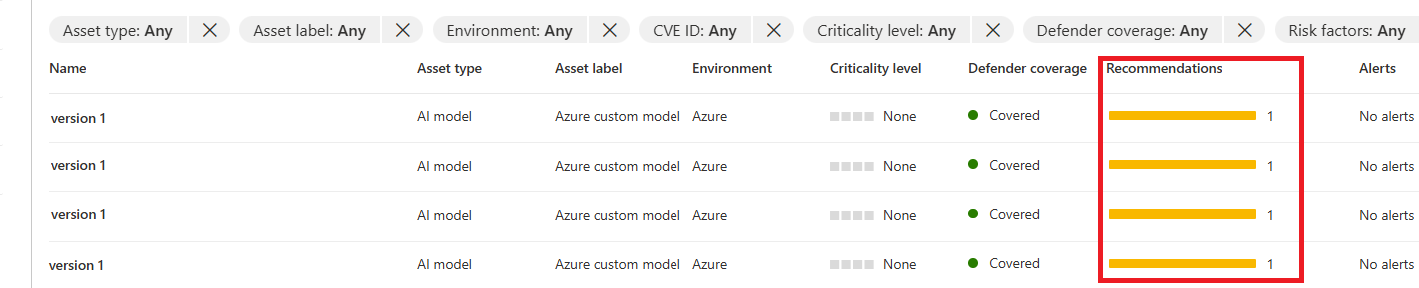

O Cloud Security Explorer apresenta todos os modelos de IA no seu ambiente que tenham descobertas ativas de segurança. Selecione ver detalhes para ver mais informações sobre cada modelo e as descobertas associadas.

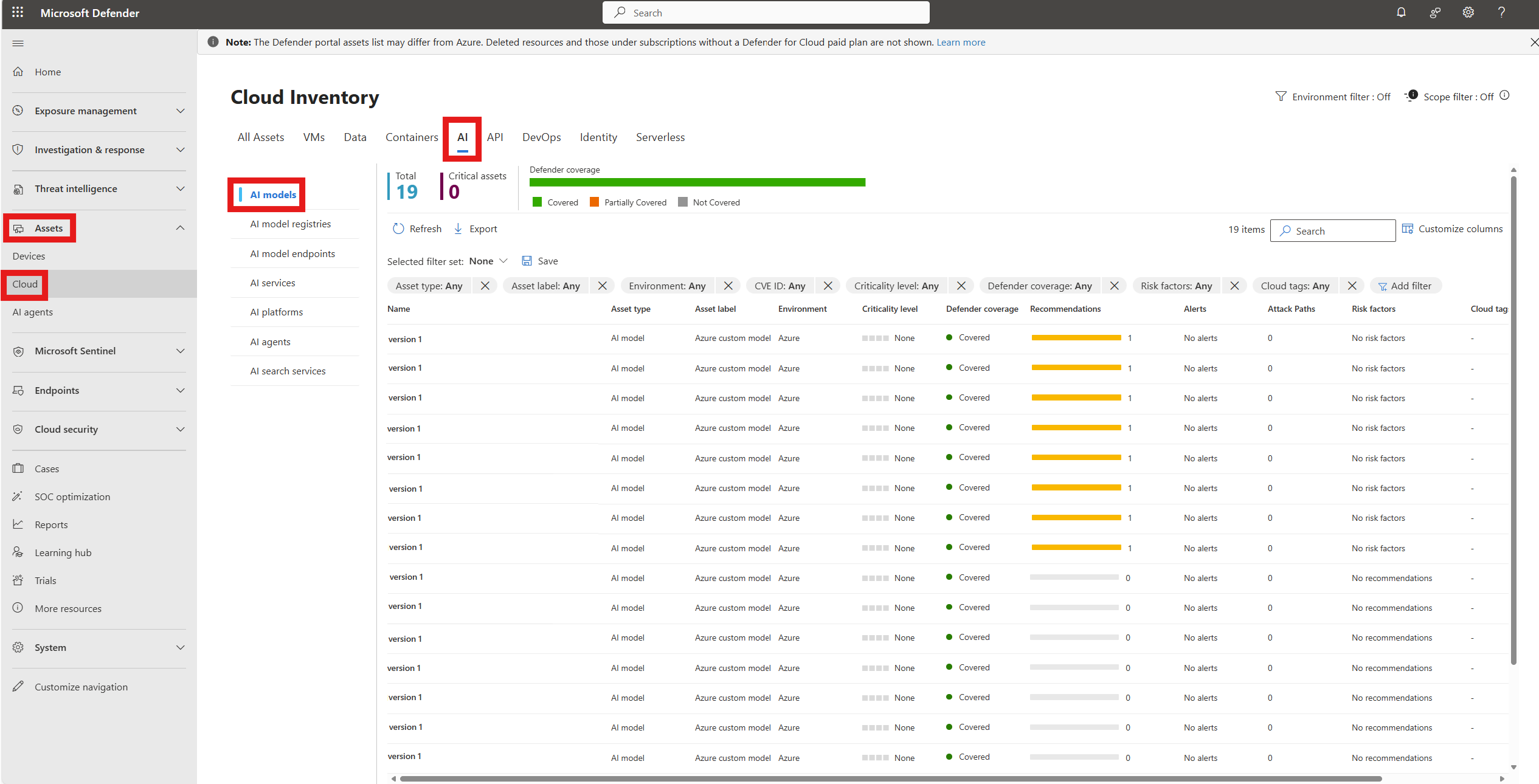

Localize todos os modelos de IA no seu ambiente

A página de Recursos do portal Defender oferece uma visão abrangente de todos os modelos de IA no seu ambiente.

Inicie sessão no portal Microsoft Defender.

Vá aAssets>Cloud>IA>modelos de IA.

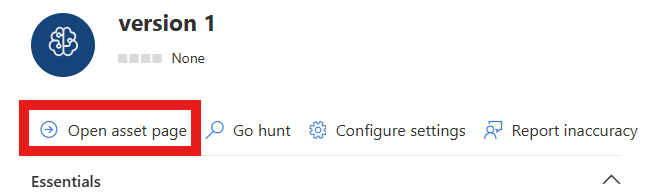

Selecione um modelo de IA com recomendações.

Selecionar Abrir página de ativo.

Selecione as recomendações> de segurança relevantes.

Revise e remedie a descoberta de segurança conforme necessário.

Também pode gerir a recomendação no portal Azure.