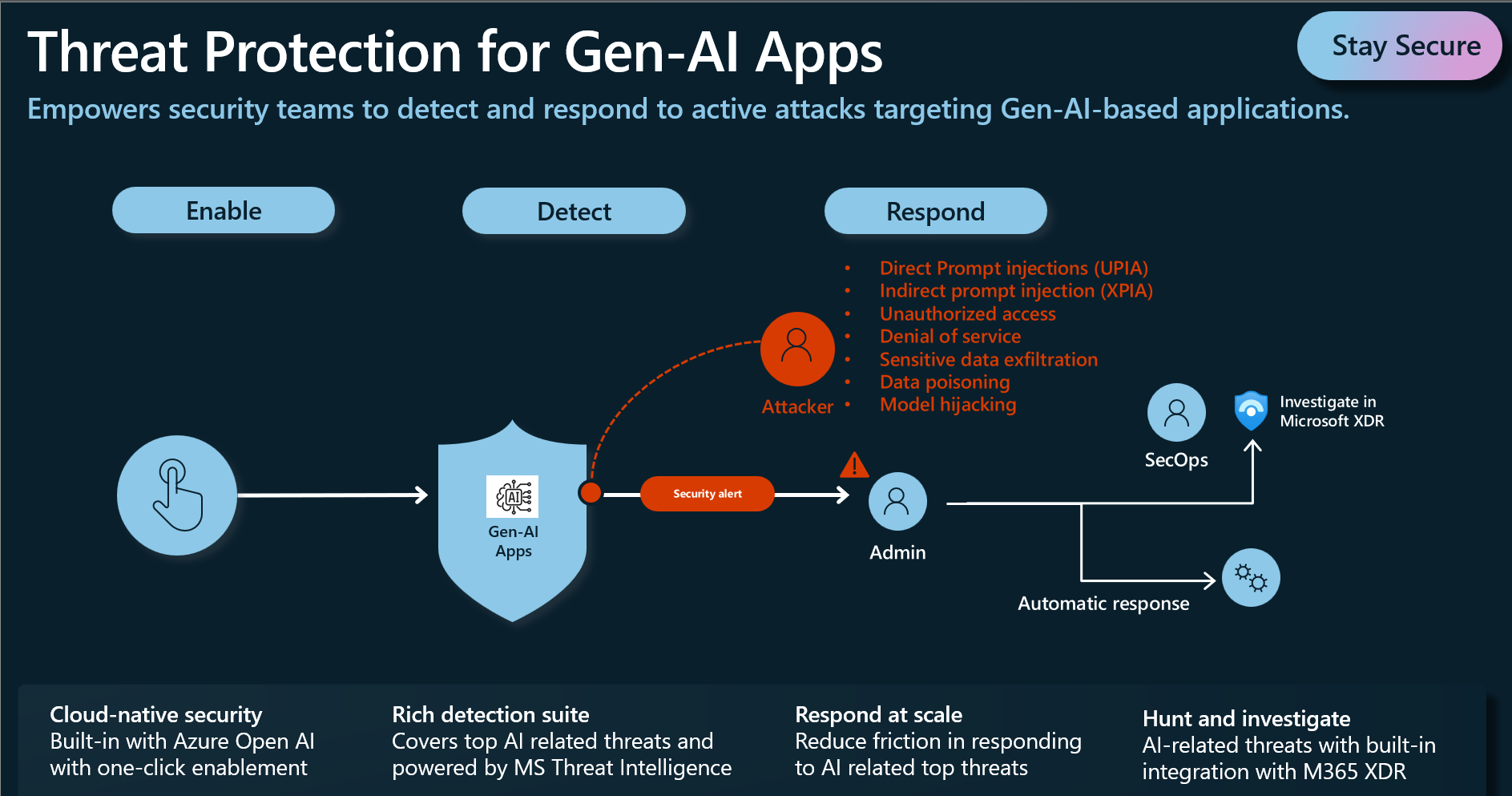

Visão geral - Proteção contra ameaças de IA

A proteção contra ameaças para cargas de trabalho de IA no Microsoft Defender for Cloud identifica continuamente ameaças a aplicativos de IA generativos em tempo real e auxilia no processo de resposta para problemas de segurança que possam existir em aplicativos de IA generativos.

Importante

A proteção contra ameaças para cargas de trabalho de IA está atualmente em visualização. Veja Termos de Utilização Complementares da Pré-visualizações do Microsoft Azure para obter os termos legais que se aplicam às funcionalidades do Azure que estão na versão beta, na pré-visualização ou que ainda não foram lançadas para disponibilidade geral.

A proteção contra ameaças de IA do Defender for Cloud integra-se com os Azure AI Content Safety Prompt Shields e os sinais de inteligência de ameaças da Microsoft para fornecer alertas de segurança contextuais e acionáveis associados a uma série de ameaças, como vazamento de dados confidenciais, envenenamento de dados, jailbreak e roubo de credenciais.

Nota

A proteção contra ameaças para cargas de trabalho de IA depende da filtragem de conteúdo do Azure OpenAI para alertas acionados pela base de prompt. Se você desativar os alertas de gatilho baseados em prompts e remover esse recurso, isso poderá afetar a capacidade do Defender for Cloud de monitorar e detetar esses ataques.

Integração com o Defender XDR

A proteção contra ameaças para cargas de trabalho de IA integra-se ao Defender XDR, permitindo que as equipes de segurança centralizem alertas sobre cargas de trabalho de IA no portal Defender XDR.

As equipes de segurança podem correlacionar alertas e incidentes de cargas de trabalho de IA no portal Defender XDR e obter uma compreensão de todo o escopo de um ataque, incluindo atividades maliciosas associadas a seus aplicativos de IA generativos a partir do painel XDR.

Inscrever-se para a pré-visualização pública limitada

Para usar a proteção contra ameaças para cargas de trabalho de IA, você deve se inscrever no programa de visualização pública limitada preenchendo o formulário de registro.

Conteúdos relacionados

Comentários

Brevemente: Ao longo de 2024, vamos descontinuar progressivamente o GitHub Issues como mecanismo de feedback para conteúdos e substituí-lo por um novo sistema de feedback. Para obter mais informações, veja: https://aka.ms/ContentUserFeedback.

Submeter e ver comentários