Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

O processamento prioritário oferece desempenho de baixa latência com a flexibilidade do pay-as-you-go. Neste artigo, ativa o processamento prioritário numa implementação de modelo, verifica qual o nível de serviço que processou os seus pedidos e monitoriza os custos associados.

Pré-requisitos

- Uma subscrição Azure - Crie uma gratuitamente.

- Um projeto Microsoft Foundry com um modelo do tipo de implantação

GlobalStandardouDataZoneStandardimplantado. - Versão

2025-12-01da API ou posterior.

Principais casos de uso

- Consistência e baixa latência para experiências de utilizador responsivas.

- Simplicidade de pagar conforme o uso , sem compromissos a longo prazo.

- Tráfego durante o horário comercial ou com picos que beneficia de um desempenho escalável e eficiente em termos de custos. Opcionalmente, pode combinar o processamento prioritário com Unidades de Débito Provisionadas (PTU) para uma capacidade estável e otimização de custos.

Meta de latência

| Modelo | Valor alvo de latência 2 |

|---|---|

| GPT-5.4, 2026-03-051 | 99% > 50 tokens por segundo |

| GPT-5.2, 2025-12-11 | 99% > 50 tokens por segundo |

| GPT-5.1, 13-11-2025 | 99% > 50 tokens por segundo |

| GPT-4.1, 2025-04-141 | 99% > 80 tokens por segundo |

1 Pedidos de contexto longo (isto é, pedidos estimados em mais de 128k tokens de prompt) serão degradados para processamento padrão e serás cobrado à taxa de nível padrão.

2 Calculado como uma latência de pedido p50 por 5 minutos.

Disponibilidade de processamento prioritário por tipo de implementação

O processamento prioritário pode ser ativado em implementações com padrão Global ou em implementações padrão de Zona de Dados (EUA). Para informações sobre preços, consulte a página de preços do Azure OpenAI.

Disponibilidade global de modelos padrão

| Região | GPT-5.4, 05-03-2026 | GPT-5.2, 2025-12-11 | GPT-5.1, 2025-11-13 | GPT-4.1, 2025-04-14 |

|---|---|---|---|---|

| leste da Austrália | - | ✅ | ✅ | ✅ |

| Brasil Sul | - | ✅ | ✅ | ✅ |

| CanadáCentral | - | ✅ | ✅ | ✅ |

| Canadá Leste | - | ✅ | ✅ | ✅ |

| Centralus | - | ✅ | ✅ | ✅ |

| Eastus | - | ✅ | ✅ | ✅ |

| eastus2 | - | - | - | - |

| FranceCentral | - | ✅ | ✅ | ✅ |

| Alemanha Oeste Central | - | ✅ | ✅ | ✅ |

| ItáliaNorte | - | ✅ | ✅ | ✅ |

| JapãoLeste | - | ✅ | ✅ | ✅ |

| Coreia Central | - | ✅ | ✅ | ✅ |

| northcentralus | - | ✅ | ✅ | ✅ |

| Noruega Oriental | - | ✅ | ✅ | ✅ |

| Polónia Central | ✅ | ✅ | ✅ | ✅ |

| southafricanorth | - | ✅ | ✅ | ✅ |

| southcentralus | ✅ | ✅ | ✅ | ✅ |

| southeastasia | - | ✅ | ✅ | ✅ |

| Sul da Índia | - | ✅ | ✅ | ✅ |

| spaincentral | - | ✅ | ✅ | ✅ |

| suécia central | ✅ | ✅ | ✅ | ✅ |

| suíçanorte | - | ✅ | ✅ | ✅ |

| switzerlandwest | - | ✅ | ✅ | ✅ |

| uaenorth | - | ✅ | ✅ | ✅ |

| UKSOUTH | - | ✅ | ✅ | ✅ |

| Europa Ocidental | - | ✅ | ✅ | ✅ |

| westus | - | ✅ | ✅ | ✅ |

| Westus3 | - | ✅ | ✅ | ✅ |

Ativar o processamento prioritário ao nível de implementação

Pode ativar o processamento prioritário ao nível de implementação e (opcionalmente) ao nível do pedido.

Observação

O processamento prioritário pode ser ativado em implementações de padrão Global ou de Zona de Dados (EUA). O processamento prioritário utiliza a mesma quota que o processamento padrão.

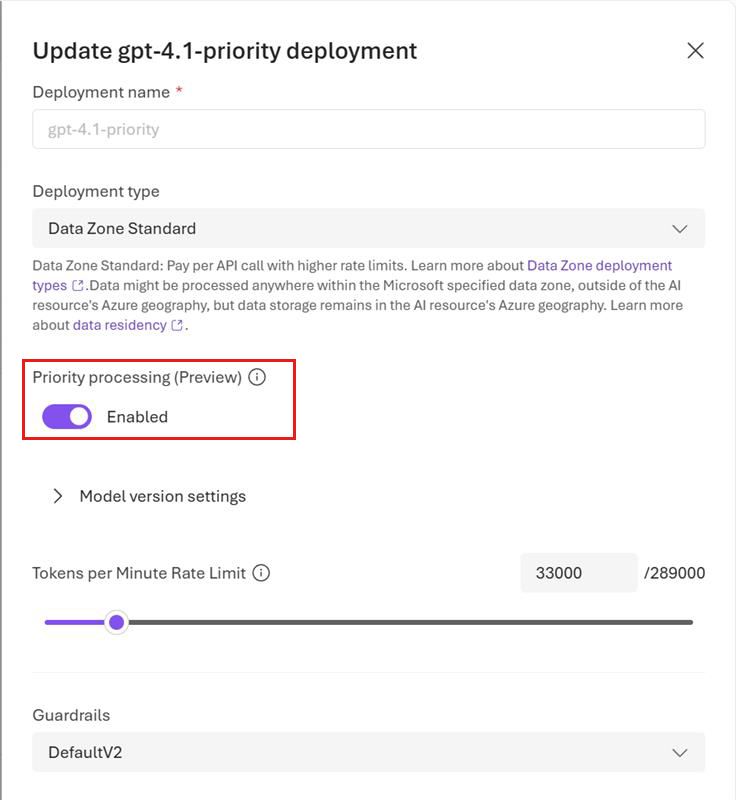

No portal Microsoft Foundry , ative a opção de processamento prioritário na página de detalhes da implementação ao criar a implementação ou atualize a definição de um modelo implementado editando os detalhes da implementação.

Observação

Se preferir usar código para ativar o processamento prioritário ao nível da implementação, pode fazê-lo através da API REST para a implementação, definindo o service_tier atributo da seguinte forma: "properties" : {"service_tier" : "priority"}. Os valores permitidos para o service_tier atributo são default e priority.

default implica processamento padrão, enquanto priority permite o processamento prioritário.

Uma vez que a implementação do modelo esteja configurada para usar processamento prioritário, pode começar a enviar pedidos para o modelo.

Ver métricas de utilização

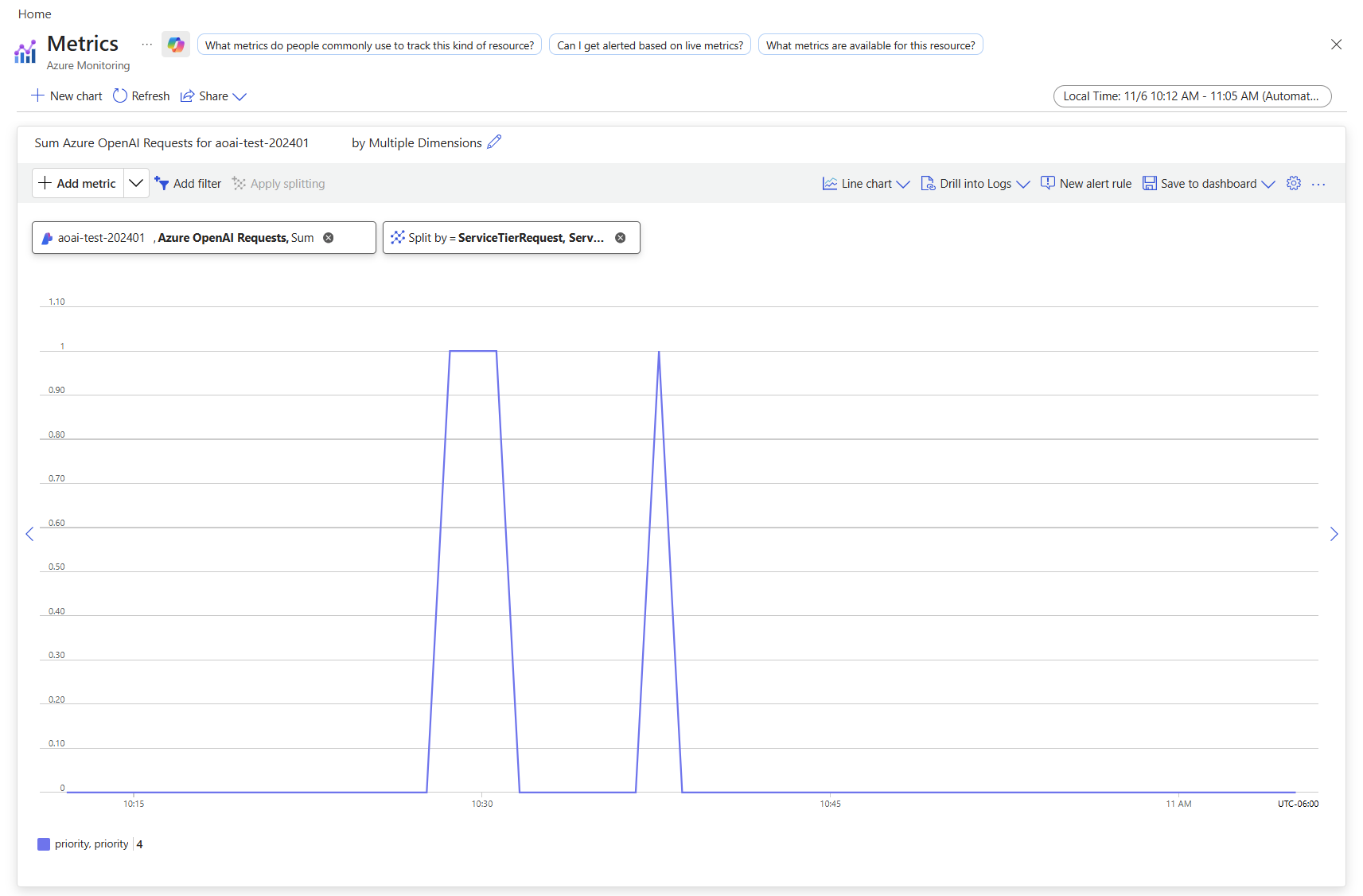

Pode ver a medida de utilização do seu recurso na secção Azure Monitor do Azure portal.

Para visualizar o volume de pedidos processados pelo processamento padrão versus o processamento prioritário, divida-se pelo nível de serviço (padrão ou prioridade) que estava no pedido original:

- Inicia sessão no https://portal.azure.com.

- Vai ao teu recurso Azure OpenAI e seleciona a opção Métricas na navegação à esquerda.

- Na página de métricas, adicione a métrica de solicitações de Azure OpenAI. Também pode selecionar outras métricas como latência do Azure OpenAI, utilização do Azure OpenAI, e outras.

- Selecione Adicionar filtro para selecionar a implementação padrão para a qual os pedidos de processamento prioritário foram processados.

- Selecione Aplicar divisão para dividir os valores por ServiceTierRequest e ServiceTierResponse.

Para mais informações sobre monitorização das suas implementações, consulte Monitor Azure OpenAI.

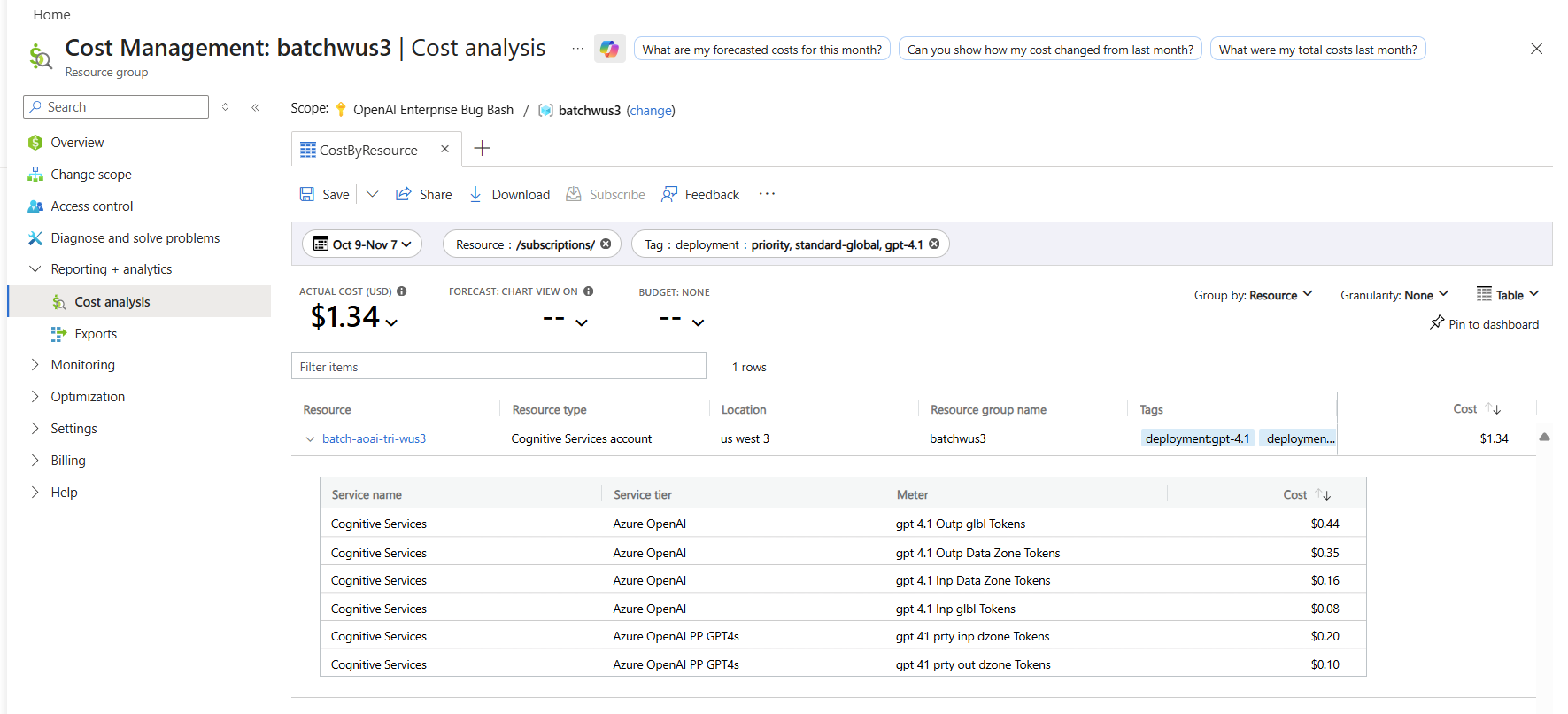

Monitorizar os custos

Pode ver uma divisão dos custos para pedidos prioritários e padrão na página de análise de custos do Azure portal, filtrando por nome de implementação e etiquetas de faturação da seguinte forma:

- Vai à página de análise de custos no Azure portal.

- (Opcional) Filtrar por recurso.

- Para filtrar por nome de implementação: Adicione um filtro para faturação Tag> selecione implementação como o valor, e depois escolha o nome da sua implementação.

Para informações sobre preços para processamento prioritário, consulte a visão geral de preços Azure OpenAI Service.

Ativar o processamento prioritário ao nível do pedido

Ativar o processamento prioritário ao nível do pedido é opcional. Tanto a API de completação de chat como a API de respostas têm um atributo service_tier opcional que especifica o tipo de processamento a usar ao servir um pedido. O exemplo seguinte mostra como definir service_tier como priority num pedido de resposta.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Use o service_tier atributo para sobrepor a definição de nível de implantação.

service_tier pode tomar os valores auto, default, e priority.

Se não definires o atributo, ele assume por omissão o valor

auto.service_tier = autosignifica que o pedido utiliza o nível de serviço configurado na implementação.service_tier = defaultsignifica que o pedido utiliza o preço e desempenho padrão para o modelo selecionado.service_tier = prioritysignifica que o pedido utiliza o nível de serviço de processamento prioritário.

A tabela seguinte resume qual o nível de serviço que processa os seus pedidos com base nas definições ao nível de implementação e ao nível de pedido para service_tier.

| Definição do nível de implantação | Definição de nível de pedido | Pedido processado por nível de serviço |

|---|---|---|

| predefinição | automático, predefinido | Standard |

| predefinição | priority | Processamento prioritário |

| priority | Auto, prioridade | Processamento prioritário |

| priority | predefinição | Standard |

Limitações

Atualmente, o serviço não suporta implementações padrão regionais nem implementações padrão de zonas de dados da UE.

O serviço pode redirecionar alguns pedidos de prioridade para processamento padrão* durante estes cenários:

- Se aumentos rápidos nos tokens de processamento por minuto levam a atingir limites de taxa de rampa. Atualmente, o limite de taxa de rampa é definido como aumentar o tráfego em mais de 50% tokens por minuto em menos de 15 minutos.

- Durante períodos de pico de pedidos, há prioridade no processamento.

- Pedidos de contexto longos enviados a certos modelos listados na tabela de alvo de latência.

Sugestão

Se encontrar regularmente limites de taxa de rampa, considere comprar PTU em vez de ou além do processamento prioritário.

* O serviço cobra pedidos processados pelo escalão de serviço padrão a taxas padrão. Os pedidos processados pelo nível de serviço padrão incluem

service_tier = defaultna resposta, enquanto os pedidos processados pelo nível de processamento prioritário incluemservice_tier = priorityna resposta.

Solução de problemas

| Questão | Motivo | Resolução |

|---|---|---|

| Pedidos rebaixados para nível padrão | Uma destas situações: - O tráfego aumentou mais de 50% em tokens por minuto em menos de 15 minutos, atingindo o limite de taxa de aumento. - Pedidos enviados durante períodos de pico para processamento prioritário. - Pedidos de contexto longos enviados a certos modelos listados na tabela de alvo de latência. |

- Aumentar o tráfego gradualmente, caso tenha encontrado limites de taxa de rampa. - Considerar a compra de PTU para capacidade em estado estacionário. |