Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

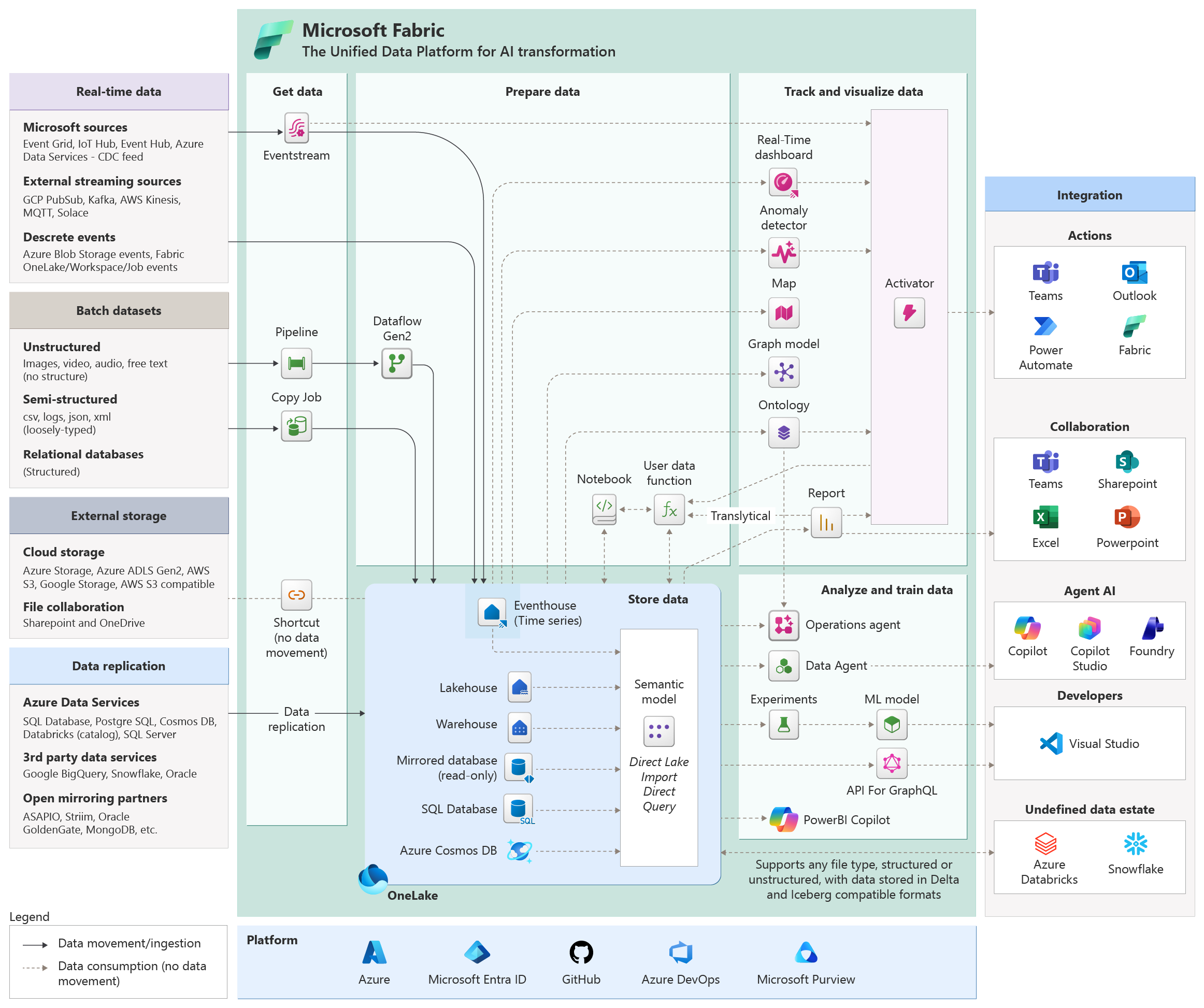

As organizações normalmente dependem de múltiplos serviços desconectados para ingerir, armazenar, transformar, analisar e visualizar dados. Esta fragmentação cria silos de dados, aumenta a sobrecarga de integração e atrasa o tempo para obter conhecimento. O Microsoft Fabric responde a estes desafios unificando todas as fases do ciclo de vida dos dados numa única plataforma construída sobre uma base partilhada.

No centro desta arquitetura está o OneLake, um único data lake organizacional que armazena todos os dados em formato aberto Delta Parquet. OneLake é provisionado automaticamente com cada locatário do Fabric. Como todas as cargas de trabalho do Fabric lêem e escrevem no OneLake, os dados não se movem entre motores. Um conjunto de dados ingerido através de um pipeline, refinado num caderno e visualizado num relatório Power BI mantém-se no mesmo local ao longo do seu percurso.

O ciclo de vida dos dados consiste em seis etapas, e o Fabric fornece ferramentas concebidas de raiz para cada uma:

Obtenha dados: Traga dados para o OneLake a partir de centenas de fontes em tempo real, em agenda, através de replicação contínua de bases de dados ou referenciando armazenamento externo no local.

Armazene dados: Persista os dados em formatos de armazenamento otimizados para a sua carga de trabalho, seja análise flexível de big data, consultas SQL estruturadas, análise de eventos em tempo real, processamento transacional ou relatórios empresariais governados.

Preparar e transformar: Limpar, remodelar e enriquecer dados usando transformações visuais low-code ou cadernos e funções reutilizáveis baseadas no código, sem mover dados para fora do OneLake.

Analisar e treinar: Construir e operacionalizar modelos de aprendizagem automática, executar análises avançadas, consultar dados programaticamente e explorar insights através de agentes de IA em linguagem natural.

Rastrear e visualizar: Obter insights através de relatórios interativos, monitorizar fluxos de dados em tempo real em dashboards em tempo real e acionar ações automáticas quando as condições são cumpridas.

Integração externa: Conectar-se de forma segura a serviços externos para automação, colaboração, governação, ferramentas para programadores e CI/CD.

O diagrama seguinte mostra como estas fases se ligam e quais os itens Fabric que participam em cada etapa. Cada etapa é abordada em profundidade num artigo dedicado. Use os links em cada secção para explorar as capacidades e ferramentas disponíveis nessa fase.

Obter dados

Diferentes tipos de conjuntos de dados provêm de uma grande variedade de fontes de dados em diferentes cenários de dados, incluindo replicação de dados, referências de armazenamento externo, conjuntos de dados batch e fluxos de dados em tempo real. Ingere e transforma estes conjuntos de dados através das ferramentas de integração do Fabric. Os dados ficam no OneLake, o armazenamento centralizado de dados para todo o Fabric. Os principais métodos de ingestão incluem:

- Eventstreams para ingestão e roteamento de eventos em tempo real.

- Pipelines de dados para movimentação de dados de lotes e programada com mais de 200 conectores.

- Espelhamento para replicação contínua a partir de bases de dados operacionais sem construir pipelines ETL.

- Atalhos para virtualização de dados sem cópia a partir de armazenamento externo como Azure Data Lake, Amazon S3 ou Google Cloud Storage.

Para mais informações, consulte Introduzir dados no Microsoft Fabric.

Armazenar dados

Uma vez ingeridos, todos os dados são armazenados no OneLake em formato aberto Delta Parquet. A OneLake fornece um único data lake para toda a sua organização, sem necessidade de provisionamento separado. O Fabric oferece vários itens de armazenamento otimizados para diferentes cargas de trabalho:

- Lakehouse para armazenamento flexível de big data que combina ficheiros e tabelas Delta geridas com um endpoint SQL automático.

- Warehouse para análises estruturadas e relacionais com suporte total a T-SQL, procedimentos armazenados e transações ACID.

- Eventhouse para análises em tempo real sobre dados de streaming e telemetria utilizando a Linguagem de Consulta Kusto (KQL).

- Base de dados SQL para cargas de trabalho transacionais e análises operacionais.

- Modelos semânticos para lógica de negócio curada, medidas e hierarquias que alimentam relatórios e IA.

Para mais informações, consulte Armazenar dados no Microsoft Fabric.

Preparar e transformar dados

Uma vez no OneLake, pode transformar ainda mais os dados usando motores de código-first ou ferramentas low-code, tudo dentro do Fabric sem movimento de dados entre os motores.

- O Dataflow Gen2 fornece uma interface Power Query low-code para limpeza, transformação e enriquecimento de dados.

- Os notebooks oferecem um ambiente semelhante ao Jupyter para engenharia de dados baseada em Python, T-SQL e Scala.

- As Funções de Dados de Utilizador permitem-lhe incorporar lógica Python personalizada reutilizável que pode ser invocada a partir de pipelines, cadernos e regras Ativador.

Para mais informações, consulte Preparar e transformar dados.

Analisar dados e treinar modelos

Use os dados preparados para treinar modelos de ML e realizar análises avançadas. A carga de trabalho de Ciência de Dados da Fabric proporciona um ambiente para construir, treinar e operacionalizar modelos de ML:

- As experiências MLflow acompanham as execuções de treino do modelo com registo automático de hiperparâmetros, métricas e itens.

- Os modelos de ML são registados num registo alimentado por MLflow para versionamento, rastreio de metadados e reprodutibilidade.

- Os agentes de dados e os agentes de operações permitem-lhe interagir com dados usando linguagem natural e agir com base nas condições e padrões encontrados.

- As APIs GraphQL fornecem uma camada flexível de acesso a dados para os programadores consultarem múltiplas fontes de dados Fabric através de um único endpoint.

- O Copilot for Power BI utiliza IA generativa para análise ad hoc, geração de DAX e exploração de dados em linguagem natural.

Para mais informações, consulte Analisar e treinar dados no Microsoft Fabric.

Rastrear e visualizar dados

Use os dados preparados e modelados para criar relatórios, dashboards e alertas em tempo real:

- Os relatórios Power BI fornecem visualização interativa de dados baseada em modelos semânticos, com distribuição entre aplicações Microsoft 365 como Teams, SharePoint, PowerPoint e Excel.

- Os fluxos de tarefas translíticos permitem aos utilizadores agir diretamente a partir de relatórios do Power BI, chamando funções de dados do utilizador.

- Os dashboards Real-Time Intelligence monitorizam dados em streaming com latência de sub-segundos através de consultas KQL e autoria visual.

- O Activator deteta condições nos dados em streaming e desencadeia ações automáticas como alertas do Teams, emails ou fluxos do Power Automate.

- O Fabric IQ mapeia dados empresariais para uma ontologia empresarial partilhada e permite aos agentes de IA raciocinar sobre os seus dados com todo o contexto empresarial.

Para mais informações, consulte Rastrear e visualizar dados.

Integração externa

O Fabric integra-se com sistemas externos tanto para a ingestão de dados como para a entrega de insights:

- O Power Automate e o Data Activator permitem a automação de fluxos de trabalho em tempo real com base nas condições dos dados.

- A integração com o Microsoft 365 revela insights no Teams, SharePoint, PowerPoint e Excel.

- As APIs REST e as bibliotecas clientes fornecem acesso programático aos recursos do Fabric.

- O Microsoft Entra ID gere autenticação, acesso condicional e suporte ao principal de serviço.

- A integração do Git com Azure DevOps e GitHub permite controlo de versões e CI/CD para itens do Fabric.

- A Microsoft Purview fornece governação, catalogação e conformidade unificadas de dados em todo o património de dados Fabric.

Para mais informações, consulte Integração externa e conectividade de plataforma.

Suporte para linguagem natural e IA

O suporte à linguagem natural apresenta-se sob a forma do Power BI Copilot, Data Agents e Operations Agents, que podem raciocinar sobre dados empresariais no OneLake e produzir respostas com base nos itens de dados a que os utilizadores podem aceder. Pode integrar Agentes de Dados no Microsoft 365 Copilot, Microsoft Foundry e Copilot Studio para que os utilizadores possam obter insights do OneLake dentro dos seus fluxos de trabalho existentes em diferentes aplicações.