Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

[Este tópico é documentação de pré-lançamento e está sujeito a alterações.]

Os prompts permitem que você crie ferramentas de IA generativas personalizadas para automação comercial e agentes. Garantir a precisão, confiabilidade e eficiência dessas ferramentas é fundamental. O teste em lote de prompts foi projetado para permitir que você valide e melhore os prompts usados em ferramentas de IA em toda a plataforma.

Importante

- Esta é uma funcionalidade de pré-visualização pronta para produção.

- As pré-visualizações prontas para produção estão sujeitas a termos de utilização suplementares.

- Os prompts são executados em modelos GPT alimentados por Azure OpenAI Service.

- Esse recurso pode ainda não estar disponível na sua região. Saiba mais na seção Prompts em Disponibilidade de recursos por região ou ambiente do governo dos EUA.

- Esta capacidade poderá estar sujeita a limitações de utilização ou a uma limitação de capacidade.

Principais características do teste em lote

O teste em lote fornece uma abordagem sistemática para validar prompts em diversos conjuntos de dados. É possível:

- Carregue ou gere conjuntos de dados de teste para uma avaliação abrangente.

- Definir critérios de avaliação para avaliar os resultados dos testes.

- Execute testes em lote para avaliar o comportamento do prompt em todo o conjunto de dados de teste.

- Compare os resultados ao longo do tempo para garantir a melhoria contínua.

- Revise e ajuste as avaliações automáticas para garantir o alinhamento com suas necessidades específicas.

Uma pontuação de precisão é calculada com base nos resultados do teste, fornecendo dados empíricos para confiar em suas ferramentas de IA.

Como usar o teste em lote

Use as etapas a seguir para configurar e executar testes em lote para seus prompts.

Definir os casos de teste

Inicia sessão no Copilot Studio, Power Apps ou Power Automate.

Acesse a lista de prompts:

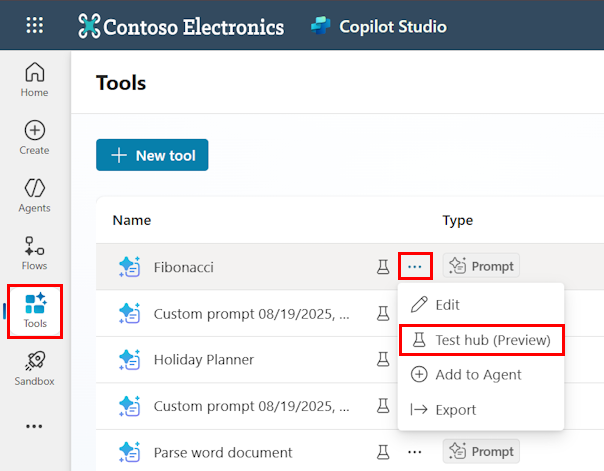

- No Copilot Studio, selecione Tools e depois filtre pelos prompts.

- Em Power Apps e Power Automate, selecione AI hub.

Ao lado do nome do prompt, selecione os três pontos (...).

Selecione Hub de teste (Visualização).

Aqui está um exemplo do ecrã Tools no Copilot Studio:

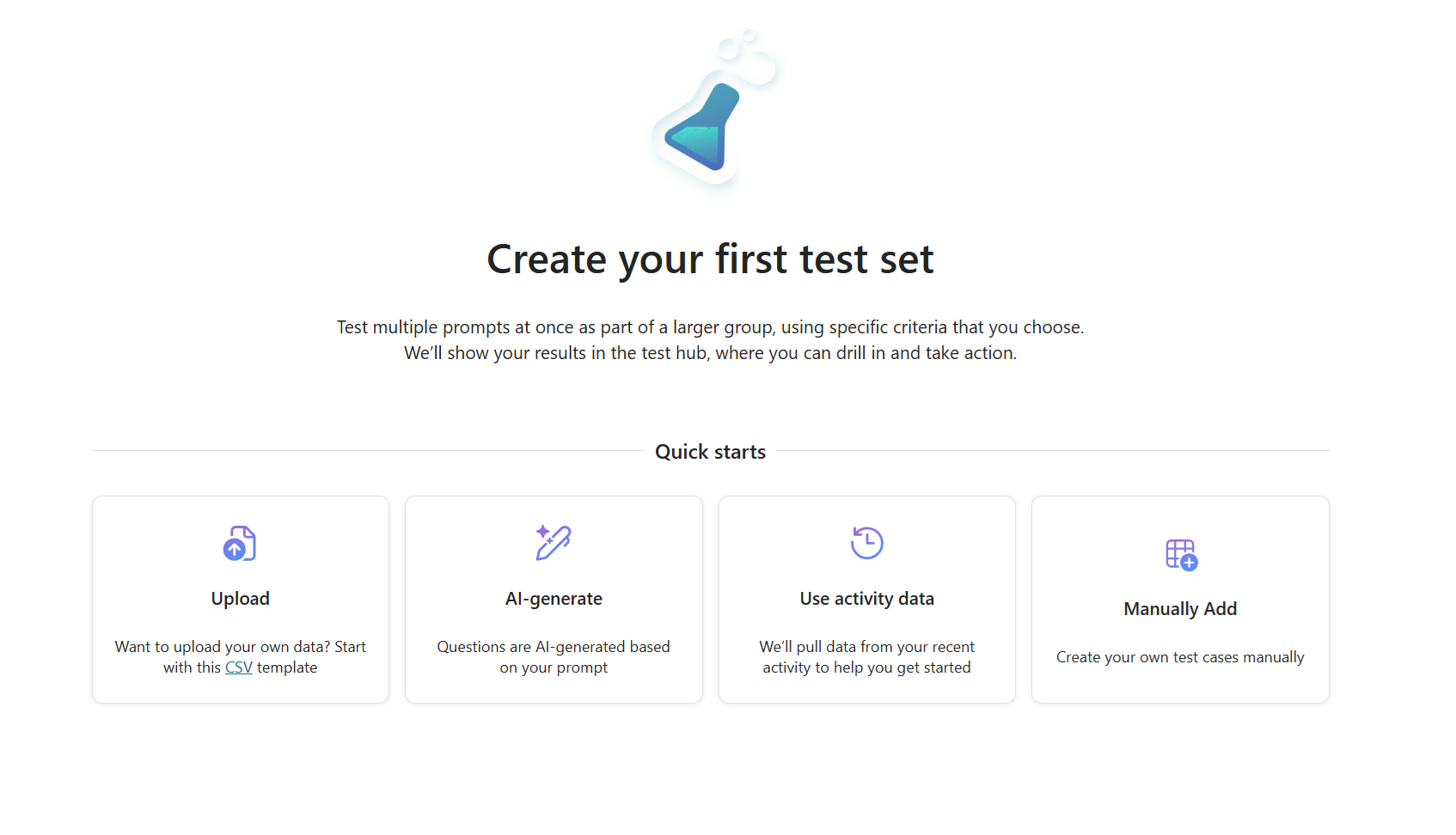

No Copilot Studio, o hub de testes assemelha-se à seguinte captura de ecrã:

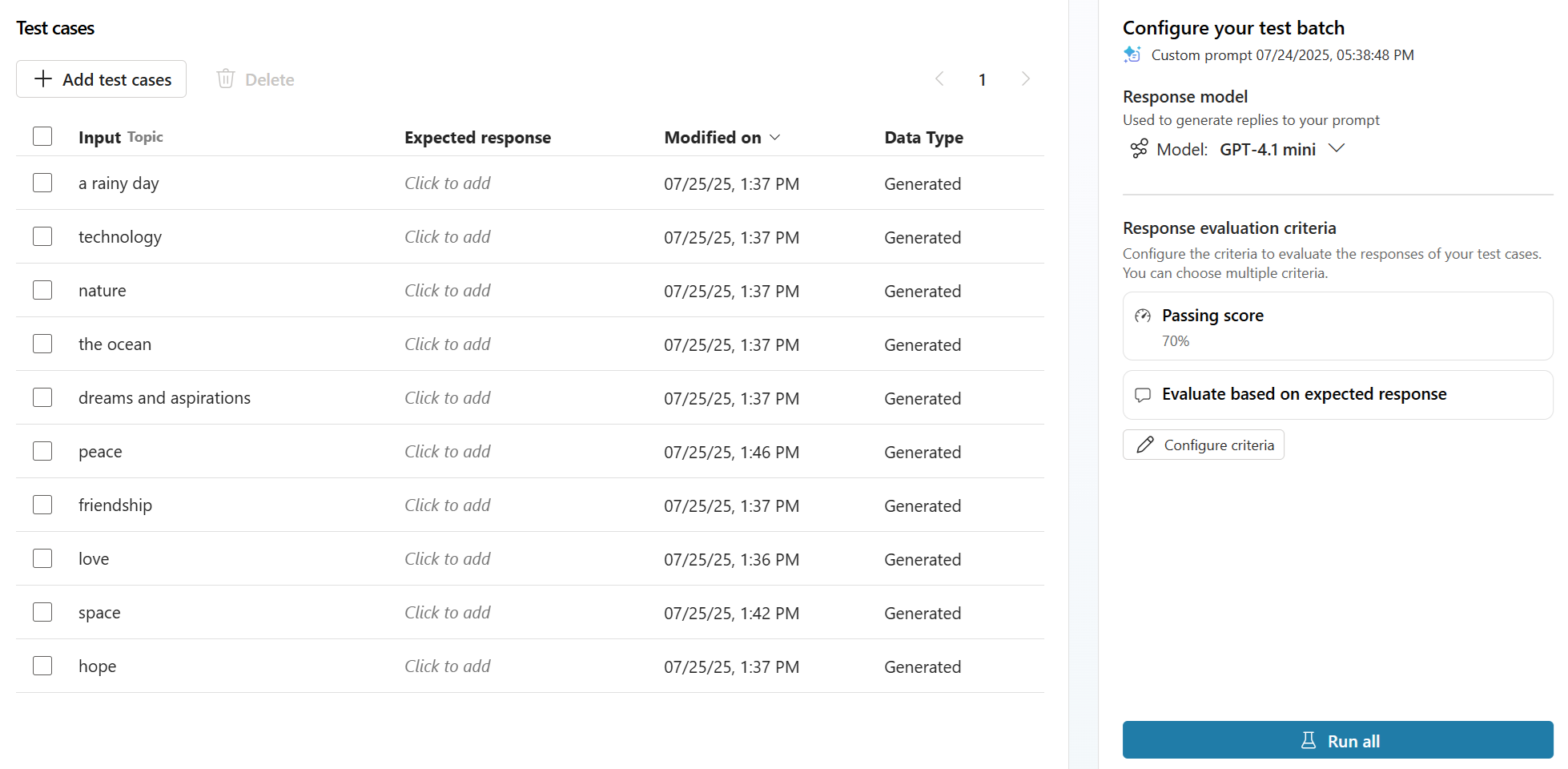

Adicione seus casos de teste usando uma das opções disponíveis:

- Upload: Permite que você carregue casos de teste usando um arquivo csv. Se quiser verificar o formato do arquivo que precisa carregar, selecione Baixar esquema de dados de teste.

- Geração de IA: Permite gerar casos de teste usando IA com base em seu prompt.

- Utilizar dados de atividade: permite-lhe extrair a atividade de pedidos recente para o ajudar a começar.

- Adicionar manualmente: Permite criar casos de teste manualmente.

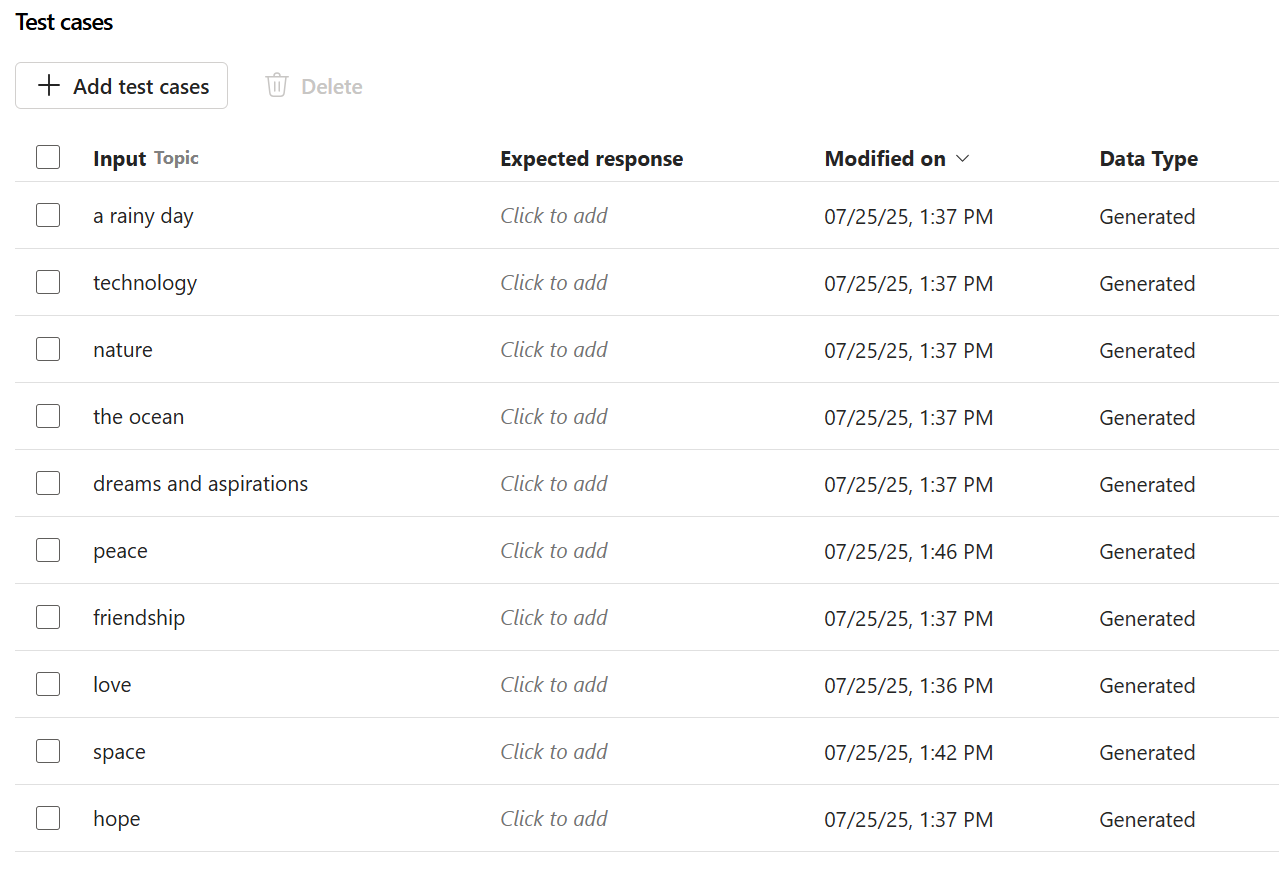

Qualquer uma das opções ajuda a criar uma lista de casos de teste que você pode executar:

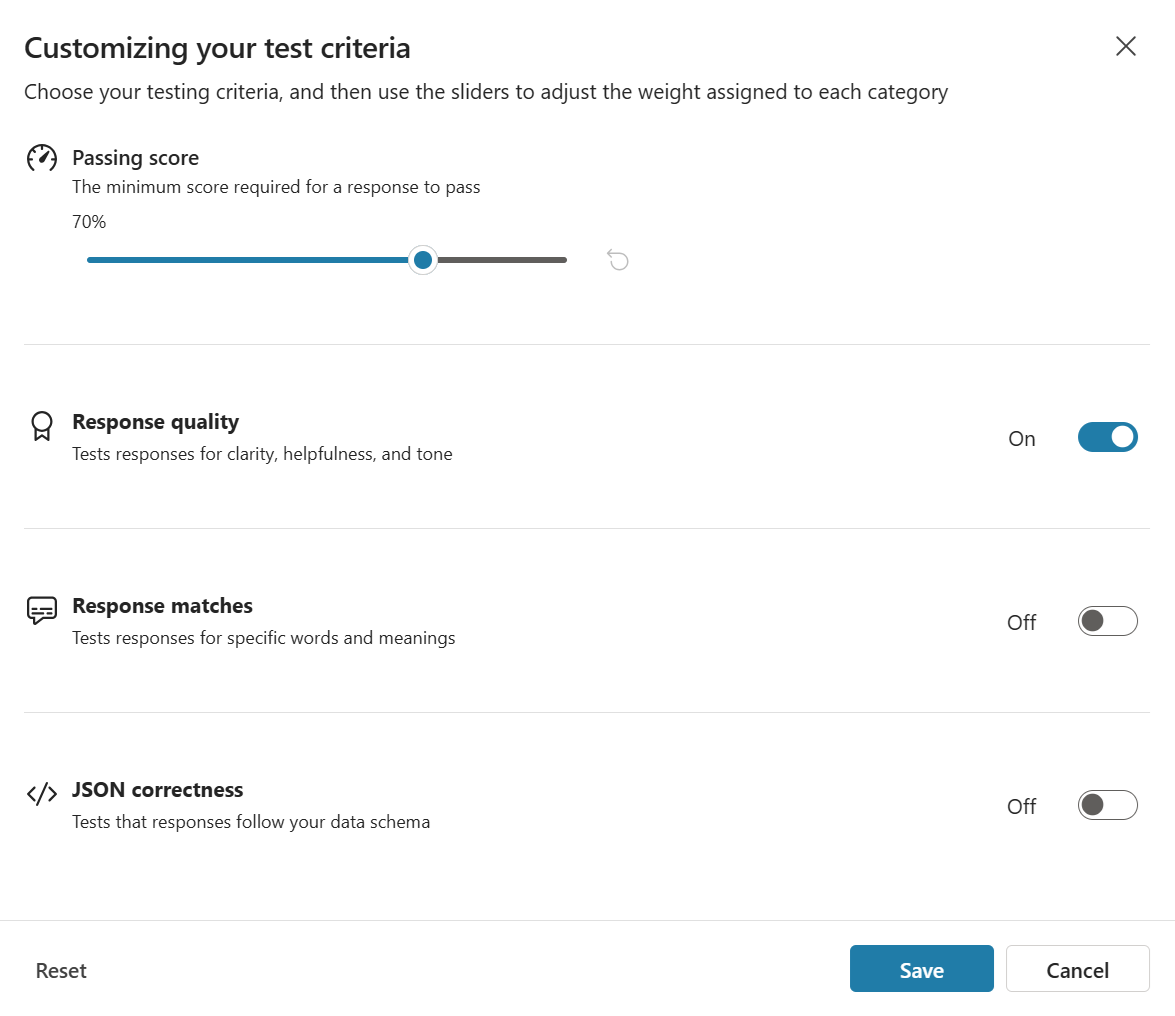

Definir critérios de avaliação

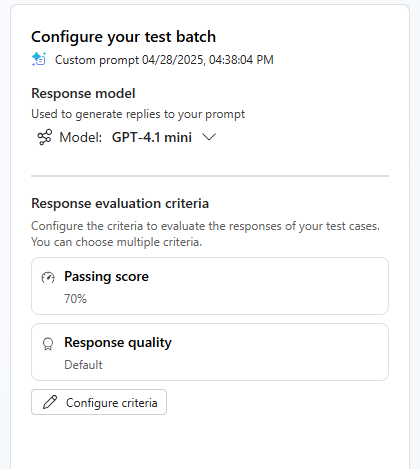

Depois de criar os casos de teste, selecione Configurar critérios na seção de configuração à direita:

Defina a pontuação de aprovação, que é a pontuação mínima necessária para que uma resposta seja aprovada.

Escolha um dos seguintes critérios pré-definidos.

- Qualidade da resposta: testa as respostas quanto à clareza, utilidade e tom

- Correspondências de respostas: resta respostas em termos de palavras e significados específicos

- Correção JSON: testa que as respostas seguem seu esquema de dados

Estes critérios e a pontuação de aprovação determinam como os resultados dos casos de teste são avaliados durante o processo de avaliação.

Executar testes em lote

Na tela de casos de teste, selecione Executar tudo para executar a avaliação em todos os casos de teste ou selecione os casos de teste a serem executados e selecione Executar selecionado.

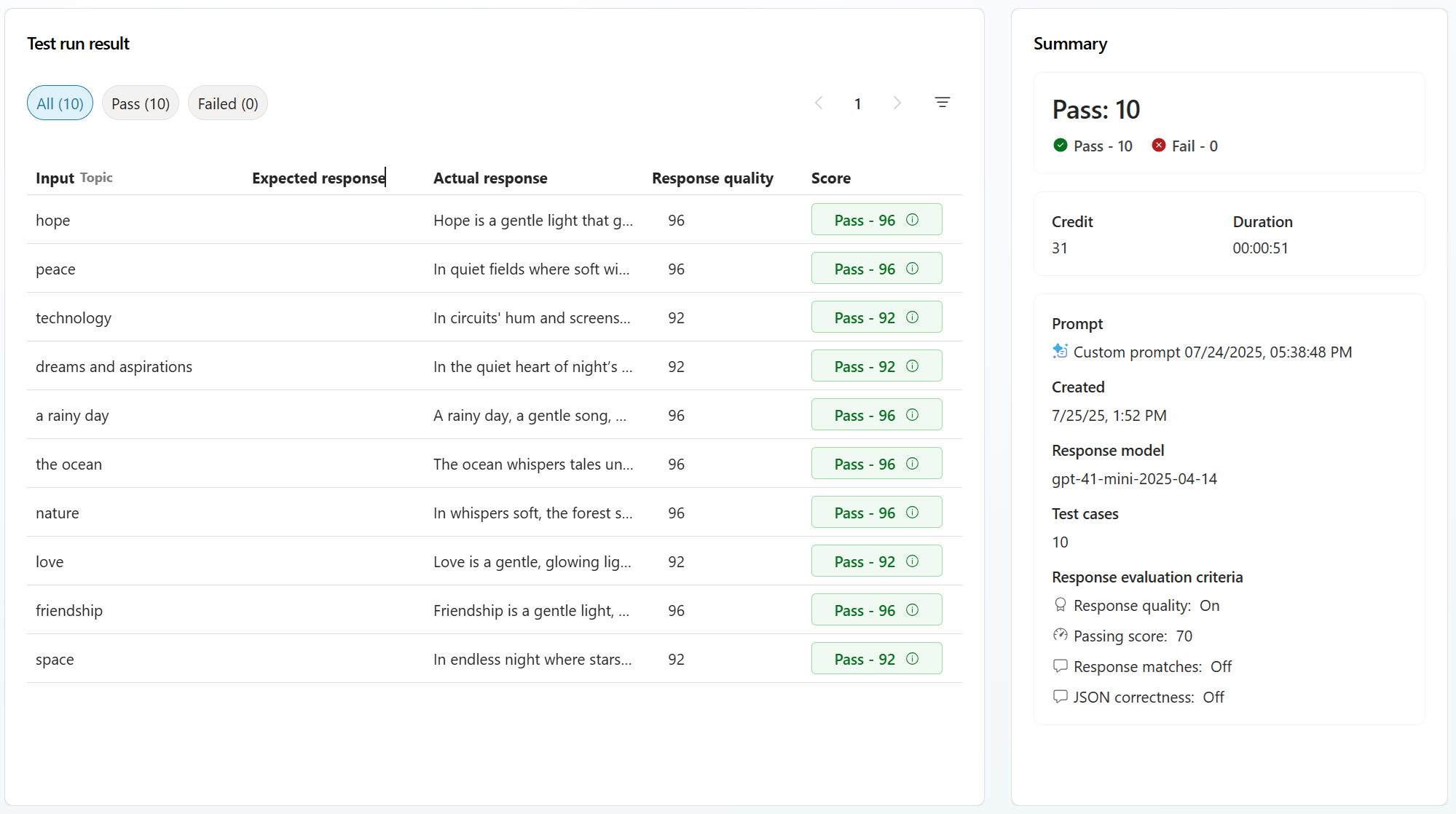

O hub de teste avalia os resultados em relação aos critérios definidos, fornecendo informações sobre o desempenho do prompt.

Uma vez feita a avaliação dos casos de teste, a tela de resultados aparece:

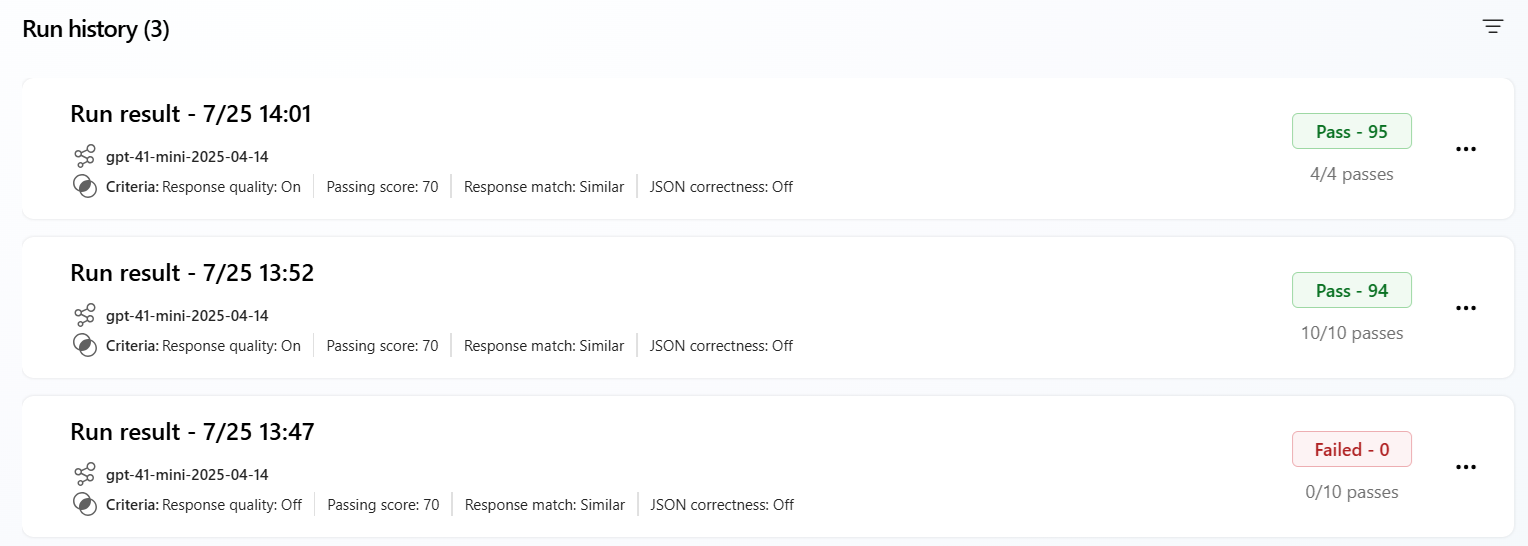

Para aceder a execuções anteriores de avaliação, selecione o nome do prompt no topo do ecrã no Copilot Studio, ou selecione Histórico de execução no Power Apps ou Power Automate.

Para ver os detalhes, selecione a sessão de avaliação.

O histórico de execução permite monitorar e analisar os resultados do teste ao longo do tempo, incluindo:

- Monitorize a progressão da pontuação de precisão em várias execuções de teste.

- Compare resultados de diferentes execuções para identificar tendências ou regressões.

- Acesse detalhes do motivo pelo qual um determinado resultado de teste foi classificado como aprovado ou reprovado, oferecendo assim mais detalhes para o diagnóstico.

Realize iterações sobre os casos de teste e monitore qualquer mudança significativa entre as avaliações.