Dados do Copiloto do GitHub

Nesta unidade, abordaremos como o GitHub Copilot lida com dados para diferentes ambientes, recursos e configurações.

Tratamento de dados para sugestões de código do GitHub Copilot

O GitHub Copilot no editor de código não retém nenhum prompt, como código ou outro contexto, usado com a finalidade de fornecer sugestões para treinar os modelos fundamentais. Ele descarta os prompts assim que uma sugestão é retornada.

Os assinantes individuais do GitHub Copilot podem optar por não compartilhar seus prompts com o GitHub, que de outra forma serão usados para ajustar o modelo fundamental do GitHub.

Tratamento de dados para o chat do GitHub Copilot

O GitHub Copilot Chat opera como uma plataforma interativa, permitindo que os desenvolvedores se envolvam em interações conversacionais com o assistente de IA para receber assistência de codificação. Aqui estão as etapas que ele executa que podem ser distintas de outros recursos, como conclusão de código:

- Formatação: O Copilot formata meticulosamente a resposta gerada para uma apresentação ideal dentro da interface de chat. Ele destaca trechos de código para melhorar a legibilidade e pode incluir opções para integração direta ao seu código. O Copilot mostra a resposta formatada na janela Copilot Chat dentro do IDE, permitindo que você revise e interaja facilmente com as informações fornecidas.

- Envolvimento do usuário: você pode se envolver ativamente com a resposta fazendo perguntas de acompanhamento, solicitando esclarecimentos ou fornecendo informações adicionais. A interface de chat mantém um histórico de conversas para facilitar a compreensão contextual nas interações subsequentes.

- Retenção de dados: Para o Copilot Chat usado fora do editor de código, o GitHub normalmente retém prompts, sugestões e contexto de suporte por 28 dias. As políticas de retenção específicas para o Copilot Chat dentro do editor de código podem variar.

O mesmo vale para CLI, Mobile e GitHub Copilot Chat no GitHub.com.

Tipos de prompt suportados pelo GitHub Copilot Chat

O GitHub Copilot Chat processa uma ampla gama de prompts relacionados à codificação, demonstrando sua versatilidade como assistente de codificação conversacional. Aqui estão alguns tipos de entrada comuns:

- Perguntas diretas: você pode fazer perguntas específicas sobre conceitos de codificação, bibliotecas ou problemas de solução de problemas. Por exemplo, "Como implementar um algoritmo de classificação rápida em Python?" ou "Por que meu componente React não está renderizando?"

- Solicitações relacionadas a código: Você pode solicitar geração, modificação ou explicação de código. Os exemplos incluem "Escrever uma função para calcular fatorial", "Corrigir este erro no meu código" ou "Explicar este trecho de código".

- Consultas abertas: Você pode explorar conceitos de codificação ou buscar orientação geral fazendo perguntas abertas como "Quais são as melhores práticas para escrever código limpo?" ou "Como posso melhorar o desempenho do meu aplicativo Python?"

- Prompts contextuais: você pode fornecer trechos de código ou descrever cenários de codificação específicos para buscar assistência personalizada. Por exemplo, "Aqui está uma parte do meu código, você pode sugerir melhorias?" ou "Estou criando um aplicativo Web, você pode me ajudar com o fluxo de autenticação?"

A capacidade do Copilot Chat de processar diversos tipos de entrada aumenta sua utilidade como um companheiro de codificação abrangente.

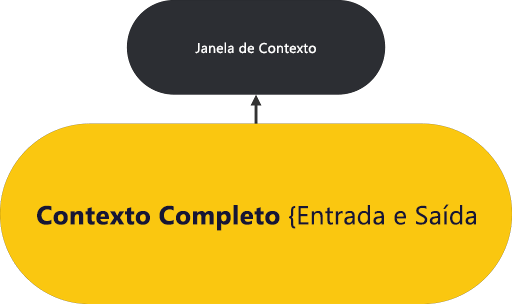

Janelas de contexto limitadas

Embora o GitHub Copilot Chat seja excelente em entender e responder a prompts, é essencial reconhecer a limitação das janelas de contexto. Isso se refere à quantidade de código e texto ao redor que o modelo pode processar simultaneamente para gerar sugestões. A janela de contexto do GitHub Copilot normalmente varia de aproximadamente 200 a 500 linhas de código ou até alguns milhares de tokens. Esta limitação pode variar dependendo da implementação específica e da versão do Copilot que está a ser utilizada.

O Copilot Chat atualmente opera com uma janela de contexto de tokens 4k, fornecendo um escopo mais amplo para entender e responder às consultas do usuário em comparação com o Copilot padrão.

Apesar desses avanços, você deve estar atento às limitações da janela de contexto ao criar prompts. Dividir problemas complexos em consultas menores e mais focadas ou fornecer trechos de código relevantes pode melhorar significativamente a capacidade do modelo de fornecer respostas precisas e úteis.