Selecione modelos usando benchmarks

Antes de implementar um modelo, deves perceber como ele se comporta em diferentes dimensões. Os benchmarks de modelos fornecem dados objetivos e mensuráveis para o ajudar a comparar modelos e tomar decisões de seleção informadas. O portal Microsoft Foundry oferece ferramentas abrangentes de benchmarking organizadas em métricas de qualidade, segurança, custo e desempenho.

Aceder aos benchmarks do modelo

Pode explorar benchmarks de duas formas dentro do portal Microsoft Foundry:

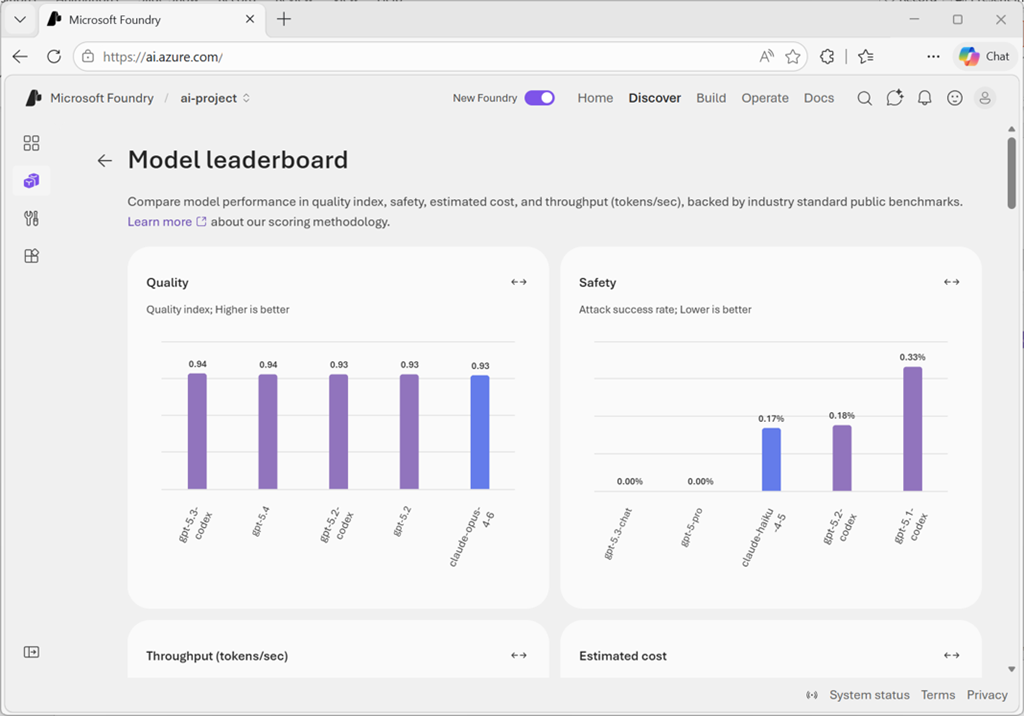

No catálogo de modelos, consulte a tabela de classificação de modelos para ver classificações comparativas entre todos os modelos disponíveis. Esta vista ajuda-o a identificar modelos de melhor desempenho para métricas ou cenários específicos. A tabela de classificação mostra os melhores modelos classificados por qualidade, segurança, custo estimado e taxa de produção.

Para benchmarks detalhados de um modelo específico, abra o cartão do modelo e selecione o separador Benchmarks. Esta visualização mostra como o modelo individual se comporta em várias métricas e conjuntos de dados, com gráficos comparativos colocando-o em relação a modelos semelhantes.

Referências de qualidade

Os benchmarks de qualidade avaliam quão bem um modelo gera respostas precisas, coerentes e contextualmente adequadas. Estas métricas utilizam conjuntos de dados públicos e métodos padronizados de avaliação para garantir consistência.

O índice de Qualidade fornece uma visão geral ao fazer a média das pontuações de precisão em múltiplos conjuntos de dados de referência que medem raciocínio, conhecimento, resposta a perguntas, capacidades matemáticas e competências de programação. Valores de índice de qualidade mais elevados indicam um desempenho global mais forte em tarefas linguísticas de uso geral.

Os benchmarks de qualidade utilizam conjuntos de dados tais como:

- Arena-Hard - resposta adversarial a perguntas

- BIG-Bench Hard - capacidades para raciocínio

- GPQA - perguntas multidisciplinares de nível de pós-graduação

- HumanEval+ e MBPP+ - tarefas de geração de código

- MATH - raciocínio matemático

- MMLU-Pro - avaliação de conhecimentos gerais

- IFEval - seguimento de instruções

As pontuações de referência são índices normalizados que variam de zero a um, onde valores mais elevados indicam melhor desempenho.

Parâmetros de segurança

As métricas de segurança garantem que os modelos não geram conteúdo prejudicial, tendencioso ou inadequado. Estes benchmarks são cruciais para aplicações expostas aos utilizadores finais, especialmente em indústrias reguladas ou em cenários de contacto com o cliente.

A Microsoft Foundry avalia modelos em múltiplas dimensões de segurança:

A deteção de comportamentos prejudiciais utiliza o benchmark HarmBench para medir quão bem os modelos resistem à geração de conteúdos inseguros. A avaliação calcula a Taxa de Sucesso de Ataque (ASR), onde valores mais baixos indicam modelos mais seguros e robustos. HarmBench testa três áreas funcionais:

- Comportamentos prejudiciais padrão - cibercrime, atividades ilegais, danos gerais

- Comportamentos prejudiciais no contexto - desinformação, assédio, bullying

- Violações de direitos de autor - reprodução de material protegido por direitos de autor

A deteção de conteúdo tóxico utiliza o conjunto de dados ToxiGen para medir quão bem os modelos identificam o discurso de ódio adversarial e implícito. Pontuações mais elevadas na F1 indicam melhor desempenho de deteção entre referências a grupos minoritários.

O conhecimento de domínios sensíveis utiliza o benchmark WMDP (Weapons of Mass Destruction Proxy) para medir o conhecimento dos modelos em biossegurança, cibersegurança e segurança química. Pontuações mais elevadas em ADM indicam mais conhecimento sobre capacidades potencialmente perigosas.

As pontuações de segurança ajudam-no a compreender a robustez do modelo, especialmente importante para aplicações direcionadas ao cliente onde a produção prejudicial representa preocupações significativas.

Referências de custo

Compreender o impacto financeiro da utilização do modelo ajuda-o a equilibrar os requisitos de qualidade com as restrições orçamentais. Os benchmarks de custos no Microsoft Foundry mostram preços para implementações de APIs serverless e modelos Azure OpenAI.

O custo por token de entrada mostra o preço do processamento de 1 milhão de tokens de entrada (o texto que envia ao modelo).

O custo por token de saída indica o preço para gerar 1 milhão de tokens de saída (o texto que o modelo produz).

O custo estimado combina custos de entrada e saída usando uma proporção típica de 3:1 (três tokens de entrada por token de saída), dando-lhe um único número para comparação. Valores mais baixos indicam modelos mais económicos.

Os benchmarks de custos ajudam-no a identificar modelos que entregam a qualidade de que precisa a um preço que se adequa aos padrões de utilização e orçamento da sua aplicação.

Parâmetros de desempenho

As métricas de desempenho medem a rapidez e eficiência com que os modelos respondem aos pedidos. Estes benchmarks são importantes para aplicações em tempo real onde a experiência do utilizador depende da capacidade de resposta.

As medições de latência incluem:

- Média da latência - tempo médio em segundos para processar um pedido

- Latência P50 (mediana) - 50% de pedidos são concluídos mais rapidamente do que este período

- Latência P90 - 90% de pedidos são concluídos mais rapidamente do que este tempo

- Latência P95 - 95% dos pedidos são concluídos mais rapidamente do que este tempo

- Latência P99 - 99% de pedidos são concluídos em menos tempo que este

- Tempo até ao primeiro token (TTFT) - tempo até chegar o primeiro token ao usar streaming

As medições de largura de banda incluem:

- Tokens gerados por segundo (GTPS) - tokens de saída gerados por segundo

- Total de tokens por segundo (TTPS) - quantidade total de tokens de entrada e saída processada por segundo

- Tempo entre tokens - intervalo entre receber tokens consecutivos

A tabela de classificação resume o desempenho usando o tempo médio até ao primeiro token (menor melhor) e a média dos tokens gerados por segundo (maior é melhor). Modelos de alta capacidade e baixa latência proporcionam melhores experiências de utilizador em aplicações interativas. Para trabalhos de processamento em lote onde a velocidade importa menos do que o custo, pode priorizar outros fatores.

Use tabelas de classificação e funcionalidades de comparação

A tabela de classificação de modelos permite-te ver os melhores modelos para métricas específicas. Pode ordenar por qualidade, segurança, custo estimado e capacidade de transferência para identificar modelos que melhor se adequam às suas necessidades.

Os rankings de cenários ajudam a encontrar modelos otimizados para casos de uso específicos como raciocínio, codificação, matemática, resposta a perguntas ou fundamentação. Se a sua candidatura corresponde a um cenário específico, comece pelo ranking de cenários relevante em vez de depender apenas do índice geral de qualidade.

Os gráficos de trade-off mostram duas métricas simultaneamente, como qualidade versus custo ou qualidade versus throughput. Estas visualizações ajudam-no a encontrar o equilíbrio ideal para as suas necessidades. Utilize o menu suspenso para comparar qualidade com custo, taxa de processamento ou segurança. Modelos mais próximos do canto superior direito do gráfico têm bom desempenho em ambas as métricas. Um modelo um pouco menos preciso, mas significativamente mais rápido ou barato, pode servir melhor as tuas necessidades.

A comparação lado a lado permite-lhe selecionar dois ou três modelos da tabela de classificação e compará-los em múltiplas dimensões:

- Parâmetros de desempenho (qualidade, segurança, rendimento)

- Detalhes do modelo (janela de contexto, dados de treino, linguagens suportadas)

- Pontos de extremidade suportados (opções de implementação)

- Suporte a funcionalidades (chamada de funções, saída estruturada, visão)

Selecione os modelos assinalando caixas ao lado dos seus nomes, depois escolha Comparar para abrir a vista de comparação detalhada.