Avaliar o desempenho do modelo

Avaliar o seu modelo implementado garante que cumpre os padrões de qualidade, fornece respostas precisas e melhora continuamente ao longo do tempo. O portal Microsoft Foundry oferece múltiplas abordagens à avaliação, desde testes manuais a métricas automatizadas e fluxos abrangentes de avaliação.

Por que avaliar modelos

A avaliação serve vários propósitos críticos no desenvolvimento de aplicações de IA generativa:

A garantia de qualidade identifica problemas e assegura que o seu modelo fornece respostas precisas e relevantes. Descobrir problemas durante a avaliação em vez da produção protege os seus utilizadores e a reputação da sua organização.

A satisfação do utilizador melhora quando os modelos fornecem consistentemente respostas úteis e adequadas. A avaliação ajuda-o a compreender como os utilizadores experienciam a sua aplicação e onde as melhorias têm maior impacto.

A melhoria contínua resulta da análise dos resultados das avaliações para identificar oportunidades de melhoria. A avaliação regular, à medida que atualiza as instruções, adiciona funcionalidades ou retreina modelos, garante a qualidade contínua.

A verificação de conformidade e segurança confirma que o seu modelo cumpre as políticas, evita a geração de conteúdos prejudiciais e respeita os requisitos de privacidade dos utilizadores e proteção de dados.

Abordagens de avaliação manual

A avaliação manual envolve revisores humanos a avaliar as respostas dos modelos. Embora seja demorado, a avaliação manual fornece insights que métricas automatizadas não conseguem captar.

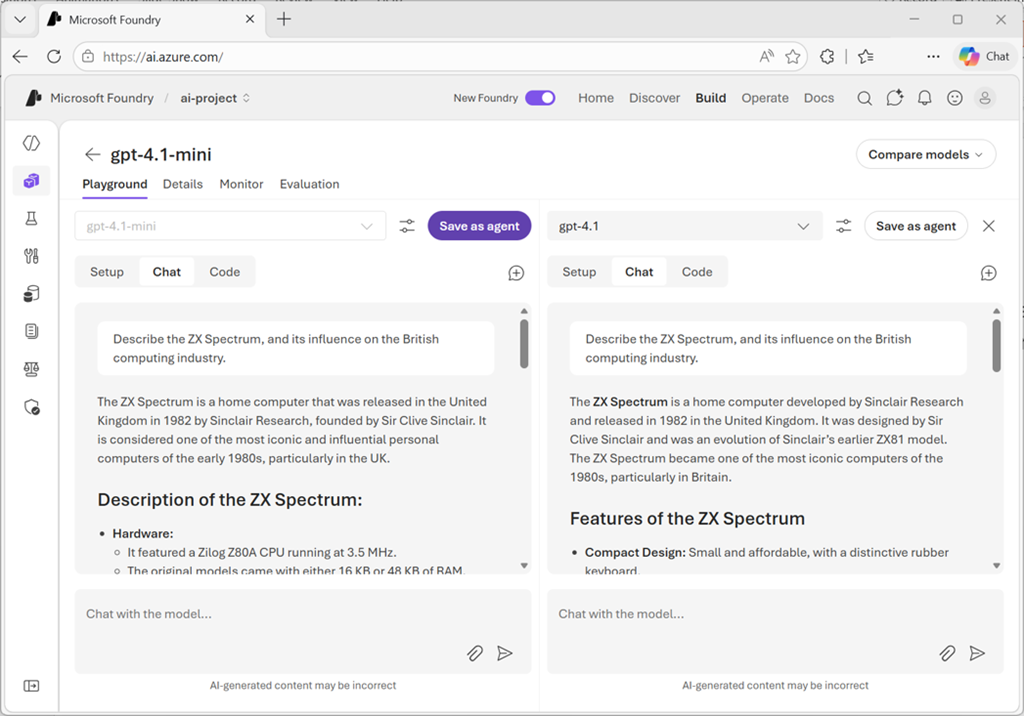

O teste interativo no playground permite-lhe explorar o comportamento do modelo de forma qualitativa. Insere diferentes estímulos, observa respostas e anota problemas como informação incorreta, tom inadequado ou falta de cumprimento das instruções. Este teste exploratório ajuda-o a compreender as forças e limitações de um modelo.

Para ajudar a otimizar o design da sua aplicação, pode testar modelos lado a lado no playground, sincronizando instruções do sistema e prompts para comparar as suas respostas.

A revisão estruturada envolve criar um conjunto de casos de teste que representem os casos de uso da sua aplicação. Os avaliadores humanos avaliam as respostas com base em critérios como:

- Relevância: A resposta responde à pergunta ou ao pedido?

- Informação: Fornece detalhes suficientes e informação útil?

- Envolvimento: A resposta é interessante e adequadamente conversacional?

- Precisão: Os factos e afirmações estão corretos?

- Segurança: A resposta evita conteúdos prejudiciais, tendenciosos ou inadequados?

Os avaliadores normalmente utilizam escalas de avaliação (como 1-5) para cada critério. As classificações agregadas em múltiplos casos de teste fornecem medidas quantitativas da qualidade global.

Os estudos de utilizadores recolhem feedback de utilizadores reais ou representativos que interagem com a sua aplicação. O feedback dos utilizadores revela questões do mundo real que pode passar despercebidas em testes controlados, como frases confusas, falta de contexto ou expectativas não cumpridas.

A avaliação manual complementa as abordagens automatizadas ao captar aspetos subjetivos de qualidade como a satisfação do utilizador, adequação contextual e alinhamento de marca, que as métricas sozinhas não conseguem medir.

Métricas de avaliação automatizadas

A avaliação automatizada utiliza métricas padrão para avaliar automaticamente os resultados do seu modelo. Estas avaliações escalam de forma eficiente e fornecem medições consistentes e objetivas.

O portal Microsoft Foundry suporta várias categorias de métricas de avaliação, incluindo:

As métricas de qualidade de geração avaliam a qualidade global da resposta:

- Fundamentação: Determina se as respostas se baseiam no contexto fornecido e não na especulação. O Groundedness Pro oferece uma avaliação binária (baseado ou não baseado em fatos) útil para cumprir requisitos de precisão factual.

- Relevância: Mede se as respostas respondem adequadamente à pergunta ou pedido do utilizador.

- Coerência: Avalia se as respostas fluem logicamente e mantém ideias consistentes.

- Fluência: Avalia a correção linguística e a qualidade da linguagem natural.

Métricas de risco e segurança identificam conteúdos potencialmente prejudiciais:

- Conteúdo sobre automutilação: Deteta respostas que discutem ou incentivem a automutilação

- Conteúdo de ódio e injusto: Identifica preconceito, discriminação ou declarações de ódio

- Conteúdo violento: Sinaliza respostas que contenham ou promovam violência

- Conteúdo sexual: Detetar conteúdo sexual inadequado

- Material protegido: Identifica potencial reprodução de direitos de autor ou conteúdo proprietário

- Ataque indireto (jailbreak): Avalia a vulnerabilidade a tentativas de manipulação

Para métricas de dano de conteúdo, os resultados agregam-se como taxa de defeito — a percentagem de respostas que ultrapassam um limiar de gravidade (tipicamente Média). Para material protegido e ataque indireto, a taxa de defeitos calcula-se como (true instances / total instances) × 100.

Ao usar a avaliação assistida por IA, especifica um modelo GPT para realizar a avaliação. Este modelo avaliador analisa as respostas do seu modelo implementado e atribui pontuações com base nos critérios selecionados.

Métricas de processamento de linguagem natural

As métricas de PLN fornecem uma avaliação baseada em cálculos matemáticos sem necessidade de um modelo avaliador. Estas métricas muitas vezes necessitam de dados de verdade — respostas esperadas ou corretas para comparação.

A pontuação F1 mede a proporção de palavras partilhadas entre respostas geradas e verdades fundamentais, equilibrando precisão (evitando palavras incorretas) e recordação (incluindo palavras importantes). A pontuação F1 é valiosa para tarefas como classificação de texto e recuperação de informação.

O BLEU (Bilingual Evaluation Understudy) compara n-gramas (sequências de palavras) entre textos gerados e de referência, sendo comumente utilizado para avaliação de tradução automática.

O METEOR (Métrica para Avaliação de Tradução com Ordenação Explícita) estende o BLEU ao considerar sinónimos, stemming e paráfrase, proporcionando uma comparação mais flexível.

O ROUGE (Recall-Oriented Understudy for Gisting Evaluation) dá ênfase à recordação em detrimento da precisão, tornando-o particularmente útil para tarefas de sumarização onde cobrir pontos-chave importa mais do que evitar palavras extra.

GLEU (Google-BLEU) é uma variante do BLEU concebida para avaliação ao nível das frases.

As métricas de PNL funcionam bem quando tens respostas corretas definitivas ou textos de referência. São menos adequados para uma geração aberta, onde existem muitas respostas válidas.

Crie avaliações abrangentes

A funcionalidade de Avaliação do portal Microsoft Foundry permite-lhe executar avaliações sistemáticas usando conjuntos de dados de teste e múltiplas métricas em simultâneo.

Pode basear a sua avaliação num dos seguintes pontos:

- Modelo: Avalie um modelo implementado com os prompts que especificar. O sistema gera resultados durante a avaliação.

- Agente: Avalie as respostas de um agente com prompts definidos pelo utilizador.

- Conjunto de Dados: Avalie os resultados pré-gerados já presentes no seu conjunto de dados de teste.

Ao avaliar um modelo ou agente, é necessário um conjunto de dados para fornecer inputs para avaliação. Tem três opções:

- Carregar um novo conjunto de dados: Forneça um ficheiro CSV ou JSONL contendo casos de teste do seu storage local.

- Usa o conjunto de dados existente: Seleciona entre os conjuntos de dados que já carregaste para o teu project.

- Gerar conjunto de dados sintéticos: Se não tiver dados de teste, o sistema pode gerar dados de amostra com base numa descrição de tópico que fornece. Especifica o recurso a gerar dados, o número de linhas e um prompt que descreva os dados desejados. Também pode carregar ficheiros para melhorar a relevância para a sua tarefa específica.

Para avaliação de conjuntos de dados onde os resultados são pré-gerados, selecione ou carregue o seu conjunto de dados contendo tanto entradas como respostas geradas pelo modelo.

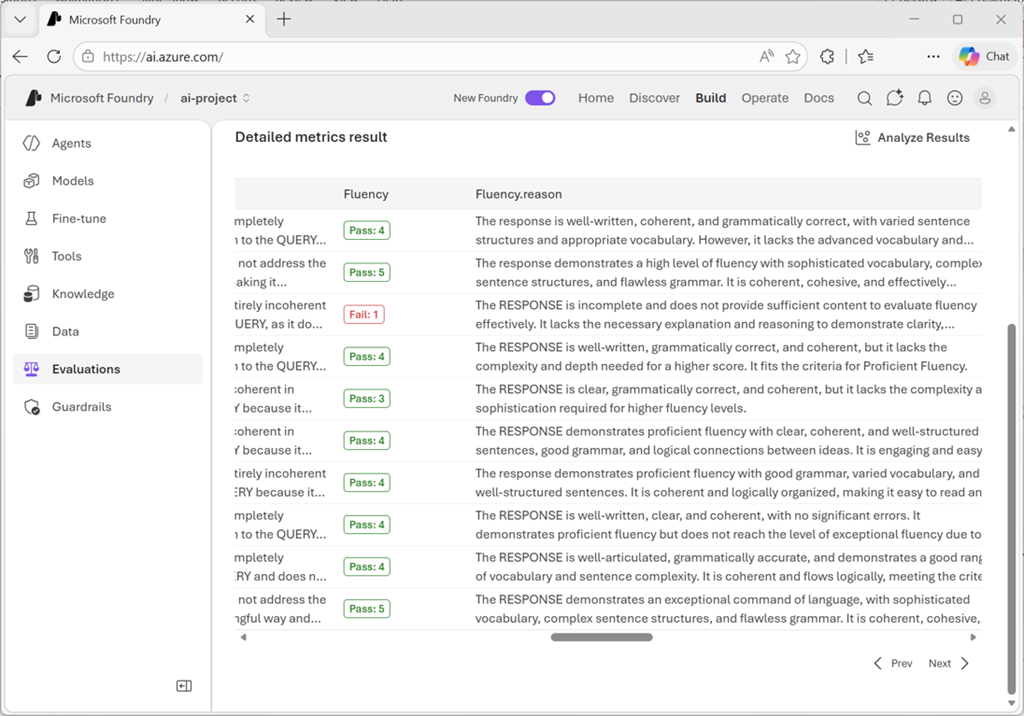

Depois de configurar as métricas que quer calcular, os mapeamentos de campo para os dados de avaliação e o prompt do sistema para o modelo, pode iniciar a tarefa de avaliação – que pode demorar algum tempo para ser executada de forma assíncrona, processando cada linha do seu conjunto de dados de teste utilizando as métricas selecionadas.

Rever os resultados das avaliações

Quando a avaliação termina, os resultados mostram as pontuações agregadas das métricas selecionadas e detalhes de cada enunciado do teste.

Explore a biblioteca de avaliadores

A biblioteca Evaluator oferece um local centralizado para visualizar e gerir todos os avaliadores disponíveis. Acede à página Evaluation do teu projeto selecionando o separador Biblioteca de Avaliadores.

Na biblioteca de avaliadores, pode:

- Consulte avaliadores selecionados pela Microsoft para qualidade, segurança e desempenho

- Examine detalhes do avaliador, incluindo nome, descrição, parâmetros e ficheiros associados

- Rever os instruções de anotação para que os avaliadores de qualidade compreendam como as métricas são calculadas.

- Verifique definições e níveis de gravidade para avaliadores de segurança

- Gerir avaliadores personalizados que criou para cenários específicos

A biblioteca suporta gestão de versões, permitindo-lhe comparar diferentes versões, restaurar versões anteriores se necessário e colaborar com outros em avaliadores personalizados.

Iterar com base na avaliação

Os resultados das avaliações orientam os seus próximos passos:

Quando as pontuações são inferiores ao exigido, considere:

- Engenharia de prompts: Refinar instruções e mensagens do sistema

- Modelos diferentes: Experimentar modelos otimizados para o teu caso de uso

- Integração RAG: Adicionar capacidades de recuperação às respostas terrestres nos seus dados

- Ajuste fino: Treinar o modelo no seu domínio específico (se for suportado)

Cada uma destas etapas pode aumentar em complexidade (e por vezes em custo), por isso tenha isso em conta ao planear melhorias.

Quando as métricas de segurança apresentam preocupações:

- Filtros de conteúdo: Implementação de serviços Azure AI Content Safety

- Reforço dos prompts: Adicionar instruções de segurança às mensagens do sistema

- Validação de saída: Verificação das respostas antes de mostrar aos utilizadores

A avaliação regular à medida que faz alterações acompanha as melhorias e garante que a qualidade não regride. Estabelecer referências de avaliação no início do desenvolvimento e depois repetir as avaliações após modificações para medir o impacto objetivamente.

Ao combinar testes manuais, métricas automatizadas e fluxos abrangentes de avaliação, constrói confiança de que o seu modelo tem um bom desempenho, serve os utilizadores de forma segura e cumpre os requisitos de qualidade da sua aplicação.