Фильтрация контента в Azure AI Studio

Внимание

Некоторые функции, описанные в этой статье, могут быть доступны только в предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Дополнительные сведения см. в статье Дополнительные условия использования Предварительных версий Microsoft Azure.

Azure AI Studio включает систему фильтрации содержимого, которая работает вместе с основными моделями и моделями создания образов DALL-E.

Внимание

Система фильтрации контента не применяется к запросам и завершениям, обрабатываемым моделью Whisper в службе Azure OpenAI. Дополнительные сведения о модели Whisper в Azure OpenAI.

Принцип работы

Эта система фильтрации содержимого поддерживается безопасностью содержимого ИИ Azure, и она работает, выполняя как входные данные запроса, так и выходные данные завершения с помощью ансамбля моделей классификации, направленных на обнаружение и предотвращение вывода вредного содержимого. Изменения в конфигурациях API и дизайне приложения могут повлиять на завершение и, следовательно, на поведение фильтрации.

При развертывании модели Azure OpenAI можно использовать фильтр содержимого по умолчанию или создать собственный фильтр содержимого (описанный далее). Фильтр содержимого по умолчанию также доступен для других текстовых моделей, курируемых СИ Azure в каталоге моделей, но пользовательские фильтры содержимого пока недоступны для этих моделей. Модели, доступные через модели как услуга , имеют фильтрацию содержимого по умолчанию и не могут быть настроены.

Поддержка языков

Модели фильтрации контента были обучены и протестированы на следующих языках: английский, немецкий, японский, испанский, французский, итальянский, португальский и китайский. Однако служба может работать на многих других языках, но качество может отличаться. В любом случае вам следует провести собственное тестирование, чтобы убедиться, что она работает для вашего приложения.

Создание фильтра содержимого

Для любого развертывания модели в Azure AI Studio можно напрямую использовать фильтр содержимого по умолчанию, но вам может потребоваться больше управления. Например, можно сделать фильтр более строгим или более мягким или включить более сложные возможности, такие как экраны запросов и защищенное обнаружение материалов.

Выполните следующие действия, чтобы создать фильтр содержимого:

Перейдите в AI Studio и перейдите к центру. Затем выберите вкладку "Фильтры содержимого" на левой панели навигации и нажмите кнопку "Создать фильтр содержимого".

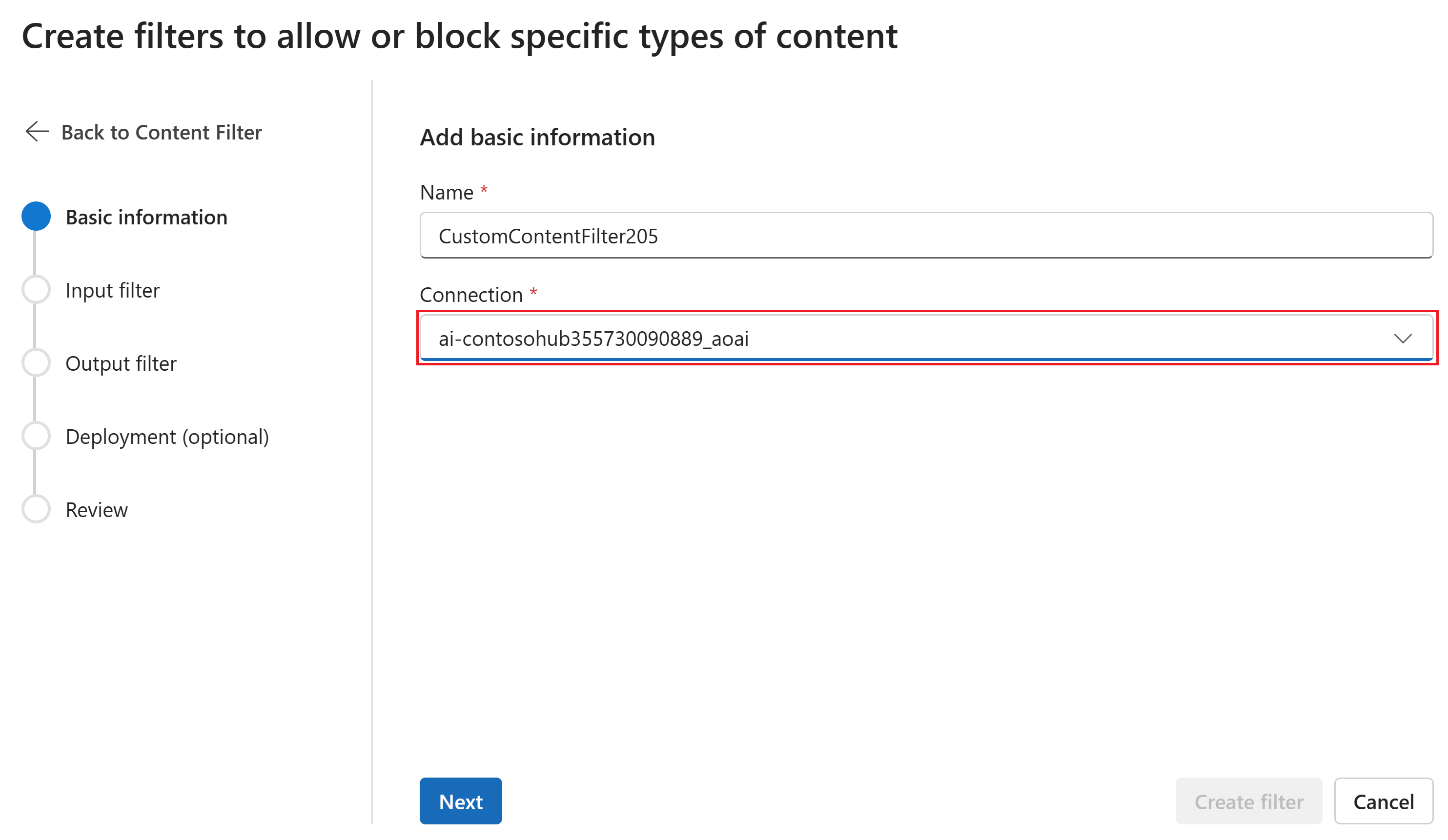

На странице "Основные сведения" введите имя фильтра содержимого. Выберите соединение для связывания с фильтром содержимого. Затем выберите Далее.

На странице "Входные фильтры" можно задать фильтр для запроса ввода. Задайте пороговое значение уровня действия и серьезности для каждого типа фильтра. На этой странице настраивается как фильтры по умолчанию, так и другие фильтры (например, экраны запроса для атак в тюрьме). Затем выберите Далее.

Содержимое будет аннотировано по категориям и заблокировано в соответствии с заданным пороговым значением. Для насилия, ненависти, сексуальной и самовредяющей категории, отрегулируйте ползунок, чтобы заблокировать содержимое высокого, среднего или низкого уровня серьезности.

На странице "Фильтры выходных данных" можно настроить выходной фильтр, который будет применяться ко всему выходному содержимому, созданному моделью. Настройте отдельные фильтры, как и раньше. Эта страница также предоставляет параметр режима потоковой передачи, который позволяет фильтровать содержимое практически в режиме реального времени по мере его создания моделью, уменьшая задержку. После завершения нажмите кнопку "Далее".

Содержимое будет аннотировано каждой категорией и заблокировано в соответствии с пороговым значением. Для насильственного содержимого, ненавидимого содержимого, сексуального содержимого и категории содержимого самоповреждения настройте пороговое значение, чтобы заблокировать вредное содержимое с равными или более высокими уровнями серьезности.

При необходимости на странице развертывания можно связать фильтр содержимого с развертыванием. Если выбранное развертывание уже подключено к фильтру, необходимо убедиться, что вы хотите заменить его. Вы также можете связать фильтр содержимого с развертыванием позже. Нажмите кнопку создания.

Конфигурации фильтрации содержимого создаются на уровне концентратора в AI Studio. Дополнительные сведения о настройке см. в документации По Azure OpenAI.

На странице "Рецензирование" просмотрите параметры и нажмите кнопку "Создать фильтр".

Использование списка блокировок в качестве фильтра

Список блокировок можно применить как входной или выходной фильтр или оба. Включите параметр "Список блокировок" на странице фильтра входных данных и (или) фильтра вывода. Выберите один или несколько списков блокировок из раскрывающегося списка или используйте встроенный список блокировок ненормативной лексики. Вы можете объединить несколько блок-списков в один фильтр.

Применение фильтра содержимого

Процесс создания фильтра позволяет применить фильтр к нужным развертываниям. Вы также можете изменять или удалять фильтры содержимого из развертываний в любое время.

Выполните следующие действия, чтобы применить фильтр содержимого к развертыванию:

Перейдите в AI Studio и выберите проект.

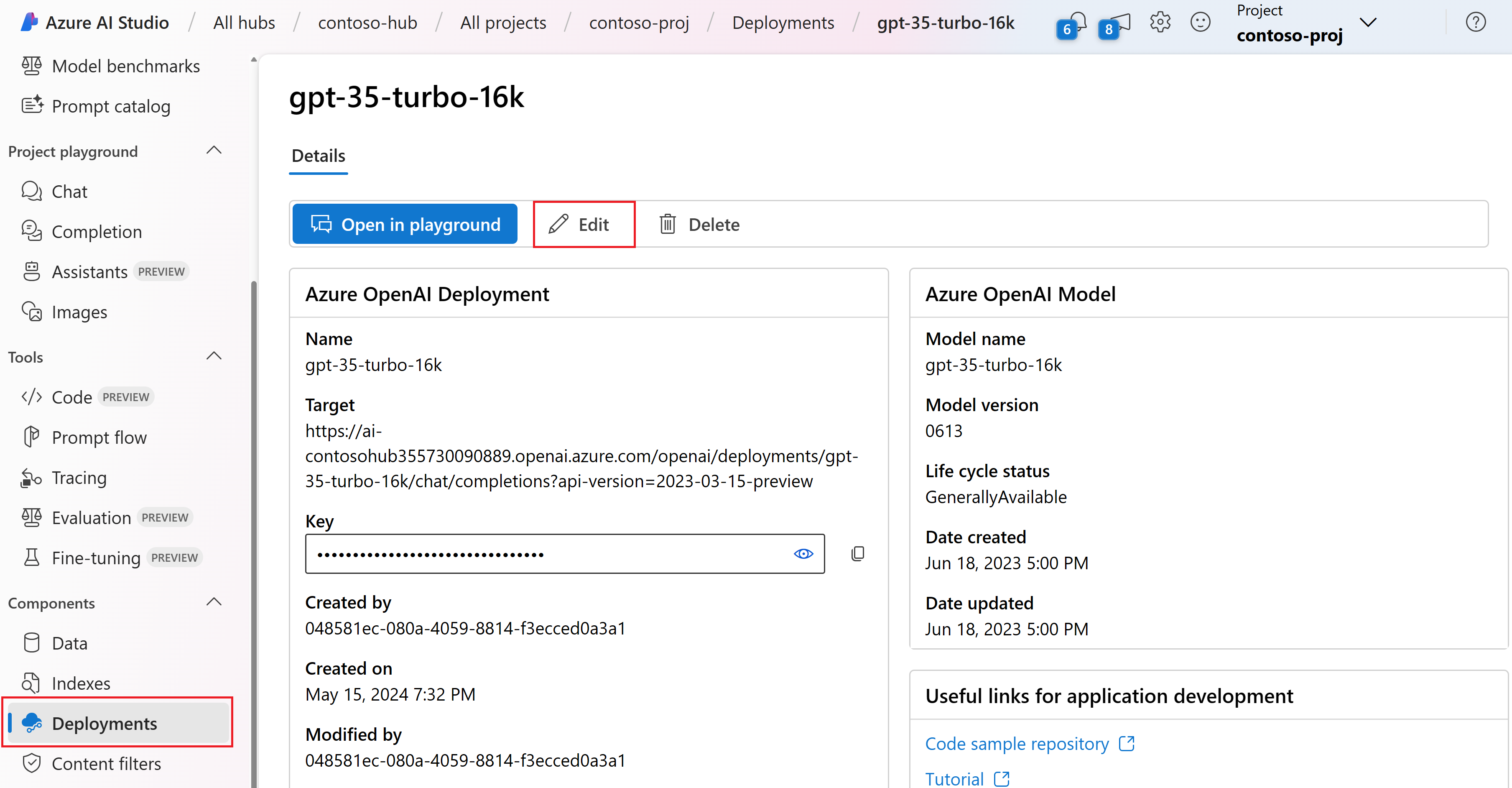

Выберите развертывания и выберите один из развертываний, а затем нажмите кнопку "Изменить".

В окне развертывания обновления выберите фильтр содержимого, который нужно применить к развертыванию.

Теперь вы можете перейти на площадку, чтобы проверить, работает ли фильтр содержимого должным образом.

Категории

| Категория | Description |

|---|---|

| Hate | Категория ненависти описывает атаки на язык или использует их, в том числе дискриминационный или дискриминационный язык со ссылкой на человека или группу личности на основе определенных различных атрибутов этих групп, включая, но не ограничивается расой, этнической принадлежности, национальностью, гендерной идентификацией и выражением, сексуальной ориентацией, религией, иммиграционным статусом, статусом способности, личным видом и размером тела. |

| Половой | Сексуальная категория описывает язык, связанный с анатомическими органами и гениталиями, романтические отношения, действия, изображаемые в эротических или ласковых терминах, физические акты, в том числе те, которые изображаются как нападение или принудительный сексуальный насильственный акт против воли, проституции, порнографии и злоупотреблений. |

| Насилие | Категория насилия описывает язык, связанный с физическими действиями, предназначенными для того, чтобы повредить, ранить, повредить или убить кого-то или что-то; описывает оружие и т. д. |

| Самоповредение | Категория самоповреждения описывает язык, связанный с физическими действиями, предназначенными для намеренного повреждения, травмы или повреждения тела человека, или убить себя. |

Уровни серьезности

| Категория | Description |

|---|---|

| Safe | Содержимое может быть связано с насилием, самоповредение, сексуальные или ненавистные категории, но термины используются в целом, журналистские, научные, медицинские и аналогичные профессиональные контексты, которые подходят для большинства аудиторий. |

| Низкая | Содержимое, которое выражает предрассудки, суждение или мнение мнения, включает в себя оскорбительный использование языка, стереотипии, варианты использования, изучающие вымышленный мир (например, игры, литература) и изображения с низкой интенсивностью. |

| Средняя | Содержимое, использующее оскорбительные, оскорбительные, высмеивание, запугивание или унижение языка в отношении определенных групп удостоверений, включает изображения поиска и выполнения вредных инструкций, фантазий, славения, поощрения вреда в средней интенсивности. |

| Высокая | Содержимое, отображающее явные и серьезные вредные инструкции, действия, ущерб или злоупотребление; включает в себя одобрение, славу или продвижение серьезных вредных актов, крайних или незаконных форм вреда, радикализации или неконсенсуального обмена властью или злоупотреблений. |

Настройка (предварительная версия)

Конфигурация фильтрации содержимого по умолчанию для серии моделей GPT настроена на фильтрацию по порогу средней серьезности для всех четырех категорий вреда содержимого (ненависти, насилия, сексуального и самостоятельного вреда) и применяется к обоим запросам (тексту, много модальному тексту или изображению) и завершениям (текст). Это означает, что содержимое, обнаруженное на уровне серьезности среднего или высокого уровня, фильтруется, а содержимое, обнаруженное на низком уровне серьезности, не фильтруется фильтрами содержимого. Для DALL-E порог серьезности по умолчанию имеет низкое значение для запросов (текста) и завершения (изображений), поэтому содержимое, обнаруженное на уровнях серьезности с низким, средним или высоким, фильтруется.

Функция настройки позволяет клиентам настраивать параметры отдельно для запросов и завершения, чтобы фильтровать содержимое для каждой категории контента на разных уровнях серьезности, как описано в таблице ниже:

| Фильтрация серьезности | Настраиваемая для запросов | Настраиваемая для завершения | Descriptions |

|---|---|---|---|

| Низкий, средний, высокий | Да | Да | Самая строгая конфигурация фильтрации. Содержимое, обнаруженное на уровнях серьезности с низким, средним и высоким, фильтруется. |

| Средний, высокий | Да | Да | Содержимое, обнаруженное на низком уровне серьезности, не фильтруется, содержимое на среднем и высоком уровне фильтруется. |

| Высокая | Да | Да | Содержимое, обнаруженное на уровнях серьезности, не фильтруется. Фильтруется только содержимое на высоком уровне серьезности. Требуется утверждение1. |

| Фильтры отсутствуют. | Если утверждено1 | Если утверждено1 | Содержимое не фильтруется независимо от уровня серьезности. Требуется утверждение1. |

1 Для моделей Azure OpenAI только клиенты, утвержденные для фильтрации измененного содержимого, имеют полный контроль фильтрации содержимого, включая настройку фильтров содержимого на уровне серьезности только или отключение фильтров содержимого. Подайте заявку на изменение фильтров контента, заполнив эту форму: Обзор ограниченного доступа Azure OpenAI: измененные фильтры содержимого и мониторинг злоупотреблений (microsoft.com)

Клиенты отвечают за обеспечение соответствия приложений, интегрирующих Azure OpenAI кодексу поведения.

Другие фильтры входных данных

Вы также можете включить специальные фильтры для сценариев создания искусственного интеллекта:

- Атаки в тюрьме: атаки в тюрьме — это запросы пользователей, предназначенные для того, чтобы спровоцировать модель генерированного искусственного интеллекта на отображение поведения, которое было обучено избежать или нарушить набор правил, заданных в системном сообщении.

- Косвенные атаки: непрямые атаки, также называемые непрямой атакой на запросы или атаки на внедрение запросов между доменами, являются потенциальной уязвимостью, в которой сторонние стороны размещают вредоносные инструкции в документах, к которым может обращаться и обрабатывать система генерированного искусственного интеллекта.

Другие фильтры выходных данных

Вы также можете включить следующие специальные фильтры выходных данных:

- Защищенный материал для текста: защищенный текст описывает известное текстовое содержимое (например, текст песни, статьи, рецепты и выбранное веб-содержимое), которое можно выводить большими языковыми моделями.

- Защищенный материал для кода: защищенный материальный код описывает исходный код, соответствующий набору исходного кода из общедоступных репозиториев, которые можно выводить большими языковыми моделями без надлежащей ссылки на исходные репозитории.

- Заземление. Фильтр обнаружения заземления определяет, находятся ли текстовые ответы больших языковых моделей (LLM) в исходных материалах, предоставляемых пользователями.

Следующие шаги

- Ознакомьтесь с дополнительными сведениями о базовых моделях, лежащих в основе Azure OpenAI.

- Фильтрация содержимого Azure AI Studio осуществляется с помощью безопасности содержимого ИИ Azure.

- Дополнительные сведения о понимании и устранении рисков, связанных с приложением, см . в обзоре методик ответственного ИИ для моделей Azure OpenAI.