Управление безопасностью ИИ (предварительная версия)

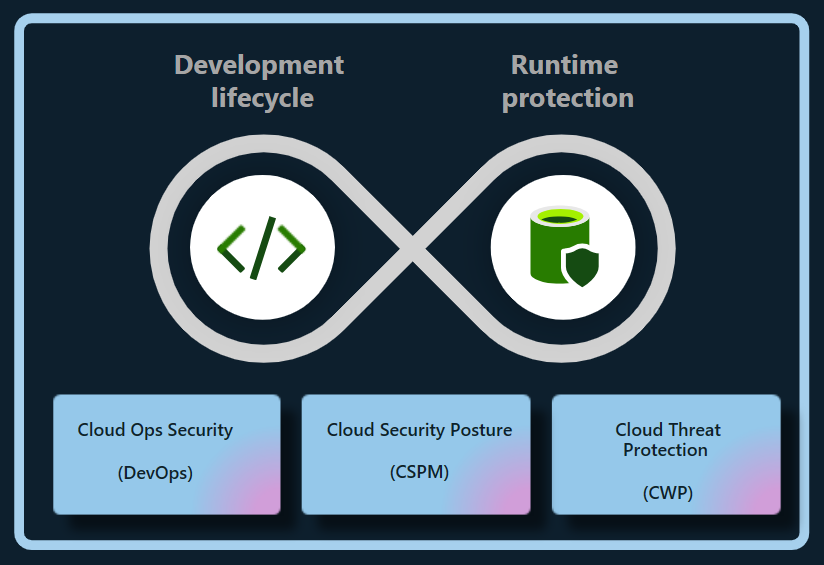

План управления posture Cloud Security (CSPM) Defender в Microsoft Defender для облака предоставляет возможности управления безопасностью ИИ, которые обеспечивают защиту корпоративных, многооблачных или гибридных облачных приложений (в настоящее время Azure и AWS) на протяжении всего жизненного цикла приложений ИИ. Defender для облака снижает риск перекрестной облачной рабочей нагрузки искусственного интеллекта на основе:

- Обнаружение созданных ими счетов за материалы (ИИ BOM), включающее компоненты приложений, данные и артефакты ИИ из кода в облако.

- Укрепление состояния безопасности приложений и создания ими с помощью встроенных рекомендаций и изучения и устранения рисков безопасности.

- Использование анализа пути атаки для выявления и устранения рисков.

Внимание

Чтобы включить возможности управления безопасностью искусственного интеллекта в учетной записи AWS, которая уже:

- Подключен к учетной записи Azure.

- Включен CSPM Defender.

- Имеет тип разрешений, заданный как минимальный доступ к привилегиям.

Необходимо перенастроить разрешения для этого соединителя, чтобы включить соответствующие разрешения, выполнив следующие действия.

- На портале Azure перейдите на страницу "Параметры среды" и выберите соответствующий соединитель AWS.

- Выберите "Настроить доступ".

- Убедитесь, что для типа разрешений задано значение "Минимальный доступ к привилегиям".

- Выполните шаги 5– 8 , чтобы завершить настройку.

Обнаружение созданных приложений ИИ

Defender для облака обнаруживает рабочие нагрузки ИИ и определяет сведения о BOM вашей организации. Эта видимость позволяет выявлять уязвимости и устранять уязвимости и защищать созданные приложения ИИ от потенциальных угроз.

Defenders for Cloud автоматически и непрерывно обнаруживает развернутые рабочие нагрузки искусственного интеллекта в следующих службах:

- Служба Azure OpenAI

- Машинное обучение Azure

- Amazon Bedrock

Defender для облака также могут обнаруживать уязвимости в зависимостях библиотеки создания ИИ, таких как TensorFlow, PyTorch и Langchain, сканируя исходный код для инфраструктуры как кода (IaC) неправильно настроенных и образов контейнеров для уязвимостей. Регулярное обновление или исправление библиотек может препятствовать эксплойтам, защите создаваемых приложений ИИ и поддержанию их целостности.

С помощью этих функций Defender для облака обеспечивает полную видимость рабочих нагрузок ИИ из кода в облако.

Снижение рисков для создания приложений искусственного интеллекта

CSPM Defender предоставляет контекстную информацию о безопасности ИИ организации. Вы можете снизить риски в рабочих нагрузках ИИ, используя рекомендации по безопасности и анализ пути атаки.

Изучение рисков с помощью рекомендаций

Defender для облака оценивает рабочие нагрузки ИИ и проблемы с рекомендациями по идентификации, безопасности данных и интернету для выявления и приоритета критически важных проблем безопасности в рабочих нагрузках ИИ.

Обнаружение неправильных конфигураций IaC

Безопасность DevOps обнаруживает неправильные конфигурации IaC, которые могут предоставлять созданные приложения ИИ уязвимостям безопасности, например чрезмерно предоставляемые средства управления доступом или непреднамеренно предоставляемые общедоступные службы. Эти неправильные конфигурации могут привести к нарушениям данных, несанкционированным доступом и соответствию требованиям, особенно при обработке строгих правил конфиденциальности данных.

Defender для облака оценивает конфигурацию созданных приложений ИИ и предоставляет рекомендации по обеспечению безопасности для улучшения состояния безопасности ИИ.

Обнаруженные неправильные конфигурации должны быть исправлены в начале цикла разработки, чтобы предотвратить более сложные проблемы позже.

К текущим проверкам безопасности искусственного интеллекта IaC относятся:

- Использование частных конечных точек службы искусственного интеллекта Azure

- Ограничение конечных точек службы искусственного интеллекта Azure

- Использование управляемого удостоверения для учетных записей службы ИИ Azure

- Использование проверки подлинности на основе удостоверений для учетных записей службы ИИ Azure

Изучение рисков с помощью анализа путей атаки

Анализ путей атак обнаруживает и устраняет риски для рабочих нагрузок ИИ, особенно во время приземления (связывания моделей ИИ с конкретными данными) и точной настройки (корректировки предварительно обученной модели на определенном наборе данных для повышения производительности на этапах связанной задачи), где могут быть предоставлены данные.

Благодаря непрерывному мониторингу рабочих нагрузок ИИ анализ пути атаки может выявлять слабые места и потенциальные уязвимости и выполнять рекомендации. Кроме того, она распространяется на случаи, когда данные и вычислительные ресурсы распределяются между Azure, AWS и GCP.