Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Существует несколько способов загрузки данных в lakehouse: от простой отправки файлов до масштабируемых конвейеров и потоковой передачи в реальном времени. Правильный подход зависит от источника данных, объема, сложности преобразования и необходимости однократной загрузки данных или непрерывного поступления данных.

Способы загрузки данных в Lakehouse

В следующих разделах описан каждый подход — отправка файлов, ярлыки, поток данных 2-го поколения, конвейеры данных, код записной книжки и поток событий, упорядоченный с самого простого варианта без кода до более сложных программных и методов в режиме реального времени.

Отправить файлы

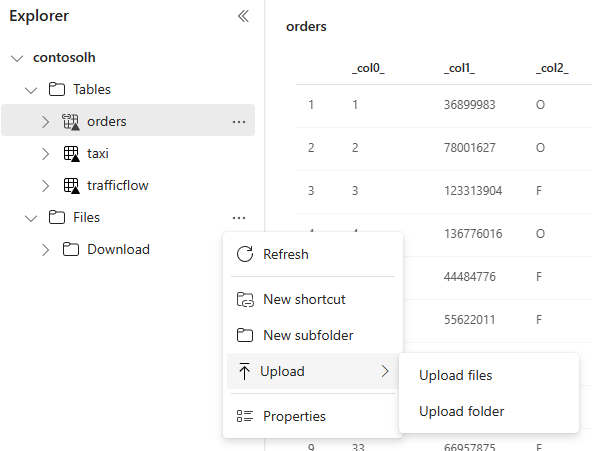

Чтобы загрузить небольшие файлы в lakehouse без каких-либо преобразований, отправьте их непосредственно с локального компьютера через обозреватель Lakehouse.

Сочетания клавиш

Ярлыки позволяют обращаться к данным в других местах хранения данных без копирования. Ярлык отображается в виде папки в lakehouse, но указывает на данные, хранящиеся в другом месте, в другом лейкхаусе, учетной записи Azure Data Lake Storage 2-го поколения, Amazon S3 или других поддерживаемых источниках. Сочетания клавиш полезны, если вы хотите запрашивать или присоединять данные между источниками, не дублируя их. Дополнительные сведения см. в разделе "Ярлыки" в озерном доме.

Поток данных 2-го поколения

Поток данных 2-го поколения — это средство преобразования данных с низким кодом с более чем 200 соединителями. Вы определяете преобразования визуально в интерфейсе Power Query и выводите результаты в таблицу Lakehouse. Dataflow Gen2 является хорошим выбором для маленьких наборов данных или когда вам нужны соединители, недоступные в других инструментах. Дополнительные сведения см. в статье "Создание первого потока данных для получения и преобразования данных".

Конвейеры данных

Конвейеры данных предоставляют масштабируемое средство для копирования для переноса больших объемов данных в озерохранилище. Действие копирования подключается к широкому спектру источников данных и может загружать данные в исходном формате или преобразовывать их в разностную таблицу. Вы можете запланировать конвейеры, активировать их на основе событий и объединить несколько действий. Дополнительные сведения см. в разделе "Копирование данных с помощью действия копирования".

Код ноутбука

Записные книжки Spark обеспечивают полный программный контроль над приемом данных. Используйте библиотеки Spark для подключения к источнику данных, загрузки данных в DataFrame, применения преобразований и сохранения результатов в lakehouse. Этот подход является наиболее гибким и подходит для сложной логики преобразования или источников, которые другие средства не поддерживают.

Примечание.

Внешние таблицы Delta, созданные с помощью кода Spark, не видны конечной точке аналитики SQL. Используйте сочетания клавиш в разделе "Таблицы", чтобы сделать внешние таблицы delta видимыми для конечной точки аналитики SQL. Дополнительные сведения см. в разделе "Ярлыки" в озерном доме.

Поток событий

Eventstream осуществляет прием, обработку и маршрутизацию событий в реальном времени большого объема из разнообразных источников. Вы можете установить lakehouse в качестве конечного пункта для сохранения потоковых данных непосредственно в таблицах Delta.

Дополнительные сведения см. в разделе "Получение данных из eventstream" в лейкхаусе.

Для сценариев потоковой передачи временных рядов или высокой пропускной способности можно также передавать события в хранилище событий и включать доступность OneLake. Это создает таблицу Delta в OneLake, которую можно использовать как ярлык для доступа к Lakehouse. Дополнительные сведения см. в статье о доступности Eventhouse OneLake.

Выбор подхода

В следующей таблице кратко описывается, когда использовать каждый метод для загрузки данных в "лейкхаус".

| Сценарий | Рекомендуемый подход |

|---|---|

| Небольшие файлы с локального компьютера | Отправить файлы |

| Эталонные данные без копирования | Сочетания клавиш |

| Небольшие и средние данные с визуальными преобразованиями | Поток данных 2-го поколения |

| Перемещение больших данных | Конвейеры данных |

| Сложные преобразования или неподдерживаемые источники | Код ноутбука |

| Прием событий в режиме реального времени | Поток событий |

| Потоковая передача временных рядов или потоковая передача с высокой пропускной способностью | Перенос данных из Eventstream в Eventhouse с поддержкой OneLake. |

Связанный контент

- Сочетания клавиш в lakehouse

- Потоковая передача данных в lakehouse с использованием Spark

- Копирование данных с помощью действия копирования

- Создание первого потока данных для получения и преобразования данных

- Исследуйте данные в lakehouse с помощью записной книжки

- Добавить пункт назначения Lakehouse в поток событий

- Доступность Eventhouse OneLake