Aktivera aktuella kläder för en observerad person

När du indexerar en video med azure AI Video Indexer avancerade videoinställningar kan du visa aktuella kläder för en observerad person. Insikten ger ögonblick i videon där nyckelpersoner är framträdande och tydligt synliga, inklusive koordinaterna för personerna, tidsstämpeln och bildens ram. Den här insikten möjliggör sammanhangsbaserad annonsering av hög kvalitet i video, där relevanta klädannonser matchas med den specifika tid i videon där de visas.

Den här artikeln beskriver hur du visar den aktuella klädinsikten och hur de aktuella klädbilderna rangordnas.

Visa en introduktionsvideo

Du kan se följande korta video som beskriver hur du visar och använder den aktuella klädinsikten.

Visa aktuella kläder

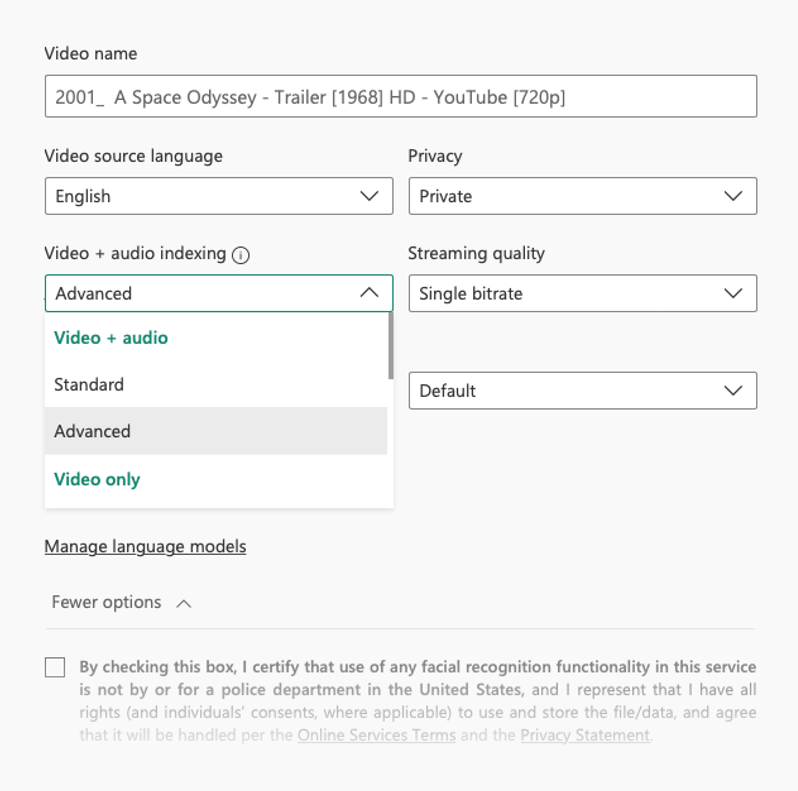

Den aktuella klädinsikten är tillgänglig när du indexerar filen genom att välja alternativet Avancerat –> Avancerad video eller Avancerad video + ljudförinställning (under Video + ljudindexering). Standardindexering innehåller inte den här insikten.

De aktuella klädbilderna rangordnas baserat på några av följande faktorer: viktiga ögonblick i videon, varaktighet som personen visas, textbaserade känslor och ljudhändelser. Insikterna privatar den högst rankade ramen per scen, vilket gör att du kan producera sammanhangsbaserade annonser per scen i hela videon. JSON-filen rangordnas efter sekvensen med scener i videon, där varje scen har den högst rankade ramen som resultat.

Kommentar

Den aktuella klädinsikten kan bara visas från artefaktfilen och insikten finns inte på Webbplatsen för Azure AI Video Indexer.

- I det övre högra hörnet väljer du för att ladda ned zip-filen artefakt: Ladda ned ->Artifact (ZIP)

- Öppna

featuredclothing.zip.

Filen .zip innehåller två objekt:

featuredclothing.map.json- filen innehåller instanser av varje aktuella kläder med följande egenskaper:id– rankningsindex ("id": 1är den viktigaste klädedräkten).confidence– poängen med aktuella kläder.frameIndex– den bästa ramen i kläderna.timestamp– motsvarar frameIndex.opBoundingBox– avgränsningslåda för personen.faceBoundingBox– avgränsningslåda för personens ansikte, om det upptäcks.fileName– där den bästa ramen i kläderna sparas.sceneID- scenen där scenen visas.

Ett exempel på aktuella kläder med

"sceneID": 1."instances": [ { "confidence": 0.07, "faceBoundingBox": {}, "fileName": "frame_100.jpg", "frameIndex": 100, "opBoundingBox": { "x": 0.09062, "y": 0.4, "width": 0.11302, "height": 0.59722 }, "timestamp": "0:00:04", "personName": "Observed Person #1", "sceneId": 1 }featuredclothing.frames.map– den här mappen innehåller bilder av de bästa ramarna som aktuella kläder visades i, vilket motsvararfileNameegenskapen i varje instans ifeaturedclothing.map.json.

Begränsningar och antaganden

Det är viktigt att notera begränsningarna i aktuella kläder för att undvika eller minimera effekterna av falska identifieringar av bilder med låg kvalitet eller låg relevans.

- Förutsättningen för aktuella kläder är att den person som bär kläderna kan hittas i den observerade människor insikt.

- Om ansiktet på en person som bär de aktuella kläderna inte identifieras, inkluderar resultaten inte ansiktets avgränsningsruta.

- Om en person i en video bär mer än en outfit väljer algoritmen sin bästa outfit som en enda aktuell klädbild.

- När de ställs är spåren optimerade för att hantera observerade personer som oftast visas på framsidan.

- Fel identifieringar kan inträffa när personer överlappar varandra.

- Ramar som innehåller suddiga personer är mer benägna att få resultat av låg kvalitet.

Mer information finns i begränsningarna för observerade personer.