Kommentar

Åtkomst till den här sidan kräver auktorisering. Du kan prova att logga in eller ändra kataloger.

Åtkomst till den här sidan kräver auktorisering. Du kan prova att ändra kataloger.

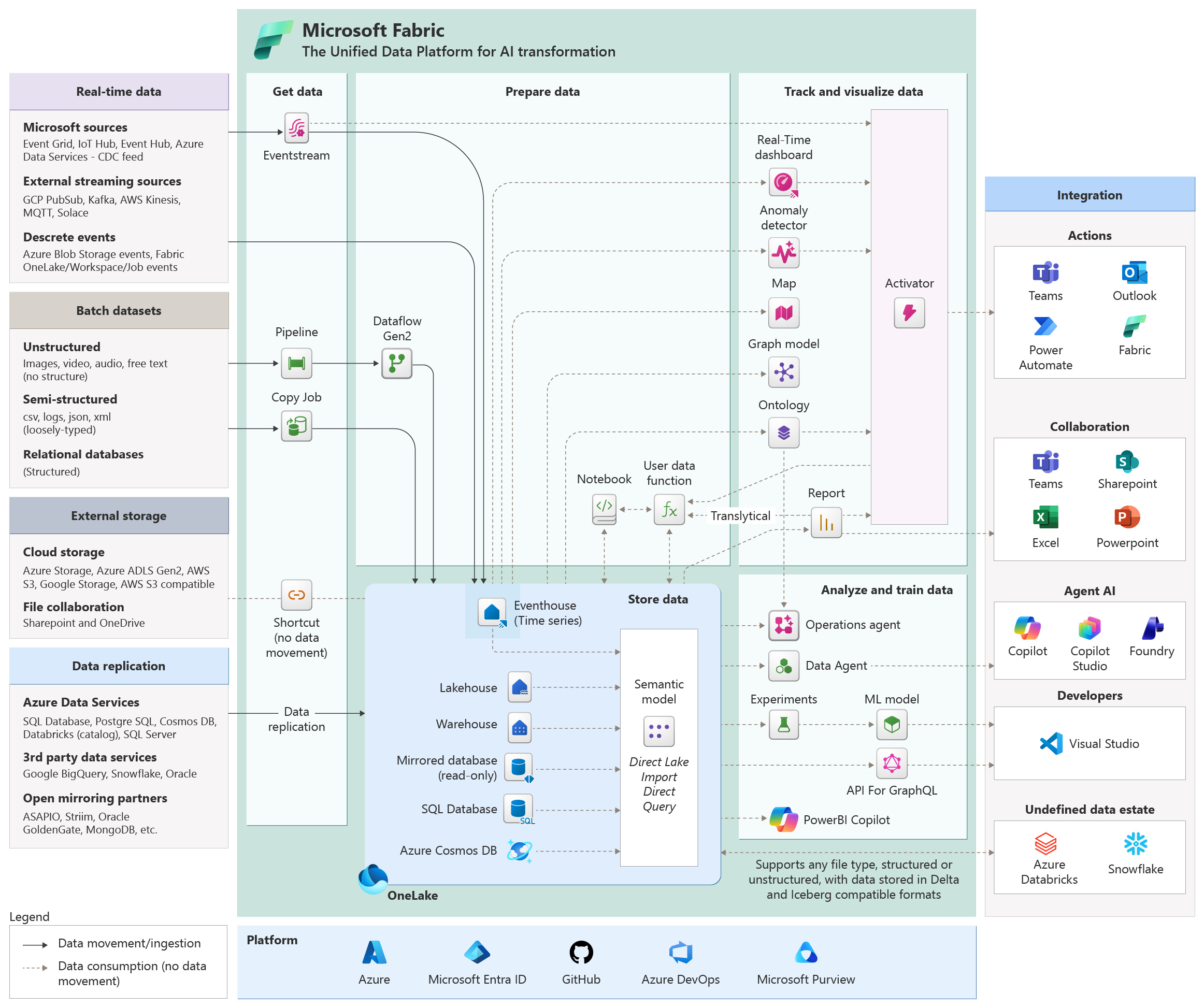

Organisationer förlitar sig vanligtvis på flera frånkopplade tjänster för att mata in, lagra, transformera, analysera och visualisera data. Den här fragmenteringen skapar datasilor, ökar integreringskostnaderna och minskar tiden till insikt. Microsoft Fabric hanterar dessa utmaningar genom att förena varje steg i datalivscykeln till en enda plattform som bygger på en delad grund.

I mitten av den här arkitekturen finns OneLake, en enda organisationsdatasjö som lagrar alla data i öppet Delta Parquet-format. OneLake etableras automatiskt med varje Fabric-abonnent. Eftersom varje Fabric-arbetsbelastning läser från och skriver till OneLake flyttas inte data mellan motorerna. En datauppsättning som matas in via en pipeline, förfinas i en notebook-fil och visualiseras i en Power BI-rapport finns kvar på en plats under hela resan.

Datalivscykeln består av sex steg och Fabric tillhandahåller specialbyggda verktyg för var och en:

Hämta data: Hämta data till OneLake från hundratals källor i realtid, enligt ett schema, genom kontinuerlig databasreplikering eller genom att referera till extern lagring på plats.

Lagra data: Spara data i lagringsformat som är optimerade för din arbetsbelastning, oavsett om det är flexibel stordataanalys, strukturerade SQL-frågor, händelseanalys i realtid, transaktionsbearbetning eller styrd affärsrapportering.

Förbered och transformera: Rensa, forma om och berika data med hjälp av visuella omvandlingar med låga kod eller kod-först notebook-filer och återanvändbara funktioner, utan att behöva flytta data från OneLake.

Analysera och träna: Skapa och operationalisera maskininlärningsmodeller, köra avancerad analys, köra frågor mot data programmatiskt och utforska insikter via AI-agenter på naturligt språk.

Spåra och visualisera: Insikter via interaktiva rapporter, övervaka livedataströmmar på realtidskontrollpaneler och utlösa automatiserade åtgärder när förutsättningarna är uppfyllda.

Extern integrering: Anslut på ett säkert sätt till externa tjänster för automatisering, samarbete, styrning, utvecklarverktyg och CI/CD.

Följande diagram visar hur dessa steg ansluter och vilka Infrastrukturobjekt som deltar i varje steg. Varje steg beskrivs på djupet i en dedikerad artikel. Använd länkarna i varje avsnitt för att utforska de funktioner och verktyg som är tillgängliga i det skedet.

Hämta data

Olika typer av datauppsättningar kommer från en mängd olika datakällor i olika datascenarier, inklusive datareplikering, externa lagringsreferenser, batchdatauppsättningar och dataströmmar i realtid. Du matar in och transformerar dessa datauppsättningar via Fabrics integreringsverktyg. Data hamnar i OneLake, den centraliserade datalagringen för hela Fabric. Viktiga inmatningsmetoder är:

- Händelseströmmar för händelseinmatning och routning i realtid.

- Data-pipelines för batch- och schemalagd dataflytt med fler än 200 anslutningar.

- Spegling för kontinuerlig replikering från driftdatabaser utan att skapa ETL-pipelines.

- Genvägar för datavirtualisering utan kopiering från extern lagring som Azure Data Lake, Amazon S3 eller Google Cloud Storage.

Mer information finns i Hämta data till Microsoft Fabric.

Lagra data

När inmatningen är klar hamnar alla data i OneLake i öppet Delta Parquet-format. OneLake tillhandahåller en enda datasjö för hela organisationen utan att det behövs någon separat etablering. Fabric erbjuder flera lagringsobjekt som är optimerade för olika arbetsbelastningar:

- Lakehouse för flexibel lagring av stordata som kombinerar filer och hanterade Delta-tabeller med en automatisk SQL-slutpunkt.

- Informationslager för strukturerad, relationsanalys med fullständigt T-SQL-stöd, lagrade procedurer och ACID-transaktioner.

- Eventhouse för realtidsanalys av strömnings- och telemetridata med hjälp av Kusto Query Language (KQL).

- SQL Database för transaktionsarbetsbelastningar och driftanalys.

- Semantiska modeller för kuraterad affärslogik, mått och hierarkier som driver rapporter och AI.

Mer information finns i Lagra data i Microsoft Fabric.

Förbereda och transformera data

När du väl är i OneLake kan du transformera data ytterligare med hjälp av antingen kod-först-motorer eller lågkodsverktyg, allt inom Fabric utan att flytta data mellan motorerna.

- Dataflow Gen2 tillhandahåller ett Power Query-gränssnitt med låg kod för datarensning, transformering och berikning.

- Notebooks erbjuder en Jupyter-liknande miljö för Python, T-SQL och Scala-baserad data engineering.

- Med användardatafunktioner kan du bädda in återanvändbar anpassad Python-logik som kan anropas från pipelines, notebook-filer och aktivatorregler.

Mer information finns i Förbereda och transformera data.

Analysera data och träna modeller

Använd förberedda data för att träna ML-modeller och utföra avancerad analys. Fabrics Data Science-arbetsbelastning ger en miljö för att skapa, träna och operationalisera ML-modeller:

- MLflow-experiment spårar modellträningskörningar med automatisk loggning av hyperparametrar, mått och objekt.

- ML-modeller registreras i ett MLflow-baserat register för versionshantering, metadataspårning och reproducerbarhet.

- Med dataagenter och driftsagenter kan du interagera med data med hjälp av naturligt språk och agera på de villkor och mönster som hittas.

- GraphQL-API:er tillhandahåller ett flexibelt dataåtkomstlager där utvecklare kan köra frågor mot flera infrastrukturdatakällor via en enda slutpunkt.

- Copilot för Power BI använder generativ AI för ad hoc-analys, DAX-generering och datautforskning på naturligt språk.

Mer information finns i Analysera och träna data i Microsoft Fabric.

Spåra och visualisera data

Använd förberedda och modellerade data för att skapa rapporter, instrumentpaneler och realtidsaviseringar:

- Power BI-rapporter ger interaktiv datavisualisering som bygger på semantiska modeller, med distribution över Microsoft 365-appar som Teams, SharePoint, PowerPoint och Excel.

- Translytiska aktivitetsflöden gör det möjligt för användare att vidta åtgärder direkt från Power BI-rapporter genom att anropa användardatafunktioner.

- Real-Time Intelligence-instrumentpaneler övervakar strömmande data med svarstid under sekunden med hjälp av KQL-frågor och visuell redigering.

- Aktivator identifierar villkor i strömmande data och utlöser automatiserade åtgärder som Teams-aviseringar, e-postmeddelanden eller Power Automate-flöden.

- Fabric IQ mappar företagsdata till en delad affärsontologi och gör det möjligt för AI-agenter att resonera över dina data med fullständig affärskontext.

Mer information finns i Spåra och visualisera data.

Extern integration

Fabric integreras med externa system för både datainmatning och leverans av insikter.

- Power Automate och Data Activator möjliggör automatisering av arbetsflöden i realtid baserat på datavillkor.

- Microsoft 365-integrering ger insikter i Teams, SharePoint, PowerPoint och Excel.

- REST-API:er och klientbibliotek ger programmatisk åtkomst till Infrastrukturresurser.

- Microsoft Entra ID hanterar autentisering, villkorlig åtkomst och support för tjänstesäkerhetsansvarig.

- Git-integrering med Azure DevOps och GitHub möjliggör versionskontroll och CI/CD för Fabric-objekt.

- Microsoft Purview tillhandahåller enhetlig styrning, katalogisering och övervakning av data i datasamlingen.

Mer information finns i Extern integrering och plattformsanslutning.

Stöd för naturligt språk och AI

Stöd för naturligt språk kommer i form av Power BI Copilot, dataagenter och operationsagenter, som kan resonera över företagsdata i OneLake och skapa svar baserat på de dataobjekt som användarna kan komma åt. Du kan integrera dataagenter i Microsoft 365 Copilot, Microsoft Foundry och Copilot Studio så att användarna kan få insikter från OneLake i sina befintliga arbetsflöden i olika program.