Utvärdera modellprestanda

Genom att utvärdera din distribuerade modell ser du till att den uppfyller kvalitetsstandarder, ger korrekta svar och förbättras kontinuerligt med tiden. Microsoft Foundry-portalen erbjuder flera metoder för utvärdering, från manuell testning till automatiserade mått och omfattande utvärderingsflöden.

Varför utvärdera modeller

Utvärdering har flera viktiga syften i generativ AI-programutveckling:

Kvalitetssäkring identifierar problem och säkerställer att din modell ger korrekta, relevanta svar. Att upptäcka problem under utvärderingen i stället för produktion skyddar användarnas och organisationens rykte.

Användarnöjdheten förbättras när modeller konsekvent levererar användbara och lämpliga svar. Utvärdering hjälper dig att förstå hur användarna upplever ditt program och var förbättringar har störst inverkan.

Kontinuerlig förbättring kommer från analys av utvärderingsresultat för att identifiera förbättringsmöjligheter. Regelbunden utvärdering när du uppdaterar frågor, lägger till funktioner eller tränar modeller garanterar kontinuerlig kvalitet.

Efterlevnads- och säkerhetsverifiering bekräftar att din modell följer principer, undviker att generera skadligt innehåll och respekterar användarnas sekretess- och dataskyddskrav.

Manuella utvärderingsmetoder

Manuell utvärdering innebär att mänskliga granskare utvärderar modellsvar. Även om en tidsintensiv manuell utvärdering ger insikter som automatiserade mått inte kan samla in.

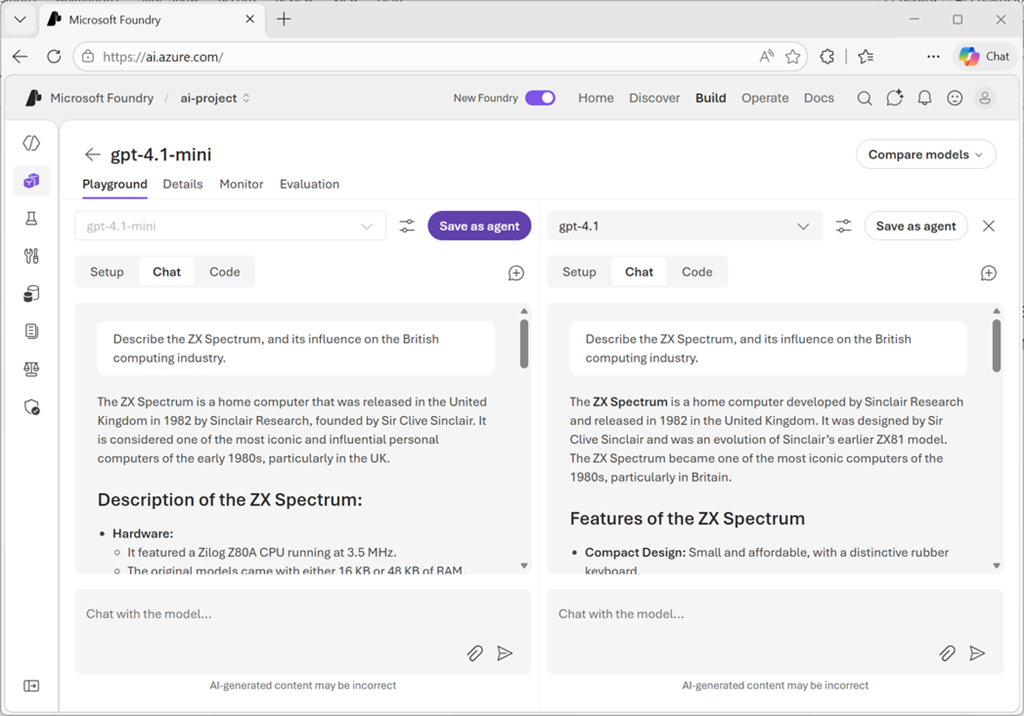

Med interaktiv testning på lekplatsen kan du utforska modellbeteendet kvalitativt. Du anger olika frågor, observerar svar och noterar problem som felaktig information, olämplig ton eller underlåtenhet att följa instruktionerna. Den här undersökande testningen hjälper dig att förstå en modells styrkor och begränsningar.

För att optimera programdesignen kan du testa modeller sida vid sida på lekplatsen, synkronisera systeminstruktioner och uppmaningar om att jämföra deras svar.

Strukturerad granskning innebär att skapa en uppsättning testfall som representerar programmets användningsfall. Mänskliga utvärderare betygsätter svar baserat på kriterier som:

- Relevans: Hanterar svaret frågan eller begäran?

- Informationsrikedom: Ger den tillräckligt med detaljer och användbar information?

- Engagemang: Är svaret intressant och lämpligt samtalsämne?

- Noggrannhet: Är fakta och påståenden korrekta?

- Säkerhet: Undviker svaret skadligt, partiskt eller olämpligt innehåll?

Utvärderare använder vanligtvis klassificeringsskalor (till exempel 1–5) för varje kriterium. Aggregerade klassificeringar i flera testfall ger kvantitativa mått av övergripande kvalitet.

Användarstudier samlar in feedback från faktiska eller representativa användare som interagerar med ditt program. Användarfeedback visar verkliga problem som du kan missa vid kontrollerad testning, till exempel förvirrande frasering, saknade kontexter eller ouppfyllda förväntningar.

Manuell utvärdering kompletterar automatiserade metoder genom att samla in subjektiva kvalitetsaspekter som användarnöjdhet, kontextuell lämplighet och varumärkesanpassning som enbart mått inte kan mäta.

Automatiserade utvärderingsmått

Automatiserad utvärdering använder standardmått för att utvärdera modellens utdata automatiskt. Dessa utvärderingar skalas effektivt och ger konsekventa, objektiva mätningar.

Microsoft Foundry-portalen stöder flera kategorier av utvärderingsmått, bland annat:

Kvalitetsmått för generation utvärderar övergripande svarskvalitet :

- Förankring: Avgör huruvida svaren baseras på tillhandahållen kontext snarare än spekulation. Groundedness Pro erbjuder binär utvärdering (grundad eller inte grundad) användbar för krav på faktamässig noggrannhet.

- Relevans: Mäter om svar hanterar användarens fråga eller begäran på rätt sätt.

- Enhetlighet: Utvärderar om svaren flödar logiskt och upprätthåller konsekventa idéer.

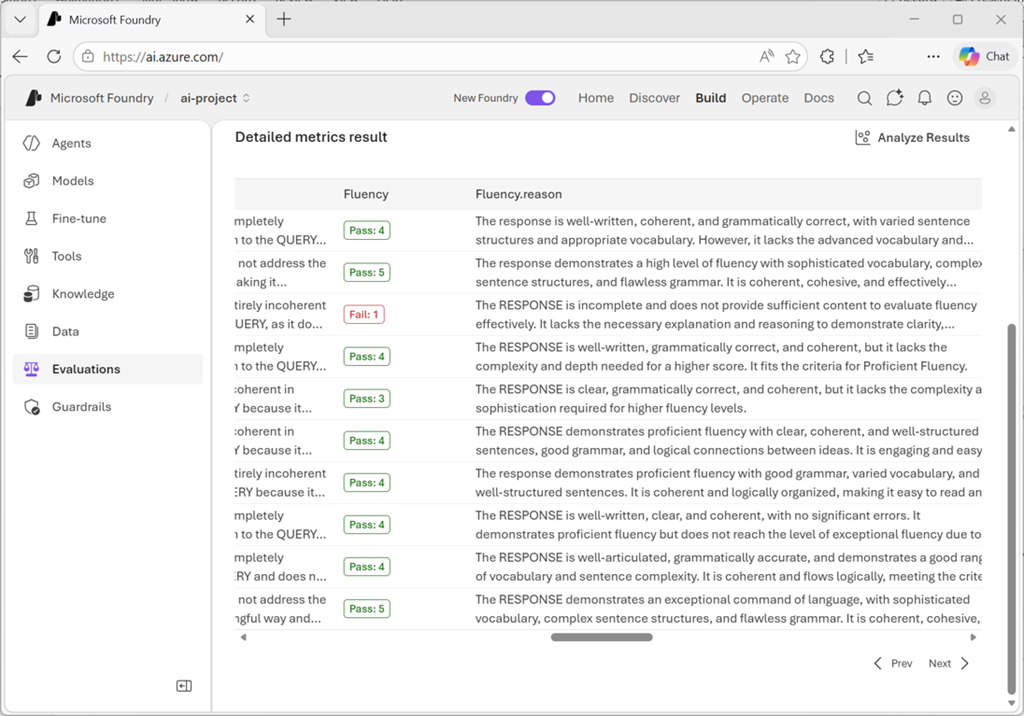

- Fluency: Utvärderar språklig korrekthet och naturlig språkkvalitet.

Risk- och säkerhetsmått identifierar potentiellt skadligt innehåll:

- Självskadeinnehåll: Identifierar svar som diskuterar eller uppmuntrar självskadebeteende

- Hatiskt och orättvist innehåll: Identifierar bias, diskriminering eller hatiska uttalanden

- Våldsamt innehåll: Flaggor som innehåller eller främjar våld

- Sexuellt innehåll: Identifierar olämpligt sexuellt innehåll

- Skyddat material: Identifierar potentiell upphovsrätt eller ägarstyrt innehållsreproduktion

- Indirekt attack (jailbreak): Utvärderar sårbarhet för manipuleringsförsök

För mått för innehållsskador aggregeras resultaten som defektfrekvens – procentandelen svar som överskrider ett tröskelvärde för allvarlighetsgrad (vanligtvis medel). För skyddat material och indirekt attack beräknas defektfrekvensen som (true instances / total instances) × 100.

När du använder AI-assisterad utvärdering anger du en GPT-modell för att utföra utvärderingen. Den här utvärderarmodellen analyserar den distribuerade modellens svar och tilldelar poäng baserat på de valda kriterierna.

Bearbetningsmått för naturligt språk

NLP-mått ger matematiskt baserad utvärdering utan att en utvärderingsmodell krävs. Dessa mått behöver ofta grund sanningsdata – förväntade eller korrekta svar för jämförelse.

F1-poäng mäter förhållandet mellan delade ord mellan genererade och sanna svar och balanserar precision (undvika felaktiga ord) och träffsäkerhet (inklusive viktiga ord). F1-poäng är värdefullt för uppgifter som textklassificering och informationshämtning.

BLEU (Tvåspråkig utvärderingsmotsvarighet) jämför n-gram (ordsekvenser) mellan genererad text och referenstext, som ofta används för utvärdering av maskinöversättning.

METEOR (Metric for Evaluation of Translation with Explicit Ordering) utökar BLEU genom att redovisa synonymer, härstamning och parafras, vilket ger en mer flexibel jämförelse.

ROUGE (Recall-Oriented Understudy for Gisting Evaluation) betonar återkallande över precision, vilket gör det särskilt användbart för sammanfattningsuppgifter där det är viktigare att täcka viktiga punkter än att undvika extra ord.

GLEU (Google-BLEU) är en variant av BLEU som utformats för utvärdering på meningsnivå.

NLP-mått fungerar bra när du har slutgiltiga korrekta svar eller referenstexter. De är mindre lämpliga för öppen generation där det finns många giltiga svar.

Skapa omfattande utvärderingar

Med microsoft Foundry-portalens utvärderingsfunktion kan du köra systematiska utvärderingar med hjälp av testdatauppsättningar och flera mått samtidigt.

Du kan basera utvärderingen på något av följande:

- Modell: Utvärdera en distribuerad modell med de frågor som du anger. Systemet genererar utdata under utvärderingen.

- Agent: Utvärdera en agents svar med användardefinierade frågor.

- Datauppsättning: Utvärdera förgenererade utdata som redan finns i testdatauppsättningen.

När du utvärderar en modell eller agent behöver du en datauppsättning för att tillhandahålla indata för utvärdering. Du har tre alternativ:

- Ladda upp ny datauppsättning: Ange en CSV- eller JSONL-fil som innehåller testfall från din lokala storage.

- Använd befintlig datauppsättning: Välj från datauppsättningar som du tidigare har laddat upp till din project.

- Generera syntetisk datamängd: Om du saknar testdata kan systemet generera exempeldata baserat på en ämnesbeskrivning som du anger. Du anger resursen för att generera data, antalet rader och en fråga som beskriver önskade data. Du kan också ladda upp filer för att förbättra relevansen för din specifika uppgift.

För datamängdsutvärdering där utdata genereras i förväg väljer eller laddar du upp din datauppsättning som innehåller både indata och modellgenererade svar.

När du har konfigurerat de mått som du vill beräkna, fältmappningarna för utvärderingsdata och systemprompten för modellen. du kan starta utvärderingsjobbet – vilket kan ta lite tid att köra asynkront och bearbeta varje rad i testdatauppsättningen mot de valda måtten.

Granska utvärderingsresultat

När utvärderingen är klar visar resultaten aggregerade poäng för de mått som du har valt och information om varje testprompt.

Utforska utvärderingsbiblioteket

Utvärderingsbiblioteket tillhandahåller en central plats för att visa och hantera alla tillgängliga utvärderare. Åtkomst den från sidan för ditt projekt Utvärdering genom att välja fliken Evaluator bibliotek.

I utvärderingsbiblioteket kan du:

- Visa Microsoft-utvalda utvärderare för kvalitet, säkerhet och prestanda

- Granska utvärderarens information, inklusive namn, beskrivning, parametrar och associerade filer

- Granska anteckningsprompter för kvalitetsutvärderingar för att förstå hur mått beräknas

- Kontrollera definitioner och allvarlighetsnivåer för säkerhetsutvärderingar

- Hantera anpassade utvärderare som du har skapat för specifika scenarier

Biblioteket stöder versionshantering så att du kan jämföra olika versioner, återställa tidigare versioner om det behövs och samarbeta med andra om anpassade utvärderare.

Iterera baserat på utvärdering

Utvärderingsresultaten informerar dina nästa steg:

När poängen är lägre än vad som krävs bör du tänka på:

- Prompt-ingenjörskonst: Förfina instruktioner och systemmeddelanden

- Olika modeller: Prova modeller som är optimerade för ditt användningsfall

- RAG-integrering: Lägga till hämtningsfunktioner för att grunda svaren i dina data

- Finjustering: Träna modellen på din specifika domän (om den stöds)

Vart och ett av dessa steg kan växa i komplexitet (och ibland kostnad), så ta hänsyn till det när du planerar förbättringar.

När säkerhetsmått visar på problem:

- Innehållsfilter: Implementera Azure AI Innehållssäkerhetstjänster

- Snabbhärdning: Lägga till säkerhetsinstruktioner i systemmeddelanden

- Utdataverifiering: Kontrollera svar innan de visas för användare

Regelbunden utvärdering när du gör ändringar spårar förbättringar och säkerställer att kvaliteten inte går tillbaka. Upprätta utvärderingsmått tidigt i utvecklingen och kör sedan utvärderingar på nytt efter ändringar för att mäta påverkan objektivt.

Genom att kombinera manuell testning, automatiserade mått och omfattande utvärderingsflöden skapar du förtroende för att din modell fungerar bra, hanterar användarna på ett säkert sätt och uppfyller programmets kvalitetskrav.