หมายเหตุ

การเข้าถึงหน้านี้ต้องได้รับการอนุญาต คุณสามารถลอง ลงชื่อเข้าใช้หรือเปลี่ยนไดเรกทอรีได้

การเข้าถึงหน้านี้ต้องได้รับการอนุญาต คุณสามารถลองเปลี่ยนไดเรกทอรีได้

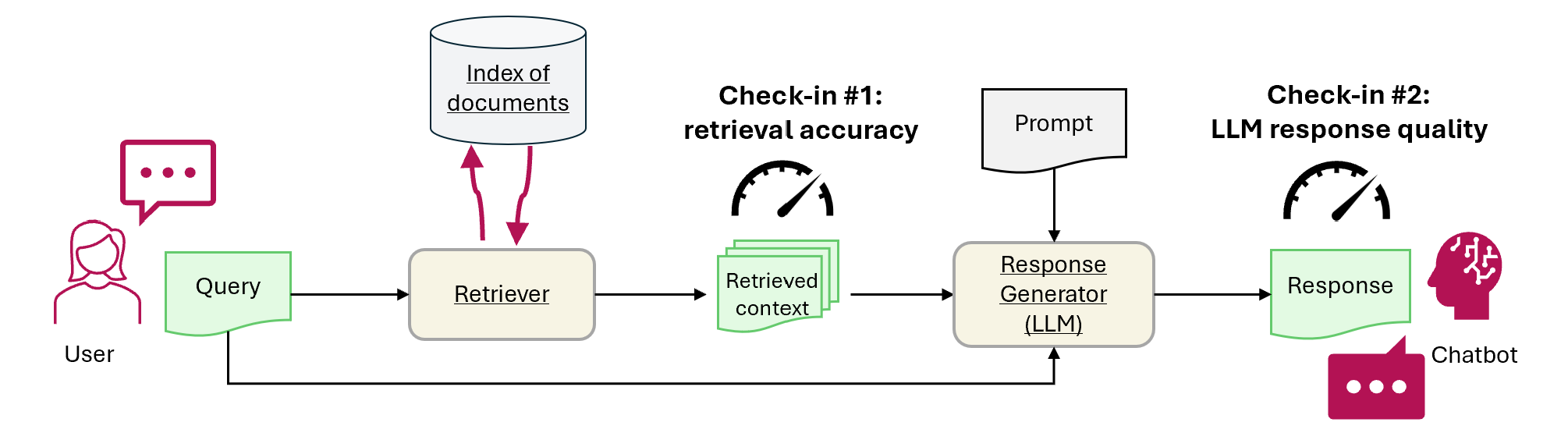

บทช่วยสอนนี้แสดงวิธีใช้ Fabric เพื่อประเมินประสิทธิภาพของแอปพลิเคชัน RAG การประเมินมุ่งเน้นไปที่องค์ประกอบ RAG หลักสององค์ประกอบ: ตัวดึงข้อมูล (Azure AI Search) และตัวสร้างการตอบกลับ (LLM ที่ใช้คิวรีของผู้ใช้ บริบทที่ดึงมา และพร้อมท์เพื่อสร้างการตอบกลับ) นี่คือขั้นตอนหลัก:

- ตั้งค่าบริการ Azure OpenAI และ Azure AI Search

- โหลดข้อมูลจากชุดข้อมูล QA ของ CMU ของบทความวิกิพีเดียเพื่อสร้างเกณฑ์มาตรฐาน

- เรียกใช้การทดสอบควันด้วยแบบสอบถามเดียวเพื่อยืนยันว่าระบบ RAG ทํางานแบบ end-to-end

- กําหนดตัวชี้วัดที่กําหนดและตัวชี้วัดที่ได้รับความช่วยเหลือจาก AI สําหรับการประเมิน

- การเช็คอิน 1: ประเมินประสิทธิภาพของรีทรีฟเวอร์โดยใช้ความแม่นยําสูงสุด N

- การเช็คอิน 2: ประเมินประสิทธิภาพของตัวสร้างการตอบกลับโดยใช้เมตริกความต่อเนื่อง ความเกี่ยวข้อง และความคล้ายคลึงกัน

- แสดงภาพและจัดเก็บผลการประเมินใน OneLake เพื่อใช้อ้างอิงในอนาคตและการประเมินอย่างต่อเนื่อง

ข้อกําหนดเบื้องต้น

ก่อนที่คุณจะเริ่มบทช่วยสอนนี้ ให้ทําตามคําแนะนําทีละขั้นตอนของ Building Retrieval Augmented Generation in Fabric

คุณต้องการบริการเหล่านี้เพื่อเรียกใช้สมุดบันทึก:

- ไมโครซอฟท์ แฟบริค

- เพิ่มเลคเฮาส์ ลงในสมุดบันทึกนี้ (มีข้อมูลที่คุณเพิ่มในบทช่วยสอนก่อนหน้านี้)

- Azure AI Studio สําหรับ OpenAI

- Azure AI Search (ประกอบด้วยข้อมูลที่คุณจัดทําดัชนีในบทช่วยสอนก่อนหน้านี้)

ในบทช่วยสอนก่อนหน้านี้คุณอัปโหลดข้อมูลไปยังเลคเฮาส์ของคุณและสร้างดัชนีเอกสารที่ใช้โดยระบบ RAG ใช้ดัชนีในแบบฝึกหัดนี้เพื่อเรียนรู้เทคนิคหลักในการประเมินประสิทธิภาพของ RAG และระบุปัญหาที่อาจเกิดขึ้น หากคุณไม่ได้สร้างดัชนีหรือนําออก ให้ทําตามคําแนะนํา เริ่มต้นใช้งานด่วน เพื่อดําเนินการตามข้อกําหนดเบื้องต้นให้เสร็จสมบูรณ์

ตั้งค่าการเข้าถึง Azure OpenAI และ Azure AI Search

กําหนดปลายทางและคีย์ที่จําเป็น นําเข้าไลบรารีและฟังก์ชันที่จําเป็น สร้างอินสแตนซ์ไคลเอ็นต์สําหรับ Azure OpenAI และ Azure AI Search กําหนดตัวห่อฟังก์ชันพร้อมพร้อมท์เพื่อสืบค้นระบบ RAG

# Enter your Azure OpenAI service values

aoai_endpoint = "https://<your-resource-name>.openai.azure.com" # TODO: Provide the Azure OpenAI resource endpoint (replace <your-resource-name>)

aoai_key = "" # TODO: Fill in your API key from Azure OpenAI

aoai_deployment_name_embeddings = "text-embedding-ada-002"

aoai_model_name_query = "gpt-4-32k"

aoai_model_name_metrics = "gpt-4-32k"

aoai_api_version = "2024-02-01"

# Setup key accesses to Azure AI Search

aisearch_index_name = "" # TODO: Create a new index name: must only contain lowercase, numbers, and dashes

aisearch_api_key = "" # TODO: Fill in your API key from Azure AI Search

aisearch_endpoint = "https://.search.windows.net" # TODO: Provide the url endpoint for your created Azure AI Search

import warnings

warnings.filterwarnings("ignore", category=DeprecationWarning)

import os, requests, json

from datetime import datetime, timedelta

from azure.core.credentials import AzureKeyCredential

from azure.search.documents import SearchClient

from pyspark.sql import functions as F

from pyspark.sql.functions import to_timestamp, current_timestamp, concat, col, split, explode, udf, monotonically_increasing_id, when, rand, coalesce, lit, input_file_name, regexp_extract, concat_ws, length, ceil

from pyspark.sql.types import StructType, StructField, StringType, IntegerType, TimestampType, ArrayType, FloatType

from pyspark.sql import Row

import pandas as pd

from azure.search.documents.indexes import SearchIndexClient

from azure.search.documents.models import (

VectorizedQuery,

)

from azure.search.documents.indexes.models import (

SearchIndex,

SearchField,

SearchFieldDataType,

SimpleField,

SearchableField,

SemanticConfiguration,

SemanticPrioritizedFields,

SemanticField,

SemanticSearch,

VectorSearch,

HnswAlgorithmConfiguration,

HnswParameters,

VectorSearchProfile,

VectorSearchAlgorithmKind,

VectorSearchAlgorithmMetric,

)

import openai

from openai import AzureOpenAI

import uuid

import matplotlib.pyplot as plt

from synapse.ml.featurize.text import PageSplitter

import ipywidgets as widgets

from IPython.display import display as w_display

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 6, Finished, Available, Finished)

# Configure access to OpenAI endpoint

openai.api_type = "azure"

openai.api_key = aoai_key

openai.api_base = aoai_endpoint

openai.api_version = aoai_api_version

# Create client for accessing embedding endpoint

embed_client = AzureOpenAI(

api_version=aoai_api_version,

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

)

# Create client for accessing chat endpoint

chat_client = AzureOpenAI(

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

api_version=aoai_api_version,

)

# Configure access to Azure AI Search

search_client = SearchClient(

aisearch_endpoint,

aisearch_index_name,

credential=AzureKeyCredential(aisearch_api_key)

)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 7, Finished, Available, Finished)

ฟังก์ชันต่อไปนี้ใช้ส่วนประกอบ RAG หลักสองส่วน - รีทรีฟเวอร์ (get_context_source) และตัวสร้างการตอบสนอง (get_answer) รหัสจะคล้ายกับบทช่วยสอนก่อนหน้านี้

topNพารามิเตอร์ช่วยให้คุณสามารถกําหนดจํานวนทรัพยากรที่เกี่ยวข้องที่จะดึงข้อมูล (บทช่วยสอนนี้ใช้ 3 แต่ค่าที่เหมาะสมที่สุดอาจแตกต่างกันไปตามชุดข้อมูล):

# Implement retriever

def get_context_source(question, topN=3):

"""

Retrieves contextual information and sources related to a given question using embeddings and a vector search.

Parameters:

question (str): The question for which the context and sources are to be retrieved.

topN (int, optional): The number of top results to retrieve. Default is 3.

Returns:

List: A list containing two elements:

1. A string with the concatenated retrieved context.

2. A list of retrieved source paths.

"""

embed_client = openai.AzureOpenAI(

api_version=aoai_api_version,

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

)

query_embedding = embed_client.embeddings.create(input=question, model=aoai_deployment_name_embeddings).data[0].embedding

vector_query = VectorizedQuery(vector=query_embedding, k_nearest_neighbors=topN, fields="Embedding")

results = search_client.search(

vector_queries=[vector_query],

top=topN,

)

retrieved_context = ""

retrieved_sources = []

for result in results:

retrieved_context += result['ExtractedPath'] + "\n" + result['Chunk'] + "\n\n"

retrieved_sources.append(result['ExtractedPath'])

return [retrieved_context, retrieved_sources]

# Implement response generator

def get_answer(question, context):

"""

Generates a response to a given question using provided context and an Azure OpenAI model.

Parameters:

question (str): The question that needs to be answered.

context (str): The contextual information related to the question that will help generate a relevant response.

Returns:

str: The response generated by the Azure OpenAI model based on the provided question and context.

"""

messages = [

{

"role": "system",

"content": "You are a chat assistant. Use provided text to ground your response. Give a one-word answer when possible ('yes'/'no' is OK where appropriate, no details). Unnecessary words incur a $500 penalty."

}

]

messages.append(

{

"role": "user",

"content": question + "\n" + context,

},

)

chat_client = openai.AzureOpenAI(

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

api_version=aoai_api_version,

)

chat_completion = chat_client.chat.completions.create(

model=aoai_model_name_query,

messages=messages,

)

return chat_completion.choices[0].message.content

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 8, Finished, Available, Finished)

ชุดข้อมูล

เวอร์ชัน 1.2 ของชุดข้อมูล Question-Answer ของมหาวิทยาลัยคาร์เนกีเมลลอนเป็นคลังข้อมูลของบทความวิกิพีเดียที่มีคําถามและคําตอบข้อเท็จจริงที่เขียนด้วยตนเอง โฮสต์ใน Azure Blob Storage ภายใต้ GFDL ชุดข้อมูลใช้ตารางเดียวกับเขตข้อมูลเหล่านี้:

-

ArticleTitle: ชื่อบทความวิกิพีเดียที่คําถามและคําตอบมาจาก -

Question: คําถามที่เขียนด้วยตนเองเกี่ยวกับบทความ -

Answer: คําตอบที่เขียนด้วยตนเองตามบทความ -

DifficultyFromQuestioner: ความยากลําบากในการให้คะแนนคําถามที่ผู้เขียนกําหนด -

DifficultyFromAnswerer: ความยากลําบากในการให้คะแนนผู้ประเมินมอบหมาย อาจแตกต่างจากDifficultyFromQuestioner -

ExtractedPath: เส้นทางไปยังบทความต้นฉบับ (บทความสามารถมีคู่คําถามและคําตอบได้หลายคู่) -

text: ทําความสะอาดข้อความบทความวิกิพีเดีย

ดาวน์โหลดไฟล์ LICENSE-S08 และ LICENSE-S09 จากตําแหน่งเดียวกันเพื่อดูรายละเอียดใบอนุญาต

ประวัติและการอ้างอิง

ใช้การอ้างอิงนี้สําหรับชุดข้อมูล:

CMU Question/Answer Dataset, Release 1.2

August 23, 2013

Noah A. Smith, Michael Heilman, and Rebecca Hwa

Question Generation as a Competitive Undergraduate Course Project

In Proceedings of the NSF Workshop on the Question Generation Shared Task and Evaluation Challenge, Arlington, VA, September 2008.

Available at http://www.cs.cmu.edu/~nasmith/papers/smith+heilman+hwa.nsf08.pdf.

Original dataset acknowledgments:

This research project was supported by NSF IIS-0713265 (to Smith), an NSF Graduate Research Fellowship (to Heilman), NSF IIS-0712810 and IIS-0745914 (to Hwa), and Institute of Education Sciences, U.S. Department of Education R305B040063 (to Carnegie Mellon).

cmu-qa-08-09 (modified version)

June 12, 2024

Amir Jafari, Alexandra Savelieva, Brice Chung, Hossein Khadivi Heris, Journey McDowell

This release uses the GNU Free Documentation License (GFDL) (http://www.gnu.org/licenses/fdl.html).

The GNU license applies to all copies of the dataset.

สร้างเกณฑ์มาตรฐาน

นําเข้าเกณฑ์มาตรฐาน สําหรับการสาธิตนี้ ให้ใช้ชุดย่อยของคําถามจาก และ S08/set1S08/set2 buckets หากต้องการเก็บหนึ่งคําถามต่อบทความ ให้ใช้df.dropDuplicates(["ExtractedPath"]) วางคําถามที่ซ้ํากัน กระบวนการดูแลจัดการเพิ่มป้ายกํากับความยาก ตัวอย่างนี้จํากัดไว้ที่medium

df = spark.sql("SELECT * FROM data_load_tests.cmu_qa")

# Filter the DataFrame to include the specified paths

df = df.filter((col("ExtractedPath").like("S08/data/set1/%")) | (col("ExtractedPath").like("S08/data/set2/%")))

# Keep only medium-difficulty questions.

df = df.filter(col("DifficultyFromQuestioner") == "medium")

# Drop duplicate questions and source paths.

df = df.dropDuplicates(["Question"])

df = df.dropDuplicates(["ExtractedPath"])

num_rows = df.count()

num_columns = len(df.columns)

print(f"Number of rows: {num_rows}, Number of columns: {num_columns}")

# Persist the DataFrame

df.persist()

display(df)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 9, Finished, Available, Finished)Number of rows: 20, Number of columns: 7SynapseWidget(Synapse.DataFrame, 47aff8cb-72f8-4a36-885c-f4f3bb830a91)

ผลลัพธ์ที่ได้คือ DataFrame ที่มี 20 แถว - เกณฑ์มาตรฐานการสาธิต ฟิลด์สําคัญคือ Question, Answer (คําตอบความจริงภาคพื้นดินที่มนุษย์ดูแล) และ ExtractedPath (เอกสารต้นฉบับ) ปรับตัวกรองเพื่อรวมคําถามอื่นๆ และเปลี่ยนความยากสําหรับตัวอย่างที่สมจริงยิ่งขึ้น ลองดูสิ

เรียกใช้การทดสอบแบบ end-to-end อย่างง่าย

เริ่มต้นด้วยการทดสอบควันแบบ end-to-end ของ Retrieval-Augmented Generation (RAG)

question = "How many suborders are turtles divided into?"

retrieved_context, retrieved_sources = get_context_source(question)

answer = get_answer(question, retrieved_context)

print(answer)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 10, Finished, Available, Finished)Three

การทดสอบควันนี้ช่วยให้คุณค้นหาปัญหาในการใช้งาน RAG เช่นข้อมูลประจําตัวที่ไม่ถูกต้องดัชนีเวกเตอร์ที่ขาดหายไปหรือว่างเปล่าหรืออินเทอร์เฟซฟังก์ชันที่เข้ากันไม่ได้ หากการทดสอบล้มเหลว ให้ตรวจสอบปัญหา ผลผลิตที่คาดหวัง: Three. หากการทดสอบควันผ่าน ให้ไปที่ส่วนถัดไปเพื่อประเมิน RAG เพิ่มเติม

สร้างเมตริก

กําหนดเมตริกที่กําหนดเพื่อประเมินรีทรีฟเวอร์ ได้รับแรงบันดาลใจจากเครื่องมือค้นหา ตรวจสอบว่ารายการแหล่งที่มาที่ดึงมามีแหล่งที่มาของความจริงพื้นฐานหรือไม่ เมตริกนี้เป็นคะแนนความแม่นยําสูงสุด N เนื่องจาก topN พารามิเตอร์กําหนดจํานวนแหล่งที่มาที่ดึงมา

def get_retrieval_score(target_source, retrieved_sources):

if target_source in retrieved_sources:

return 1

else:

return 0

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 11, Finished, Available, Finished)

ตามเกณฑ์มาตรฐานคําตอบมีอยู่ในแหล่งที่มาด้วย ID "S08/data/set1/a9". การทดสอบฟังก์ชันในตัวอย่างที่เราเรียกใช้ด้านบนจะ 1ส่งคืน ตามที่คาดไว้ เนื่องจากอยู่ในกลุ่มข้อความที่เกี่ยวข้องสามอันดับแรก

print("Retrieved sources:", retrieved_sources)

get_retrieval_score("S08/data/set1/a9", retrieved_sources)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 12, Finished, Available, Finished)Retrieved sources: ['S08/data/set1/a9', 'S08/data/set1/a9', 'S08/data/set1/a5']1

ส่วนนี้กําหนดเมตริกที่ได้รับความช่วยเหลือจาก AI เทมเพลตพร้อมท์ประกอบด้วยตัวอย่างอินพุต (CONTEXT และ ANSWER) และเอาต์พุตที่แนะนํา หรือที่เรียกว่าโมเดลไม่กี่ช็อต เป็นพร้อมท์เดียวกับที่ใช้ใน Azure AI Studio เรียนรู้เพิ่มเติมในเมตริกการประเมินในตัว การสาธิตนี้ใช้เมตริก groundedness และ relevance ซึ่งมักจะมีประโยชน์และน่าเชื่อถือที่สุดสําหรับการประเมินโมเดล GPT เมตริกอื่นๆ อาจมีประโยชน์ แต่ให้สัญชาตญาณน้อยกว่า ตัวอย่างเช่น คําตอบไม่จําเป็นต้องคล้ายกันจึงจะถูกต้อง ดังนั้น similarity คะแนนอาจทําให้เข้าใจผิดได้ มาตราส่วนสําหรับเมตริกทั้งหมดคือ 1 ถึง 5 ยิ่งสูงยิ่งดี ความมีพื้นฐานใช้อินพุตเพียงสองรายการ (บริบทและคําตอบที่สร้างขึ้น) ในขณะที่ตัวชี้วัดอีกสองตัวยังใช้ความจริงพื้นฐานในการประเมิน

def get_groundedness_metric(context, answer):

"""Get the groundedness score from the LLM using the context and answer."""

groundedness_prompt_template = """

You are presented with a CONTEXT and an ANSWER about that CONTEXT. Decide whether the ANSWER is entailed by the CONTEXT by choosing one of the following ratings:

1. 5: The ANSWER follows logically from the information contained in the CONTEXT.

2. 1: The ANSWER is logically false from the information contained in the CONTEXT.

3. an integer score between 1 and 5 and if such integer score does not exist, use 1: It is not possible to determine whether the ANSWER is true or false without further information. Read the passage of information thoroughly and select the correct answer from the three answer labels. Read the CONTEXT thoroughly to ensure you know what the CONTEXT entails. Note the ANSWER is generated by a computer system, it can contain certain symbols, which should not be a negative factor in the evaluation.

Independent Examples:

## Example Task #1 Input:

"CONTEXT": "Some are reported as not having been wanted at all.", "QUESTION": "", "ANSWER": "All are reported as being completely and fully wanted."

## Example Task #1 Output:

1

## Example Task #2 Input:

"CONTEXT": "Ten new television shows appeared during the month of September. Five of the shows were sitcoms, three were hourlong dramas, and two were news-magazine shows. By January, only seven of these new shows were still on the air. Five of the shows that remained were sitcoms.", "QUESTION": "", "ANSWER": "At least one of the shows that were cancelled was an hourlong drama."

## Example Task #2 Output:

5

## Example Task #3 Input:

"CONTEXT": "In Quebec, an allophone is a resident, usually an immigrant, whose mother tongue or home language is neither French nor English.", "QUESTION": "", "ANSWER": "In Quebec, an allophone is a resident, usually an immigrant, whose mother tongue or home language is not French."

5

## Example Task #4 Input:

"CONTEXT": "Some are reported as not having been wanted at all.", "QUESTION": "", "ANSWER": "All are reported as being completely and fully wanted."

## Example Task #4 Output:

1

## Actual Task Input:

"CONTEXT": {context}, "QUESTION": "", "ANSWER": {answer}

Reminder: The return values for each task should be correctly formatted as an integer between 1 and 5. Do not repeat the context and question. Don't explain the reasoning. The answer should include only a number: 1, 2, 3, 4, or 5.

Actual Task Output:

"""

metric_client = openai.AzureOpenAI(

api_version=aoai_api_version,

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

)

messages = [

{

"role": "system",

"content": "You are an AI assistant. You will be given the definition of an evaluation metric for assessing the quality of an answer in a question-answering task. Your job is to compute an accurate evaluation score using the provided evaluation metric."

},

{

"role": "user",

"content": groundedness_prompt_template.format(context=context, answer=answer)

}

]

metric_completion = metric_client.chat.completions.create(

model=aoai_model_name_metrics,

messages=messages,

temperature=0,

)

return metric_completion.choices[0].message.content

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 13, Finished, Available, Finished)

def get_relevance_metric(context, question, answer):

relevance_prompt_template = """

Relevance measures how well the answer addresses the main aspects of the question, based on the context. Consider whether all and only the important aspects are contained in the answer when evaluating relevance. Given the context and question, score the relevance of the answer between one to five stars using the following rating scale:

One star: the answer completely lacks relevance

Two stars: the answer mostly lacks relevance

Three stars: the answer is partially relevant

Four stars: the answer is mostly relevant

Five stars: the answer has perfect relevance

This rating value should always be an integer between 1 and 5. So the rating produced should be 1 or 2 or 3 or 4 or 5.

context: Marie Curie was a Polish-born physicist and chemist who pioneered research on radioactivity and was the first woman to win a Nobel Prize.

question: What field did Marie Curie excel in?

answer: Marie Curie was a renowned painter who focused mainly on impressionist styles and techniques.

stars: 1

context: The Beatles were an English rock band formed in Liverpool in 1960, and they are widely regarded as the most influential music band in history.

question: Where were The Beatles formed?

answer: The band The Beatles began their journey in London, England, and they changed the history of music.

stars: 2

context: The recent Mars rover, Perseverance, was launched in 2020 with the main goal of searching for signs of ancient life on Mars. The rover also carries an experiment called MOXIE, which aims to generate oxygen from the Martian atmosphere.

question: What are the main goals of Perseverance Mars rover mission?

answer: The Perseverance Mars rover mission focuses on searching for signs of ancient life on Mars.

stars: 3

context: The Mediterranean diet is a commonly recommended dietary plan that emphasizes fruits, vegetables, whole grains, legumes, lean proteins, and healthy fats. Studies have shown that it offers numerous health benefits, including a reduced risk of heart disease and improved cognitive health.

question: What are the main components of the Mediterranean diet?

answer: The Mediterranean diet primarily consists of fruits, vegetables, whole grains, and legumes.

stars: 4

context: The Queen's Royal Castle is a well-known tourist attraction in the United Kingdom. It spans over 500 acres and contains extensive gardens and parks. The castle was built in the 15th century and has been home to generations of royalty.

question: What are the main attractions of the Queen's Royal Castle?

answer: The main attractions of the Queen's Royal Castle are its expansive 500-acre grounds, extensive gardens, parks, and the historical castle itself, which dates back to the 15th century and has housed generations of royalty.

stars: 5

Don't explain the reasoning. The answer should include only a number: 1, 2, 3, 4, or 5.

context: {context}

question: {question}

answer: {answer}

stars:

"""

metric_client = openai.AzureOpenAI(

api_version=aoai_api_version,

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

)

messages = [

{

"role": "system",

"content": "You are an AI assistant. You are given the definition of an evaluation metric for assessing the quality of an answer in a question-answering task. Compute an accurate evaluation score using the provided evaluation metric."

},

{

"role": "user",

"content": relevance_prompt_template.format(context=context, question=question, answer=answer)

}

]

metric_completion = metric_client.chat.completions.create(

model=aoai_model_name_metrics,

messages=messages,

temperature=0,

)

return metric_completion.choices[0].message.content

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 14, Finished, Available, Finished)

def get_similarity_metric(question, ground_truth, answer):

similarity_prompt_template = """

Equivalence, as a metric, measures the similarity between the predicted answer and the correct answer. If the information and content in the predicted answer is similar or equivalent to the correct answer, then the value of the Equivalence metric should be high, else it should be low. Given the question, correct answer, and predicted answer, determine the value of Equivalence metric using the following rating scale:

One star: the predicted answer is not at all similar to the correct answer

Two stars: the predicted answer is mostly not similar to the correct answer

Three stars: the predicted answer is somewhat similar to the correct answer

Four stars: the predicted answer is mostly similar to the correct answer

Five stars: the predicted answer is completely similar to the correct answer

This rating value should always be an integer between 1 and 5. So the rating produced should be 1 or 2 or 3 or 4 or 5.

The examples below show the Equivalence score for a question, a correct answer, and a predicted answer.

question: What is the role of ribosomes?

correct answer: Ribosomes are cellular structures responsible for protein synthesis. They interpret the genetic information carried by messenger RNA (mRNA) and use it to assemble amino acids into proteins.

predicted answer: Ribosomes participate in carbohydrate breakdown by removing nutrients from complex sugar molecules.

stars: 1

question: Why did the Titanic sink?

correct answer: The Titanic sank after it struck an iceberg during its maiden voyage in 1912. The impact caused the ship's hull to breach, allowing water to flood into the vessel. The ship's design, lifeboat shortage, and lack of timely rescue efforts contributed to the tragic loss of life.

predicted answer: The sinking of the Titanic was a result of a large iceberg collision. This caused the ship to take on water and eventually sink, leading to the death of many passengers due to a shortage of lifeboats and insufficient rescue attempts.

stars: 2

question: What causes seasons on Earth?

correct answer: Seasons on Earth are caused by the tilt of the Earth's axis and its revolution around the Sun. As the Earth orbits the Sun, the tilt causes different parts of the planet to receive varying amounts of sunlight, resulting in changes in temperature and weather patterns.

predicted answer: Seasons occur because of the Earth's rotation and its elliptical orbit around the Sun. The tilt of the Earth's axis causes regions to be subjected to different sunlight intensities, which leads to temperature fluctuations and alternating weather conditions.

stars: 3

question: How does photosynthesis work?

correct answer: Photosynthesis is a process by which green plants and some other organisms convert light energy into chemical energy. This occurs as light is absorbed by chlorophyll molecules, and then carbon dioxide and water are converted into glucose and oxygen through a series of reactions.

predicted answer: In photosynthesis, sunlight is transformed into nutrients by plants and certain microorganisms. Light is captured by chlorophyll molecules, followed by the conversion of carbon dioxide and water into sugar and oxygen through multiple reactions.

stars: 4

question: What are the health benefits of regular exercise?

correct answer: Regular exercise can help maintain a healthy weight, increase muscle and bone strength, and reduce the risk of chronic diseases. It also promotes mental well-being by reducing stress and improving overall mood.

predicted answer: Routine physical activity can contribute to maintaining ideal body weight, enhancing muscle and bone strength, and preventing chronic illnesses. In addition, it supports mental health by alleviating stress and augmenting general mood.

stars: 5

Don't explain the reasoning. The answer should include only a number: 1, 2, 3, 4, or 5.

question: {question}

correct answer:{ground_truth}

predicted answer: {answer}

stars:

"""

metric_client = openai.AzureOpenAI(

api_version=aoai_api_version,

azure_endpoint=aoai_endpoint,

api_key=aoai_key,

)

messages = [

{

"role": "system",

"content": "You are an AI assistant. You will be given the definition of an evaluation metric for assessing the quality of an answer in a question-answering task. Your job is to compute an accurate evaluation score using the provided evaluation metric."

},

{

"role": "user",

"content": similarity_prompt_template.format(question=question, ground_truth=ground_truth, answer=answer)

}

]

metric_completion = metric_client.chat.completions.create(

model=aoai_model_name_metrics,

messages=messages,

temperature=0,

)

return metric_completion.choices[0].message.content

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 15, Finished, Available, Finished)

ทดสอบเมตริกความเกี่ยวข้อง:

get_relevance_metric(retrieved_context, question, answer)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 16, Finished, Available, Finished)'2'

คะแนน 5 หมายความว่าคําตอบมีความเกี่ยวข้อง โค้ดต่อไปนี้ได้รับเมตริกความคล้ายคลึงกัน:

get_similarity_metric(question, 'three', answer)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 17, Finished, Available, Finished)'5'

คะแนน 5 หมายความว่าคําตอบตรงกับคําตอบความจริงพื้นฐานที่ดูแลโดยผู้เชี่ยวชาญที่เป็นมนุษย์ คะแนนเมตริกที่ได้รับความช่วยเหลือจาก AI อาจผันผวนด้วยอินพุตเดียวกัน พวกเขาเร็วกว่าการใช้ผู้ตัดสินที่เป็นมนุษย์

ประเมินประสิทธิภาพของ RAG ในการเปรียบเทียบ Q&A

สร้าง wrapper ฟังก์ชันเพื่อเรียกใช้ตามขนาด ตัดแต่ละฟังก์ชันที่ลงท้ายด้วย _udf (ย่อมาจาก user-defined function) เพื่อให้สอดคล้องกับข้อกําหนดของ Spark (@udf(returnType=StructType([ ... ]))) และเรียกใช้การคํานวณบนข้อมูลขนาดใหญ่ได้เร็วขึ้นทั่วทั้งคลัสเตอร์

# UDF wrappers for RAG components

@udf(returnType=StructType([

StructField("retrieved_context", StringType(), True),

StructField("retrieved_sources", ArrayType(StringType()), True)

]))

def get_context_source_udf(question, topN=3):

return get_context_source(question, topN)

@udf(returnType=StringType())

def get_answer_udf(question, context):

return get_answer(question, context)

# UDF wrapper for retrieval score

@udf(returnType=StringType())

def get_retrieval_score_udf(target_source, retrieved_sources):

return get_retrieval_score(target_source, retrieved_sources)

# UDF wrappers for AI-assisted metrics

@udf(returnType=StringType())

def get_groundedness_metric_udf(context, answer):

return get_groundedness_metric(context, answer)

@udf(returnType=StringType())

def get_relevance_metric_udf(context, question, answer):

return get_relevance_metric(context, question, answer)

@udf(returnType=StringType())

def get_similarity_metric_udf(question, ground_truth, answer):

return get_similarity_metric(question, ground_truth, answer)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 18, Finished, Available, Finished)

การเช็คอิน #1: ประสิทธิภาพของรีทรีฟเวอร์

รหัสต่อไปนี้สร้าง result คอลัมน์ และ retrieval_score ในเกณฑ์มาตรฐาน DataFrame คอลัมน์เหล่านี้ประกอบด้วยคําตอบที่สร้างโดย RAG และตัวบ่งชี้ว่าบริบทที่ให้ไว้กับ LLM มีบทความที่คําถามยึดตามหรือไม่

df = df.withColumn("result", get_context_source_udf(df.Question)).select(df.columns+["result.*"])

df = df.withColumn('retrieval_score', get_retrieval_score_udf(df.ExtractedPath, df.retrieved_sources))

print("Aggregate Retrieval score: {:.2f}%".format((df.where(df["retrieval_score"] == 1).count() / df.count()) * 100))

display(df.select(["question", "retrieval_score", "ExtractedPath", "retrieved_sources"]))

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 19, Finished, Available, Finished)Aggregate Retrieval score: 100.00%SynapseWidget(Synapse.DataFrame, 14efe386-836a-4765-bd88-b121f32c7cfc)

สําหรับคําถามทั้งหมด รีทรีฟเวอร์จะดึงบริบทที่ถูกต้อง และในกรณีส่วนใหญ่จะเป็นรายการแรก Azure AI Search ทํางานได้ดี คุณอาจสงสัยว่าเหตุใดในบางกรณีบริบทจึงมีค่าที่เหมือนกันสองหรือสามค่า นั่นไม่ใช่ข้อผิดพลาด - หมายความว่ารีทรีฟเวอร์ดึงชิ้นส่วนของบทความเดียวกันที่ไม่พอดีกับส่วนเดียวในระหว่างการแยก

การเช็คอิน #2: ประสิทธิภาพของตัวสร้างการตอบสนอง

ส่งคําถามและบริบทไปยัง LLM เพื่อสร้างคําตอบ จัดเก็บไว้ใน generated_answer คอลัมน์ใน DataFrame:

df = df.withColumn('generated_answer', get_answer_udf(df.Question, df.retrieved_context))

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 20, Finished, Available, Finished)

ใช้คําตอบที่สร้างขึ้น คําตอบที่เป็นความจริง คําถาม และบริบทเพื่อคํานวณเมตริก แสดงผลการประเมินสําหรับคําถาม-คําตอบแต่ละคู่:

df = df.withColumn('gpt_groundedness', get_groundedness_metric_udf(df.retrieved_context, df.generated_answer))

df = df.withColumn('gpt_relevance', get_relevance_metric_udf(df.retrieved_context, df.Question, df.generated_answer))

df = df.withColumn('gpt_similarity', get_similarity_metric_udf(df.Question, df.Answer, df.generated_answer))

display(df.select(["question", "answer", "generated_answer", "retrieval_score", "gpt_groundedness","gpt_relevance", "gpt_similarity"]))

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 21, Finished, Available, Finished)SynapseWidget(Synapse.DataFrame, 22b97d27-91e1-40f3-b888-3a3399de9d6b)

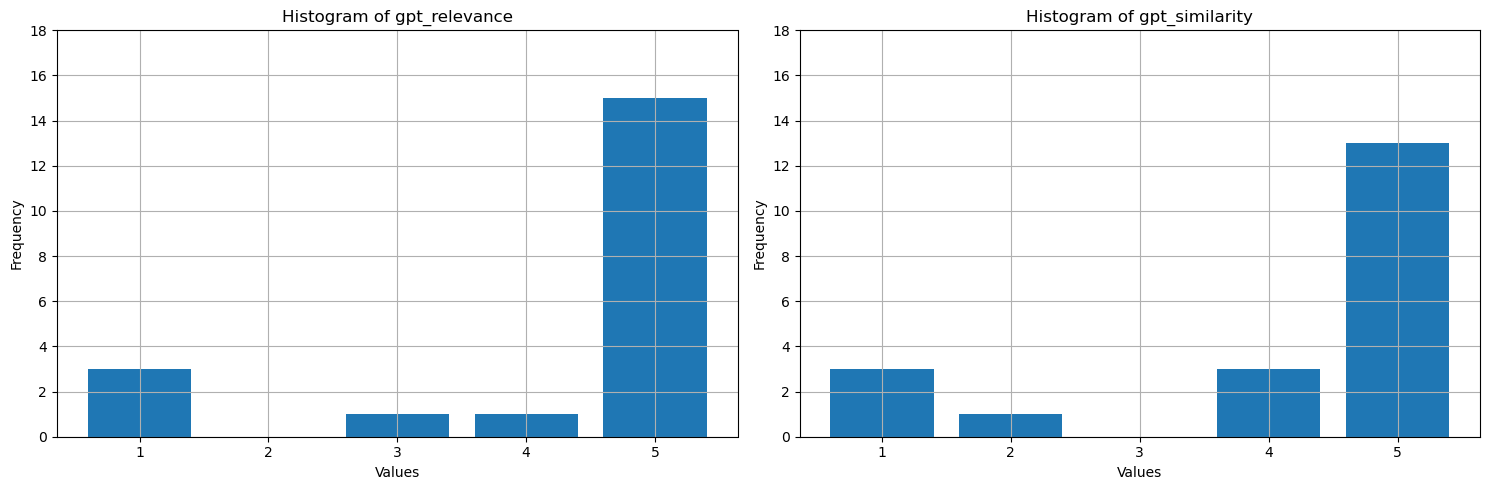

ค่านิยมเหล่านี้แสดงให้เห็นอะไร? เพื่อให้ตีความได้ง่ายขึ้น ให้พล็อตฮิสโตแกรมของความมีเหตุผล ความเกี่ยวข้อง และความคล้ายคลึงกัน LLM มีรายละเอียดมากกว่าคําตอบตามความจริงของมนุษย์ ซึ่งลดเมตริกความคล้ายคลึงกัน - ประมาณครึ่งหนึ่งของคําตอบถูกต้องตามความหมาย แต่ได้รับสี่ดาวเนื่องจากส่วนใหญ่คล้ายกัน ค่าส่วนใหญ่สําหรับเมตริกทั้งสามคือ 4 หรือ 5 ซึ่งบ่งชี้ว่าประสิทธิภาพของ RAG นั้นดี มีค่าผิดปกติเล็กน้อย - ตัวอย่างเช่น สําหรับคําถาม How many species of otter are there?แบบจําลองที่สร้างขึ้น There are 13 species of otterซึ่งถูกต้องด้วยความเกี่ยวข้องและความคล้ายคลึงกันสูง (5) ด้วยเหตุผลบางประการ GPT ถือว่ามีพื้นฐานไม่ดีในบริบทที่ให้ไว้และให้หนึ่งดาว ในอีกสามกรณีที่มีเมตริกที่ช่วยโดย AI อย่างน้อยหนึ่งดวงของดาวหนึ่งดวงคะแนนต่ําชี้ให้เห็นถึงคําตอบที่ไม่ดี LLM ทําคะแนนผิดพลาดเป็นครั้งคราว แต่มักจะให้คะแนนได้แม่นยํา

# Convert Spark DataFrame to Pandas DataFrame

pandas_df = df.toPandas()

selected_columns = ['gpt_groundedness', 'gpt_relevance', 'gpt_similarity']

trimmed_df = pandas_df[selected_columns].astype(int)

# Define a function to plot histograms for the specified columns

def plot_histograms(dataframe, columns):

# Set up the figure size and subplots

plt.figure(figsize=(15, 5))

for i, column in enumerate(columns, 1):

plt.subplot(1, len(columns), i)

# Filter the dataframe to only include rows with values 1, 2, 3, 4, 5

filtered_df = dataframe[dataframe[column].isin([1, 2, 3, 4, 5])]

filtered_df[column].hist(bins=range(1, 7), align='left', rwidth=0.8)

plt.title(f'Histogram of {column}')

plt.xlabel('Values')

plt.ylabel('Frequency')

plt.xticks(range(1, 6))

plt.yticks(range(0, 20, 2))

# Call the function to plot histograms for the specified columns

plot_histograms(trimmed_df, selected_columns)

# Show the plots

plt.tight_layout()

plt.show()

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 24, Finished, Available, Finished)

ในขั้นตอนสุดท้าย ให้บันทึกผลลัพธ์เกณฑ์มาตรฐานลงในตารางในเลคเฮาส์ของคุณ ขั้นตอนนี้เป็นทางเลือก แต่ขอแนะนําเป็นอย่างยิ่ง ซึ่งจะทําให้สิ่งที่คุณค้นพบมีประโยชน์มากขึ้น เมื่อคุณเปลี่ยนแปลงบางสิ่งใน RAG (เช่น แก้ไขพรอมต์ อัปเดตดัชนี หรือใช้โมเดล GPT อื่นในตัวสร้างการตอบสนอง) ให้วัดผลกระทบ หาปริมาณการปรับปรุง และตรวจจับการถดถอย

# create name of experiment that is easy to refer to

friendly_name_of_experiment = "rag_tutorial_experiment_1"

# Note the current date and time

time_of_experiment = current_timestamp()

# Generate a unique GUID for all rows

experiment_id = str(uuid.uuid4())

# Add two new columns to the Spark DataFrame

updated_df = df.withColumn("execution_time", time_of_experiment) \

.withColumn("experiment_id", lit(experiment_id)) \

.withColumn("experiment_friendly_name", lit(friendly_name_of_experiment))

# Store the updated DataFrame in the default lakehouse as a table named 'rag_experiment_runs'

table_name = "rag_experiment_run_demo1"

updated_df.write.format("parquet").mode("append").saveAsTable(table_name)

เอาต์พุตเซลล์:StatementMeta(, 21cb8cd3-7742-4c1f-8339-265e2846df1d, 28, Finished, Available, Finished)

กลับไปที่ผลการทดสอบได้ทุกเมื่อเพื่อตรวจสอบ เปรียบเทียบกับการทดสอบใหม่ และเลือกการกําหนดค่าที่เหมาะกับการใช้งานจริงมากที่สุด

Summary

ใช้ตัววัดที่ได้รับความช่วยเหลือจาก AI และอัตราการเรียกดูสูงสุด N เพื่อสร้างโซลูชันการสร้างที่เสริมการเรียกดู (RAG) ของคุณ