หมายเหตุ

การเข้าถึงหน้านี้ต้องได้รับการอนุญาต คุณสามารถลอง ลงชื่อเข้าใช้หรือเปลี่ยนไดเรกทอรีได้

การเข้าถึงหน้านี้ต้องได้รับการอนุญาต คุณสามารถลองเปลี่ยนไดเรกทอรีได้

Retrieval Augmented Generation (RAG) ใน Microsoft Copilot Studio รวมความสามารถในการให้เหตุผลของโมเดลภาษาเข้ากับความรู้เฉพาะองค์กรที่เชื่อถือได้ ช่วยให้ตัวแทนสามารถสร้างการตอบสนองที่ถูกต้อง ตามบริบท และมีพื้นฐานตามเนื้อหาขององค์กร แทนที่จะพึ่งพาหน่วยความจําแบบจําลองเพียงอย่างเดียว

ในบทความนี้ คุณจะได้เรียนรู้วิธีการ:

- ทําความเข้าใจว่า RAG ช่วยเพิ่มความน่าเชื่อถือและความมั่นคงของ AI ได้อย่างไร

- อธิบายวิธีที่ Copilot Studio ดึงและสังเคราะห์ความรู้

- ระบุแหล่งความรู้ที่รองรับและข้อจํากัด

- ตระหนักถึงข้อควรพิจารณาด้านการกํากับดูแล การปฏิบัติตามข้อกําหนด และความปลอดภัยของ AI

- ใช้แนวคิด RAG เมื่อออกแบบนักบินร่วมในสภาพแวดล้อมขององค์กร

ข้อมูลเบื้องต้นเกี่ยวกับ RAG

RAG เป็นรูปแบบการออกแบบที่ปรับปรุงความแม่นยําของ AI โดยการรวมความสามารถสองอย่างเข้าด้วยกัน:

- การดึงข้อมูล: การค้นหาแหล่งข้อมูลขององค์กร

- การสร้างข้อความ: การสังเคราะห์ข้อมูลที่ดึงมาโดยใช้โมเดลภาษา

วิธีการนี้ช่วยลดข้อมูลที่ไม่ถูกต้องเพิ่มความไว้วางใจและสร้างการตอบสนองที่มีรากฐานมาจากเนื้อหาขององค์กรจริง

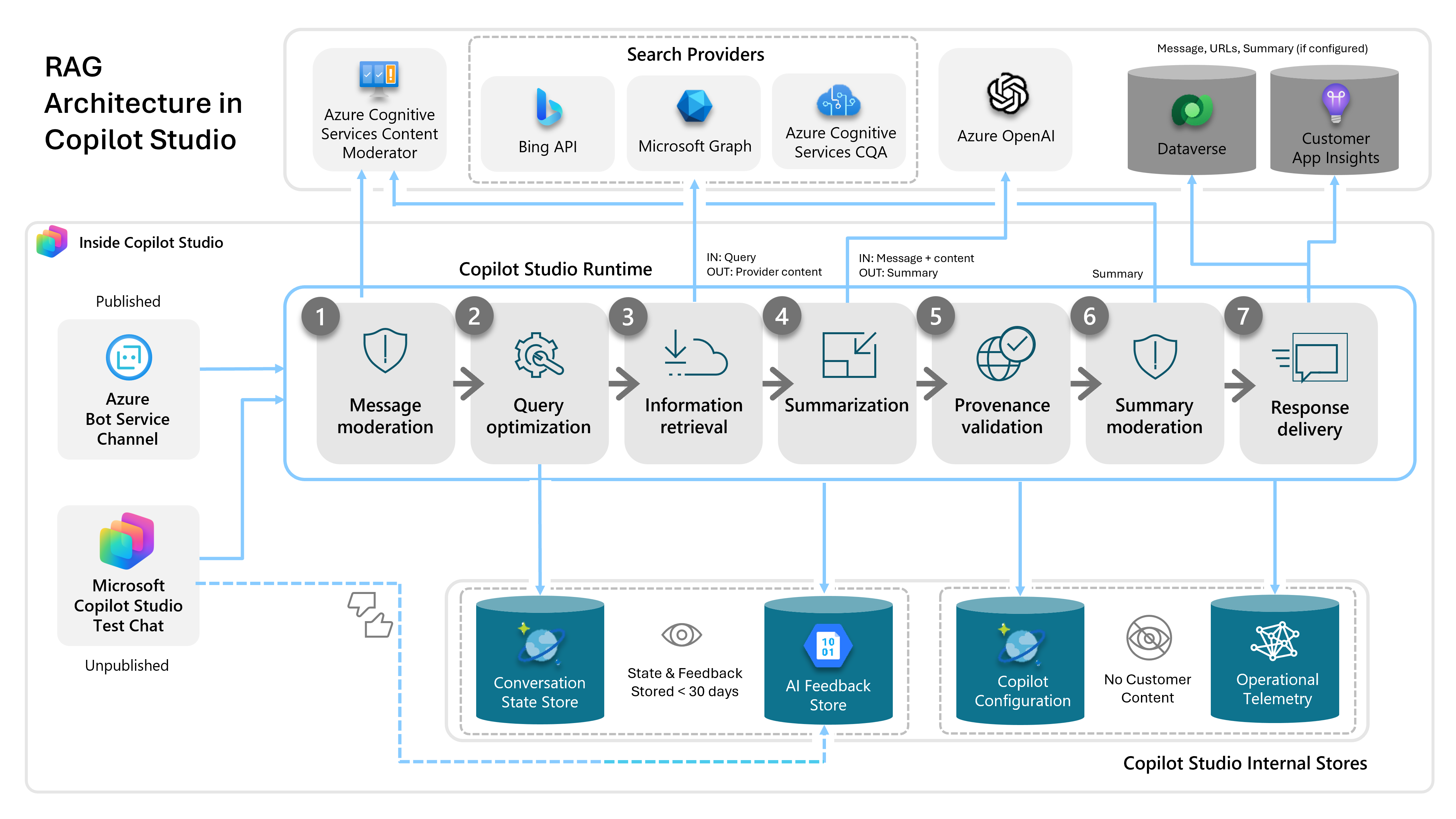

สถาปัตยกรรม RAG ใน Copilot Studio

ไปป์ไลน์ RAG ของ Copilot Studio สร้างขึ้นบนบริการ Azure AI และผสานรวมกับขอบเขตความน่าเชื่อถือ การปฏิบัติตามข้อกําหนด และความปลอดภัยของ Microsoft อย่างแน่นหนา

ส่วนประกอบหลัก:

- รันไทม์ Copilot Studio: จัดการไปป์ไลน์การสนทนา

- กลไกการเพิ่มประสิทธิภาพการสืบค้น: เขียนใหม่และตีความการสืบค้น

- ผู้ให้บริการค้นหา: Bing, SharePoint, Graph, Dataverse, Azure AI Search

- กลไกการสรุป: สร้างคําตอบที่มีเหตุผลและอ้างถึง

- เลเยอร์การกลั่นกรอง: ตรวจสอบความถูกต้องของข้อความและบทสรุป

- ที่เก็บสถานะ: หน่วยความจําระยะสั้น (น้อยกว่า 30 วัน ไม่ใช้สําหรับการฝึกอบรม)

- การจัดเก็บข้อมูลทางไกลและคําติชม: ให้ข้อมูลเชิงลึกและการกํากับดูแล

วิธีการทํางานของ RAG ใน Copilot Studio

RAG ใน Copilot Studio ทําตามกระบวนการสี่ขั้นตอน:

- การเขียนคิวรีใหม่

- การดึงข้อมูลเนื้อหา

- การสรุปและการสร้างการตอบสนอง

- การตรวจสอบความปลอดภัยและการกํากับดูแล

1. การเขียนแบบสอบถามใหม่

Copilot Studio ปรับคําถามของผู้ใช้ให้เหมาะสมก่อนค้นหา:

- ชี้แจงความหมาย

- เพิ่มสัญญาณตามบริบท (10 เทิร์นสุดท้าย)

- ปรับปรุงการจับคู่คีย์เวิร์ด

- สร้างคําค้นหาที่ง่ายดาย

กระบวนการนี้ช่วยเพิ่มคุณภาพการดึงข้อมูลและลดผลลัพธ์ที่ไม่เกี่ยวข้อง

2. การดึงเนื้อหา

หลังจากเขียนคิวรีใหม่ ระบบจะเรียกใช้กับแหล่งข้อมูลองค์ความรู้ทั้งหมดที่คุณตั้งค่าไว้ Copilot Studio ได้รับผลลัพธ์สามอันดับแรกจากแต่ละแหล่ง โดยสร้างสมดุลระหว่างความเกี่ยวข้องกับประสิทธิภาพ พฤติกรรมของแหล่งข้อมูลความรู้แต่ละแหล่งจะแตกต่างกันไปขึ้นอยู่กับปัจจัยต่างๆ เช่น การรับรองความถูกต้อง การจัดทําดัชนี รูปแบบไฟล์ และข้อจํากัดของที่เก็บข้อมูล

ตารางต่อไปนี้สรุปแหล่งข้อมูลความรู้ที่ได้รับการสนับสนุนทั้งหมด รวมถึงความสามารถ ข้อจํากัด และข้อกําหนดการรับรองความถูกต้อง:

| แหล่งความรู้ | คำอธิบาย | การรับรองความถูกต้อง | ความสามารถ ข้อจํากัด และข้อจํากัดที่สําคัญ |

|---|---|---|---|

| ข้อมูลสาธารณะ (เว็บไซต์) | เว็บไซต์ที่จัดทําดัชนีโดย Bing | ไม่มีใคร |

|

| SharePoint / OneDrive | เนื้อหาภายในองค์กร (ภายในเท่านั้น) | การรับรองความถูกต้องที่ได้รับมอบหมายจาก Microsoft Entra ID |

|

| ไฟล์ที่อัปโหลด | ไฟล์ที่อัปโหลดไปยังที่เก็บข้อมูล Dataverse | ไม่มีใคร |

|

| ตาราง Dataverse | เรกคอร์ดทางธุรกิจที่มีโครงสร้าง (ภายในเท่านั้น) | การรับรองความถูกต้องที่ได้รับมอบหมายจาก Microsoft Entra ID |

|

| ตัวเชื่อมต่อกราฟ | แอประดับองค์กรที่จัดทําดัชนีลงใน Microsoft Graph (ภายในเท่านั้น) | การรับรองความถูกต้องที่ได้รับมอบหมายจาก Microsoft Entra ID |

|

| ตัวเชื่อมต่อแบบเรียลไทม์ | ข้อมูลสดจากระบบต่างๆ เช่น Salesforce, Zendesk, SQL (ภายในเท่านั้น) | ผู้ใช้ต้องเข้าสู่ระบบ |

|

| การค้นหา AI ของ Azure | การค้นหาความหมายตามเวกเตอร์ | ปลายทางที่กําหนดค่าไว้ |

|

| ข้อมูลที่กําหนดเอง | ข้อมูลที่จัดหาผ่าน API, โฟลว์ หรือตรรกะแบบกําหนดเอง | ไม่มีใคร |

|

3. การสรุปและการสร้างการตอบสนอง

- AI สังเคราะห์เนื้อหาที่ดึงมา

- ใช้คําแนะนําแบบกําหนดเองสําหรับโทนเสียง การจัดรูปแบบ ความปลอดภัย หรือความกระชับ

- สร้างการอ้างอิงข้อมูลพื้นฐาน

- ปรับแต่งการตอบกลับโดยใช้บริบทของผู้ใช้ (เช่น ภาษา แผนก หรือภูมิภาค)

4. การตรวจสอบความปลอดภัยและการกํากับดูแล

การตอบกลับแต่ละครั้งจะผ่านเลเยอร์การตรวจสอบความถูกต้องอัตโนมัติ:

- การกลั่นกรองคําตอบที่เป็นอันตราย เป็นอันตราย ไม่เป็นไปตามข้อกําหนด หรือมีลิขสิทธิ์

- การตรวจสอบการต่อสายดินและการลบข้อมูลที่ไม่ถูกต้อง

ไม่มีข้อมูลลูกค้าฝึกโมเดลภาษา

ข้อควรพิจารณาที่สําคัญเมื่อใช้ RAG

RAG ทํางานได้ดีที่สุดสําหรับคําถามและคําตอบที่เป็นข้อเท็จจริง ไม่ใช่การวิเคราะห์เอกสารเชิงลึก

RAG เหมาะสําหรับ:

- การตอบคําถามจากฐานความรู้

- สรุปนโยบาย คําถามที่พบบ่อย และเนื้อหาขั้นตอน

- การดึงข้อมูลข้อเท็จจริงเฉพาะจากไฟล์หรือระบบภายใน

RAG ไม่ได้มีไว้สําหรับ:

- การเปรียบเทียบเอกสารฉบับเต็ม

- การประเมินการปฏิบัติตามนโยบาย

- การให้เหตุผลที่ซับซ้อนเกี่ยวกับเอกสารที่ไม่มีโครงสร้างที่ยาวเหยียด

ข้อควรพิจารณาด้านความปลอดภัยและการปฏิบัติตามข้อกําหนดของ Generative AI

ฟีเจอร์ Generative AI ใน Microsoft Copilot Studio ได้รับการออกแบบมาเพื่อมอบความสามารถในการสนทนาและการให้เหตุผลที่มีประสิทธิภาพในขณะที่ยังคงรักษาการควบคุมความปลอดภัย ความเป็นส่วนตัว และการปฏิบัติตามข้อบังคับที่แข็งแกร่ง

โมเดลพื้นฐานและโฮสติ้ง

- Copilot Studio อาศัยโมเดลพื้นฐานที่ OpenAI ฝึกฝน

- Copilot Studio ใช้หนึ่งในโมเดล OpenAI ล่าสุดสําหรับคําตอบเชิงกําเนิด

- โมเดลทํางานทั้งหมดบนบริการ Azure AI Foundry ภายใน ซึ่งสอดคล้องกับขอบเขตความน่าเชื่อถือของบริการของ Microsoft

- การใช้งานโมเดลทั้งหมดเป็นไปตามหลักการและนโยบาย AI ที่มีความรับผิดชอบของ Microsoft

คําแนะนําแบบกําหนดเอง

ผู้สร้างสามารถให้ คําแนะนําแบบกําหนดเอง เพื่อกําหนดลักษณะการทํางานของโมเดล โน้มน้าว หรือเพิ่มกฎการจัดรูปแบบ คําแนะนําเหล่านี้ช่วยปรับแต่งการตอบสนองเชิงสร้างสรรค์ให้เข้ากับความต้องการขององค์กรในขณะที่ยังคงเคารพตัวกรองความปลอดภัยและการควบคุมการปฏิบัติตามข้อกําหนด

การจัดเก็บและการประมวลผลข้อมูล

- การจัดเก็บและการประมวลผลข้อมูล ใน Copilot Studio อาจย้ายข้อมูลข้ามขอบเขตภูมิภาคเมื่อไม่มีการโฮสต์โมเดลในเครื่อง

- เมื่อไม่อนุญาตให้มีการเคลื่อนย้ายข้อมูลนี้ ผู้ดูแลระบบสามารถใช้การตั้งค่าสภาพแวดล้อมเพื่อปิดใช้งานคุณลักษณะเฉพาะ เช่น แบบจําลองภาษา Azure หรือ Bing Search

- Copilot Studio ไม่รวบรวมหรือใช้ข้อมูลลูกค้าใดๆ สําหรับการฝึกอบรมโมเดลภาษา

การจัดการข้อมูลการดําเนินงาน

- ในระหว่างการดําเนินการ ระบบจะจัดเก็บการสนทนาชั่วคราวในร้านค้าที่ปลอดภัยและดําเนินการโดย Microsoft

- การเข้าถึงบุคลากรที่ได้รับอนุญาตของ Microsoft ถูกจํากัดผ่าน Secure Access Workstations (SAWs) ที่มีตัวควบคุม Just-In-Time (JIT)

- องค์กรสามารถควบคุมการเข้าถึงเพิ่มเติมผ่าน Customer Lockbox โดยต้องได้รับการอนุมัติอย่างชัดเจนก่อนที่วิศวกรฝ่ายสนับสนุนของ Microsoft จะสามารถดูข้อมูลได้

การแก้ไขปัญหาการวัดและส่งข้อมูลทางไกล

- คุณลักษณะ Generative AI สร้างข้อมูลการแก้ไขปัญหาเพิ่มเติม แต่สําหรับการดําเนินการที่เริ่มต้นโดยผู้สร้างในบานหน้าต่าง ทดสอบ โดยเฉพาะเมื่อผู้สร้างยกนิ้วโป้งขึ้นหรือยกนิ้วโป้งลงเพื่อตอบกลับ

- ไม่มีการบันทึกข้อมูลลูกค้าเพิ่มเติมนอกลูปคําติชมที่ชัดเจนนี้

การตรวจสอบและความปลอดภัยในการละเมิด

เนื่องจากเลเยอร์ความปลอดภัยหลายชั้นปกป้องคุณลักษณะ Generative AI อยู่แล้ว Generative AI ของ Copilot Studio จึงปิดใช้งาน การตรวจสอบการละเมิด Azure AI เพื่อหลีกเลี่ยงการบันทึกข้อมูลลูกค้าเพิ่มเติม