การวิเคราะห์ข้อความทางสถิติ

หมายเหตุ

ดูแท็บ ข้อความและรูปภาพ สําหรับรายละเอียดเพิ่มเติม!

เมื่อแบ่งคลังข้อมูลข้อความออกเป็นโทเค็นที่เป็นส่วนประกอบและเตรียมไว้สําหรับการวิเคราะห์ มีเทคนิคการวิเคราะห์ทางสถิติทั่วไปบางอย่างที่คุณสามารถใช้เพื่ออนุมานความหมายจากข้อความ

การวิเคราะห์ความถี่

บางทีวิธีที่ชัดเจนที่สุดในการตรวจสอบหัวข้อที่กล่าวถึงในเอกสารคือการนับจํานวนครั้งที่โทเค็นมาตรฐานแต่ละรายการปรากฏขึ้น สมมติฐานคือคําศัพท์ที่ใช้บ่อยขึ้นในเอกสารสามารถช่วยระบุหัวข้อหรือหัวข้อที่กล่าวถึงได้ พูดง่ายๆ ก็คือ หากคุณสามารถกําหนดคําที่ใช้บ่อยที่สุดในเอกสารที่กําหนด คุณมักจะได้รับความคิดที่ดีว่าเอกสารนั้นเกี่ยวกับอะไร

ตัวอย่างเช่น พิจารณาข้อความต่อไปนี้:

AI in modern business delivers transformative benefits by enhancing efficiency, decision-making, and customer experiences. Businesses can leverage AI to automate repetitive tasks, freeing employees to focus on strategic work, while predictive analytics and machine learning models enable data-driven decisions that improve accuracy and speed. AI-powered tools like Copilot streamline workflows across marketing, finance, and operations, reducing costs and boosting productivity. Additionally, intelligent applications personalize customer interactions, driving engagement and loyalty. By embedding AI into core processes, businesses benefit from the ability to innovate faster, adapt to market changes, and maintain a competitive edge in an increasingly digital economy.

หลังจากทําโทเค็น ทําให้เป็นมาตรฐาน และใช้คําศัพท์กับข้อความแล้ว ความถี่ของแต่ละคําจะสามารถนับและจัดตารางได้ ให้ผลลัพธ์บางส่วนดังต่อไปนี้:

| เงื่อนไข | ความถี่ |

|---|---|

ai |

4 |

business |

3 |

benefit |

2 |

customer |

2 |

decision |

2 |

market |

2 |

ability |

1 |

accuracy |

1 |

| ... | ... |

คําศัพท์ที่เกิดขึ้นบ่อยที่สุดบ่งชี้ว่าข้อความกล่าวถึง AI และประโยชน์ทางธุรกิจ

ความถี่ของเทอม - ความถี่เอกสารผกผัน (TF-IDF)

การวิเคราะห์ความถี่อย่างง่ายที่คุณนับจํานวนครั้งที่เกิดขึ้นของแต่ละโทเค็นอาจเป็นวิธีที่มีประสิทธิภาพในการวิเคราะห์เอกสารเดียว แต่เมื่อคุณต้องการแยกความแตกต่างระหว่างเอกสารหลายฉบับภายในคลังข้อมูลเดียวกัน

ตัวอย่างเช่น พิจารณาตัวอย่างข้อความสองตัวอย่างต่อไปนี้:

ตัวอย่าง A:

Microsoft Copilot Studio enables declarative AI agent creation using natural language, prompts, and templates. With this declarative approach, an AI agent is configured rather than programmed: makers define intents, actions, and data connections, then publish the agent to channels. Microsoft Copilot Studio simplifies agent orchestration, governance, and lifecycles so an AI agent can be iterated quickly. Using Microsoft Copilot Studio helps modern businesses deploy Microsoft AI agent solutions fast.

ตัวอย่าง B:

Microsoft Foundry enables code‑based AI agent development with SDKs and APIs. Developers write code to implement agent conversations, tool calling, state management, and custom pipelines. In Microsoft Foundry, engineers can use Python or Microsoft C#, integrate Microsoft AI services, and manage CI/CD to deploy the AI agent. This code-first development model supports extensibility and performance while building Microsoft Foundry AI agent applications.

คําศัพท์ที่พบบ่อยที่สุดสามอันดับแรกในตัวอย่างเหล่านี้แสดงในตารางต่อไปนี้:

ตัวอย่าง A:

| เงื่อนไข | ความถี่ |

|---|---|

agent |

6 |

ai |

4 |

microsoft |

4 |

ตัวอย่าง B:

| เงื่อนไข | ความถี่ |

|---|---|

microsoft |

5 |

agent |

4 |

ai |

4 |

ดังที่คุณเห็นจากผลลัพธ์คําที่พบบ่อยที่สุดในทั้งสองตัวอย่างเหมือนกัน ("agent", "Microsoft", และ "AI") สิ่งนี้บอกเราว่าเอกสารทั้งสองครอบคลุมธีมโดยรวมที่คล้ายคลึงกัน แต่ไม่ได้ช่วยให้เราแยกแยะระหว่างเอกสารแต่ละฉบับ การตรวจสอบจํานวนคําศัพท์ที่ใช้ไม่บ่อยอาจช่วยได้ แต่คุณสามารถจินตนาการถึงการวิเคราะห์คลังข้อมูลตามเอกสาร AI ของ Microsoft ได้อย่างง่ายดาย ซึ่งจะส่งผลให้มีคําศัพท์จํานวนมากที่พบได้ทั่วไปในเอกสารทั้งหมด ทําให้ยากต่อการกําหนดหัวข้อเฉพาะที่ครอบคลุมในแต่ละเอกสาร

เพื่อแก้ไขปัญหานี้ ความถี่ของคํา - ความถี่ของเอกสารผกผัน (TF-IDF) เป็นเทคนิคที่คํานวณคะแนนตามความถี่ที่คําหรือคําศัพท์ปรากฏในเอกสารเดียวเมื่อเทียบกับความถี่ทั่วไปในคอลเลกชันเอกสารทั้งหมด เมื่อใช้เทคนิคนี้ จะมีการสันนิษฐานความเกี่ยวข้องระดับสูงสําหรับคําที่ปรากฏบ่อยในเอกสารใดเอกสารหนึ่ง แต่ค่อนข้างไม่บ่อยนักในเอกสารอื่นๆ ในการคํานวณ TF-IDF สําหรับเงื่อนไขในเอกสารแต่ละฉบับคุณสามารถใช้กระบวนการสามขั้นตอนต่อไปนี้:

คํานวณความถี่ของคําศัพท์ (TF): นี่คือจํานวนครั้งที่คําปรากฏในเอกสาร ตัวอย่างเช่น หากคํา

"agent"นั้นปรากฏ 6 ครั้งในเอกสาร ดังนั้นtf(agent) = 6คํานวณความถี่ของเอกสารผกผัน (IDF): จะตรวจสอบว่าคํานั้นพบบ่อยหรือหายากเพียงใดในเอกสารทั้งหมด ถ้าคําปรากฏในทุกเอกสาร แสดงว่าคํานั้นไม่พิเศษ สูตรที่ใช้ในการคํานวณ IDF คือ

idf(t) = log(N / df(t))(โดยที่Nคือ จํานวนเอกสารทั้งหมด และdf(t)คือ จํานวนเอกสารที่มีคําtว่า )รวมเข้าด้วยกันเพื่อคํานวณ TF-IDF: คูณ TF และ IDF เพื่อให้ได้คะแนน:

tfidf(t, d) = tf(t, d) * log(N / df(t))

คะแนน TF-IDF สูงบ่งชี้ว่าคําปรากฏบ่อยครั้งในเอกสารหนึ่ง แต่ไม่ค่อยปรากฏในเอกสารอื่น คะแนนต่ําบ่งชี้ว่าคําเป็นเรื่องธรรมดาในเอกสารจํานวนมาก ในสองตัวอย่างเกี่ยวกับตัวแทน AI เนื่องจาก "AI", , และ"agent"ปรากฏในทั้งสองตัวอย่าง (N = 2, df(t) = 2) IDF ของพวกเขาคือ log(2/2) = 0ดังนั้นพวกเขาจึงไม่มีน้ําหนักที่เลือกปฏิบัติใน "Microsoft"TF-IDF ผลลัพธ์ TF-IDF สามอันดับแรกสําหรับตัวอย่างคือ:

ตัวอย่าง A:

| เงื่อนไข | TF-IDF |

|---|---|

copilot |

2.0794 |

studio |

2.0794 |

declarative |

1.3863 |

ตัวอย่าง B:

| เงื่อนไข | TF-IDF |

|---|---|

code |

2.0794 |

develop |

2.0794 |

foundry |

2.0794 |

จากผลลัพธ์เหล่านี้ จะชัดเจนขึ้นว่าตัวอย่าง A เกี่ยวกับการสร้างตัวแทนแบบประกาศด้วย Copilot Studio ในขณะที่ตัวอย่าง B เกี่ยวกับการพัฒนาตัวแทนตามรหัสด้วย Microsoft Foundry

เทคนิคการเรียนรู้ของเครื่อง "ถุงคํา"

Bag-of-words เป็นชื่อที่กําหนดให้กับเทคนิคการแยกคุณลักษณะที่แสดงโทเค็นข้อความเป็นเวกเตอร์ของความถี่หรือเหตุการณ์ของคําโดยไม่สนใจไวยากรณ์และลําดับคํา การแสดงนี้กลายเป็นอินพุตสําหรับอัลกอริธึมการเรียนรู้ของเครื่อง เช่น Naive Bayes ซึ่งเป็นตัวจําแนกความน่าจะเป็นที่ใช้ทฤษฎีบทของ Bayes เพื่อทํานายคลาสที่น่าจะเป็นของเอกสารตามความถี่ของคํา

ตัวอย่างเช่น คุณอาจใช้เทคนิคนี้เพื่อฝึกโมเดลแมชชีนเลิร์นนิงที่ทําการกรองจดหมายขยะอีเมล คํา "miracle cure"ว่า , "lose weight fast", และ '"ต่อต้านริ้วรอย'' อาจปรากฏบ่อยกว่าในอีเมลสแปมเกี่ยวกับผลิตภัณฑ์เพื่อสุขภาพที่น่าสงสัยมากกว่าอีเมลปกติของคุณ และโมเดลที่ผ่านการฝึกอบรมอาจตั้งค่าสถานะข้อความที่มีคําเหล่านี้ว่าอาจเป็นสแปม

คุณสามารถใช้ การวิเคราะห์ความรู้สึก โดยใช้วิธีเดียวกันในการจําแนกข้อความตามน้ําเสียงทางอารมณ์ ถุงคํามีคุณสมบัติ และโมเดลใช้คุณลักษณะเหล่านั้นเพื่อประเมินความน่าจะเป็นและกําหนดป้ายกํากับความคิดเห็น เช่น "บวก" หรือ "ลบ"

เท็กซ์แรงค์

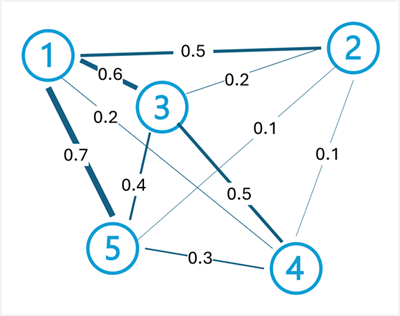

TextRank เป็นอัลกอริทึมที่ใช้กราฟที่ไม่มีผู้ดูแลซึ่งสร้างแบบจําลองข้อความเป็นเครือข่ายของ โหนดที่เชื่อมต่อ ตัวอย่างเช่น แต่ละประโยคในเอกสารอาจถือได้ว่าเป็นโหนด และการเชื่อมต่อ (ขอบ) ระหว่างประโยคเหล่านั้นจะถูกให้คะแนนตามความคล้ายคลึงกันของคําที่มีอยู่ TextRank มักใช้เพื่อสรุปข้อความตามการระบุชุดย่อยของประโยคภายในเอกสารที่แสดงถึงหัวเรื่องโดยรวมได้ดีที่สุด

อัลกอริทึม TextRank ใช้หลักการเดียวกับอัลกอริทึม PageRank ของ Google (ซึ่งจัดอันดับหน้าเว็บตามลิงก์ระหว่างกัน) กับข้อความ แนวคิดหลักคือประโยคมีความสําคัญหากคล้ายกับประโยคสําคัญอื่นๆ อัลกอริทึมทํางานผ่านขั้นตอนต่อไปนี้:

สร้างกราฟ: แต่ละประโยคจะกลายเป็นโหนด และขอบที่เชื่อมต่อประโยคเหล่านั้นจะถูกถ่วงน้ําหนักตามความคล้ายคลึงกัน (มักวัดโดยใช้การทับซ้อนกันของคําหรือความคล้ายคลึงกันของโคไซน์ระหว่างเวกเตอร์ประโยค)

คํานวณอันดับซ้ํา: คะแนนของแต่ละโหนดจะคํานวณตามคะแนนของโหนดที่เชื่อมต่ออยู่ สูตรคือ:

TextRank(Sᵢ) = (1-d) + d * Σ(wⱼᵢ / Σwⱼₖ) * TextRank(Sⱼ)(โดยที่dปัจจัยการหน่วง โดยทั่วไปคือ 0.85wⱼᵢคือน้ําหนักของขอบจากประโยคjหนึ่งไปอีกประโยคiหนึ่ง และผลรวมจะวนซ้ําทุกประโยคที่เชื่อมต่อกับi)แยกประโยคอันดับสูงสุด: หลังจากการบรรจบกัน ประโยคที่มีคะแนนสูงสุดจะถูกเลือกเป็นบทสรุป

ตัวอย่างเช่น พิจารณาเอกสารต่อไปนี้เกี่ยวกับการประมวลผลแบบคลาวด์:

Cloud computing provides on-demand access to computing resources. Computing resources include servers, storage, and networking. Azure is Microsoft's cloud computing platform. Organizations use cloud platforms to reduce infrastructure costs. Cloud computing enables scalability and flexibility.

ในการสร้างบทสรุปของเอกสารนี้กระบวนการ TextRank เริ่มต้นด้วยการแบ่งเอกสารนี้ออกเป็นประโยค:

Cloud computing provides on-demand access to computing resources.Computing resources include servers, storage, and networking.Azure is Microsoft's cloud computing platform.Organizations use cloud platforms to reduce infrastructure costs.Cloud computing enables scalability and flexibility.

ถัดไปขอบจะถูกสร้างขึ้นระหว่างประโยคที่มีน้ําหนักตามความคล้ายคลึงกัน (คําทับซ้อนกัน) สําหรับตัวอย่างนี้ น้ําหนักขอบอาจเป็น:

- ประโยคที่ 1 <-> ประโยคที่ 2 : 0.5 (หุ้น

"computing resources") - ประโยคที่ 1 <-> ประโยคที่ 3 : 0.6 (หุ้น

"cloud computing") - ประโยคที่ 1 <-> ประโยคที่ 4 : 0.2 (หุ้น

"cloud") - ประโยคที่ 1 <-> ประโยคที่ 5 : 0.7 (หุ้น

"cloud computing") - ประโยค 2 <-> ประโยค 3: 0.2 (ทับซ้อนกันจํากัด)

- ประโยค 2 <-> ประโยค 4: 0.1 (ทับซ้อนกันจํากัด)

- ประโยคที่ 2 <-> ประโยคที่ 5 : 0.1 (หุ้น

"computing") - ประโยค 3 <-> ประโยค 4 : 0.5 (หุ้น

"cloud platforms") - ประโยค 3 <-> ประโยค 5 : 0.4 (หุ้น

"cloud computing") - ประโยค 4 <-> ประโยค 5: 0.3 (ทับซ้อนกันจํากัด)

หลังจากคํานวณคะแนน TextRank ซ้ําๆ โดยใช้น้ําหนักเหล่านี้ ประโยค 1, 3 และ 5 อาจได้รับคะแนนสูงสุด เนื่องจากเชื่อมต่อกับประโยคอื่นๆ ได้ดีผ่านคําศัพท์และแนวคิดที่ใช้ร่วมกัน ประโยคเหล่านี้จะถูกเลือกเพื่อสร้างบทสรุปที่กระชับ: "Cloud computing provides on-demand access to computing resources. Azure is Microsoft's cloud computing platform. Cloud computing enables scalability and flexibility."

หมายเหตุ

การสร้างสรุปเอกสารโดยการเลือกประโยคที่เกี่ยวข้องมากที่สุดเป็นรูปแบบหนึ่งของการสรุปแบบแยกข้อมูล ในวิธีนี้ จะไม่มีการสร้างข้อความใหม่ - สรุปประกอบด้วยชุดย่อยของข้อความต้นฉบับ การพัฒนาล่าสุดในการสร้างแบบจําลองความหมายยังช่วยให้สามารถสรุปเชิง นามธรรม ซึ่งจะสร้างภาษาใหม่ที่สรุปธีมหลักของเอกสารต้นฉบับ

นอกจากนี้ TextRank ยังสามารถนําไปใช้ในระดับคําสําหรับการ แยกคีย์เวิร์ด โดยที่คํา (แทนที่จะเป็นประโยค) จะกลายเป็นโหนด และขอบแสดงถึงการเกิดขึ้นร่วมกันภายในหน้าต่างคงที่ คําที่มีอันดับสูงสุดจะถูกแยกออกมาเป็นคําสําคัญที่แสดงถึงหัวข้อหลักของเอกสาร