Not

Bu sayfaya erişim yetkilendirme gerektiriyor. Oturum açmayı veya dizinleri değiştirmeyi deneyebilirsiniz.

Bu sayfaya erişim yetkilendirme gerektiriyor. Dizinleri değiştirmeyi deneyebilirsiniz.

Bu makalede, Azure Databricks işlemini görüntüleme, düzenleme, başlatma, sonlandırma, silme, erişimi denetleme ve performans ile günlükleri izleme gibi işlemlerin nasıl yönetileceğini açıklanmaktadır. İşlemleri program aracılığıyla yönetmek için Kümeler API'sini de kullanabilirsiniz.

Hesaplamayı görüntüle

Çalışma alanı kenar çubuğunda ![]() 'ne tıklayarak işleminizi görüntüleyebilirsiniz.

'ne tıklayarak işleminizi görüntüleyebilirsiniz.

Sol tarafta, işlem sabitlenip sabitlenmediğini ve işlem durumunu gösteren iki sütun bulunur. Üzerine gelerek durum hakkında daha fazla bilgi edinin.

İşlem yapılandırmasını JSON dosyası olarak görüntüleme

Bazen işlem yapılandırmanızı JSON olarak görüntülemek yararlı olabilir. Bu özellikle Kümeler API'sini kullanarak benzer bir işlem oluşturmak istediğinizde kullanışlıdır. Mevcut bir işlemi görüntülediğinizde Yapılandırma sekmesine gidin, sekmenin sağ üst kısmındaki JSON'a tıklayın, JSON'u kopyalayın ve API çağrınıza yapıştırın. JSON görünümü salt okunurdur.

Bir bilişim bileşenini sabitleme

İşlem sonlandırıldıktan 30 gün sonra kalıcı olarak silinir. Bir işlem 30 günden uzun süre durdurulduğunda, tüm amaçlı işlem yapılandırmasını korumak için yönetici işlemi sabitleyebilir. En fazla 100 işlem kaynağı sabitlenebilir.

Yöneticiler, sabitle simgesine tıklayarak işlem listesinden veya işlem ayrıntısı sayfasından bir işlem sabitleyebilir.

Hesaplama düzenle

İşlem ayrıntılarının kullanıcı arabiriminden bir işlem yapılandırmasını düzenleyebilirsiniz.

Not

- İşlem birimine iliştirilmiş not defterleri ve işler, düzenlendikten sonra iliştirilmiş olarak kalır.

- Düzenlemeden sonra işlem biriminde yüklü olan kitaplıklar yüklü kalmaya devam eder.

- Çalışan bir işlemin herhangi bir özniteliğini düzenlerseniz (işlem boyutu ve izinleri hariç), işlemi yeniden başlatmanız gerekir. Bu, şu anda bilgisayar kullanan kullanıcıları kesintiye uğratabilir.

- Yalnızca çalışmakta olan veya sonlandırılan bir hesaplamayı düzenleyebilirsiniz. Ancak, işlem ayrıntıları sayfasında belirtilen durumlarda olmayan işlem izinlerini güncelleyebilirsiniz.

Bir hesaplama birimini kopyala

Mevcut bir hesaplama birimini kopyalamak için, hesaplamanın Kebab menu icon.menüsünden Kopyala'yı seçin.

Kopyala'yı seçtikten sonra, hesaplama yapılandırmasıyla önceden doldurulmuş hesaplama oluşturma kullanıcı arayüzü açılır. Aşağıdaki öznitelikler kopyaya ekLENMEDİ:

- İşlem izinleri

- Ekli not defterleri

Önceden yüklenmiş kitaplıkları kopyalanan işlem içine eklemek istemiyorsanız İşlem oluştur düğmesinin yanındaki açılan menüye tıklayın ve Kitaplıklar olmadan oluştur'u seçin.

İşlem izinleri

Bir işlem için dört izin düzeyi vardır: İZİN YOK, BAĞLAYABİLİR, YENİDEN BAŞLATABİLİR ve YÖNETEBİLİR. Ayrıntılar için bkz . İşlem ACL'leri.

Not

Gizli bilgiler, kümenin Spark sürücü günlüğünden stdout ve stderr akışlarından gizlenmez. Hassas verileri korumak için Spark sürücü günlükleri, varsayılan olarak yalnızca görev üzerinde YÖNETME iznine sahip kullanıcılar ve ayrılmış erişim modu ve standart erişim modu kümelerinde görüntülenebilir. CAN ATTACH TO veya CAN RESTART izni olan kullanıcıların bu kümelerdeki günlükleri görüntülemesine izin vermek için, küme yapılandırmasında aşağıdaki Spark yapılandırma özelliğini ayarlayın: spark.databricks.acl.needAdminPermissionToViewLogs false.

Yalıtımsız paylaşılan erişim modu kümelerde, Spark sürücü günlükleri CAN ATTACH TO, CAN RESTART veya CAN MANAGE iznine sahip kullanıcılar tarafından görüntülenebilir. Günlükleri kimlerin okuyabileceğini yalnızca CAN MANAGE iznine sahip kullanıcılarla sınırlandırmak için spark.databricks.acl.needAdminPermissionToViewLogstrueolarak ayarlayın.

Spark özelliklerini bir küme yapılandırmasına nasıl ekleyeceğinizi öğrenmek için Spark yapılandırmasına göz atın.

İşlem izinlerini yapılandırma

Bu bölümde, çalışma alanı kullanıcı arabirimini kullanarak izinlerin nasıl yönetileceğini açıklanmaktadır. İzinler API'sini veya Databricks Terraform sağlayıcısını da kullanabilirsiniz.

İşlem izinlerini yapılandırmak için bir işlem üzerinde CAN MANAGE iznine sahip olmanız gerekir.

- Kenar çubuğunda İşlem'e tıklayın.

- İşlem satırında kebap menüsü

Sağ tarafta İzinleri düzenle'yi seçin.

İzin Ayarları'nda Kullanıcı, grup veya hizmet sorumlusu seçin... açılan menüsüne tıklayın ve bir kullanıcı, grup veya hizmet sorumlusu seçin. - İzin açılır menüsünden bir izin seçin.

- Ekle'ye ve Kaydet'e tıklayın.

İşlemi sonlandırma

İşlem kaynaklarını kaydetmek için bir işlem sonlandırabilirsiniz. Sonlandırılan işlem yapılandırması, daha sonra yeniden kullanılabilmesi (veya işler söz konusu olduğunda otomatik olarak başlatılabilmesi) için depolanır. Bir hesaplama işlemini elle sonlandırabilir veya belirli bir süre hareketsizlikten sonra otomatik olarak sonlanacak şekilde yapılandırabilirsiniz.

İşlem sabitlenmediği veya yeniden başlatılmadığı sürece, sonlandırmadan 30 gün sonra otomatik ve kalıcı olarak silinir. Bu silme işlemi bir kullanıcı veya API eylemi yerine sistem tarafından gerçekleştirildiğinden, denetim günlüklerinde görünmez.

Sonlandırılan işlem, işlem listesinde işlem adının solunda gri bir daireyle gösterilir.

Not

Yeni bir İş işlemi üzerinde bir iş çalıştırdığınızda (genellikle önerilir), işlem sonlandırılır ve iş tamamlandığında yeniden başlatılamaz. Öte yandan, sonlandırılmış mevcut bir Çok Amaçlı hesaplama üzerinde çalışacak bir iş zamanlarsanız, bu hesaplama otomatik olarak başlayacaktır.

Önemli

Deneme Premium çalışma alanı kullanıyorsanız, çalışan tüm işlem kaynakları sonlandırılır:

- Bir çalışma alanını tam Premium'a yükselttiğiniz zaman.

- Çalışma alanı yükseltilmediyse ve deneme süresi dolarsa.

El ile sonlandırma

İşlem listesinden (işlem satırındaki kareye tıklayarak) veya işlem ayrıntı sayfasından ( Sonlandır'a tıklayarak) bir işlem işlemini el ile sonlandırabilirsiniz.

Otomatik sonlandırma

İşlem için otomatik sonlandırma da ayarlayabilirsiniz. İşlem oluşturma sırasında, işlem işleminin sonlandırılmasını istediğiniz işlem dışı süreyi dakikalar içinde belirtebilirsiniz.

geçerli saat ile işlemdeki son komut çalıştırması arasındaki fark belirtilen etkinlik dışı süreden fazlaysa, Azure Databricks bu işlemi otomatik olarak sonlandırır.

Spark işleri, Yapılandırılmış Akış, JDBC çağrıları ve Azure Databricks web terminali etkinliği de dahil olmak üzere işlemdeki tüm komutlar yürütmeyi bitirdiğinde işlem etkin değil olarak kabul edilir.

Uyarı

- Hesaplama, DStream'lerin kullanımından kaynaklanan etkinliği raporlamaz. Bu, DStreams çalıştırılırken otomatik sonlanan bir hesaplamanın sonlandırılabileceği anlamına gelir. DStreams çalıştıran işlem için otomatik sonlandırmayı kapatın veya Yapılandırılmış Akış kullanmayı göz önünde bulundurun.

- Boşta çalışan işlem, sonlandırmadan önce etkin olmayan süre boyunca DBU ve bulut örneği ücretlerinin birikmesine devam eder.

Otomatik sonlandırmayı yapılandırma

Yeni işlem arayüzünde otomatik sonlandırmayı yapılandırabilirsiniz. Kutunun işaretli olduğundan emin olun ve işlem yapılmadan geçen dakika süresi dolduğunda sonlandır ayarına dakika sayısını girin.

Otomatik Sonlandırma onay kutusunu temizleyerek veya etkinlik dışı bir süre 0belirterek otomatik sonlandırmayı geri çevirebilirsiniz.

Not

Otomatik sonlandırma en son Spark sürümlerinde en iyi şekilde desteklenir. Eski Spark sürümlerinin bilinen sınırlamaları vardır ve bu da işlem etkinliğinin yanlış raporlanmasıyla sonuçlanabilir. Örneğin, JDBC, R veya akış komutlarını çalıştıran işlem, erken işlem sonlandırmaya yol açan eski bir etkinlik süresi bildirebilir. Hata düzeltmeleri ve otomatik sonlandırma iyileştirmelerinden yararlanmak için lütfen en son Spark sürümüne yükseltin.

Beklenmeyen sonlandırma

Bazen bir hesaplama, el ile sonlandırma veya yapılandırılmış otomatik sonlandırma sonucu olmaksızın beklenmedik şekilde sonlandırılır.

Sonlandırma nedenlerinin ve düzeltme adımlarının listesi için bkz. Bilgi Bankası.

Bir hesaplamayı sil

Bir işlem silindiğinde işlem sonlandırılarak yapılandırması kaldırılır. Bir hesaplama birimini silmek için, hesaplama biriminin Kebab menu icon. menüsünden Sil'i seçin.

Uyarı

Bu eylemi geri alamazsınız.

Sabitlenmiş bir hesaplamayı silmek için, önce bir yönetici tarafından sabitlemesi kaldırılmalıdır.

Bir işlemi program aracılığıyla silmek için Kümeler API'sinin uç noktasını da çağırabilirsiniz.

İşlemi yeniden başlatma

İşlem listesinden, işlem ayrıntı sayfasından veya not defterinden daha önce sonlandırılan bir işlemi yeniden başlatabilirsiniz. Programlama yoluyla işlem başlatmak için Kümeler API'sinin uç noktasını da çağırabilirsiniz.

Azure Databricks, benzersiz küme kimliğini kullanarak bir işlem tanımlar. Sonlandırılan bir işlem başlattığınızda Databricks, aynı kimlikle işlem yeniden oluşturur, tüm kitaplıkları otomatik olarak yükler ve not defterlerini yeniden ekler.

Not

Deneme çalışma alanı kullanıyorsanız ve deneme süresinin dolması durumunda işlem başlatamazsınız.

Bilgisayarı en son görüntülerle güncellemek için yeniden başlatın

Bilgisayar kaynaklarını yeniden başlattığınızda, bilgisayar kaynağı kapsayıcıları ve VM konakları için en son görüntüleri alır. Akış verilerini işlemek için kullanılanlar gibi uzun süre çalışan işlemler için düzenli yeniden başlatmalar zamanlamak önemlidir.

Görüntüyü en son görüntü sürümüyle güncel tutmak için tüm işlem kaynaklarını düzenli olarak yeniden başlatmak sizin sorumluluğunuzdadır.

Önemli

Hesabınız veya çalışma alanınız için uyumluluk güvenlik profili etkinleştirirseniz, uzun süre çalışan işlem zamanlanmış bir bakım penceresi sırasında gerektiğinde otomatik olarak yeniden başlatılır. Bu, otomatik yeniden başlatmanın zamanlanmış işi kesintiye uğratma riskini azaltır. Ayrıca bakım penceresi sırasında yeniden başlatmayı zorlayabilirsiniz. Bkz. Otomatik küme güncelleştirme.

Not defteri örneği: Uzun süre çalışan hesaplamayı bulma

Çalışma alanı yöneticisiyseniz, işlemlerinizin her birinin ne kadar süreyle çalıştığını belirleyen bir betik çalıştırabilir ve isteğe bağlı olarak, belirtilen sayıda günden eskiyse bunları yeniden başlatabilirsiniz. Azure Databricks bu betiği bir çalışma kitabı olarak sağlar.

Betiğin ilk satırları yapılandırma parametrelerini tanımlar:

-

min_age_output: İşlemin çalıştırabileceği en fazla gün sayısı. Varsayılan değer 1'dir. -

perform_restart: EğerTrueise, betikmin_age_outputtarafından belirtilen gün sayısından daha büyük olan her yaştaki hesaplamayı yeniden başlatır. Varsayılan değer, uzun süre çalışan işlemi tanımlayan ancak bunları yeniden başlatmayan şeklindedirFalse. -

secret_configuration:REPLACE_WITH_SCOPEveREPLACE_WITH_KEYdeğerlerini bir gizli alan ve anahtar adı ile değiştirin. Sırları ayarlama hakkında daha fazla bilgi için not defterine bakın.

Uyarı

perform_restart'ı Trueolarak ayarlarsanız, betik uygun bilişim kaynaklarını otomatik olarak yeniden başlatır, bu da aktif görevlerin başarısız olmasına ve açık not defterlerinin sıfırlanmasına neden olabilir. Çalışma alanınızın iş açısından kritik işlerini kesintiye uğratma riskini azaltmak için zamanlanmış bir bakım penceresi planlayın ve çalışma alanı kullanıcılarına bildirmeyi unutmayın.

Uzun süre çalışan hesaplamaları tanımlayıp gerekirse yeniden başlatma

İşler ve JDBC/ODBC sorguları için otomatik başlatmayı hesapla

Sonlandırılan bir işlem için atanan bir iş çalışmak üzere zamanlandığında veya bir JDBC/ODBC arabiriminden sonlandırılan bir işlemle bağlantı kurduğunuzda işlem otomatik olarak yeniden başlatılır. Bakınız, İşler için bilgi işlem yapılandırması ve JDBC bağlantısı.

İşlem otomatik başlangıcı, zamanlanmış işler için işlemi yeniden başlatmak için el ile müdahaleye gerek kalmadan işlemi otomatik olarak sonlandıracak şekilde yapılandırmanıza olanak tanır. Ayrıca, sonlandırılmış bir hesaplama üzerinde bir iş başlatarak hesaplama başlatma işlemini zamanlayabilirsiniz.

İşlem otomatik olarak yeniden başlatılmadan önce işlem ve iş erişim denetimi izinleri denetleniyor.

Not

İşleminiz Azure Databricks platformu sürüm 2.70 veya önceki bir sürümde oluşturulduysa otomatik başlangıç yoktur: sonlandırılan işlemde çalıştırılacak şekilde zamanlanan işler başarısız olur.

Spark kullanıcı arabiriminde işlem bilgilerini görüntüleme

İşlem ayrıntıları sayfasındaki Spark kullanıcı arabirimi sekmesini seçerek Spark işleri hakkındaki ayrıntılı bilgileri görüntüleyebilirsiniz.

Sonlandırılan bir işlemi yeniden başlatırsanız Spark kullanıcı arabirimi, sonlandırılan işlemle ilgili geçmiş bilgileri değil, yeniden başlatılan işlem bilgilerini görüntüler.

Spark kullanıcı arabirimini kullanarak maliyet ve performans sorunlarını tanılama adımlarını görmek için bkz . Spark kullanıcı arabirimini kullanarak maliyet ve performans sorunlarını tanılama.

İşlem günlüklerini görüntüleme

Azure Databricks, işlemle ilgili etkinliğin üç tür günlüğe kaydedilmesini sağlar:

- Oluşturma, sonlandırma ve yapılandırma düzenlemeleri gibi işlem yaşam döngüsü olaylarını yakalayan işlem olay günlükleri.

- Hata ayıklama için kullanabileceğiniz Apache Spark sürücüsü ve çalışan günlüğü.

- İşlem başlatma betik günlüklerini hesaplayın, bunlar başlatma betiklerini hata ayıklamak için değerlidir.

Bu bölümde işlem olay günlükleri, sürücü ve çalışan günlükleri ele alınmaktadır. Init-script günlükleri hakkında ayrıntılı bilgi için Init-script günlüğü bölümüne bakın.

İşlem olay günlükleri

İşlem olay günlüğü, kullanıcı eylemleri tarafından el ile veya Azure Databricks tarafından otomatik olarak tetiklenen önemli işlem yaşam döngüsü olaylarını görüntüler. Bu tür olaylar bir işlemin bir bütün olarak çalışmasını ve işlemde çalışan işleri etkiler.

Desteklenen olay türleri için bkz. Kümeler API'sinin veri yapısı.

Olaylar 60 gün boyunca depolanır ve bu süre Azure Databricks'teki diğer veri saklama süreleriyle karşılaştırılabilir.

Bir bilgisayarın olay günlüğünü görüntüle

İşlemin olay günlüğünü görüntülemek için işlem ayrıntıları sayfalarında Olay günlüğü sekmesini seçin.

Bir olay hakkında daha fazla bilgi için günlükteki satırına tıklayın ve ardından ayrıntılar için JSON sekmesine tıklayın.

İşlem sürücüsü ve çalışan günlükleri

Defterlerinizden, işlerinizden ve kütüphanelerinizden gelen doğrudan yazdırma ve günlük ifadeleri Spark sürücü loglarına gider. Bu günlük dosyalarına işlem ayrıntıları sayfasındaki Sürücü günlükleri sekmesinden erişebilirsiniz. İndirmek için günlük dosyasının adına tıklayın.

Bu günlüklerin üç çıkışı vardır:

- Standart çıktı

- Standart hata

- Log4j günlükleri

Spark çalışan günlüklerini görüntülemek için Spark kullanıcı arabirimi sekmesini kullanın. İşlem için bir günlük teslim konumu da yapılandırabilirsiniz. Hem çalışan hem de işlem günlükleri belirttiğiniz konuma teslim edilir.

Performansı izleme

Azure Databricks işleminin performansını izlemenize yardımcı olmak için Azure Databricks, işlem ayrıntıları sayfasından ölçümlere erişim sağlar. Databricks Runtime 12.2 ve altı için Azure Databricks, Ganglia ölçümlerine erişim sağlar. Databricks Runtime 13.3 LTS ve üzeri için işlem ölçümleri Azure Databricks tarafından sağlanır.

Ayrıca, Azure için izleme platformu olan Azure İzleyici'deki Log Analytics çalışma alanına ölçümleri göndermek üzere bir Azure Databricks hesaplama birimi yapılandırabilirsiniz.

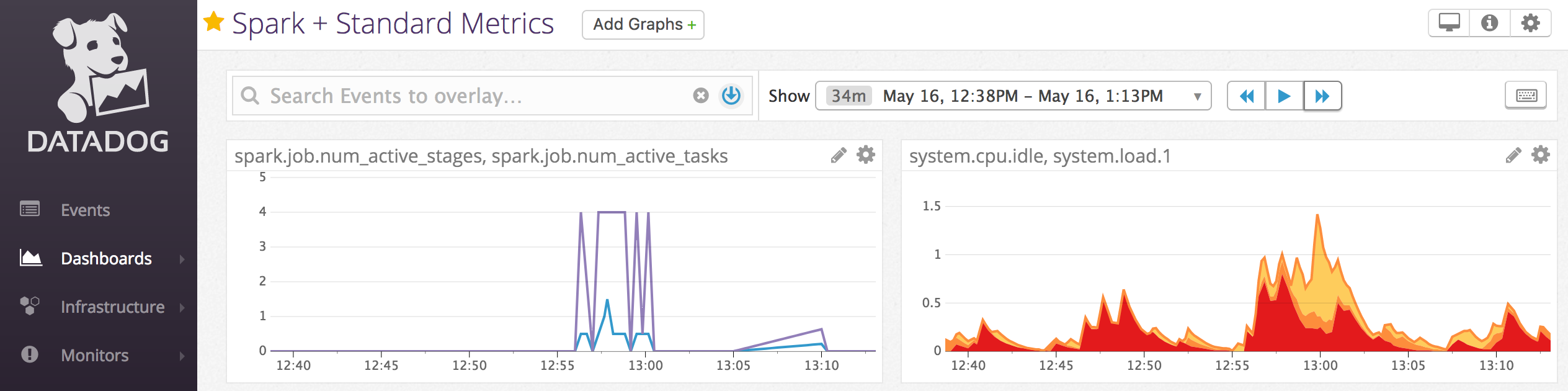

Datadog ölçümlerini Datadog hesabınıza göndermek için işlem düğümlerine Datadog aracıları da yükleyebilirsiniz.

Metrikleri hesapla

Hesaplama ölçümleri, sunucu tabanlı tüm amaçlı ve iş hesaplamaları için varsayılan izleme aracıdır. İşlem ölçümleri kullanıcı arabirimine erişmek için işlem ayrıntıları sayfasındaki Ölçümler sekmesine gidin.

Tarih seçici filtresini kullanarak bir zaman aralığı seçerek geçmiş ölçümleri görüntüleyebilirsiniz. Ölçümler dakikada bir toplanır. Yenile düğmesine tıklayarak da en son ölçümleri alabilirsiniz. Daha fazla bilgi için bkz . İşlem ölçümlerini görüntüleme.

Ganglia ölçümleri

Not

Ganglia ölçümleri yalnızca Databricks Runtime 12.2 ve altında kullanılabilir.

Ganglia kullanıcı arabirimine erişmek için işlem ayrıntıları sayfasındaki Ölçümler sekmesine gidin ve Eski ölçümler ayarını etkinleştirin. GPU ölçümleri GPU özellikli işlem için kullanılabilir.

Canlı ölçümleri görüntülemek için Ganglia Kullanıcı Arabirimi bağlantısına tıklayın.

Geçmiş ölçümleri görüntülemek için bir anlık görüntü dosyasına tıklayın. Anlık görüntü, seçilen saatten önceki saatin toplam ölçümlerini içerir.

Not

Ganglia, Docker kapsayıcıları ile desteklenmez. Bilgisayar işlem biriminizle bir Docker kapsayıcısı kullanırsanız Ganglia ölçümleri kullanılamaz.

Ganglia ölçüm koleksiyonunu yapılandırma

Azure Databricks, Ganglia ölçümlerini varsayılan olarak 15 dakikada bir toplar. Koleksiyon dönemini yapılandırmak için DATABRICKS_GANGLIA_SNAPSHOT_PERIOD_MINUTES kullanarak veya Küme OLUŞTURMA API'sininspark_env_vars alanında ortam değişkenini ayarlayın.

Azure İzleyici

Azure Databricks hesaplama kaynaklarını, Azure'un izleme platformu olan Azure İzleyici'deki Log Analytics çalışma alanına ölçümler gönderecek şekilde yapılandırabilirsiniz.

Not

Azure Databricks çalışma alanını kendi sanal ağınıza dağıttıysanız ve Azure Databricks tarafından gerekli olmayan tüm giden trafiği reddedecek şekilde ağ güvenlik gruplarını (NSG) yapılandırdıysanız, "AzureMonitor" hizmet etiketi için ek bir giden kuralı yapılandırmanız gerekir.

Not defteri örneği: Datadog ölçümleri

Datadog ölçümlerini Datadog hesabınıza göndermek için işlem düğümlerine Datadog aracıları yükleyebilirsiniz. Aşağıdaki not defteri, işlem kapsamlı bir init betiği kullanarak bir işlem üzerinde Datadog aracısının nasıl yükleneceğini gösterir.

Datadog aracısını tüm işlemlere yüklemek için işlem ilkesi kullanarak işlem kapsamlı init betiğini yönetin.

Datadog ajanı başlatma betiği not defterini yükleme

Spot örneklerini devre dışı bırakma

Spot örnekler maliyetleri düşürebileceğinden, işleri çalıştırmak için isteğe bağlı örnekler yerine spot örnekleri kullanarak işlem oluşturmak yaygın bir yoldur. Ancak spot örnekler bulut sağlayıcısı zamanlama mekanizmaları tarafından önlenebilir. Spot örneklerinin öncelikli olarak kullanılması, çalışmakta olan işler üzerinde sorunlara yol açabilir, örneğin:

- Karıştırma getirme hataları

- Veri kaybını karıştırma

- RDD veri kaybı

- İş hataları

Bu sorunların giderilmesine yardımcı olmak için devre dışı bırakma özelliğini etkinleştirebilirsiniz. Kullanımdan kaldırma, bulut sağlayıcısının genellikle bir spot örneği kullanımdan kaldırılmadan önce gönderdiği bildirimden yararlanır. Bir yürütücü içeren bir spot örneği kapma bildirimi aldığında, devre dışı bırakma işlemi karıştırma ve RDD verilerini sağlıklı yürütücülere aktarmaya çalışır. Bulut sağlayıcısına bağlı olarak, son ön koşuldan önceki süre genellikle 30 saniye ile 2 dakika arasındadır.

Databricks, devre dışı bırakma da etkinleştirildiğinde veri geçişinin etkinleştirilmesini önerir. Genellikle, karıştırma verisi alma hataları, karışık veri kaybı ve RDD veri kaybı dahil daha fazla veri taşındıkça hata olasılığı azalır. Veri geçişi, daha az yeniden hesaplama ve tasarruf maliyetlerine de yol açabilir.

Not

Devreden çıkarma, elinden gelenin yapılmasıdır ve tüm verilerin öncelik tanınmadan önce aktarılabileceğini garanti etmez. Görev çalıştırıldığında yürütücüden karıştırma verileri getirilirken, yetkisini alma işlemi karıştırma getirme hatalarına karşı garanti veremez.

Devre dışı bırakma etkinleştirildiğinde, spot örnek ökten çıkarılması nedeniyle meydana gelen görev hataları toplam başarısız deneme sayısına eklenmez. Önkoşulun neden olduğu görev hataları başarısız denemeler olarak sayılmaz çünkü hatanın nedeni görevin dışındadır ve iş hatasına neden olmaz.

Devre dışı bırakmayı etkinleştirme

Bir işlemde devre dışı bırakma özelliğini etkinleştirmek için, işlem yapılandırması arayüzündeki Gelişmiş Seçenekler altında yer alan Spark sekmesine aşağıdaki nitelikleri girin. Bu özellikler hakkında bilgi için bkz . Spark yapılandırması.

Başvuruları devre dışı bırakmayı etkinleştirmek için Spark yapılandırma alanına bu özelliği girin:

spark.decommission.enabled trueKullanımdan çıkarma sırasında verilerin rastgele taşınmasını etkinleştirmek için, Spark yapılandırma alanına şu özelliği girin:

spark.storage.decommission.enabled true spark.storage.decommission.shuffleBlocks.enabled trueDevre dışı bırakma sırasında RDD önbellek verisi geçişini etkinleştirmek için Spark yapılandırma alanına şu özelliği girin:

spark.storage.decommission.enabled true spark.storage.decommission.rddBlocks.enabled trueNot

RDD StorageLevel çoğaltması 1'den fazla olarak ayarlandığında, çoğaltmalar RDD'lerin veri kaybetmemesini sağladığından Databricks RDD veri geçişini etkinleştirmenizi önermez.

İşçilerin devre dışı bırakılmasını etkinleştirmek için Ortam Değişkenleri alanına bu özelliği girin:

SPARK_WORKER_OPTS="-Dspark.decommission.enabled=true"

Kullanıcı arabiriminde devre dışı bırakma durumunu ve kayıp nedenini görüntüle

Kullanıcı arabiriminden bir çalışanın devreden çıkarma durumuna erişmek için Spark hesaplama kullanıcı arabirimi - Ana sekmesine gidin.

Kullanımdan kaldırma işlemi tamamlandığında, hesaplama ayrıntıları sayfasındaki Spark UI > Yürütücüler sekmesinde yürütücünün kayıp nedenini görüntüleyebilirsiniz.