Not

Bu sayfaya erişim yetkilendirme gerektiriyor. Oturum açmayı veya dizinleri değiştirmeyi deneyebilirsiniz.

Bu sayfaya erişim yetkilendirme gerektiriyor. Dizinleri değiştirmeyi deneyebilirsiniz.

Önemli

Veri Toplama Kuralları (DCR) ile Logstash çıkış eklentisi kullanılarak veri alımı şu anda genel önizleme aşamasındadır. Bu özellik, hizmet düzeyi sözleşmesi olmadan sağlanır. Daha fazla bilgi için bkz. Microsoft Azure Önizlemeleri için Ek Kullanım Koşulları.

Microsoft Sentinel'in yeni Logstash çıkış eklentisi, veri toplama kuralları (DCR) aracılığıyla işlem hattı dönüşümlerini ve gelişmiş yapılandırmayı destekler. Eklenti, dış veri kaynaklarından her tür günlüğü Log Analytics veya Microsoft Sentinel özel veya standart tablolara iletir.

Bu makalede, yeni Logstash eklentisini, çıkış şeması üzerinde tam denetimle verileri Log Analytics'e akışla aktarmak veya DCR'leri kullanarak Microsoft Sentinel için ayarlamayı öğreneceksiniz. Eklentiyi dağıtmayı öğrenin.

Not

Logstash eklentisinin önceki bir sürümü, Veri Toplama API'sini kullanarak Logstash aracılığıyla veri kaynaklarını bağlamanıza olanak tanır.

Yeni eklenti ile şunları yapabilirsiniz:

- Sütun adlarının ve türlerinin yapılandırmasını denetleyin.

- Filtreleme veya zenginleştirme gibi alım süresi dönüştürmeleri gerçekleştirin.

- Özel günlükleri özel bir tabloya alın veya Log Analytics Syslog tablosuna bir Syslog giriş akışı alın.

Standart tablolara alım yalnızca özel günlük alımı için desteklenen standart tablolarla sınırlıdır.

Logstash veri toplama altyapısıyla çalışma hakkında daha fazla bilgi edinmek için bkz . Logstash ile çalışmaya başlama.

Genel bakış

Mimari ve arka plan

Logstash altyapısı üç bileşenden oluşur:

- Giriş eklentileri: Çeşitli kaynaklardan özelleştirilmiş veri koleksiyonu.

- Filtre eklentileri: Verilerin belirtilen ölçütlere göre değiştirilmesi ve normalleştirilmesi.

- Çıkış eklentileri: Toplanan ve işlenen verilerin çeşitli hedeflere özel gönderilmesi.

Not

Microsoft yalnızca burada açıklanan Microsoft Sentinel sağlanan Logstash çıkış eklentisini destekler. Geçerli eklentinin adı microsoft-sentinel-log-analytics-logstash-output-plugin, v1.1.3. Çıkış eklentisiyle ilgili sorunlar için bir destek bileti açabilirsiniz .

Microsoft, Microsoft Sentinel için üçüncü taraf Logstash çıkış eklentilerini veya herhangi bir türde başka bir Logstash eklentisini veya bileşenini desteklemez.

Eklentinin Logstash sürüm desteğinin önkoşullarına bakın.

Logstash için Microsoft Sentinel çıktı eklentisi, Log Analytics Günlük Alımı API'sini kullanarak JSON biçimli verileri Log Analytics çalışma alanınıza gönderir. Veriler özel günlüklere veya standart tabloya aktarılır.

- Günlük alımı API'si hakkında daha fazla bilgi edinin.

Logstash'ta Microsoft Sentinel çıkış eklentisini dağıtma

Eklentiyi ayarlamak için şu adımları izleyin:

- Önkoşulları gözden geçirin

- Eklentiyi yükleme

- Örnek dosya oluşturma

- Gerekli DCR ile ilgili kaynakları oluşturma

- Logstash yapılandırma dosyasını yapılandırma

- Logstash'i yeniden başlatma

- Gelen günlükleri Microsoft Sentinel'de görüntüleme

- Çıkış eklentisi denetim günlüklerini izleme

Önkoşullar

Logstash'in desteklenen bir sürümünü yükleyin. Eklenti aşağıdaki Logstash sürümlerini destekler:

- 7.0 - 7.17.13

- 8.0 - 8.9

- 8.11 - 8.15

- 8.19.2

- 9.0.8

- 9.1.10

- 9.2.4 - 9.2.5

Not

Logstash 8 kullanıyorsanız işlem hattında ECS'yi devre dışı bırakmanızı öneririz.

En az katkıda bulunan haklarına sahip bir Log Analytics çalışma alanınız olduğunu doğrulayın.

Çalışma alanında DCR nesneleri oluşturma izinlerinizin olduğunu doğrulayın.

Eklentiyi yükleme

Microsoft Sentinel çıktı eklentisi Logstash koleksiyonunda kullanılabilir.

- Logstash Eklentilerle çalışma belgesindeki yönergeleri izleyerek microsoft-sentinel-log-analytics-logstash-output-plugin eklentisini yükleyin.

- Logstash sisteminizin İnternet erişimi yoksa, çevrimdışı eklenti paketini hazırlamak ve kullanmak için Logstash Çevrimdışı Eklenti Yönetimi belgesindeki yönergeleri izleyin. (Bunun için İnternet erişimine sahip başka bir Logstash sistemi oluşturmanız gerekir.)

Örnek dosya oluşturma

Bu bölümde, şu senaryolardan birinde örnek bir dosya oluşturacaksınız:

- Özel günlükler için örnek dosya oluşturma

- Günlükleri Syslog tablosuna almak için örnek bir dosya oluşturma

Özel günlükler için örnek dosya oluşturma

Bu senaryoda Logstash giriş eklentisini olayları Microsoft Sentinel gönderecek şekilde yapılandıracaksınız. Bu örnekte, olayların benzetimini yapmak için oluşturucu giriş eklentisini kullanırız. Diğer giriş eklentilerini kullanabilirsiniz.

Bu örnekte Logstash yapılandırma dosyası şöyle görünür:

input {

generator {

lines => [

"This is a test log message"

]

count => 10

}

}

Aşağıdaki çıkış eklentisi yapılandırmasını Logstash yapılandırma dosyanıza kopyalayın.

output { microsoft-sentinel-log-analytics-logstash-output-plugin { create_sample_file => true sample_file_path => "<enter the path to the file in which the sample data will be written>" #for example: "c:\\temp" (for windows) or "/tmp" for Linux. } }Örnek dosyayı oluşturmadan önce başvuruda bulunılan dosya yolunun var olduğundan emin olmak için Logstash'ı başlatın.

Eklenti, yapılandırılan yolda adlı

sampleFile<epoch seconds>.jsonörnek bir dosyaya on kayıt yazar. Örneğin: c:\temp\sampleFile1648453501.json. Eklentinin oluşturduğu örnek dosyanın bir bölümü aşağıda verilmiştir:[ { "host": "logstashMachine", "sequence": 0, "message": "This is a test log message", "ls_timestamp": "2022-03-28T17:45:01.690Z", "ls_version": "1" }, { "host": "logstashMachine", "sequence": 1 ... ]Eklenti her kayda otomatik olarak şu özellikleri ekler:

-

ls_timestamp: Kaydın giriş eklentisinden alındığı zaman -

ls_version: Logstash işlem hattı sürümü.

DCR'yi oluştururken bu alanları kaldırabilirsiniz.

-

Günlükleri Syslog tablosuna almak için örnek bir dosya oluşturma

Bu senaryoda Logstash giriş eklentisini syslog olaylarını Microsoft Sentinel gönderecek şekilde yapılandıracaksınız.

Logstash makinenize iletilen syslog iletileriniz yoksa, iletileri oluşturmak için günlükçü komutunu kullanabilirsiniz. Örneğin (Linux için):

logger -p local4.warn --rfc3164 --tcp -t CEF: "0|Microsoft|Device|cef-test|example|data|1|here is some more data for the example" -P 514 -d -n 127.0.0.1 Here is an example for the Logstash input plugin: input { syslog { port => 514 } }Aşağıdaki çıkış eklentisi yapılandırmasını Logstash yapılandırma dosyanıza kopyalayın.

output { microsoft-sentinel-log-analytics-logstash-output-plugin { create_sample_file => true sample_file_path => "<enter the path to the file in which the sample data will be written>" #for example: "c:\\temp" (for windows) or "/tmp" for Linux. } }Örnek dosyayı oluşturmadan önce dosya yolunun var olduğundan emin olmak için Logstash'i başlatın.

Eklenti, yapılandırılan yolda adlı

sampleFile<epoch seconds>.jsonörnek bir dosyaya on kayıt yazar. Örneğin: c:\temp\sampleFile1648453501.json. Eklentinin oluşturduğu örnek dosyanın bir bölümü aşağıda verilmiştir:[ { "logsource": "logstashMachine", "facility": 20, "severity_label": "Warning", "severity": 4, "timestamp": "Apr 7 08:26:04", "program": "CEF:", "host": "127.0.0.1", "facility_label": "local4", "priority": 164, "message": 0|Microsoft|Device|cef-test|example|data|1|here is some more data for the example", "ls_timestamp": "2022-04-07T08:26:04.000Z", "ls_version": "1" } ]Eklenti her kayda otomatik olarak şu özellikleri ekler:

-

ls_timestamp: Kaydın giriş eklentisinden alındığı zaman -

ls_version: Logstash işlem hattı sürümü.

DCR'yi oluştururken bu alanları kaldırabilirsiniz.

-

Gerekli DCR kaynaklarını oluşturma

Microsoft Sentinel DCR tabanlı Logstash eklentisini yapılandırmak için önce DCR ile ilgili kaynakları oluşturmanız gerekir.

Bu bölümde, aşağıdaki senaryolardan birinde DCR'niz için kullanılacak kaynaklar oluşturacaksınız:

Özel tabloya alım için DCR kaynakları oluşturma

Verileri özel bir tabloya almak için şu adımları izleyin (REST API kullanarak günlükleri izleme Azure veri gönderme (Azure portal) öğreticisine göre):

Önkoşulları gözden geçirin.

Önceki bölümde oluşturduğunuz örnek dosyayı kullanarak örnek verileri ayrıştırın ve filtreleyin.

-

Örnek veri gönder adımını atlayın.

Herhangi bir sorunla karşılaşırsanız sorun giderme adımlarına bakın.

Standart tabloya alım için DCR kaynakları oluşturma

Verileri Syslog veya CommonSecurityLog gibi standart bir tabloya almak için REST API (Resource Manager şablonları) kullanarak Günlükleri İzleme Azure için veri gönderme öğreticisini temel alan bir işlem kullanırsınız. Öğreticide verilerin özel bir tabloya nasıl alınabileceği açıklanırken, verileri standart bir tabloya almak için işlemi kolayca ayarlayabilirsiniz. Aşağıdaki adımlar, adımlardaki ilgili değişiklikleri gösterir.

Önkoşulları gözden geçirin.

-

Log Analytics çalışma alanında yeni tablo oluştur adımını atlayın. Bu adım standart bir tabloya veri alırken geçerli değildir çünkü tablo Log Analytics'te zaten tanımlanmıştır.

DCR'yi oluşturun. Bu adımda:

- Önceki bölümde oluşturduğunuz örnek dosyayı sağlayın.

- Özelliğini tanımlamak

streamDeclarationsiçin oluşturduğunuz örnek dosyayı kullanın. Örnek dosyadaki alanların her biri, aynı ada ve uygun türe sahip karşılık gelen bir sütuna sahip olmalıdır (aşağıdaki örne bakın). - özelliğinin

outputStreamdeğerini özel tablo yerine standart tablonun adıyla yapılandırın. Özel tablolardan farklı olarak, standart tablo adlarında sonek yoktur_CL. - Tablo adının ön eki yerine

Custom-olmalıdırMicrosoft-. ÖrneğimizdeoutputStreamözellik değeri şeklindedirMicrosoft-Syslog.

-

Örnek veri gönder adımını atlayın.

Herhangi bir sorunla karşılaşırsanız sorun giderme adımlarına bakın.

Örnek: Syslog tablosuna veri alan DCR

Aşağıdakilere dikkat edin:

-

streamDeclarationsSütun adları ve türleri örnek dosya alanlarıyla aynı olmalıdır, ancak bunların tümünü belirtmeniz gerekmez. Örneğin, aşağıdakiPRIDCR'de vetypels_versionalanları sütundanstreamDeclarationsatlanır. -

dataflowsözelliği girişi Syslog tablo biçimine dönüştürür ve olarakoutputStreamMicrosoft-Syslogayarlar.

{

"$schema": "https://schema.management.azure.com/schemas/2019-04-01/deploymentTemplate.json#",

"contentVersion": "1.0.0.0",

"parameters": {

"dataCollectionRuleName": {

"type": "String",

"metadata": {

"description": "Specifies the name of the Data Collection Rule to create."

}

},

"location": {

"defaultValue": "westus2",

"allowedValues": [

"westus2",

"eastus2",

"eastus2euap"

],

"type": "String",

"metadata": {

"description": "Specifies the location in which to create the Data Collection Rule."

}

},

"location": {

"defaultValue": "[resourceGroup().location]",

"type": "String",

"metadata": {

"description": "Specifies the location in which to create the Data Collection Rule."

}

},

"workspaceResourceId": {

"type": "String",

"metadata": {

"description": "Specifies the Azure resource ID of the Log Analytics workspace to use."

}

}

},

"resources": [

{

"type": "Microsoft.Insights/dataCollectionRules",

"apiVersion": "2021-09-01-preview",

"name": "[parameters('dataCollectionRuleName')]",

"location": "[parameters('location')]",

"properties": {

"streamDeclarations": {

"Custom-SyslogStream": {

"columns": [

{

"name": "ls_timestamp",

"type": "datetime"

}, {

"name": "timestamp",

"type": "datetime"

},

{

"name": "message",

"type": "string"

},

{

"name": "facility_label",

"type": "string"

},

{

"name": "severity_label",

"type": "string"

},

{

"name": "host",

"type": "string"

},

{

"name": "logsource",

"type": "string"

}

]

}

},

"destinations": {

"logAnalytics": [

{

"workspaceResourceId": "[parameters('workspaceResourceId')]",

"name": "clv2ws1"

}

]

},

"dataFlows": [

{

"streams": [

"Custom-SyslogStream"

],

"destinations": [

"clv2ws1"

],

"transformKql": "source | project TimeGenerated = ls_timestamp, EventTime = todatetime(timestamp), Computer = logsource, HostName = logsource, HostIP = host, SyslogMessage = message, Facility = facility_label, SeverityLevel = severity_label",

"outputStream": "Microsoft-Syslog"

}

]

}

}

],

"outputs": {

"dataCollectionRuleId": {

"type": "String",

"value": "[resourceId('Microsoft.Insights/dataCollectionRules', parameters('dataCollectionRuleName'))]"

}

}

}

Logstash yapılandırma dosyasını yapılandırma

Logstash yapılandırma dosyasını günlükleri özel bir tabloya alacak şekilde yapılandırmak için şu değerleri alın:

| Alan | Alma |

|---|---|

client_app_Id |

Application (client) ID Bu bölümde kullandığınız öğreticiye göre DCR kaynaklarını oluştururken 3. adımda oluşturduğunuz değer. |

client_app_secret |

Application (client) ID Bu bölümde kullandığınız öğreticiye göre DCR kaynaklarını oluştururken 5. adımda oluşturduğunuz değer. |

tenant_id |

Aboneliğinizin kiracı kimliği. Kiracı kimliğini Giriş > Microsoft Entra ID > Genel Bakış > Temel Bilgileri altında bulabilirsiniz. |

data_collection_endpoint |

Bu bölümde kullandığınız öğreticiye logsIngestion göre DCR kaynaklarını oluştururken 3. adımdaki URI'nin değeri. |

dcr_immutable_id |

Bu bölümde kullandığınız öğreticiye göre DCR immutableIdkaynaklarını oluştururken 6. adımda DCR'nin değeri. |

dcr_stream_name |

DCR kaynaklarını oluştururken 6. adımda açıklandığı gibi özel tablolar için DCR'nin JSON görünümüne gidin ve özelliğini kopyalayındataFlows>streams. Aşağıdaki örnekteki bölümüne dcr_stream_name bakın.Standart tablolar için değeri olur Custom-SyslogStream. |

Gerekli değerleri aldıktan sonra:

- Önceki adımda oluşturduğunuz Logstash yapılandırma dosyasının çıkış bölümünü aşağıdaki örnekle değiştirin.

- Aşağıdaki örnekte yer tutucu dizelerini aldığınız değerlerle değiştirin.

- özniteliğini olarak

falsedeğiştirdiğinizdencreate_sample_fileemin olun.

İsteğe bağlı yapılandırma

| Alan | Açıklama | Varsayılan değer |

|---|---|---|

azure_cloud |

Kullanılan Azure bulutunun adını belirtmek için kullanılır, Kullanılabilir değerler şunlardır: AzureCloud, AzureChinaCloudve AzureUSGovernment. |

AzureCloud |

key_names |

Dize dizisi. Sütunların bir alt kümesini Log Analytics'e göndermek istiyorsanız bu alanı belirtin. | Yok (alan boş) |

plugin_flush_interval |

Log Analytics'e iki ileti gönderme arasındaki en büyük zaman farkını (saniye olarak) tanımlar. | 5 |

retransmission_time |

İleti gönderme başarısız olduğunda iletilerin yeniden iletilme süresini saniye olarak ayarlar. | 10 |

compress_data |

Bu alan olduğunda True, olay verileri API'yi kullanmadan önce sıkıştırılır. Yüksek aktarım hızı işlem hatları için önerilir. |

False |

proxy |

Tüm API çağrıları için kullanılacak proxy URL'sini belirtin. | Yok (alan boş) |

proxy_aad |

Microsoft Entra ID API çağrıları için kullanılacak proxy URL'sini belirtin. | 'proxy' ile aynı değer (alan boş) |

proxy_endpoint |

Veri Toplama Uç Noktasına API çağrıları için kullanılacak proxy URL'sini belirtin. | 'proxy' ile aynı değer (alan boş) |

Örnek: Çıkış eklentisi yapılandırma bölümü

output {

microsoft-sentinel-log-analytics-logstash-output-plugin {

client_app_Id => "<enter your client_app_id value here>"

client_app_secret => "<enter your client_app_secret value here>"

tenant_id => "<enter your tenant id here> "

data_collection_endpoint => "<enter your logsIngestion URI here> "

dcr_immutable_id => "<enter your DCR immutableId here> "

dcr_stream_name => "<enter your stream name here> "

create_sample_file=> false

sample_file_path => "c:\\temp"

proxy => "http://proxy.example.com"

}

}

Microsoft Sentinel Logstash çıkış eklentisinin diğer parametrelerini ayarlamak için çıkış eklentisinin benioku dosyasına bakın.

Not

Güvenlik nedenleriyle Logstash yapılandırma dosyanızda , client_app_secret, tenant_id, data_collection_endpointve dcr_immutable_id özniteliklerini örtük olarak belirtmenizi client_app_Idöneririz. Bu hassas bilgileri Logstash KeyStore'da depolamanızı öneririz.

Logstash'i yeniden başlatma

Güncelleştirilmiş çıkış eklentisi yapılandırmasıyla Logstash'i yeniden başlatın ve DCR yapılandırmanıza göre verilerin doğru tabloya alındığını görün.

Gelen günlükleri Microsoft Sentinel'de görüntüleme

İletilerin çıkış eklentisine gönderildiğini doğrulayın.

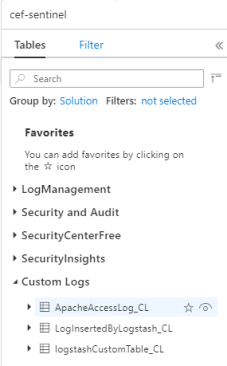

Microsoft Sentinel gezinti menüsünde Günlükler'e tıklayın. Tablolar başlığı altında Özel Günlükler kategorisini genişletin. Yapılandırmada belirttiğiniz tablonun adını (sonekle

_CL) bulun ve tıklayın.

Tablodaki kayıtları görmek için, şema olarak tablo adını kullanarak tabloyu sorgulayın.

Çıkış eklentisi denetim günlüklerini izleme

Microsoft Sentinel çıktı eklentisinin bağlantısını ve etkinliğini izlemek için uygun Logstash günlük dosyasını etkinleştirin. Günlük dosyası konumu için Logstash Dizin Düzeni belgesine bakın.

Bu günlük dosyasında veri görmüyorsanız, çıkış eklentisinin veri aldığından emin olmak için yerel olarak (giriş ve filtre eklentileri aracılığıyla) bazı olayları oluşturun ve gönderin. Microsoft Sentinel yalnızca çıkış eklentisiyle ilgili sorunları destekler.

Ağ güvenliği

Microsoft Sentinel Logstash çıkış eklentisi için ağ ayarlarını tanımlayın ve ağ yalıtımını etkinleştirin.

Sanal ağ hizmeti etiketleri

Microsoft Sentinel çıktı eklentisi Azure sanal ağ hizmeti etiketlerini destekler. Hem AzureMonitor hem de AzureActiveDirectory etiketleri gereklidir.

Azure Sanal Ağ hizmet etiketleri, ağ güvenlik grupları, Azure Güvenlik Duvarı ve kullanıcı tanımlı yollarda ağ erişim denetimlerini tanımlamak için kullanılabilir. Güvenlik kuralları ve yolları oluştururken belirli IP adreslerinin yerine hizmet etiketlerini kullanın. Azure Sanal Ağ hizmet etiketlerinin kullanılamadığı senaryolar için güvenlik duvarı gereksinimleri aşağıda verilmiştir.

Güvenlik duvarı gereksinimleri

Aşağıdaki tabloda Azure sanal ağ hizmet etiketlerinin kullanılamadığı senaryolar için güvenlik duvarı gereksinimleri listelemektedir.

| Bulut | Uç nokta | Amaç | Bağlantı noktası | Yön | HTTPS denetlemesi atlaması |

|---|---|---|---|---|---|

| ticari Azure | https://login.microsoftonline.com | Yetkilendirme sunucusu (Microsoft kimlik platformu) | Bağlantı Noktası 443 | Giden | Evet |

| ticari Azure | https://<data collection endpoint name>.<Azure cloud region>.ingest.monitor.azure.com |

Veri toplama Uç Noktası | Bağlantı Noktası 443 | Giden | Evet |

| Azure Kamu | https://login.microsoftonline.us | Yetkilendirme sunucusu (Microsoft kimlik platformu) | Bağlantı Noktası 443 | Giden | Evet |

| Azure Kamu | Yukarıdaki '.com' yerine '.us' ifadesini kullanın | Veri toplama Uç Noktası | Bağlantı Noktası 443 | Giden | Evet |

| 21Vianet tarafından sağlanan Microsoft Azure | https://login.chinacloudapi.cn | Yetkilendirme sunucusu (Microsoft kimlik platformu) | Bağlantı Noktası 443 | Giden | Evet |

| 21Vianet tarafından sağlanan Microsoft Azure | Yukarıdaki '.com' yerine '.cn' ifadesini kullanın | Veri toplama Uç Noktası | Bağlantı Noktası 443 | Giden | Evet |

Eklenti sürümleri

1.1.3

-

rest-clientAzure'a bağlanmak için kullanılan kitaplığı kitaplıklaexcondeğiştirir.

1.1.1

- Çin'de 21Vianet tarafından sağlanan Azure ABD Kamu bulutu ve Microsoft Azure için destek ekler.

1.1.0

- API bağlantıları için farklı ara sunucu değerlerinin ayarlanmasına izin verir.

- Günlük alımı API'sini 2023-01-01 sürümüne yükselter.

- Eklentiyi microsoft-sentinel-log-analytics-logstash-output-plugin olarak yeniden adlandırır.

1.0.0

- Microsoft Sentinel için Logstash çıkış eklentisinin ilk sürümü. Bu eklenti, Azure İzleyici'nin Günlük Alımı API'siyle Veri Toplama Kurallarını (DCR) kullanır.

Bilinen sorunlar

Lite Ubuntu'nun Docker görüntüsünde yüklü Logstash kullanırken aşağıdaki uyarı görüntülenebilir:

java.lang.RuntimeException: getprotobyname_r failed

Bunu çözmek için aşağıdaki komutları kullanarak Dockerfile'ınıza netbase paketini yükleyin:

USER root

RUN apt install netbase -y

Daha fazla bilgi için bkz . Logstash 7.17.0 (Docker)'da JNR regresyonu.

Ayrılan Logstash çalışanlarının sayısı dikkate alındığında ortamınızın olay oranı düşükse , plugin_flush_interval değerini 60 veya daha fazla değere yükseltmenizi öneririz. Bu değişiklik, her çalışanın Veri Toplama Uç Noktasına (DCE) yüklemeden önce daha fazla olay toplu işlemine izin verir. DCR ölçümlerini kullanarak alım yükünü izleyebilirsiniz. plugin_flush_interval hakkında daha fazla bilgi için daha önce bahsedilen İsteğe Bağlı Yapılandırma tablosuna bakın.

Sınırlamalar

- Standart tablolara alım yalnızca özel günlük alımı için desteklenen standart tablolarla sınırlıdır.

- özelliğindeki giriş akışının

streamDeclarationssütunları bir harfle başlamalıdır. Bir sütunu başka karakterlerle (örneğin@veya_) başlatırsanız işlem başarısız olur. -

TimeGeneratedTarih saat alanı gereklidir. Bu alanı KQL dönüşümüne eklemeniz gerekir. - Diğer olası sorunlar için öğreticideki sorun giderme bölümünü gözden geçirin.

Sonraki adımlar

Bu makalede, dış veri kaynaklarını Microsoft Sentinel bağlamak için Logstash'i kullanmayı öğrendinsiniz. Microsoft Sentinel hakkında daha fazla bilgi edinmek için aşağıdaki makalelere bakın: