Öğretici: Synapse çalışma alanını kullanarak IntelliJ ile Apache Spark uygulaması oluşturma

Bu öğreticide, Scala'da yazılmış Apache Spark uygulamaları geliştirmek ve bunları doğrudan IntelliJ tümleşik geliştirme ortamından (IDE) sunucusuz bir Apache Spark havuzuna göndermek için IntelliJ için Azure Toolkit eklentisinin nasıl kullanılacağı gösterilmektedir. Eklentiyi birkaç şekilde kullanabilirsiniz:

- Spark havuzunda Scala Spark uygulaması geliştirin ve gönderin.

- Spark havuzlarınızın kaynaklarına erişin.

- Scala Spark uygulamasını yerel olarak geliştirin ve çalıştırın.

Bu öğreticide aşağıdakilerin nasıl yapılacağını öğreneceksiniz:

- Azure Toolkit for IntelliJ eklentisini kullanma

- Apache Spark uygulamaları geliştirme

- Spark havuzlarına uygulama gönderme

Önkoşullar

Azure araç seti eklentisi 3.27.0-2019.2 – IntelliJ Eklentisi deposundan yükleme

Aşağıdaki önkoşul yalnızca Windows kullanıcıları için geçerlidir:

Yerel Spark Scala uygulamasını bir Windows bilgisayarda çalıştırırken SPARK-2356'da açıklandığı gibi bir özel durum alabilirsiniz. Windows'ta WinUtils.exe eksik olduğundan özel durum oluşur. Bu hatayı çözmek için WinUtils yürütülebilir dosyasını C:\WinUtils\bin gibi bir konuma indirin. Ardından HADOOP_HOME ortam değişkenini ekleyin ve değişkenin değerini C:\WinUtils olarak ayarlayın.

Spark havuzu için Spark Scala uygulaması oluşturma

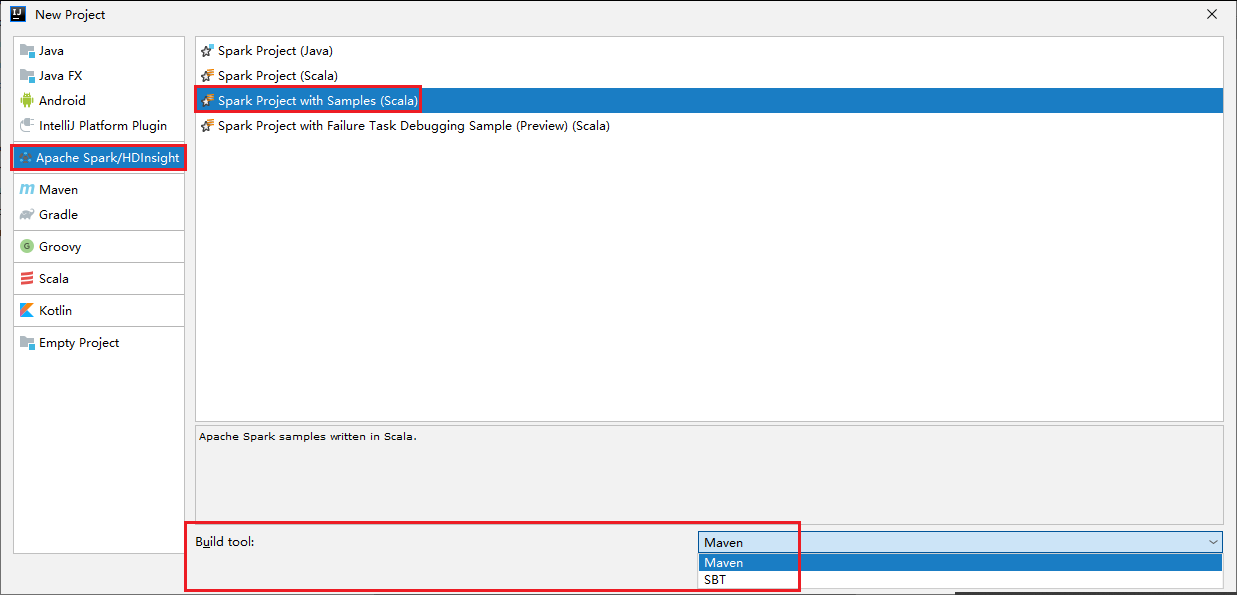

IntelliJ IDEA'yı başlatın ve Yeni Proje Oluştur'u seçerek Yeni Proje penceresini açın.

Sol bölmeden Apache Spark/HDInsight'ı seçin.

Ana pencerede Örneklerle Spark Projesi(Scala) seçeneğini belirleyin.

Derleme aracı açılan listesinden aşağıdaki türlerden birini seçin:

- Scala için Maven proje oluşturma sihirbazı desteği.

- Scala projesi için bağımlılıkları yönetmeye ve oluşturmaya yönelik SBT .

İleri'yi seçin.

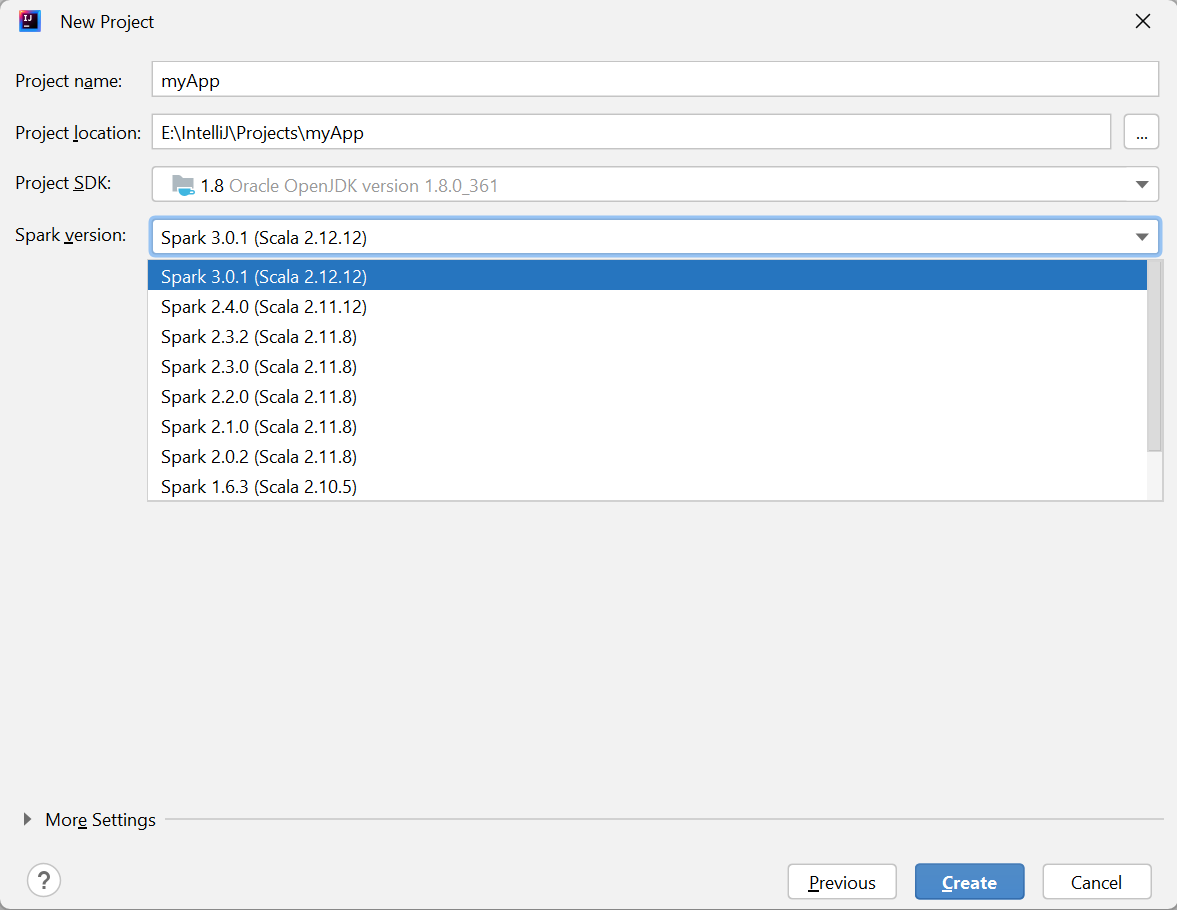

Yeni Proje penceresinde aşağıdaki bilgileri sağlayın:

Özellik Açıklama Proje adı Bir ad girin. Bu öğreticide myAppkullanılır.Proje konumu Projenizi kaydetmek için istenen konumu girin. Proje SDK'sı IDEA'nın ilk kullanımında boş olabilir. Yeni... öğesini seçin ve JDK'nize gidin. Spark Sürümü Oluşturma sihirbazı, Spark SDK ve Scala SDK'sı için uygun sürümü tümleştirir. Burada ihtiyacınız olan Spark sürümünü seçebilirsiniz.

Bitir'i seçin. Projenin kullanılabilir duruma gelmesi birkaç dakika sürebilir.

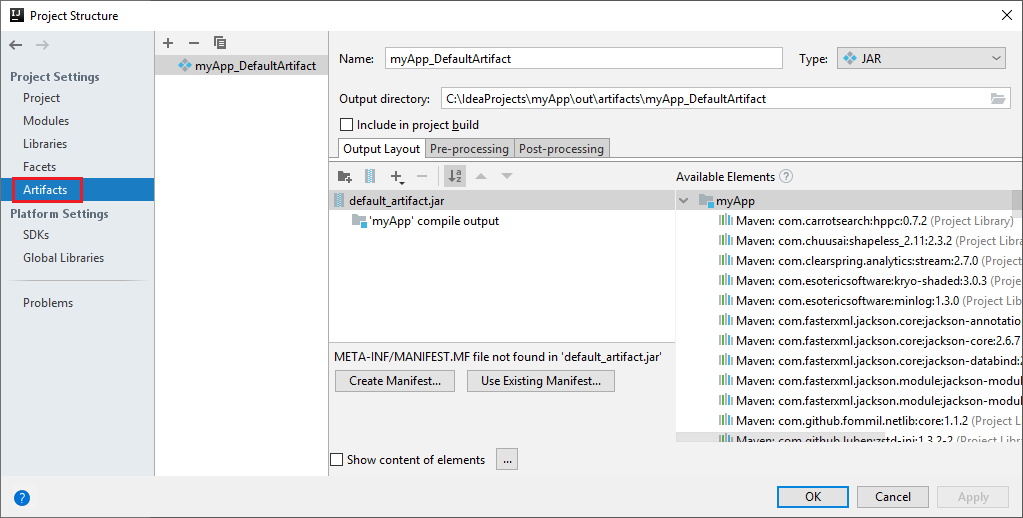

Spark projesi sizin için otomatik olarak bir yapıt oluşturur. Yapıtı görüntülemek için aşağıdaki işlemi yapın:

a. Menü çubuğundan Dosya>Proje Yapısı.... seçeneğine gidin.

b. Proje Yapısı penceresinde Yapıtlar'ı seçin.

c. Yapıtı görüntüledikten sonra İptal'i seçin.

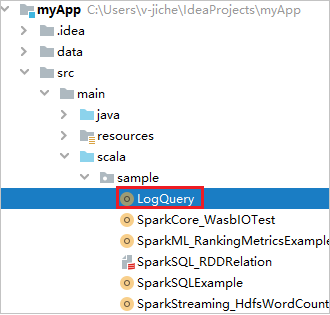

MyApp>src>main>scala>örnek>LogQuery'den LogQuery'yi bulun. Bu öğreticide çalıştırmak için LogQuery kullanılır.

Spark havuzlarınıza Bağlan

Spark havuzlarınıza bağlanmak için Azure aboneliğinde oturum açın.

Azure aboneliğinizde oturum açın

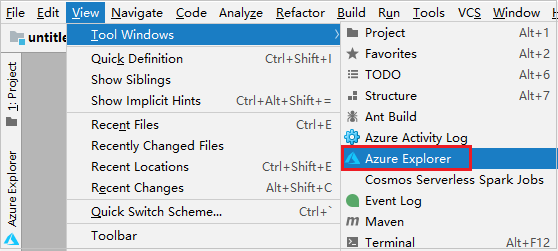

Menü çubuğundan Görünüm>Aracı Windows>Azure Gezgini'ne gidin.

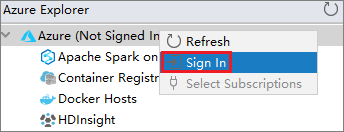

Azure Gezgini'nde Azure düğümüne sağ tıklayıp Oturum Aç'ı seçin.

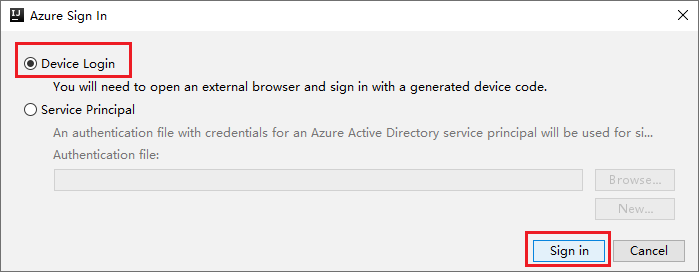

Azure Oturum Aç iletişim kutusunda Cihaz Oturum Açma'yı ve ardından Oturum aç'ı seçin.

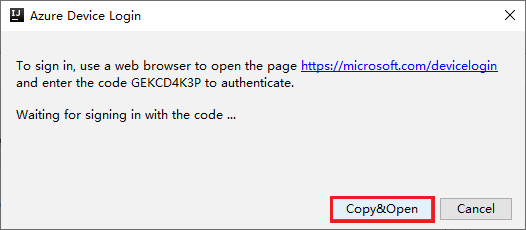

Azure Cihaz Oturum Açma iletişim kutusunda Kopyala ve Aç'ı seçin.

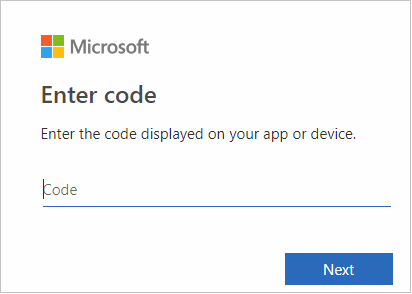

Tarayıcı arabiriminde kodu yapıştırın ve İleri'yi seçin.

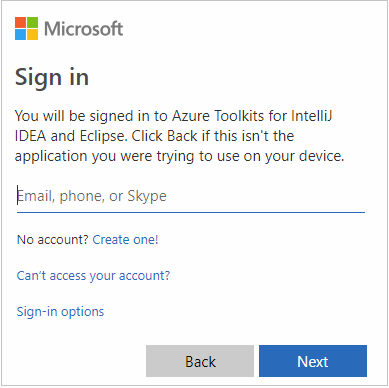

Azure kimlik bilgilerinizi girin ve tarayıcıyı kapatın.

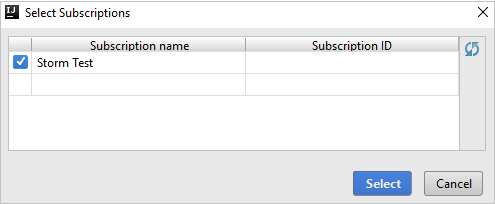

Oturum açtıktan sonra Abonelikleri Seç iletişim kutusunda, kimlik bilgileriyle ilişkili tüm Azure abonelikleri listelenir. Aboneliğinizi ve ardından Seç'i seçin.

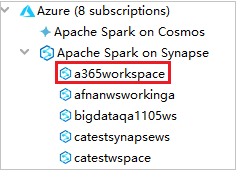

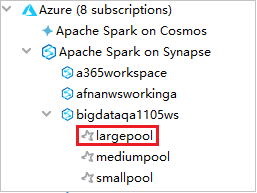

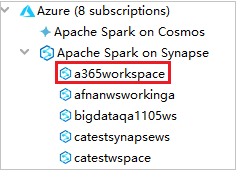

Azure Gezgini'nde Synapse üzerinde Apache Spark'ı genişleterek aboneliklerinizdeki Çalışma Alanlarını görüntüleyin.

Spark havuzlarını görüntülemek için çalışma alanını daha da genişletebilirsiniz.

Spark havuzunda Spark Scala uygulamasını uzaktan çalıştırma

Scala uygulamasını oluşturduktan sonra uzaktan çalıştırabilirsiniz.

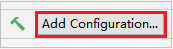

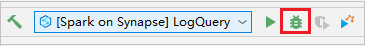

Simgeyi seçerek Çalıştırma/Yapılandırmalarda Hata Ayıklama penceresini açın.

Yapılandırmaları Çalıştır/Hatalarını Ayıkla iletişim penceresinde öğesini ve +ardından Synapse'te Apache Spark'ı seçin.

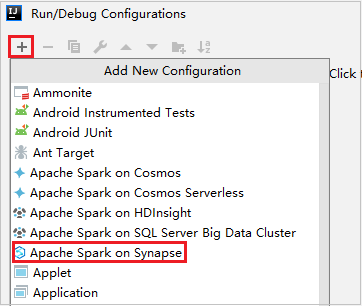

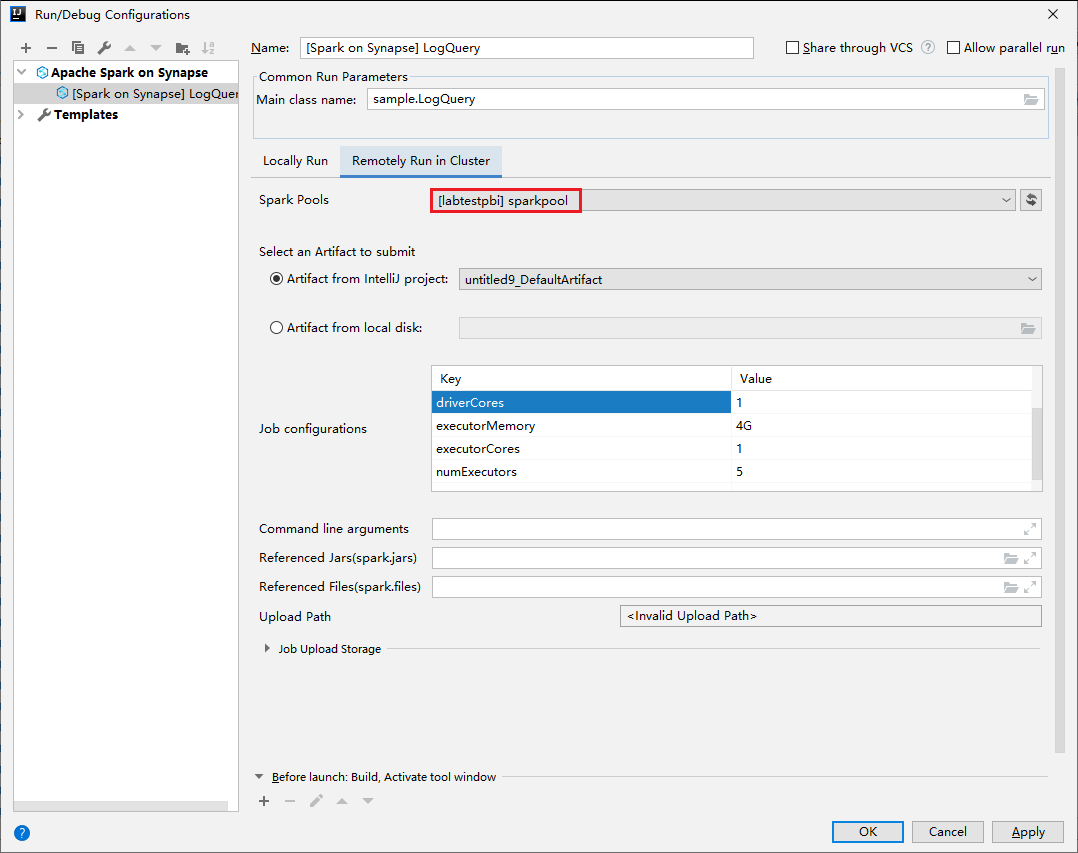

Çalıştırma/Hata Ayıklama Yapılandırmaları penceresinde aşağıdaki değerleri sağlayın ve tamam'ı seçin:

Özellik Değer Spark havuzları Uygulamanızı çalıştırmak istediğiniz Spark havuzlarını seçin. Göndermek için bir Yapıt seçin Varsayılan ayarı değiştirmeyin. Ana sınıf adı Varsayılan değer, seçili dosyadaki ana sınıftır. Üç noktayı (...) ve başka bir sınıfı seçerek sınıfı değiştirebilirsiniz. İş yapılandırmaları Varsayılan anahtarı ve değerleri değiştirebilirsiniz. Daha fazla bilgi için bkz . Apache Livy REST API. Komut satırı bağımsız değişkenleri Gerekirse, ana sınıf için boşlukla ayrılmış bağımsız değişkenler girebilirsiniz. Başvuruda Belirtilen Jar'lar ve Başvurulan Dosyalar Başvuruda bulunan Jar'ların ve varsa dosyaların yollarını girebilirsiniz. Şu anda yalnızca ADLS 2. Nesil kümesini destekleyen Azure sanal dosya sistemindeki dosyalara da göz atabilirsiniz. Daha fazla bilgi için: Apache Spark Yapılandırması ve Kaynakları kümeye yükleme. İş Yükleme Depolama Ek seçenekleri göstermek için genişletin. Depolama Türü Açılan listeden Karşıya yüklemek için Azure Blobunu kullan'ı veya Karşıya yüklemek için küme varsayılan depolama hesabını kullan'ı seçin. Depolama Hesabı Depolama hesabınızı girin. Depolama Anahtarı Depolama anahtarınızı girin. kapsayıcıyı Depolama Hesap ve Depolama Depolama Anahtarı girildikten sonra açılan listeden depolama kapsayıcınızı seçin.

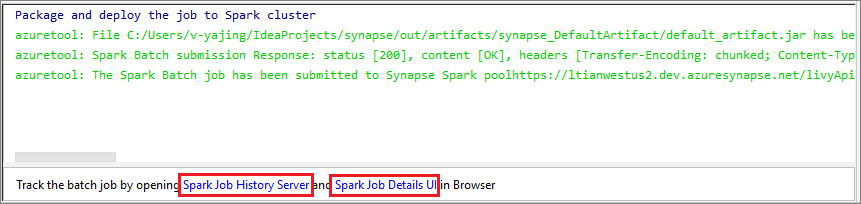

Projenizi seçili Spark havuzuna göndermek için SparkJobRun simgesini seçin. Kümedeki Uzak Spark İşi sekmesi, iş yürütme ilerleme durumunu en altta görüntüler. Kırmızı düğmeyi seçerek uygulamayı durdurabilirsiniz.

Yerel Çalıştırma/Apache Spark uygulamalarında hata ayıklama

Apache Spark işiniz için yerel çalıştırmanızı ve yerel hata ayıklamanızı ayarlamak için aşağıdaki yönergeleri izleyebilirsiniz.

Senaryo 1: Yerel çalıştırma

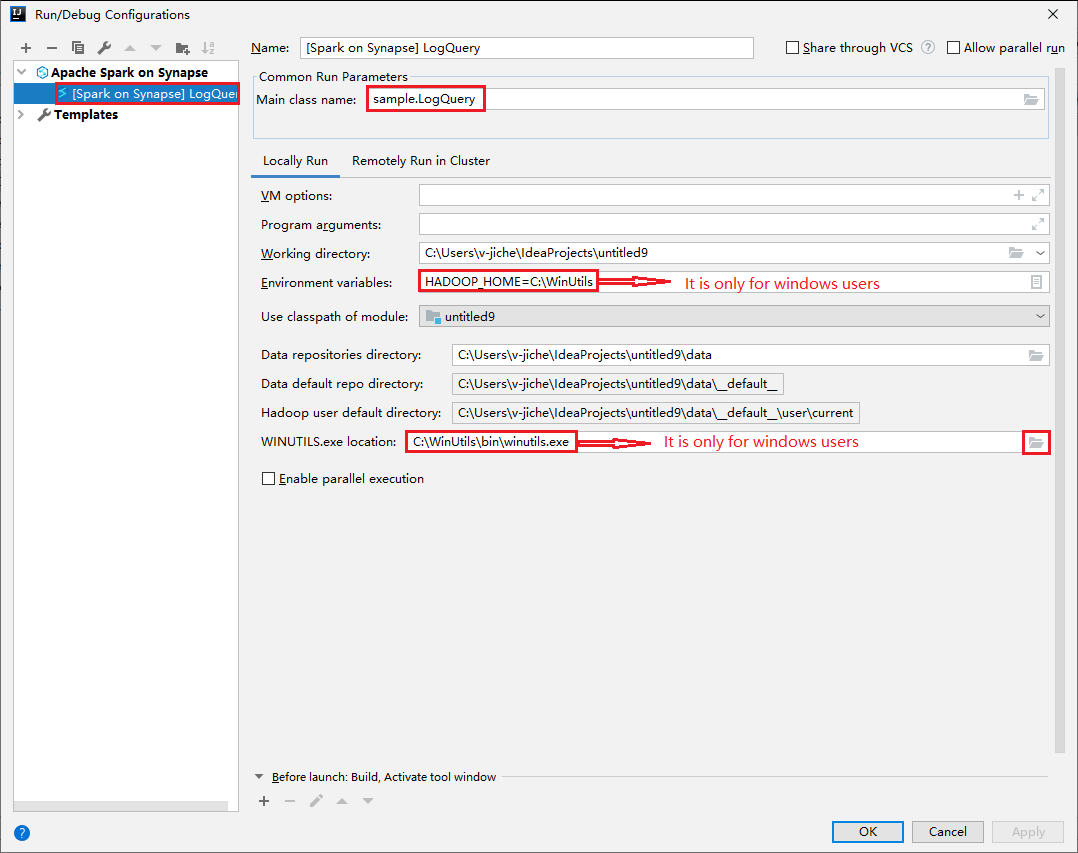

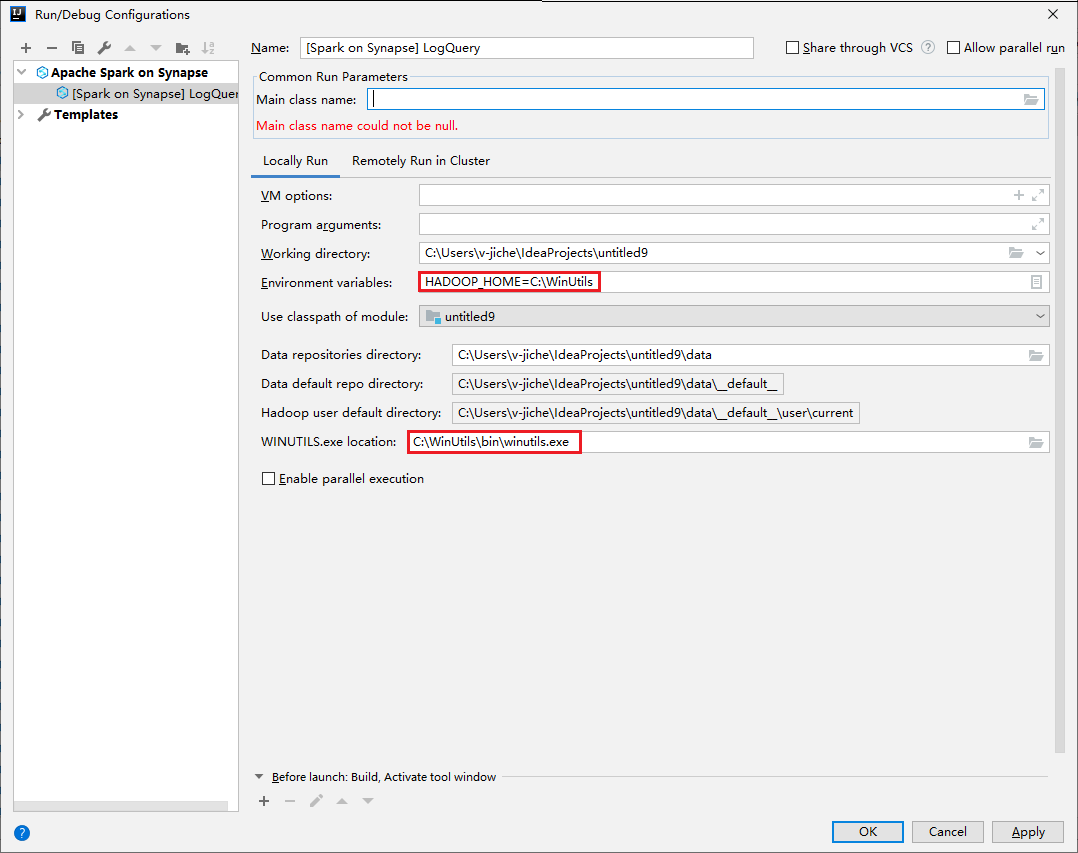

Çalıştır/Yapılandırmalarda Hata Ayıkla iletişim kutusunu açın, artı işaretini ()+ seçin. Ardından Synapse üzerinde Apache Spark seçeneğini belirleyin. Kaydedilecek Ad, Ana sınıf adı bilgilerini girin.

- Ortam değişkenleri ve WinUtils.exe Konumu yalnızca Windows kullanıcıları içindir.

- Ortam değişkenleri: Sistem ortam değişkeni daha önce ayarladıysanız ve el ile eklemeniz gerekmiyorsa otomatik olarak algılanabilir.

- WinUtils.exe Konumu: Sağ taraftaki klasör simgesini seçerek WinUtils konumunu belirtebilirsiniz.

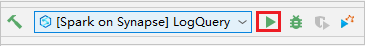

Ardından yerel oynat düğmesini seçin.

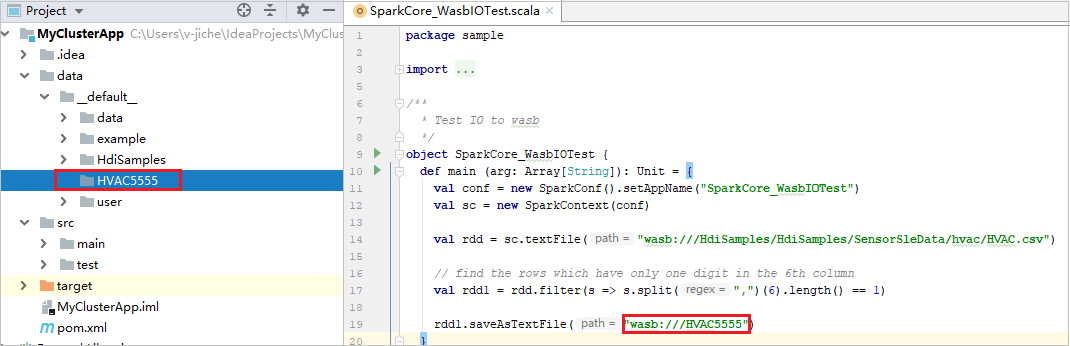

Yerel çalıştırma tamamlandıktan sonra betik çıktı içeriyorsa, çıktı dosyasını varsayılan verilerden> de kontrol edebilirsiniz.

Senaryo 2: Yerel hata ayıklama yapma

LogQuery betiğini açın, kesme noktalarını ayarlayın.

Yerel hata ayıklama yapmak için Yerel hata ayıklama simgesini seçin.

Synapse Çalışma Alanına erişme ve yönetme

Azure Gezgini'nde Azure Toolkit for IntelliJ içinde farklı işlemler gerçekleştirebilirsiniz. Menü çubuğundan Görünüm>Aracı Windows>Azure Gezgini'ne gidin.

Çalışma alanını başlatın

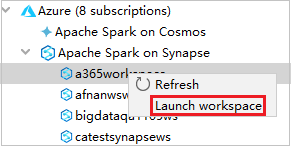

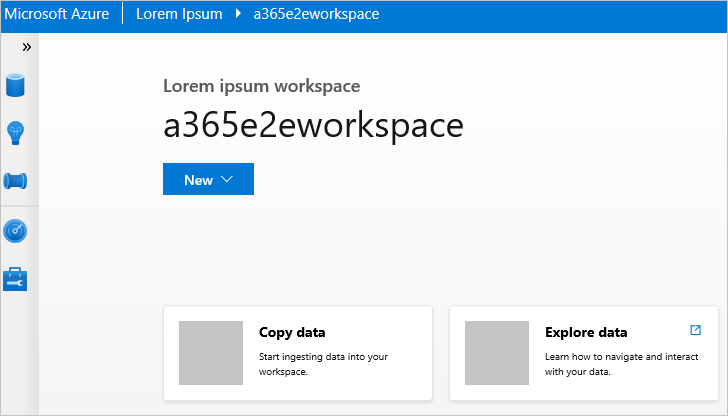

Azure Gezgini'nden Synapse'te Apache Spark'a gidin ve genişletin.

Bir çalışma alanına sağ tıklayın, ardından Çalışma alanını başlat'ı seçin; web sitesi açılır.

Spark konsolu

Spark Yerel Konsolu'nu (Scala) veya Spark Livy Etkileşimli Oturum Konsolu'nu (Scala) çalıştırabilirsiniz.

Spark yerel konsolu (Scala)

WINUTILS.EXE önkoşulunu karşıladığınızdan emin olun.

Menü çubuğundan Yapılandırmaları Düzenle... komutunu çalıştırın>.

Çalıştırma/Hata Ayıklama Yapılandırmaları penceresinde, sol bölmede Synapse[Synapse> üzerinde Spark] myApp üzerinde Apache Spark'a gidin.

Ana pencerede Yerel Olarak Çalıştır sekmesini seçin.

Aşağıdaki değerleri sağlayın ve tamam'ı seçin:

Özellik Değer Ortam değişkenleri HADOOP_HOME değerinin doğru olduğundan emin olun. WINUTILS.exe konumu Yolun doğru olduğundan emin olun.

Project'ten myApp>src>main>scala myApp konumuna>gidin.

Menü çubuğundan Araçlar>Spark konsolu Spark Yerel Konsolunu>Çalıştır (Scala) seçeneğine gidin.

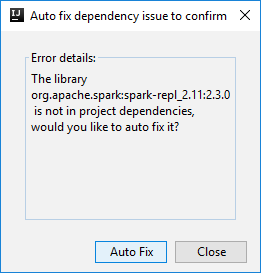

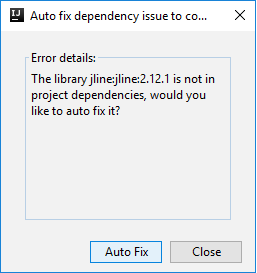

Ardından, bağımlılıkları otomatik olarak düzeltmek isteyip istemediğinizi sormak için iki iletişim kutusu görüntülenebilir. Öyleyse, Otomatik Düzeltme'yi seçin.

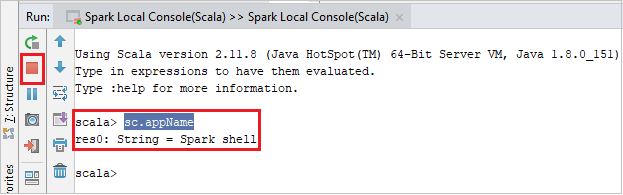

Konsol aşağıdaki resme benzer görünmelidir. Konsol penceresine yazın

sc.appNameve ardından ctrl+Enter tuşlarına basın. Sonuç gösterilir. Kırmızı düğmeyi seçerek yerel konsolu durdurabilirsiniz.

Spark Livy etkileşimli oturum konsolu (Scala)

Yalnızca IntelliJ 2018.2 ve 2018.3'te desteklenir.

Menü çubuğundan Yapılandırmaları Düzenle... komutunu çalıştırın>.

Çalıştırma/Hata Ayıklama Yapılandırmaları penceresinde, sol bölmede synapse[Synapse> üzerinde Spark] myApp üzerinde Apache Spark'a gidin.

Ana pencerede Kümede Uzaktan Çalıştır sekmesini seçin.

Aşağıdaki değerleri sağlayın ve tamam'ı seçin:

Özellik Değer Ana sınıf adı Ana sınıf adını seçin. Spark havuzları Uygulamanızı çalıştırmak istediğiniz Spark havuzlarını seçin.

Project'ten myApp>src>main>scala myApp konumuna>gidin.

Menü çubuğundan Araçlar>Spark konsolu>Spark Livy Etkileşimli Oturum Konsolu'nu (Scala) çalıştır'a gidin.

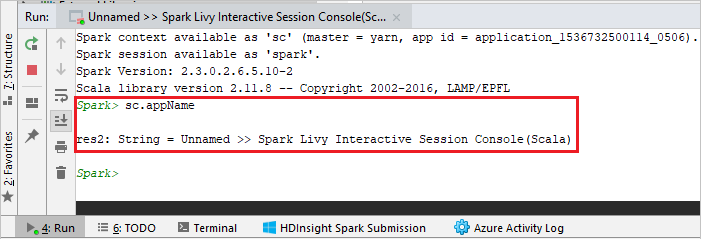

Konsol aşağıdaki resme benzer görünmelidir. Konsol penceresine yazın

sc.appNameve ardından ctrl+Enter tuşlarına basın. Sonuç gösterilir. Kırmızı düğmeyi seçerek yerel konsolu durdurabilirsiniz.

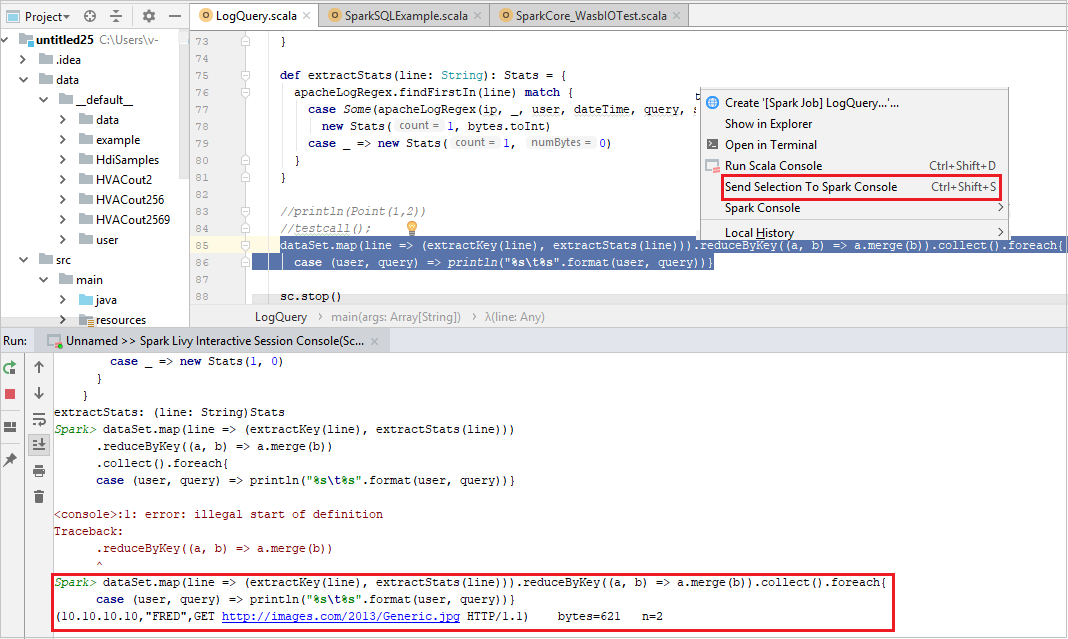

Seçimi Spark konsoluna gönder

Yerel konsola veya Livy Interactive Session Console'a (Scala) kod göndererek betik sonucunu görmek isteyebilirsiniz. Bunu yapmak için Scala dosyasındaki bazı kodları vurgulayabilir ve ardından Seçimi Spark konsoluna Gönder'e sağ tıklayabilirsiniz. Seçilen kod konsola gönderilir ve tamamlanır. Sonuç, konsoldaki koddan sonra görüntülenir. Konsol mevcut hataları denetler.

Sonraki adımlar

Geri Bildirim

Çok yakında: 2024 boyunca, içerik için geri bildirim mekanizması olarak GitHub Sorunları’nı kullanımdan kaldıracak ve yeni bir geri bildirim sistemiyle değiştireceğiz. Daha fazla bilgi için bkz. https://aka.ms/ContentUserFeedback.

Gönderin ve geri bildirimi görüntüleyin