AI 应用模板

本文档的这一部分介绍了 AI 应用模板 和相关文章,这些模板使用这些模板演示了如何执行关键开发人员任务。 AI 应用模板为你提供了维护良好、易于部署的参考实现,可帮助确保 AI 应用有一个高质量的起点。

AI 应用模板有两类, 构建基块 和 端到端解决方案。 以下部分介绍本文顶部所选编程语言的每个类别中的一些关键模板。 若要浏览包括这些模板和其他模板在内的更全面的列表,请参阅 Azure 开发人员 CLI 库中的 AI 应用模板。

构建基块

构建基块是较小的示例,侧重于特定方案和任务。 大多数构建基块演示 了对使用你自己的数据的聊天应用的端到端解决方案 的功能。

| 构建基块 | 说明 |

|---|---|

| 使用 Azure 容器应用进行负载均衡 | 了解如何向应用程序添加负载均衡,以将聊天应用扩展到 Azure OpenAI 令牌和模型配额限制之外。 此方法使用 Azure 容器应用创建三个 Azure OpenAI 终结点以及一个主容器,将传入流量定向到三个终结点中的一个。 |

| 构建基块 | 说明 |

|---|---|

| 为聊天应用配置文档安全性 | 将 RAG 模式与自己的数据一起使用生成聊天应用程序时,请确保每个用户根据其权限接收答案。 授权用户应有权访问聊天应用文档中包含的答案。 未经授权的用户不应有权从他们无权查看的安全文档访问答案。 |

| 评估聊天应用答案 | 了解如何根据一组正确或理想的答案(称为地面真相)评估聊天应用的答案。 每当以影响答案的方式更改聊天应用程序时,请运行评估以比较更改。 此演示应用程序提供目前可以使用的工具,以便更轻松地运行评估。 |

| 使用 Azure 容器应用进行负载均衡 | 了解如何向应用程序添加负载均衡,以将聊天应用扩展到 Azure OpenAI 令牌和模型配额限制之外。 此方法使用 Azure 容器应用创建三个 Azure OpenAI 终结点以及一个主容器,将传入流量定向到三个终结点中的一个。 |

| 使用 API 管理 进行负载均衡 | 了解如何向应用程序添加负载均衡,以将聊天应用扩展到 Azure OpenAI 令牌和模型配额限制之外。 此方法使用 Azure API 管理创建三个 Azure OpenAI 终结点,以及一个主容器,用于将传入流量定向到三个终结点之一。 |

| 使用 Locust 负载测试 Python 聊天应用 | 了解在 Python 聊天应用程序中使用 RAG 模式和 Locust(一种常用的开源负载测试工具)对 Python 聊天应用程序执行负载测试的过程。 负载测试的主要目标是确保聊天应用程序中的预期负载不超过当前的 Azure OpenAI 事务每分钟(TPM)配额。 通过在负载过大的情况下模拟用户行为,可以识别应用程序中的潜在瓶颈和可伸缩性问题。 |

| 构建基块 | 说明 |

|---|---|

| 使用 Azure 容器应用进行负载均衡 | 了解如何向应用程序添加负载均衡,以将聊天应用扩展到 Azure OpenAI 令牌和模型配额限制之外。 此方法使用 Azure 容器应用创建三个 Azure OpenAI 终结点以及一个主容器,将传入流量定向到三个终结点中的一个。 |

| 构建基块 | 说明 |

|---|---|

| 评估聊天应用答案 | 了解如何根据一组正确或理想的答案(称为地面真相)评估聊天应用的答案。 每当以影响答案的方式更改聊天应用程序时,请运行评估以比较更改。 此演示应用程序提供目前可以使用的工具,以便更轻松地运行评估。 |

| 使用 Azure 容器应用进行负载均衡 | 了解如何向应用程序添加负载均衡,以将聊天应用扩展到 Azure OpenAI 令牌和模型配额限制之外。 此方法使用 Azure 容器应用创建三个 Azure OpenAI 终结点以及一个主容器,将传入流量定向到三个终结点中的一个。 |

| 使用 API 管理 进行负载均衡 | 了解如何向应用程序添加负载均衡,以将聊天应用扩展到 Azure OpenAI 令牌和模型配额限制之外。 此方法使用 Azure API 管理创建三个 Azure OpenAI 终结点,以及一个主容器,用于将传入流量定向到三个终结点之一。 |

端到端解决方案

端到端解决方案是全面的参考示例,包括文档、源代码和部署,使你能够出于自己的目的采取和扩展。

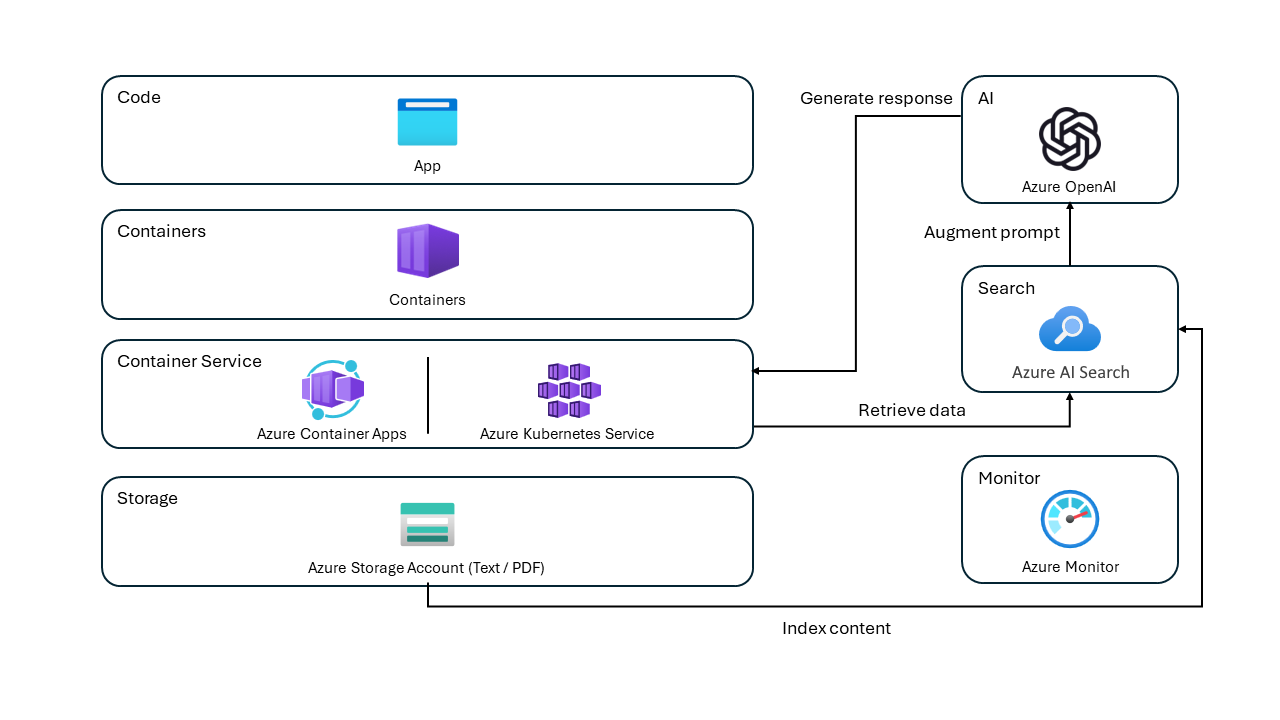

通过 .NET 使用 Azure OpenAI 和 Azure AI 搜索与数据聊天

此模板是一个完整的端到端解决方案,演示在 Azure 中运行的“检索扩充生成”(RAG)模式。 它使用 Azure AI 搜索检索和 Azure OpenAI 大型语言模型为 ChatGPT 样式和 Q&A 体验提供支持。

若要开始使用此模板,请参阅 使用适用于 .NET 的你自己的数据示例开始聊天。 若要访问源代码并阅读有关模板的深入详细信息,请参阅 azure-search-openai-demo-csharp GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps Azure Functions |

Azure OpenAI Azure 计算机视觉 Azure 表单识别器 Azure AI 搜索 Azure 存储 |

GPT 3.5 Turbo GPT 4.0 |

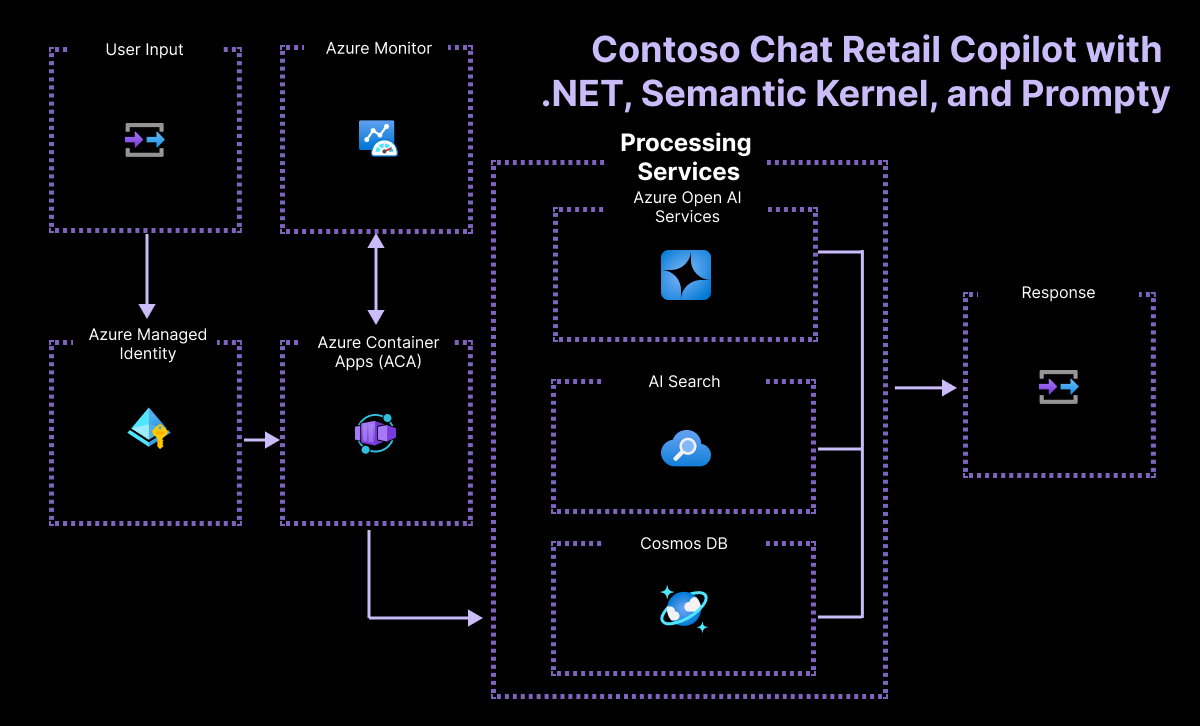

Contoso 聊天零售 Copilot 与 .NET 和语义内核

此模板实施 Contoso Outdoors,这是一家概念性商店,专门从事户外装备,适合徒步旅行和露营爱好者。 此虚拟商店通过智能聊天代理增强客户参与度和销售支持。 此代理由 Microsoft Azure AI Stack 中的“检索扩充生成”(RAG)模式提供支持,该模式由语义内核和 Prompty 支持丰富。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 contoso-chat-csharp-prompty GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps |

Azure OpenAI Microsoft Entra ID Azure 托管标识 Azure Monitor Azure AI 搜索 Azure AI Studio Azure SQL Azure 存储 |

GPT 3.5 Turbo GPT 4.0 |

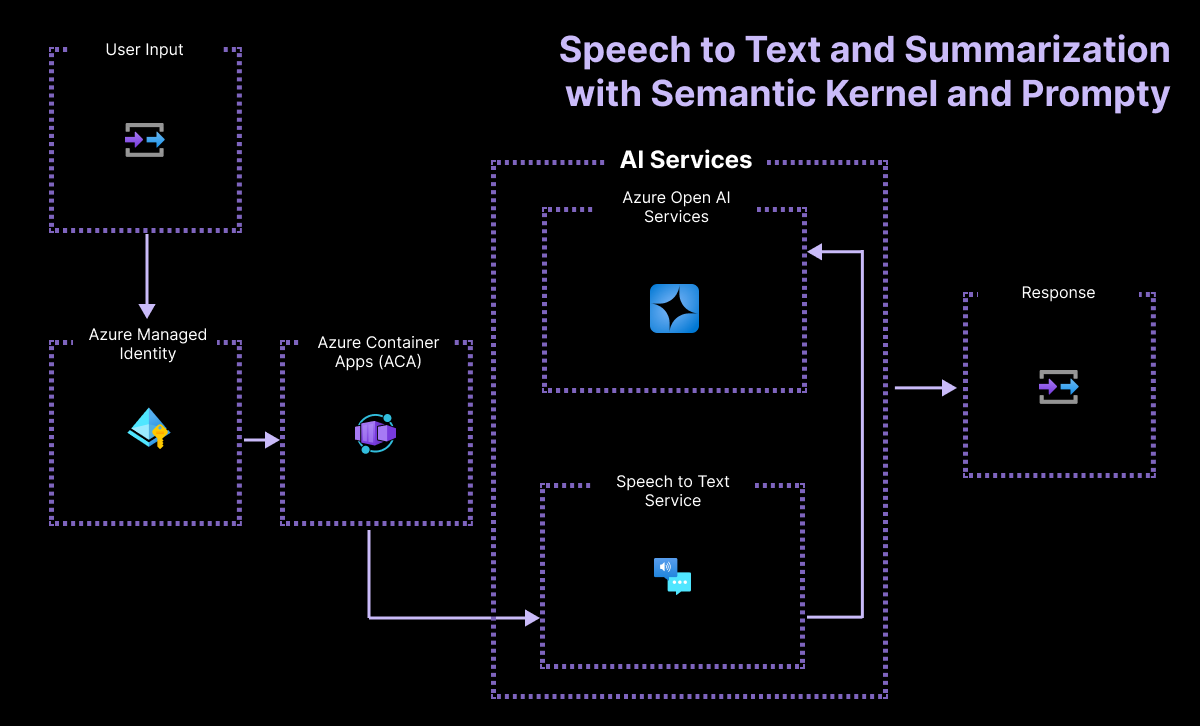

使用语音转文本和 .NET 和 GPT 3.5 Turbo 进行过程自动化和摘要

此模板是一种流程自动化解决方案,用于接收公司 Contoso 制造公司(一家制造汽车电池的制造公司)现场和车间工人报告的问题。 问题由工作人员通过麦克风输入进行实时共享,或预先录制为音频文件。 该解决方案将音频输入从语音转换为文本,然后使用 LLM 和 Prompty 或 Promptflow 汇总问题,并使用解决方案指定的格式返回结果。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 摘要 openai-csharp-prompty GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps | 语音转文本 汇总 Azure OpenAI |

GPT 3.5 Turbo |

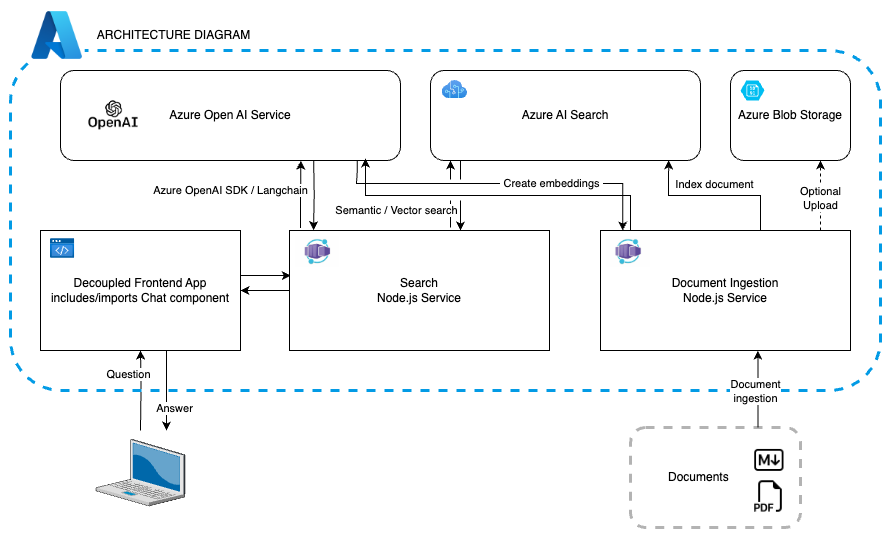

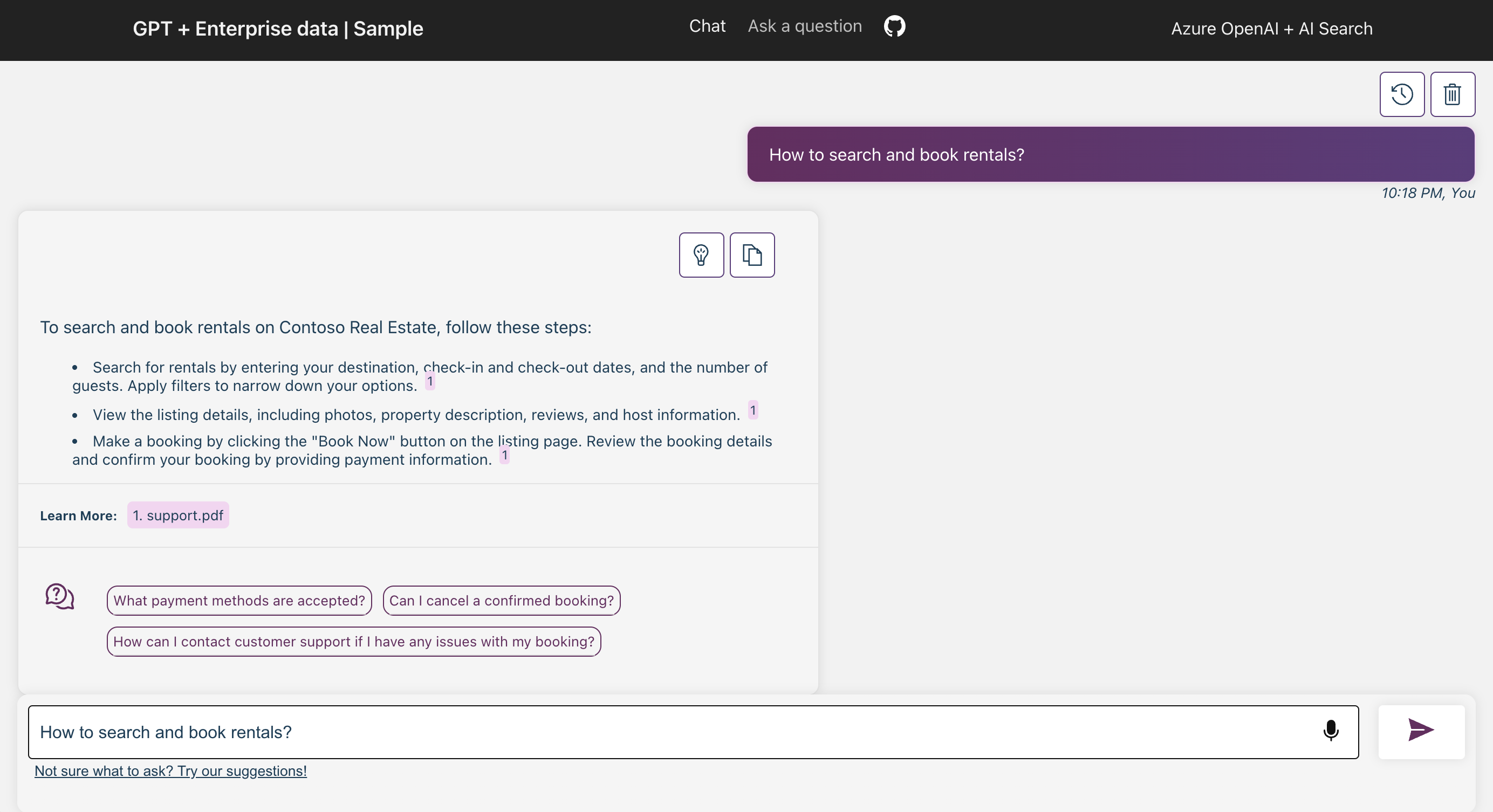

通过 Python 使用 Azure OpenAI 和 Azure AI 搜索与数据聊天

此模板是一个完整的端到端解决方案,演示在 Azure 中运行的“检索扩充生成”(RAG)模式。 它使用 Azure AI 搜索检索和 Azure OpenAI 大型语言模型为 ChatGPT 样式和 Q&A 体验提供支持。

若要开始使用此模板,请参阅 使用自己的 Python 数据示例开始聊天。 若要访问源代码并阅读有关模板的深入详细信息,请参阅 azure-search-openai-demo GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure 应用服务 | Azure OpenAI 必应搜索 Azure 托管标识 Azure Monitor Azure AI 搜索 Azure AI Studio |

GPT 3.5 Turbo GPT 4.0 DALL-E |

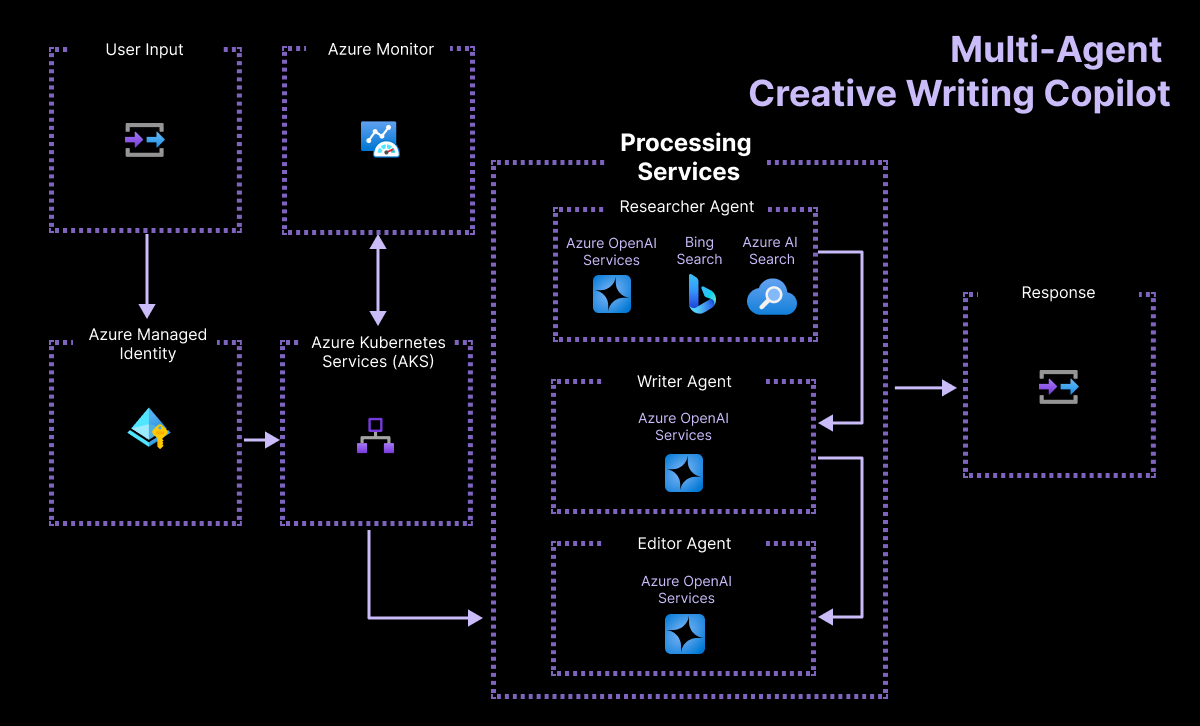

多模式创意写作 Copilot 与 DALL-E

此模板是一种创造性的编写多代理解决方案,可帮助用户编写文章。 它演示如何创建和使用由 Azure OpenAI 驱动的 AI 代理。 它包括一个 Flask 应用,该应用从用户获取主题和说明,然后调用一个使用 必应搜索 API 来研究主题的研究代理、一个使用 Azure AI 搜索 执行语义相似性搜索的来自矢量存储的相关问题、编写器代理将研究和产品信息合并到一篇有用的文章中, 和编辑器代理,用于优化最终向用户呈现的文章。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 agent-openai-python-prompty GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure 容器注册 Azure Kubernetes |

Azure OpenAI 必应搜索 Azure 托管标识 Azure Monitor Azure AI 搜索 Azure AI Studio |

GPT 3.5 Turbo GPT 4.0 DALL-E |

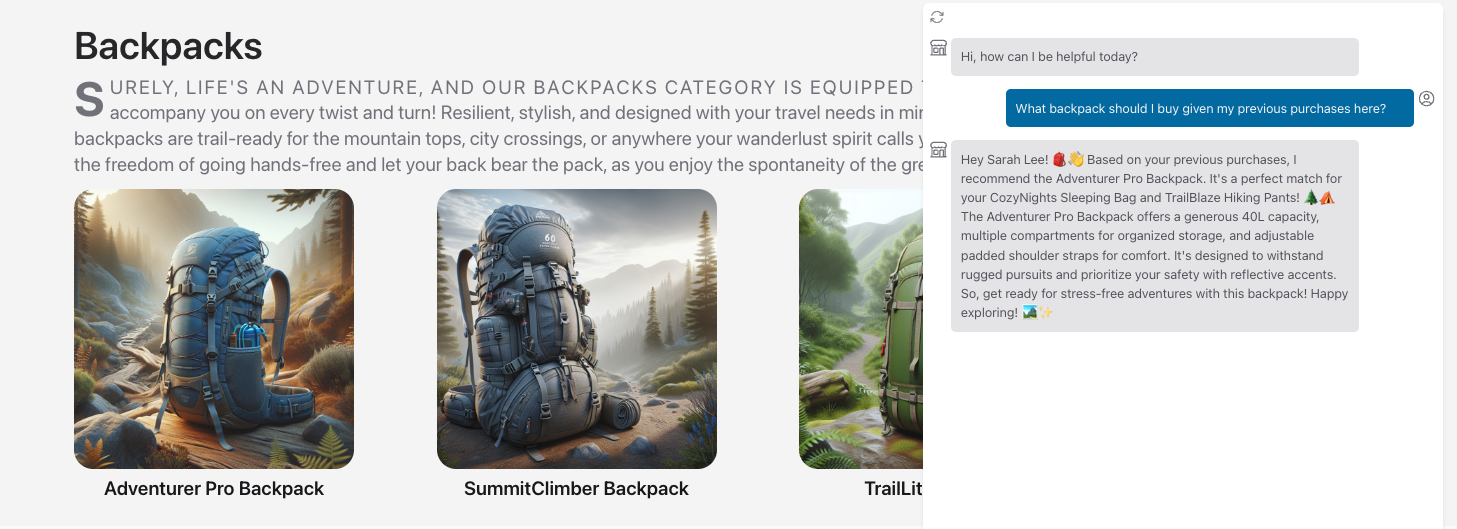

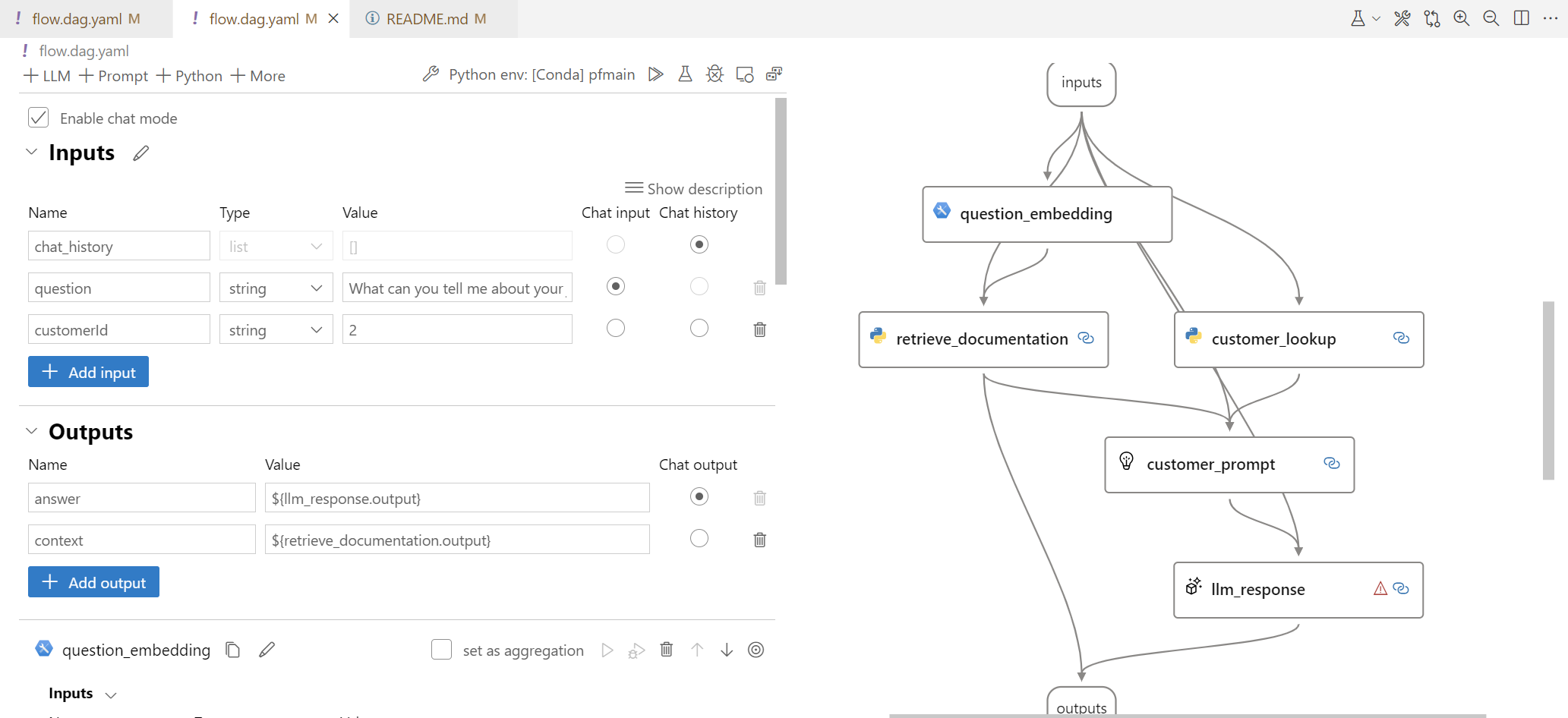

Contoso Chat Retail Copilot with AI Studio

此模板是客户销售和支持聊天解决方案。 它演示如何使用 Azure AI Studio 和 Prompt Flow 使用 RAG(检索扩充生成)体系结构生成大型语言模型(LLM)应用程序。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 contoso-chat GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps |

Azure OpenAI Azure AI 搜索 Azure AI Studio Azure Cosmos DB |

GPT 3.5 Turbo GPT 4.0 托管集成运行时 (MIR) |

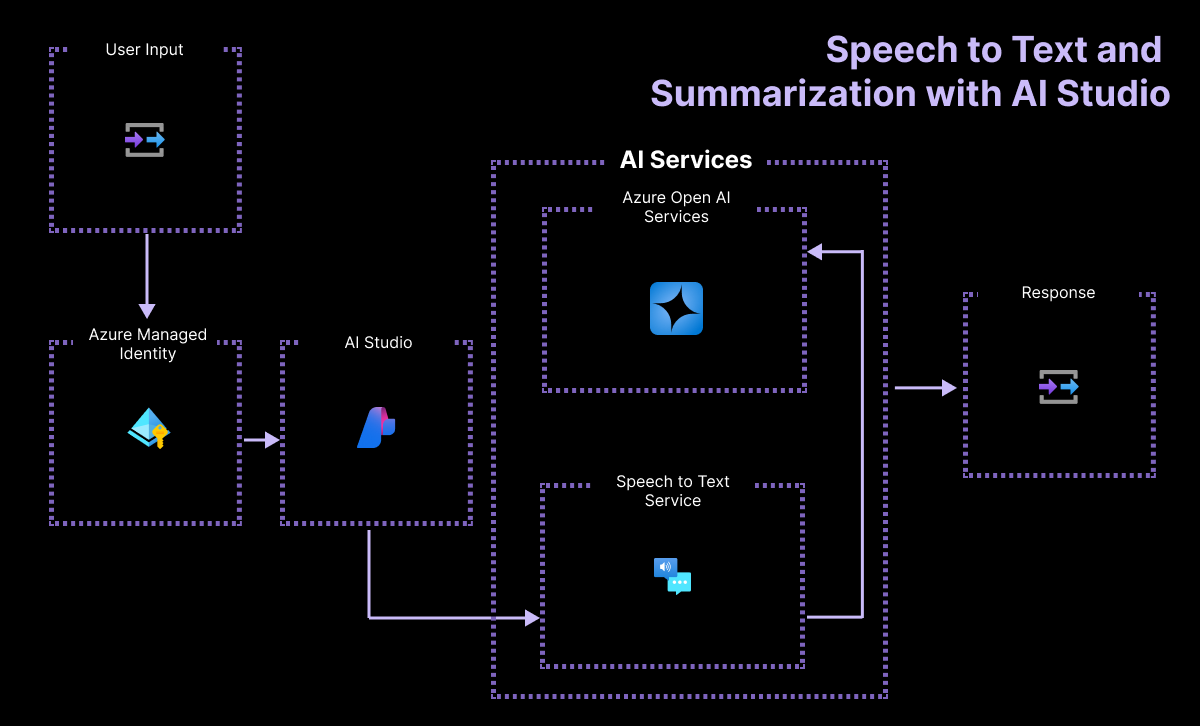

使用语音转文本和使用 AI Studio 进行汇总的过程自动化

此模板是一种流程自动化解决方案,用于接收公司 Contoso 制造公司(一家制造汽车电池的制造公司)现场和车间工人报告的问题。 这些问题由工作人员通过麦克风输入实时进行共享,预先录制为音频文件或文本输入。 该解决方案将音频输入从语音转换为文本,然后使用文本报告作为 LLM 和 Prompty/Promptflow 的输入,以解决方案指定的格式汇总问题并返回结果。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 摘要 openai-python-prompflow GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps | Azure AI Studio 语音转文本服务 提示流 托管集成运行时 (MIR) |

GPT 3.5 Turbo |

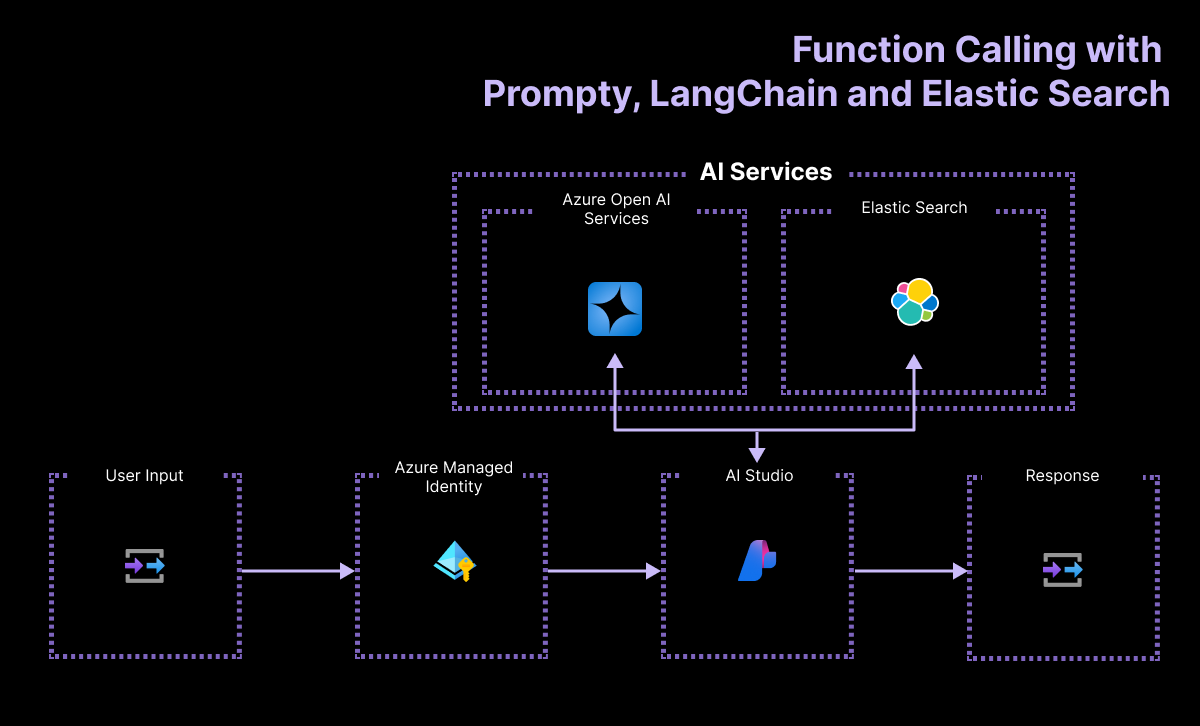

使用 Prompty、LangChain 和弹性搜索进行函数调用

此模板是一个应用程序,它使用 Prompty、Langchain 和 Elasticsearch 构建大型语言模型 (LLM) 搜索代理。 这种具有检索扩充生成(RAG)技术的代理能够通过将实时信息检索与生成响应集成来基于所提供的数据来回答用户问题。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 agent-python-openai-prompty-langchain GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| 机器学习服务 | Azure AI Studio Elastic Search Microsoft Entra ID Azure 托管标识 Azure Monitor Azure 存储 Azure AI Studio 托管集成运行时 (MIR) |

GPT 3.5 Turbo |

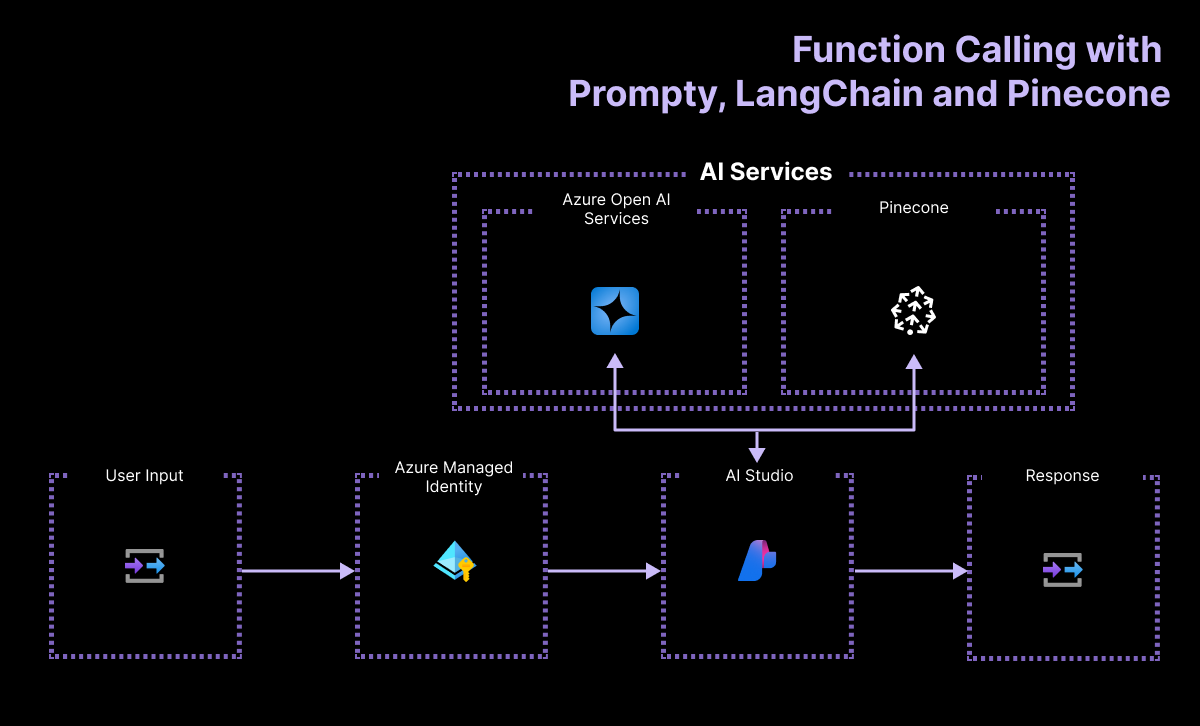

使用 Prompty、LangChain 和 Pinecone 调用的函数

此模板利用新的 Prompty 工具、Langchain 和 Pinecone 构建大型语言模型(LLM)搜索代理。 这种具有检索扩充生成(RAG)技术的代理能够通过将实时信息检索与生成响应集成来基于所提供的数据来回答用户问题。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 agent-openai-python-prompty-langchain-pinecone GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps | Pinecone Microsoft Entra ID Microsoft托管标识 Azure Monitor Azure 存储 |

GPT 3.5 Turbo |

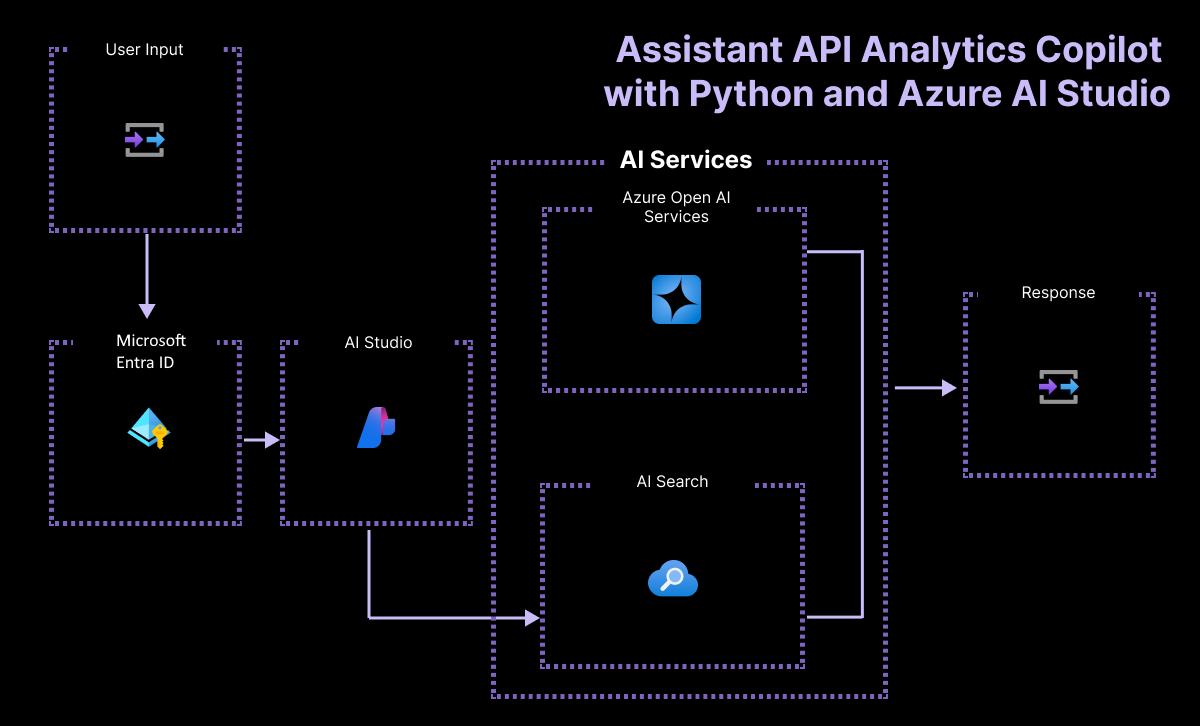

使用 Python 和 Azure AI Studio 的助理 API 分析 Copilot

此模板是一个助手 API,用于与表格数据聊天,并使用自然语言执行分析。 若要访问源代码并阅读有关模板的深入详细信息,请参阅 assistant-data-openai-python-promptflow GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| 机器学习服务 | Azure AI 搜索 Azure AI Studio 托管集成运行时 (MIR) Azure OpenAI |

GPT 3.5 Turbo GPT 4 |

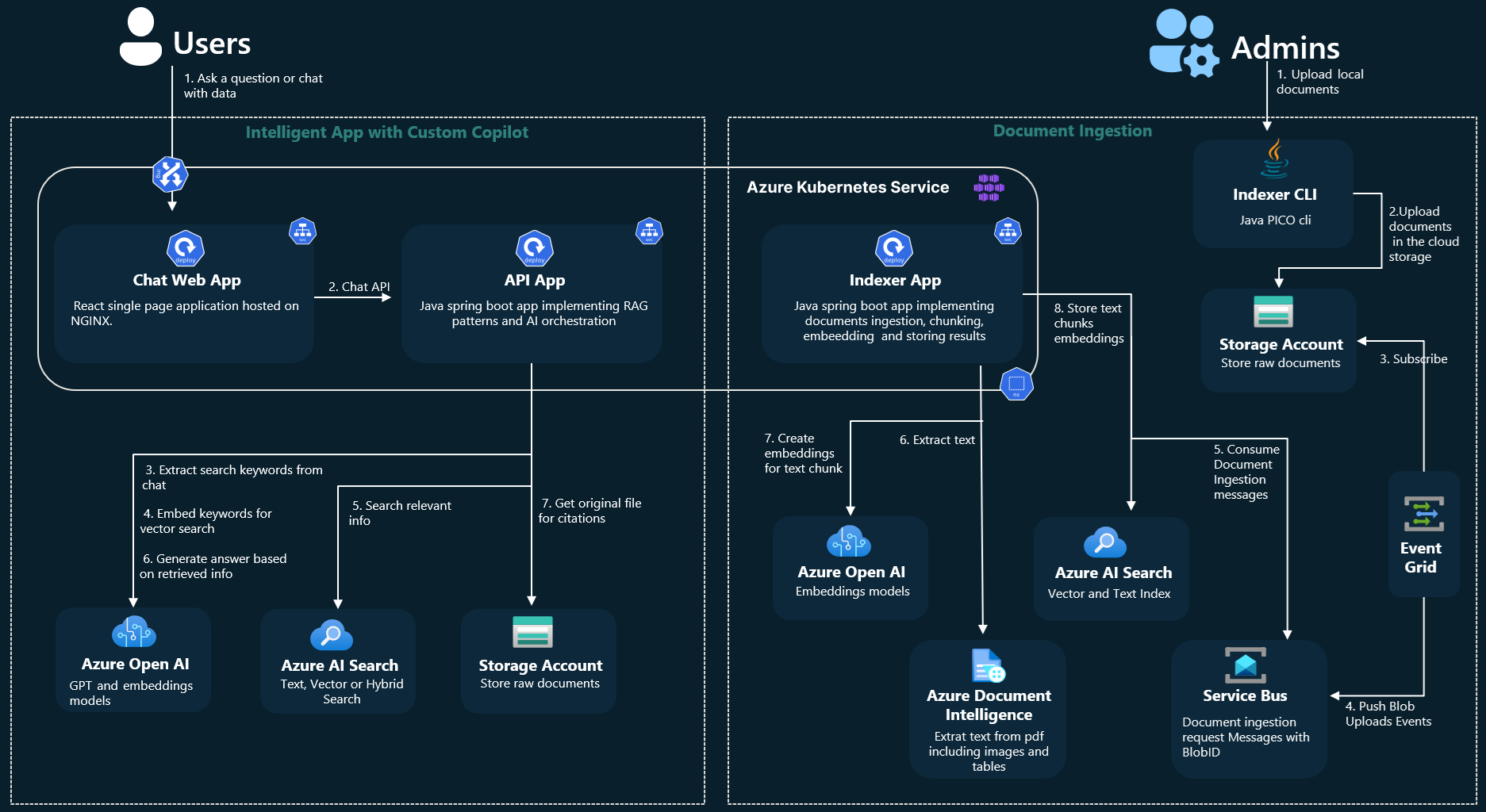

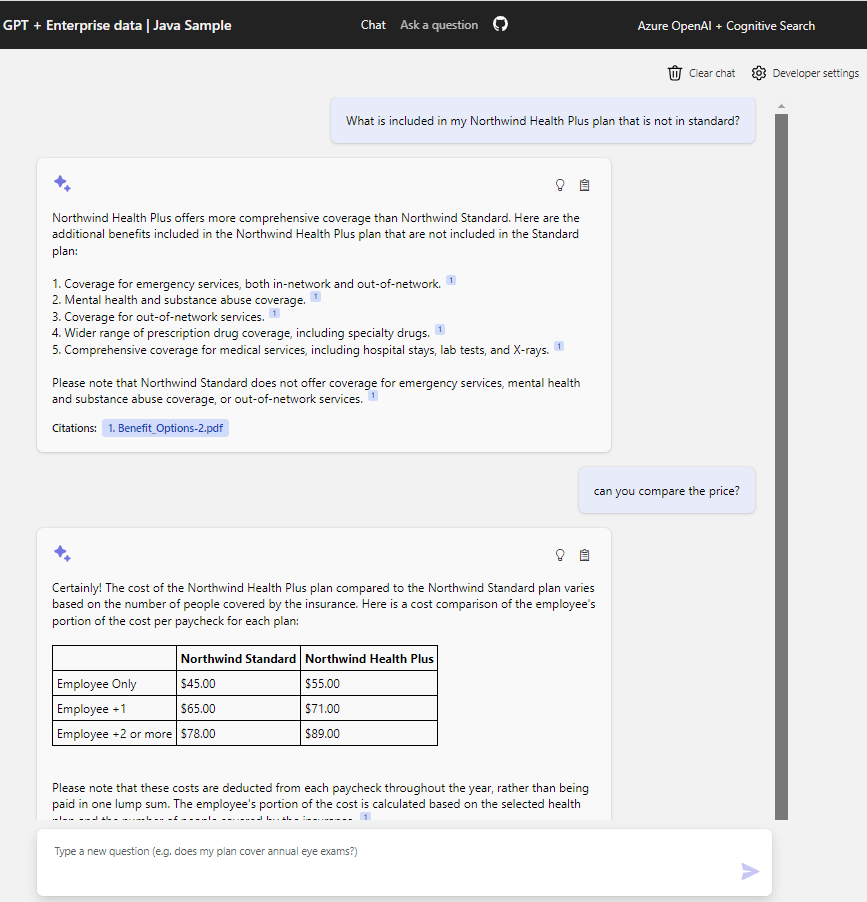

通过 Java 使用 Azure OpenAI 和 Azure AI 搜索与数据聊天

此模板是一个完整的端到端解决方案,演示在 Azure 中运行的“检索扩充生成”(RAG)模式。 它使用 Azure AI 搜索检索和 Azure OpenAI 大型语言模型为 ChatGPT 样式和 Q&A 体验提供支持。

若要开始使用此模板,请参阅 使用自己的 Java 数据示例开始聊天。 若要访问源代码并阅读有关模板的深入详细信息,请参阅 azure-search-openai-demo-java GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure 应用服务 Azure Container Apps Azure Kubernetes 服务 |

Azure OpenAI Azure AI 搜索 Azure 存储 Azure Monitor |

通过 JavaScript 使用 Azure OpenAI 和 Azure AI 搜索与数据聊天

此模板是一个完整的端到端解决方案,演示在 Azure 中运行的“检索扩充生成”(RAG)模式。 它使用 Azure AI 搜索检索和 Azure OpenAI 大型语言模型为 ChatGPT 样式和 Q&A 体验提供支持。

若要开始使用此模板,请参阅 使用自己的 JavaScript 数据示例开始聊天。 若要访问源代码并阅读有关模板的深入详细信息,请参阅 azure-search-openai-javascript GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure Container Apps Azure 静态 Web 应用 |

Azure OpenAI Azure AI 搜索 Azure 存储 Azure Monitor |

text-embedding-ada-002 |

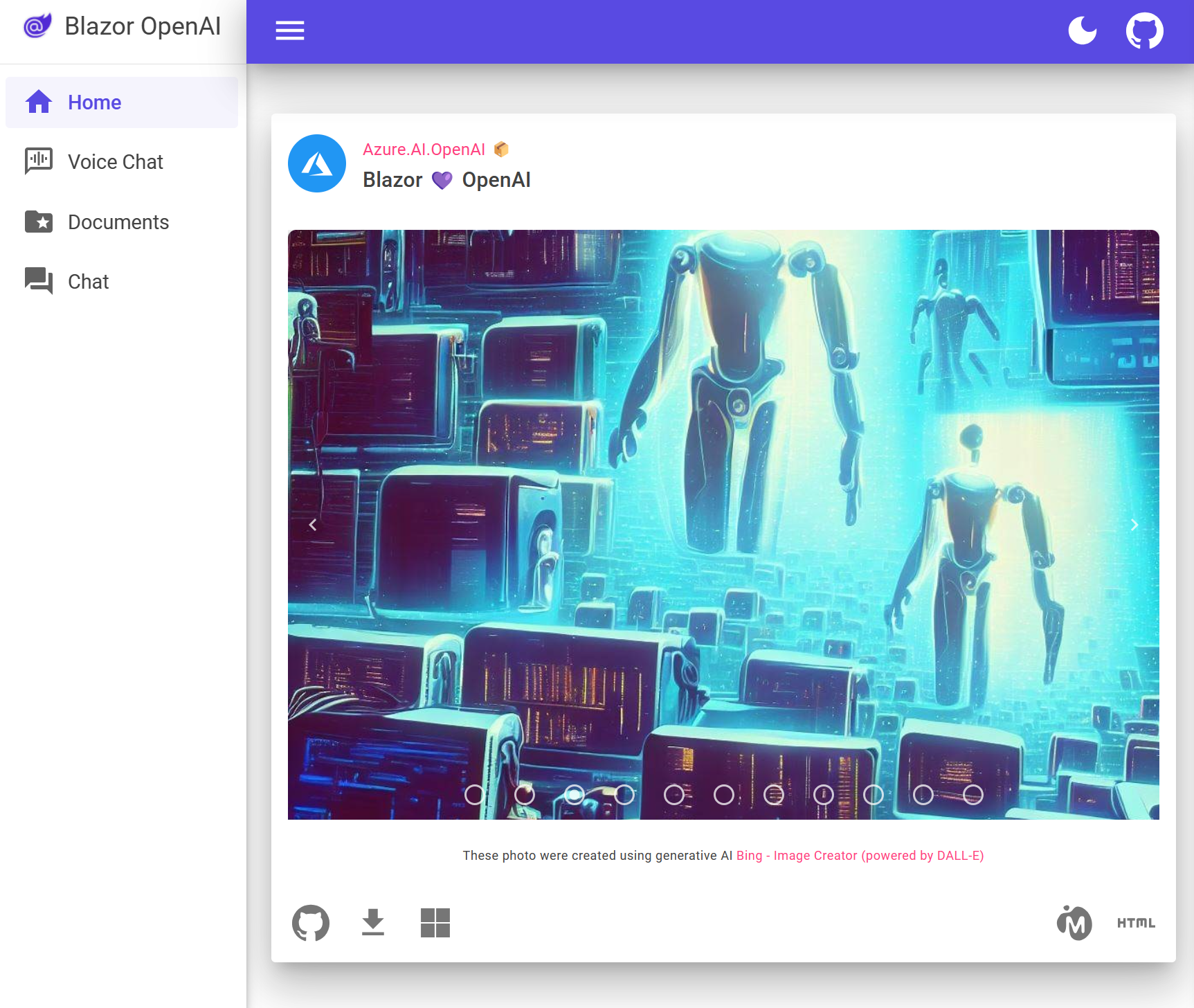

Azure OpenAI 聊天前端

此模板是一个最小的 OpenAI 聊天 Web 组件,可以作为客户端连接到任何后端实现。

若要访问源代码并阅读有关模板的深入详细信息,请参阅 azure-openai-chat-frontend GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure 静态 Web 应用 | Azure AI 搜索 Azure OpenAI |

GPT 3.5 Turbo GPT4 |

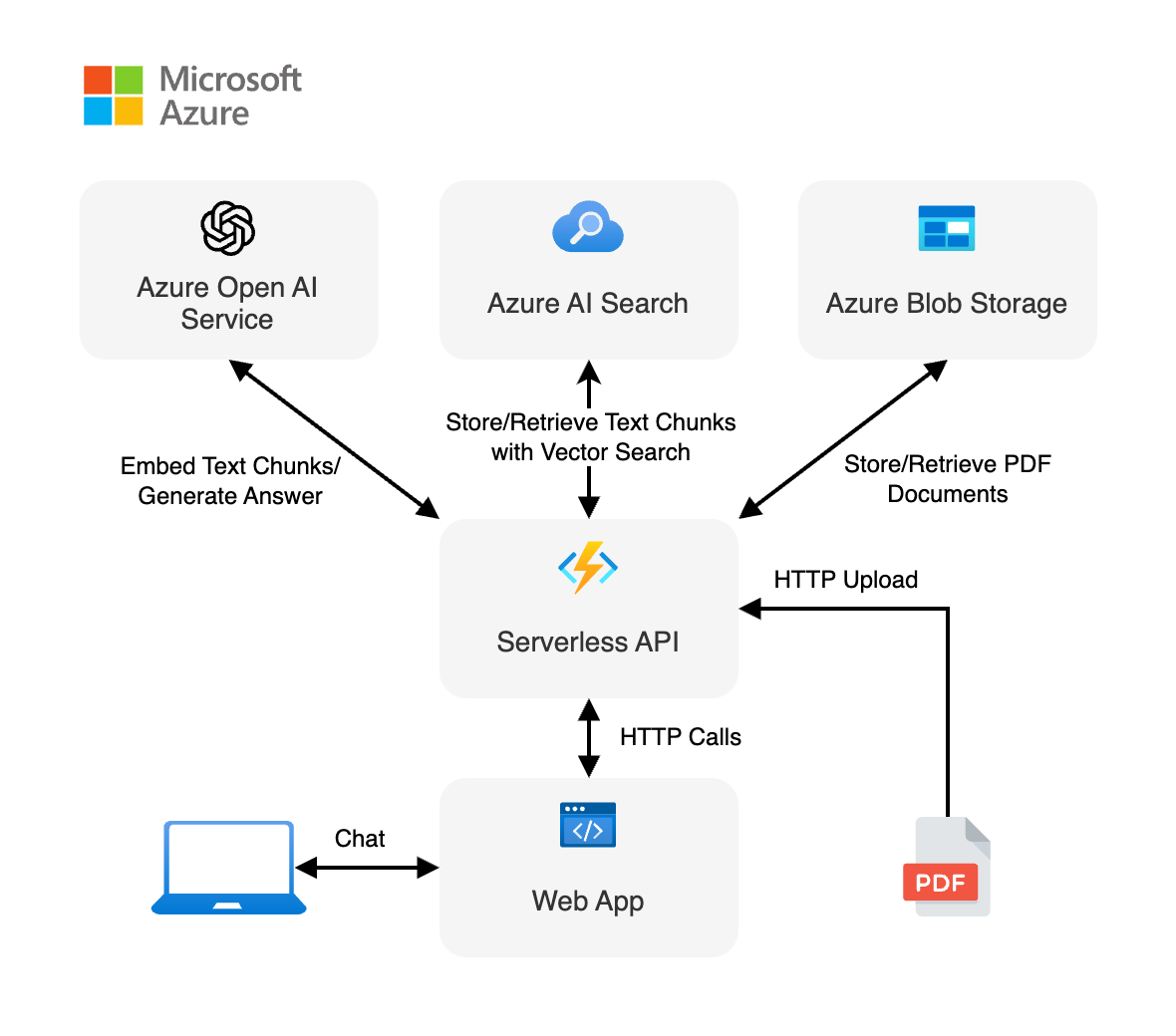

使用 LangChain.js 与 RAG 进行无服务器 AI 聊天

该模板是一个无服务器 AI 聊天机器人,使用 LangChain.js 和 Azure 检索扩充生成,该机器人使用一组企业文档来生成对用户查询的响应。 它使用名为 Contoso Real Estate 的虚构公司,该体验允许其客户就其产品的使用情况提出支持问题。 示例数据包括一组文档,用于描述其服务条款、隐私策略和支持指南。

若要了解如何部署和运行此模板,请参阅 使用 LangChain.js 通过 RAG 进行无服务器 AI 聊天入门。 若要访问源代码并阅读有关模板的深入详细信息,请参阅 无服务器聊天 -langchainjs GitHub 存储库。

此模板演示了这些功能的使用。

| Azure 托管解决方案 | 技术 | AI 模型 |

|---|---|---|

| Azure 静态 Web 应用 Azure Functions |

Azure AI 搜索 Azure OpenAI Azure Cosmos DB Azure 存储 Azure 托管标识 |

GPT4 Mistral Ollama |

反馈

即将发布:在整个 2024 年,我们将逐步淘汰作为内容反馈机制的“GitHub 问题”,并将其取代为新的反馈系统。 有关详细信息,请参阅:https://aka.ms/ContentUserFeedback。

提交和查看相关反馈